Quebrando a barreira de rede na infraestrutura de IA

Sources: https://www.microsoft.com/en-us/research/blog/breaking-the-networking-wall-in-ai-infrastructure, https://www.microsoft.com/en-us/research/blog/breaking-the-networking-wall-in-ai-infrastructure/, Microsoft Research

TL;DR

- Limites de memória e rede no data center restringem o desempenho de IA. Fonte

- MOSAIC usa microLEDs e uma arquitetura óptica ampla e lenta para oferecer conexões mais rápidas, mais longas, mais confiáveis e energeticamente eficientes que podem transformar os projetos de clusters de IA. Fonte

- A abordagem foca em retirar gargalos de interconexão para workloads de IA escaláveis e futuros designs de data centers. Fonte

- O post da Microsoft Research, datado de 19 de março de 2025, apresenta o MOSAIC como caminho para repensar as interconexões da infraestrutura de IA. Fonte

Contexto e antecedentes

O artigo da Microsoft Research identifica uma restrição central na infraestrutura de IA moderna: limites de memória e rede no data center que restringem o desempenho de sistemas de IA. Esse enquadramento enfatiza que o ritmo com que os dados podem ser movidos e acessados entre compute, memória e hierarquias de armazenamento desempenha um papel crucial na taxa de transferência e na eficiência geral da IA. Fonte À medida que as cargas de IA crescem em escala e complexidade, a necessidade de movimentação de dados mais eficiente e de interconexões mais rápidas torna-se cada vez mais evidente. A discussão apresenta a barreira de rede como um gargalo digno de enfrentar para desbloquear novos patamares de capacidade da IA dentro de sistemas em escala de data center. Fonte

O que há de novo

O MOSAIC é apresentado como um conceito que utiliza microLEDs e uma arquitetura óptica ampla e lenta para fornecer interconexões mais rápidas, mais longas, mais confiáveis e mais eficientes energeticamente. Essas características são descritas como qualidades enabling para clusters de IA de próxima geração e para possíveis mudanças no desenho de data centers. Fonte

Por que isso importa (impacto para desenvolvedores/empresas)

Para desenvolvedores e empresas que expandem cargas de IA, o desempenho de interconexão afeta diretamente a taxa de treinamento de modelos, a vazão de inferência e a eficiência operacional. A proposta MOSAIC aponta para uma abordagem que pode mitigar gargalos de movimentação de dados e melhorar a confiabilidade em grandes clusters de IA, potencialmente influenciando a arquitetura e a operação de data centers. Fonte Embora cronogramas de implantação específicos não sejam fornecidos, a pesquisa apresenta uma direção com implicações significativas para implantações escaláveis de IA e para o ecossistema de data centers. Fonte

Detalhes técnicos ou Implementação

- MOSAIC usa microLEDs como parte de sua estratégia de interconexão.

- Aplica uma arquitetura óptica ampla e lenta para alcançar os benefícios de desempenho reivindicados.

- A combinação visa oferecer conexões mais rápidas, mais longas, mais confiáveis e mais eficientes energeticamente em comparação com abordagens de rede convencionais em data centers. Fonte

Principais conclusões

- A barreira de rede é identificada como gargalo em infraestrutura de IA pela Microsoft Research. Fonte

- MOSAIC propõe interconexões baseadas em microLEDs com uma abordagem óptica ampla e lenta. Fonte

- A abordagem visa conexões mais rápidas, mais longas, mais confiáveis e energeticamente eficientes que poderiam transformar o design de clusters de IA. Fonte

- Indício de pesquisa inicial com implicações potenciais para arquiteturas futuras de data centers e implantações de IA. Fonte

FAQ

-

O que é MOSAIC?

MOSAIC é um conceito da Microsoft Research que usa microLEDs e uma arquitetura óptica ampla e lenta para viabilizar melhores interconexões na infraestrutura de IA. [Fonte](https://www.microsoft.com/en-us/research/blog/breaking-the-networking-wall-in-ai-infrastructure/)

-

Por que o desempenho de interconexão é importante para IA?

Limites de memória e rede no data center restringem o desempenho de IA, tornando interconexões de alta vazão e baixa latência críticas para cargas de IA escaláveis. [Fonte](https://www.microsoft.com/en-us/research/blog/breaking-the-networking-wall-in-ai-infrastructure/)

-

uais benefícios a MOSAIC promete?

Conexões mais rápidas, mais longas, mais confiáveis e energeticamente eficientes que podem transformar o design de clusters de IA. [Fonte](https://www.microsoft.com/en-us/research/blog/breaking-the-networking-wall-in-ai-infrastructure/)

-

uando isso foi discutido?

O post da Microsoft Research é datado de 19 de março de 2025. [Fonte](https://www.microsoft.com/en-us/research/blog/breaking-the-networking-wall-in-ai-infrastructure/)

Referências

More news

Shadow Leak mostra como agentes do ChatGPT podem exfiltrar dados do Gmail via injeção de prompt

Pesquisadores de segurança demonstraram uma injeção de prompt chamada Shadow Leak que usou o Deep Research do ChatGPT para extrair dados de uma caixa de entrada do Gmail. OpenAI corrigiu a falha; o caso destaca riscos de IA com atuação autônoma.

Microsoft transforma site da Foxconn no data center Fairwater AI, considerado o mais poderoso do mundo

A Microsoft divulga planos para um data center Fairwater AI de 1,2 milhão de pés quadrados no Wisconsin, com centenas de milhares de GPUs Nvidia GB200. projeto de US$ 3,3 bilhões promete treinamento de IA em escala sem precedentes.

Deteção e redução de scheming em modelos de IA: avanços, métodos e implicações

OpenAI e Apollo Research avaliaram desalineação oculta em modelos de fronteira, observaram comportamentos de scheming e testaram um método de alinhamento deliberativo que reduziu ações encobertas em cerca de 30x, com limitações e trabalhos em andamento.

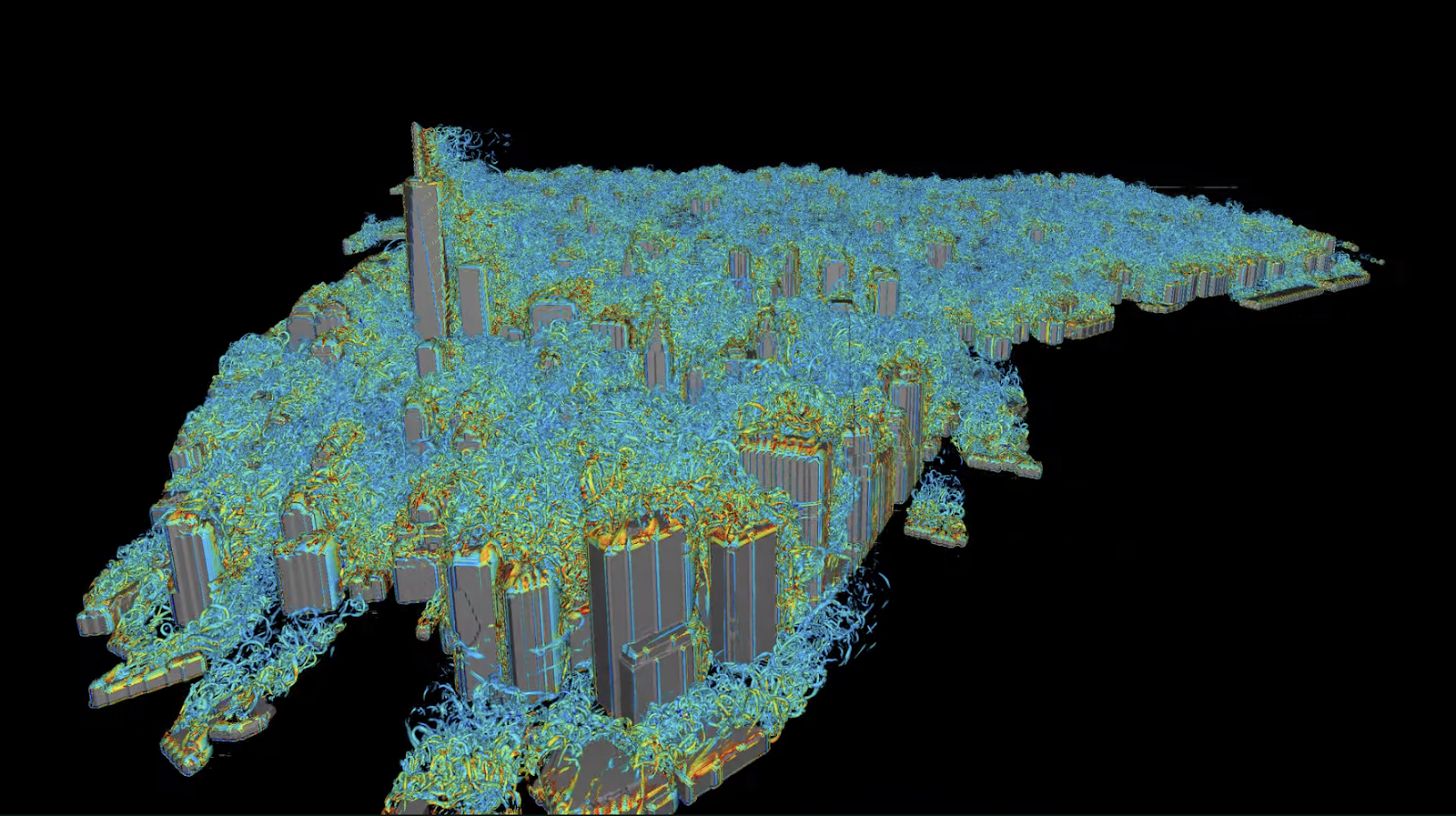

Autodesk Research Revoluciona CFD com Warp no NVIDIA GH200

Autodesk Research, NVIDIA Warp e GH200 mostram CFD baseado em Python com XLB: ~8x de velocidade, até 50 bilhões de células e desempenho próximo a soluções OpenCL/C++.

Interferência no espaço de ferramentas na era MCP: projetando para compatibilidade de agentes em escala

Microsoft Research aborda interferência no espaço de ferramentas na era MCP e descreve considerações de design para compatibilidade de agentes em escala, com Magentic-UI como exemplo ilustrativo.

RenderFormer: How neural networks are reshaping 3D rendering

RenderFormer, from Microsoft Research, is the first model to show that a neural network can learn a complete graphics rendering pipeline. It’s designed to support full-featured 3D rendering using only machine learning—no traditional graphics computation required. The post RenderFormer: How neural ne