Conectando Centros de Dados Distribuídos em Grandes Fábricas de IA com Scale-Across Networking

Sources: https://developer.nvidia.com/blog/how-to-connect-distributed-data-centers-into-large-ai-factories-with-scale-across-networking, https://developer.nvidia.com/blog/how-to-connect-distributed-data-centers-into-large-ai-factories-with-scale-across-networking/, NVIDIA Dev Blog

TL;DR

- O Spectrum-XGS Ethernet permite scale-across networking para conectar centros de dados distribuídos em uma única fábrica de IA em longas distâncias (acima de 500 metros).

- Utiliza a plataforma de hardware NVIDIA Spectrum-X Ethernet ( switches Spectrum-X e SuperNICs ConnectX-8 ) com controle de congestionamento baseado em telemetria e roteamento adaptativo sensível à distância para minimizar a latência.

- Em testes NCCL a 10 km, o Spectrum-XGS oferece até 1,9x mais largura de banda all-reduce do que Ethernet convencional, especialmente para mensagens maiores.

- A tecnologia unifica centros de dados independentemente da proximidade, aumentando a fungibilidade da infraestrutura de IA e habilitando treinamento de grande escala com uma única tarefa e inferência distribuída.

- Aborda problemas de latência e jitter associados ao Ethernet de longo alcance com buffers profundos, oferecendo desempenho previsível para cargas de trabalho síncronas de IA. NVIDIA

Contexto e antecedentes

A escalada de IA é extremamente complexa, e novas técnicas em treinamento e inferência exigem cada vez mais da data center. Embora as capacidades dos data centers estejam crescendo rapidamente, a infraestrutura física impõe limitações que não afetam algoritmos e modelos. Disponibilidade de energia, capacidade de refrigeração e espaço físico impõem limites ao footprint de uma fábrica de IA. Para continuar crescendo, novos data centers são criados, e a conectividade à distância se torna um fator para reunir recursos para executar workloads de treinamento distribuído ou de inferência desagrupada. NVIDIA Tradicionalmente, ao conectar data centers com Ethernet de longa distância feito com silício comerciante “pronto para uso”, o objetivo principal era garantir que os dados chegassem ao destino. Como as distâncias podem ser longas e as latências altas, a possibilidade de congestão é alta, e o impacto pode ser extremo. Para mitigar esse desafio e evitar a queda de pacotes, fornecedores de Ethernet de prateleira criam soluções com buffers profundos para absorver grandes picos de tráfego. Embora esses buffers resolvam problemas para provedores de serviço de longa distância e telecomunicações, eles introduzem problemas para IA. Em particular, switches com buffers profundos sofrem latências maiores e, quando o buffer enche, ele precisa drenar. Para workloads de IA, esse evento é imprevisível, gerando jitter significativo na entrega de dados. Latência alta e imprevisibilidade dessa técnica de absorção tornam-se problemáticos para treinamento e inferência distribuída, que são tarefas síncronas e requerem desempenho previsível da rede. Este post explica como o NVIDIA Spectrum-XGS Ethernet para scale-across networking oferece conectividade entre data centers com o desempenho necessário para IA. NVIDIA A scale-across networking é uma nova categoria de conectividade de computação de IA, que pode ser vista como uma nova dimensão, ortogonal às opções existentes de scale-up e scale-out. Com o Spectrum-XGS Ethernet para scale-across networking, múltiplos data centers de tamanhos e distâncias variados podem ser unidos como uma única grande fábrica de IA. Pela primeira vez, a rede pode entregar o desempenho necessário para treinamento de IA em grande escala e inferência em locais geograficamente separados. O Spectrum-XGS Ethernet é uma adição tecnológica à plataforma NVIDIA Spectrum-X Ethernet. Baseia-se no mesmo conjunto de hardware dos switches Spectrum-X e das SuperNICs ConnectX-8, e utiliza a mesma pilha de software e bibliotecas empregadas para conectividade de scale-out dentro do data center. Com o Spectrum-XGS Ethernet, a conectividade é entre fábricas de IA em distâncias longas; isto é, mais de 500 metros. Isso pode significar conectividade entre edifícios em um campus, ou entre dezenas ou centenas de milhas, através de cidades ou estados e até países. Para tornar a conectividade scale-across factível, os algoritmos responsáveis por assegurar banda efetiva alta e isolamento de desempenho precisaram evoluir. NVIDIA Um dos desafios de mover dados por grandes distâncias é a menor latência resultante—mesmo para dados que trafegam por fibra óptica na forma de luz. Os dados se propagam através das fibras a uma velocidade de 5 nanosegundos por metro. Isso significa que percorrer 1 quilômetro consome 5 microssegundos. Esses números podem parecer baixos em termos absolutos, mas para comunicação GPU-a-GPU cada microssegundo conta. O Spectrum-XGS Ethernet apresenta controle de congestionamento baseado em telemetria modificado e roteamento adaptativo que são otimizados levando em conta a distância entre dispositivos que se comunicam. Quando uma conexão é iniciada, a rede observa se os dispositivos estão dentro do mesmo data center ou não. Isso ajuda o switch a escolher a melhor abordagem de balanceamento de carga para roteamento adaptativo e informa a SuperNIC sobre a taxa de injeção para o controle de congestionamento. Em nível de rede, isso permite que o Spectrum-XGS Ethernet gerencie as comunicações de forma holística sem introduzir latência adicional. NVIDIA Alguns dos principais benefícios da tecnologia Spectrum-XGS Ethernet para scale-across networking incluem:

- Para mostrar o impacto do Spectrum-XGS Ethernet no desempenho de scale-across, engenheiros da NVIDIA executaram primitivas NCCL entre vários sites a uma distância de 10 km e compararam com Ethernet de prateleira. Os resultados mostram até 1,9x maior largura de banda NCCL all-reduce. O maior ganho ocorre com mensagens maiores, as quais são comuns em cargas de treinamento de IA. Esses aprimoramentos se traduzem em tempos de conclusão de jobs mais rápidos para aplicações de IA. NVIDIA

- O Spectrum-XGS Ethernet aumenta a fungibilidade da infraestrutura de IA. Ao introduzir uma tecnologia que permite que data centers se comuniquem a qualquer distância sem degradação de desempenho, o Spectrum-XGS Ethernet cria uma arquitetura comum entre scale-out e scale-across networking. Data centers Ethernet baseados no Spectrum-XGS podem ser combinados para operar como um único sistema, independentemente da proximidade. Isso habilita infraestruturas de IA críticas a agregar recursos e manter o valor para workloads avançados de IA. NVIDIA Para saber mais sobre as inovações técnicas por trás do NVIDIA Spectrum-X Ethernet, veja a NVIDIA Spectrum-X Network Platform Architecture. NVIDIA

More news

NVIDIA HGX B200 reduz a Intensidade de Emissões de Carbono Incorporado

O HGX B200 da NVIDIA reduz 24% da intensidade de carbono incorporado em relação ao HGX H100, ao mesmo tempo em que aumenta o desempenho de IA e a eficiência energética. Esta análise resume os dados de PCF e as novidades de hardware.

Scaleway Como Novo Fornecedor de Inferência no Hugging Face para Inferência serverless de Baixa Latência

A Scaleway é agora um Fornecedor de Inferência compatível no Hugging Face Hub, permitindo inferência serverless diretamente nas páginas de modelo com as SDKs JS e Python. Acesse modelos abertos populares com operações escaláveis e baixa latência.

Prever Eventos Climáticos Extremos em Minutos sem Supercomputador com Huge Ensembles (HENS)

NVIDIA e o Lawrence Berkeley National Laboratory apresentam Huge Ensembles (HENS), uma ferramenta de IA de código aberto que prevê eventos climáticos raros e de alto impacto usando 27.000 anos de dados, com opções de código aberto ou prontos para uso.

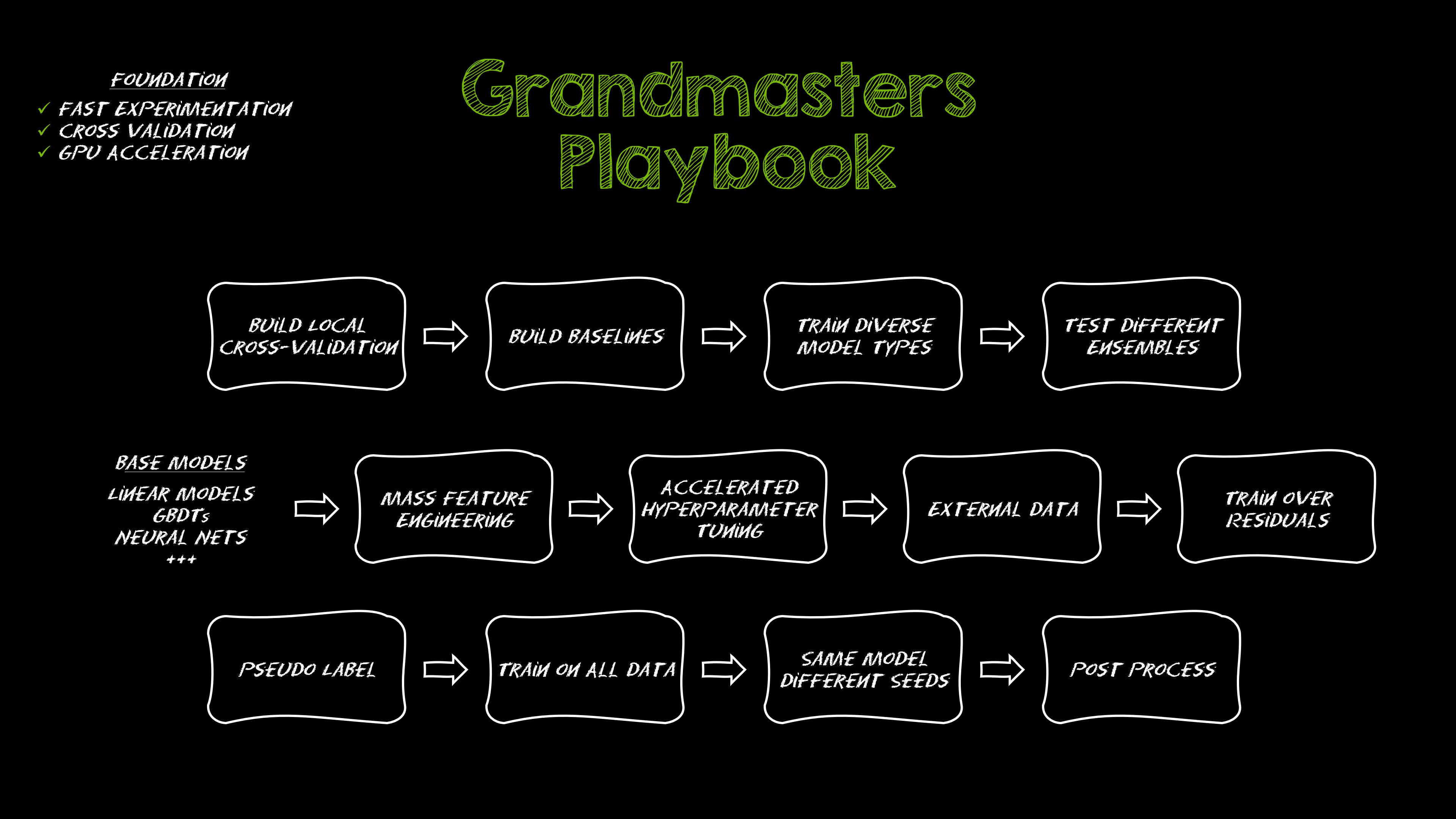

Playbook dos Grandmasters do Kaggle: 7 Técnicas de Modelagem Testadas para Dados Tabulares

Análise detalhada de sete técnicas testadas por Grandmasters do Kaggle para resolver grandes conjuntos de dados tabulares com aceleração por GPU, desde baselines diversificados até ensemble avançado e pseudo-rotulagem.

Como reduzir gargalos do KV Cache com NVIDIA Dynamo

O Dynamo da NVIDIA transfere o KV Cache da memória da GPU para armazenamento de custo mais baixo, permitindo janelas de contexto maiores, maior concorrência e menor custo de inferência em grandes modelos.

NVIDIA RAPIDS 25.08 Adiciona Novo Profiler para cuML, Melhorias no Motor GPU Polars e Suporte Ampliado de Algoritmos

RAPIDS 25.08 traz profiladores function-level e line-level para cuml.accel, executor streaming padrão no motor GPU Polars, suporte ampliado de tipos e strings, novo Spectral Embedding no cuML e acelerações com zero código para mais algoritmos.