Enviando agentes mais inteligentes com cada novo modelo: SafetyKit usa GPT-5 para moderação mais segura e inteligente

Sources: https://openai.com/index/safetykit, OpenAI

TL;DR

- SafetyKit usa agentes de IA multimodais alimentados por GPT‑5 e GPT‑4.1 para detectar e agir diante de fraudes e atividades proibidas em texto, imagens, transações financeiras e listagens de produtos. OpenAI SafetyKit

- Ele revisa 100% do conteúdo do cliente com mais de 95% de precisão com base nas avaliações do SafetyKit.

- A plataforma agora abrange risco em pagamentos, fraude, exploração infantil, AML e atende a centenas de milhões de usuários finais.

- Uma abordagem de correspondência de modelos encaminha o conteúdo para o melhor agente e o modelo ideal para cada violação, oferecendo aplicação mais nuançada entre modalidades.

- Desde o início, SafetyKit processa mais de 16 bilhões de tokens por dia, um salto em relação aos 200 milhões de seis meses atrás, permitindo cobertura de risco mais rápida e ampla.

Contexto e antecedentes

OpenAI SafetyKit constrói agentes de IA multimodais para ajudar marketplaces, plataformas de pagamento e fintechs a detectar e agir diante de fraudes e atividades proibidas em texto, imagens, transações financeiras, listas de produtos e muito mais. Avanços recentes em raciocínio de modelos e compreensão multimodal tornam isso mais eficaz, estabelecendo um novo patamar para operações de risco, conformidade e segurança. Os agentes do SafetyKit utilizam GPT‑5, GPT‑4.1, pesquisas profundas e Computer Using Agent (CUA) para revisar 100% do conteúdo do cliente com mais de 95% de exatidão com base nas avaliações do SafetyKit. Eles ajudam plataformas a proteger usuários, prevenir fraudes, evitar multas regulatórias e aplicar políticas complexas que sistemas legados podem deixar passar, como regras regionais e números de telefone embutidos em imagens de golpes, ou conteúdo explícito. A automação também protege moderadores humanos da exposição a material ofensivo, libertando-os para decisões de políticas mais nuanas. Os agentes do SafetyKit são criados para lidar com categorias de risco específicas, desde golpes até produtos ilegais. Todo conteúdo é encaminhado ao agente mais adequado para a violação, usando o modelo OpenAI ideal: Essa abordagem de correspondência de modelo permite escalar a revisão de conteúdo entre modalidades com mais nuance e precisão do que soluções legadas. O agente de Detecção de Golpes, por exemplo, vai além de apenas escanear texto. Ele analisa elementos visuais como QR codes ou números de telefone embutidos em imagens de produtos. O GPT‑4.1 ajuda a interpretar a imagem, entender o layout e decidir se há violação de políticas. O agente de Divulgação de Políticas verifica listas ou páginas de destino quanto a linguagem obrigatória, como avisos legais ou avisos de conformidade por região. O GPT‑4.1 extrai as seções relevantes, e o GPT‑5 avalia a conformidade, sinalizando violações. “Pensamos nos nossos agentes como fluxos de trabalho criados sob medida”, diz Graunke. “Algumas tarefas exigem raciocínio profundo, outras requerem contexto multimodal. O OpenAI é o único stack que entrega desempenho confiável em ambos.” Decisões de políticas costumam depender de distinções sutis. Considere um marketplace que exige que vendedores incluam um aviso para produtos de bem-estar, com requisitos variando conforme as alegações do produto e as regras regionais. Fornecedores legados usam gatilhos por palavras-chave ou regras rígidas, o que pode deixar passar decisões mais profundas. O agente de Divulgação de Política do SafetyKit primeiro consulta a biblioteca interna de políticas e então o GPT‑5 avalia o conteúdo: ele menciona tratamento ou prevenção? Está sendo vendido em uma região onde o aviso é obrigatório? E se sim, a linguagem exigida está realmente inclusa na listagem? Se alguma pendência existir, o GPT‑5 retorna uma saída estruturada que o agente usa para sinalizar o problema. “O poder do GPT‑5 está em quão precisamente ele pode raciocinar quando fundamentado em políticas reais”, observa Graunke. “Isso nos permite tomar decisões precisas e defensáveis mesmo em casos limite onde outros sistemas falham.” O SafetyKit faz avaliações de referência com cada novo modelo OpenAI em relação aos seus casos mais difíceis, muitas vezes implantando os melhores desempenhos no mesmo dia. Avaliações internas rigorosas permitem à equipe identificar rapidamente como novos modelos podem melhorar o desempenho e se integrar de forma contínua à infraestrutura central. Quando o OpenAI o3 foi lançado, o SafetyKit o utilizou para melhorar o desempenho em casos limítrofes em áreas políticas-chave. O GPT‑5 foi lançado em seguida, e em poucos dias já foi aplicado aos seus agentes mais exigentes, elevando as pontuações de referência em mais de 10 pontos em suas tarefas de visão mais desafiadoras. “OpenAI avança rapidamente, e projetamos nosso sistema para acompanhar. Cada nova versão nos dá uma vantagem operacional — abrindo novas capacidades e domínios que não podíamos suportar antes, aumentando a cobertura e a precisão que oferecemos aos clientes”, diz Graunke. O SafetyKit também alimenta melhorias no ecossistema, compartilhando resultados de avaliações, falhas em casos de borda e percepções específicas de políticas diretamente com a OpenAI para ajudar a moldar o desempenho futuro de modelos voltados a workloads críticos de segurança. A arquitetura do SafetyKit aplica políticas em escala, entregando velocidade, precisão e cobertura de risco abrangente. Nos bastidores, ele agora lida com mais de 16 bilhões de tokens diários, upando de 200 milhões há seis meses, analisando mais conteúdo sem sacrificar a precisão. Nesse mesmo período, o SafetyKit expandiu para risco de pagamentos, fraude, combate à exploração infantil, combate à lavagem de dinheiro e novos clientes com centenas de milhões de usuários finais sob proteção do SafetyKit. Essa base capacita clientes a responder rápida e seguramente a riscos emergentes. “Criamos um ciclo em que cada lançamento da OpenAI fortalece diretamente nossas capacidades”, afirma Graunke. “É por isso que o sistema se aprimora continuamente, sempre mantendo-se à frente de riscos em evolução.”

O que há de novo

- Da prototipagem com visões iniciais a escalar com o GPT‑5, os agentes multimodais do SafetyKit se expandem para novos domínios e elevam a precisão. Os agentes do SafetyKit revisam conteúdo em texto, imagens e dados financeiros para detectar e agir contra atividades proibidas.

- A plataforma agora abrange risco em pagamentos, fraude, AML e exploração infantil, alcançando centenas de milhões de usuários.

- Um fluxo de correspondência de modelos envia cada item ao melhor agente e ao modelo mais adequado, possibilitando aplicação mais precisa entre modalidades. O agente de Detecção de Golpes, por exemplo, analisa elementos visuais como QR codes ou números de telefone embutidos em imagens, com o GPT‑4.1 auxiliando na extração de layout e interpretação.

- Decisões de política são fundamentadas na biblioteca interna de políticas do SafetyKit, com o GPT‑5 fornecendo a avaliação final de conformidade e sinalizando quando linguagem ou divulgações estiverem ausentes.

- Avaliações internas rápidas promovem a adoção de modelos de alto desempenho logo após lançamentos da OpenAI, com melhorias disponíveis no mesmo dia.

- A arquitetura continua escalando para processar bilhões de tokens diários sem comprometer a precisão, alimentando melhorias contínuas para a OpenAI moldar futuras capacidades de modelos voltados a segurança.

Por que isso importa (impacto para desenvolvedores/empresas)

Para desenvolvedores e empresas construindo marketplaces digitais, plataformas de pagamento ou serviços financeiros, o SafetyKit oferece uma abordagem escalável para aplicação de políticas e gestão de risco. Com GPT‑5, GPT‑4.1 e CUAs em conjunto, o SafetyKit proporciona decisões precisas e defensáveis entre modalidades e jurisdições. A capacidade de revisar 100% do conteúdo com alta precisão ajuda as plataformas a proteger usuários, reduzir fraudes e mitigar riscos regulatórios, como requisitos de divulgação regionais. A automação também reduz a exposição de moderadores a conteúdo ofensivo, liberando equipes humanas para interpretar políticas e gerenciar exceções complexas. A capacidade de correspondência de modelos permite que as plataformas evoluam regras sem reestruturar pipelines com gatilhos limítrofes. Em vez de depender apenas de palavras-chave, riscos são tratados por fluxos de trabalho dedicados para categorias como golpes ou produtos ilegais, oferecendo cobertura mais ampla e uma trilha mais clara de conformidade à medida que as regras mudam. O SafetyKit também facilita a escalabilidade. Encaminhando conteúdo ao agente e ao modelo mais adequado, plataformas podem ampliar cobertura a novos domínios, novos tipos de conteúdo e grandes populações de usuários sem perder precisão. A colaboração contínua com a OpenAI — incluindo o compartilhamento de avaliações, dados de casos de borda e insights de políticas — ajuda a moldar melhorias em modelos voltados a workloads críticos de segurança.

Detalhes técnicos ou Implementação

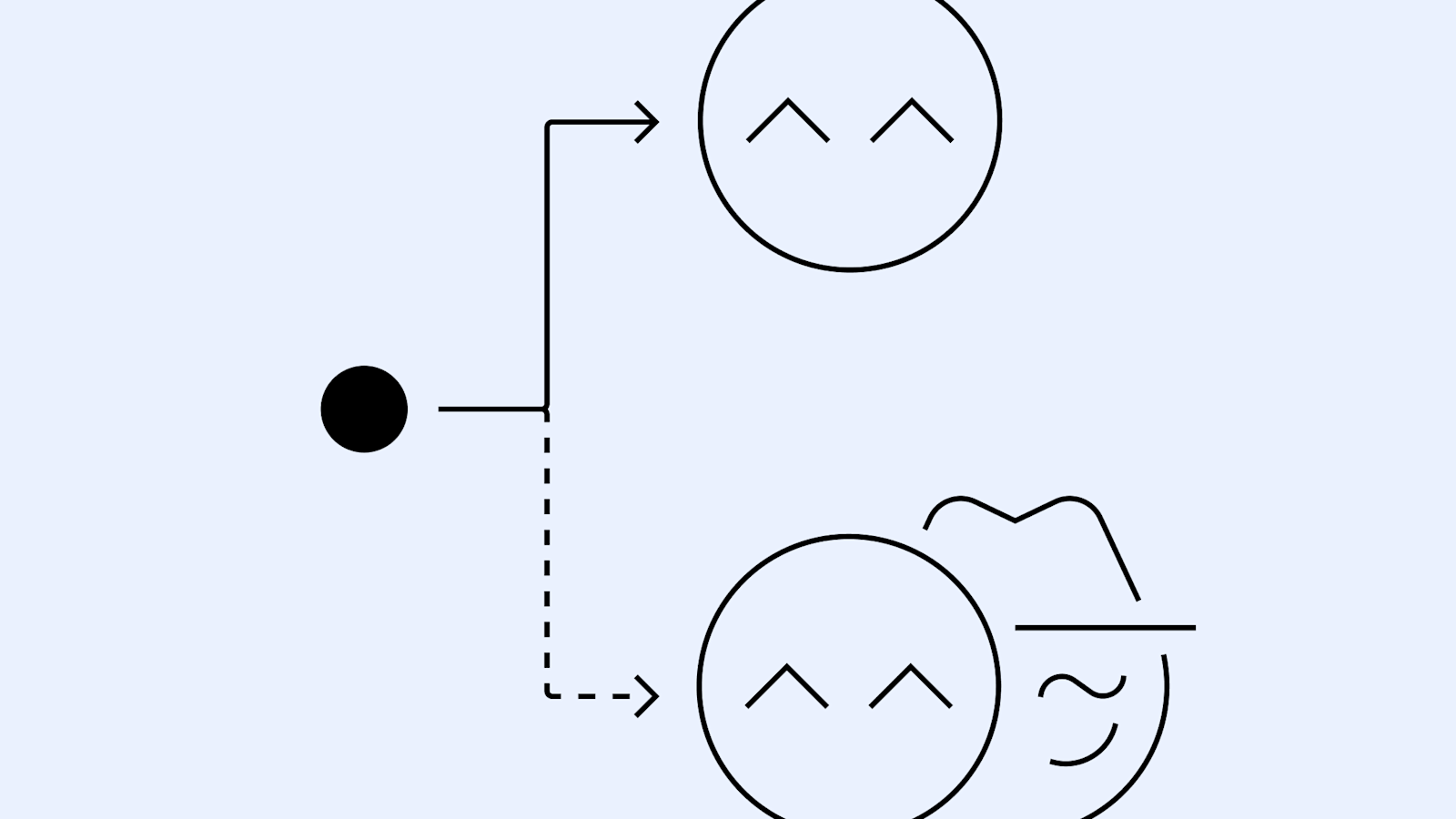

- A arquitetura é composta por agentes especializados, cada um lidando com uma categoria de risco (por exemplo, golpes, produtos ilegais) e coordenados por uma camada de correspondência de modelo que escolhe o melhor agente e modelo OpenAI para cada violação.

- O agente de Detecção de Golpes amplia a análise para além de texto, examinando elementos visuais em imagens de produtos, como QR codes ou números de telefone. O GPT‑4.1 auxilia no processamento de imagens e na compreensão do layout para decidir se há violação de política.

- O agente de Divulgação de Política depende da biblioteca interna de políticas para obter diretrizes, com o GPT‑5 avaliando a conformidade e sinalizando quando divulgações ou linguagem obrigatórias não estão presentes.

- As decisões de políticas são alicerçadas em regras reais, permitindo aplicação precisa mesmo em nuances regionais. Isso ajuda a evitar falhas ou falsos positivos que abordagens baseadas apenas em palavras-chave poderiam gerar.

- O SafetyKit faz benchmarks de novos modelos da OpenAI em relação aos casos mais difíceis da suíte de avaliação e costuma implantar os melhores desempenhos rapidamente, às vezes no mesmo dia em produção.

- A arquitetura é escalável para bilhões de tokens diários — o SafetyKit agora analisa mais de 16 bilhões de tokens por dia, sem sacrificar a precisão.

- O ciclo SafetyKit também fornece um caminho contínuo de melhoria: conforme a OpenAI lança novas capacidades, o SafetyKit as integra para ampliar cobertura, precisão e velocidade em workloads críticos de segurança.

Principais conclusões

- SafetyKit combina agentes multimodais com GPT‑5 e GPT‑4.1 para impor políticas em texto, imagens e transações.

- Ele revisa 100% do conteúdo com mais de 95% de precisão e expandiu-se para risco de pagamentos, fraude, AML e exploração infantil.

- Um fluxo de correspondência de modelos encaminha cada violação ao melhor agente e modelo para aplicação mais nuançada.

- A plataforma processa bilhões de tokens diários, permitindo cobertura ampla sem sacrificar precisão.

- O sistema mantém um ciclo de feedback com a OpenAI para moldar o desempenho de modelos futuros em workloads de segurança.

FAQ

-

O que é SafetyKit?

Um conjunto de agentes de IA multimodais criados para detectar e agir diante de fraudes e atividades proibidas em texto, imagens, transações e listagens.

-

uais modelos são usados?

SafetyKit utiliza GPT‑5 e GPT‑4.1, com componentes de Computer Using Agent (CUA).

-

uantos tokens ele processa diariamente?

Mais de 16 bilhões de tokens por dia.

-

ual é o nível de precisão da revisão?

Revisa 100% do conteúdo com mais de 95% de precisão, segundo avaliações internas.

-

Como ele lida com regulações?

Usa uma biblioteca interna de políticas e avaliação do GPT‑5 para conformidade com requisitos regionais e divulgações obrigatórias.

Referências

More news

Deteção e redução de scheming em modelos de IA: avanços, métodos e implicações

OpenAI e Apollo Research avaliaram desalineação oculta em modelos de fronteira, observaram comportamentos de scheming e testaram um método de alinhamento deliberativo que reduziu ações encobertas em cerca de 30x, com limitações e trabalhos em andamento.

Teen safety, freedom, and privacy

Explore OpenAI’s approach to balancing teen safety, freedom, and privacy in AI use.

Rumo à Predição de Idade: OpenAI Adapta o ChatGPT para Adolescentes e Famílias

OpenAI descreve um sistema de longo prazo de predição de idade para adaptar o ChatGPT a usuários com menos de 18 anos e adultos, com políticas apropriadas por faixa etária, salvaguardas de segurança e controles parentais.

OpenAI, NVIDIA e Nscale apresentam Stargate UK para Infraestrutura de IA Soberana no Reino Unido

OpenAI, NVIDIA e Nscale anunciam Stargate UK, uma parceria de infraestrutura de IA soberana que oferece poder de computação local no Reino Unido para apoiar serviços públicos, setores regulados e metas nacionais de IA.

OpenAI apresenta GPT-5-Codex: assistente de codificação mais rápido, confiável e com revisões de código avançadas

A OpenAI apresenta o GPT‑5‑Codex, uma versão do GPT‑5 otimizada para codificação guiada por agentes no Codex. Acelera trabalhos interativos, gerencia tarefas longas, aprimora revisões de código e funciona no terminal, IDE, web, GitHub e mobile.

Adendo ao GPT-5-Codex: GPT-5 Otimizado para Codificação com Medidas de Segurança

Um adendo detalhando o GPT-5-Codex, uma variante do GPT-5 otimizada para codificação em Codex, com mitigação de segurança e disponibilidade multiplataforma.