Modelos Falcon-H1 da TII disponíveis no Amazon Bedrock Marketplace e no SageMaker JumpStart

Sources: https://aws.amazon.com/blogs/machine-learning/tii-falcon-h1-models-now-available-on-amazon-bedrock-marketplace-and-amazon-sagemaker-jumpstart, https://aws.amazon.com/blogs/machine-learning/tii-falcon-h1-models-now-available-on-amazon-bedrock-marketplace-and-amazon-sagemaker-jumpstart/, AWS ML Blog

TL;DR

- Os modelos Falcon-H1 da Technology Innovation Institute (TII) estão disponíveis no Amazon Bedrock Marketplace e no Amazon SageMaker JumpStart. Seis modelos com instruções são oferecidos: 0,5B, 1,5B, 1,5B-Deep, 3B, 7B e 34B.

- Falcon-H1 usa um design híbrido paralelo que combina Modelos de Espaço de Estado (SSM) como o Mamba com a atenção dos Transformers para oferecer inferência mais rápida e menor uso de memória, mantendo boa compreensão de contexto.

- A família Falcon-H1 oferece suporte multilíngue nativo em 18 idiomas e suporta até 256K de contexto, disponível sob a licença Falcon LLM.

- As opções de implantação incluem Bedrock Marketplace e SageMaker JumpStart, com etapas guiadas, playgrounds de teste e integração com APIs Bedrock e ferramentas SageMaker para implantação segura e ajuste fino.

Contexto e antecedentes

A família Falcon-H1 tem origem na Technology Innovation Institute (TII), instituição de pesquisa líder baseada em Abu Dhabi e parte do UAE Advanced Technology Research Council (ATRC). A TII foca em IA, computação quântica, robótica autônoma, criptografia e mais. A AWS e a TII trabalham juntas para ampliar o acesso a modelos de IA de origem dos Emirados Árabes Unidos em todo o mundo, permitindo que profissionais construam e escalem aplicações de IA generativa com os modelos Falcon-H1. A arquitetura Falcon-H1 implementa um design híbrido paralelo que combina a inferência rápida e o baixo uso de memória dos SSMs com a capacidade de atenção dos Transformers. O design aproveita conceitos de Mamba e da arquitetura Transformer para oferecer eficiência e generalização. A família Falcon-H1 varia de 0,5 a 34 bilhões de parâmetros e oferece suporte nativo para 18 idiomas. Segundo a TII, modelos menores demonstram eficiência significativa ao alcançar paridade de desempenho com modelos maiores em várias situações. A TII lança os modelos Falcon-H1 sob a licença Falcon LLM para promover acessibilidade e colaboração na IA, além de apoiar governança e políticas de segurança. A disponibilidade no Bedrock Marketplace e no SageMaker JumpStart permite que desenvolvedores comparem modelos proprietários e públicos em um único ambiente e implantem com infraestrutura da AWS que prioriza segurança, escalabilidade e custo-eficiência. O material da postagem também descreve como testar o Falcon-H1-0,5B-Instruct no Bedrock Playground e invocar o modelo por meio da Bedrock Converse API, substituindo os placeholders pelo ARN do endpoint que começa com arn:aws:sagemaker. Do ponto de vista da plataforma, o Bedrock Marketplace oferece acesso a centenas de modelos por meio de APIs unificadas, com opções de tipo de instância e configurações de segurança, como VPC e chaves de criptografia. O JumpStart oferece fluxos de trabalho prontos para uso por meio do SageMaker Studio, SDK e Console, facilitando a integração com pipelines de ML existentes. O objetivo é facilitar a transição do descobrimento para a produção com maior velocidade, mantendo controles de governança e custos. Para organizações que avaliam qual opção entre Bedrock Marketplace ou SageMaker JumpStart atende melhor a seus requisitos, o post original oferece orientações sobre como escolher entre Bedrock e SageMaker AI com base em casos de uso, cargas de trabalho e contexto de segurança. A parceria entre TII e AWS busca ampliar o acesso a capacidades de IA de origem dos Emirados Árabes Unidos, mantendo governança e segurança. Mais detalhes estão disponíveis nas referências da postagem. A família Falcon-H1 enfatiza suporte multilíngue em 18 idiomas e escala de 0,5 a 34 bilhões de parâmetros, com até 256K de contexto. Essa combinação visa oferecer modelos de IA generativa eficientes e capazes para uma variedade de aplicações, operando dentro da infraestrutura de nuvem da AWS com Bedrock e JumpStart. Você pode explorar esses modelos em regiões onde Bedrock e JumpStart estejam disponíveis, de acordo com a disponibilidade regional e requisitos de conformidade. Para mais contexto sobre os objetivos mais amplos desta colaboração, consulte o AWS Machine Learning Blog e recursos relacionados mencionados na seção de Referências.

What’s new

- Seis modelos Falcon-H1 com instruções estão disponíveis no Bedrock Marketplace e no SageMaker JumpStart: 0,5B, 1,5B, 1,5B-Deep, 3B, 7B e 34B.

- A arquitetura Falcon-H1 utiliza um design híbrido paralelo que mescla SSMs com atenção de Transformer para otimizar velocidade de inferência e uso de memória.

- Suporte multilíngue nativo em 18 idiomas, com contexto de até 256K, entre os tamanhos de modelo.

- Os modelos são lançados sob a licença Falcon LLM e acessíveis por meio de Bedrock Marketplace APIs ou fluxos de implantação do JumpStart, facilitando descoberta, teste e uso em produção.

- Orientações práticas de implantação são fornecidas para Bedrock Marketplace e JumpStart, incluindo um Bedrock playground para testes e exemplos usando a Bedrock Converse API, bem como um fluxo de trabalho do SageMaker Python SDK para implantações no JumpStart.

- Pre-requisitos para implantação no Bedrock incluem possuir uma conta AWS com cota suficiente para endpoints ml.g6.xlarge; aumentos de cota podem ser solicitados via AWS Service Quotas.

- O post demonstra um fluxo de implantação end-to-end para o Falcon-H1-0,5B-Instruct como exemplo, com passos aplicáveis a outros modelos Falcon-H1 da família, conforme a disponibilidade de cotas e recursos.

Tabela de visão geral do modelo

| Modelo | Parâmetros | Contexto | Idiomas | Arquitetura |---|---|---|---|---| | 0,5B | 0,5B | 256K | 18 | Híbrido SSM (Mamba) + Atenção Transformer |1,5B | 1,5B | 256K | 18 | Híbrido SSM + Atenção Transformer |1,5B-Deep | 1,5B | 256K | 18 | Híbrido SSM + Atenção Transformer |3B | 3B | 256K | 18 | Híbrido SSM + Atenção Transformer |7B | 7B | 256K | 18 | Híbrido SSM + Atenção Transformer |34B | 34B | 256K | 18 | Híbrido SSM + Atenção Transformer |

Por que isso é importante (impacto para desenvolvedores/empresas)

- Acessibilidade e escalabilidade: Bedrock Marketplace e JumpStart oferecem caminhos unificados para descobrir, comparar e implantar grandes modelos de linguagem, facilitando a avaliação do Falcon-H1 frente a outros modelos disponíveis e escolhendo a melhor opção para cada workload.

- Alcance global com IA de origem dos Emirados: a colaboração traz capacidades de IA desenvolvidas no UAE para audiência mundial, alinhando-se a metas regionais de inovação e à UAE National AI Strategy 2031, ao oferecer acesso global aos Falcon-H1.

- Eficiência e custo-efetividade: o design híbrido reduz consumo de memória e melhora a eficiência de inferência, especialmente para modelos menores, sem comprometer desempenho. Isso viabiliza implantação em larga escala com custos mais controlados.

- Segurança e governança: implantações no Bedrock e JumpStart podem ser configuradas em VPC, com opções de chaves de criptografia e etiquetagem de recursos para aderência a políticas de segurança.

- Capacidades multilíngues: com suporte a 18 idiomas, os modelos Falcon-H1 são adequados para aplicações multilíngues e atendimento a clientes globais.

Detalhes técnicos ou Implementação

A família Falcon-H1 vai de 0,5B a 34B parâmetros e é construída sobre um design híbrido paralelo que mescla SSMs com a atenção do Transformer. Os SSMs, como o Mamba, promovem inferência mais rápida e menor uso de memória, enquanto a atenção do Transformer sustenta compreensão de contexto e generalização. A combinação oferece vantagens de eficiência em todos os tamanhos de modelo, mantendo capacidades modernas de LLM. O contexto de até 256K é suportado em todos os tamanhos, com suporte a 18 idiomas. As vias de implantação são duas: Bedrock Marketplace e SageMaker JumpStart. Bedrock oferece catálogo central de modelos com APIs unificadas, opções de tipo de instância e configurações de segurança, incluindo VPC e criptografia. JumpStart facilita fluxos de trabalho prontos para uso via Studio, SDK do SageMaker e Console, facilitando a integração com pipelines existentes. O post apresenta um fluxo end-to-end para o Falcon-H1-0,5B-Instruct, com passos aplicáveis a modelos maiores conforme disponibilidade de cotas e recursos. Pré-requisitos e considerações operacionais:

- A implantação no Bedrock requer uma conta AWS com cota suficiente para endpoints ml.g6.xlarge; cotas padrão frequentemente são 0, então é necessário solicitar aumento de cota via AWS Service Quotas.

- Após experimentar modelos Falcon-H1, é importante excluir endpoints e recursos associados para evitar encargos contínuos, seguindo as diretrizes oficiais do SageMaker para gerenciamento de recursos.

- Embora o artigo use Falcon-H1-0,5B-Instruct como exemplo, os mesmos passos de implantação se aplicam aos demais modelos Falcon-H1 da família, sujeitando-se às cotas e disponibilidade de recursos.

Principais conclusões

- Falcon-H1 amplia a disponibilidade de modelos LLM de origem UAE via Bedrock e JumpStart, expandindo o conjunto de opções para desenvolvimento de IA.

- O design híbrido SSM/Transformer oferece eficiência com desempenho sólido, com suporte multilíngue em 18 idiomas e até 256K de contexto.

- Implantações podem ser feitas pelo Bedrock Playground ou pelo JumpStart, com opções de Studio e SDK para integração com pipelines existentes.

- A licença Falcon LLM reforça uma abordagem colaborativa e acessível à IA com controles de governança e segurança.

- Fatores de pré-requisito e custos devem ser considerados: planeje solicitações de cotas e práticas de limpeza de recursos para evitar cobranças desnecessárias.

FAQ

-

Quais modelos Falcon-H1 estão disponíveis no Bedrock Marketplace e JumpStart?

Seis modelos: 0,5B, 1,5B, 1,5B-Deep, 3B, 7B e 34B.

-

Como implantar Falcon-H1 no Bedrock versus JumpStart?

O Bedrock oferece descoberta de modelos, APIs unificadas e opções de configuração de implantação, além de um Bedrock Playground para testes; o JumpStart fornece Studio, o SDK do SageMaker e o Console com fluxos de trabalho de implantação para produção e integração com pipelines de ML.

-

uais são os pré-requisitos para implantação no Bedrock?

Conta AWS com cota suficiente para endpoints ml.g6.xlarge; se a cota for insuficiente, é necessário solicitar aumento via AWS Service Quotas.

-

ue capabilities os Falcon-H1 oferecem?

Suporte multilíngue em 18 idiomas, até 256K de contexto, e variação de modelos de 0,5B a 34B parâmetros, com arquitetura híbrida SSM/Transformer e licença Falcon LLM.

-

Como gerenciar recursos para evitar cobranças contínuas?

Exclua endpoints e recursos associados após a experimentação, seguindo as orientações do SageMaker para otimizar custos.

References

More news

NVIDIA HGX B200 reduz a Intensidade de Emissões de Carbono Incorporado

O HGX B200 da NVIDIA reduz 24% da intensidade de carbono incorporado em relação ao HGX H100, ao mesmo tempo em que aumenta o desempenho de IA e a eficiência energética. Esta análise resume os dados de PCF e as novidades de hardware.

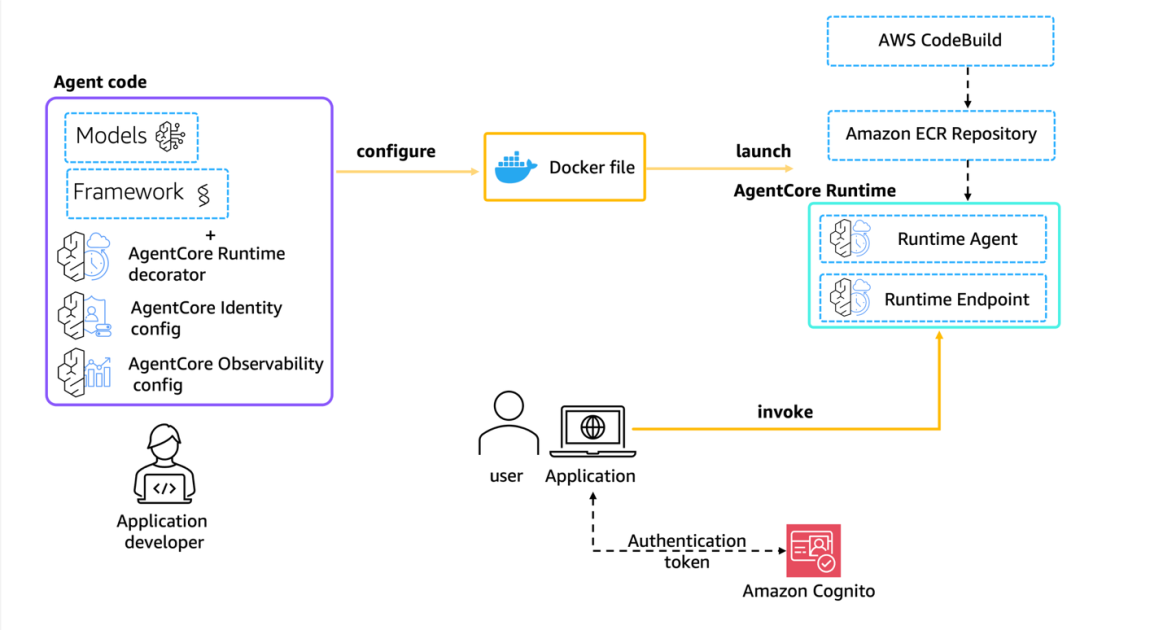

Levar agentes de IA do conceito à produção com Amazon Bedrock AgentCore

Análise detalhada de como o Amazon Bedrock AgentCore ajuda a transformar aplicações de IA baseadas em agentes de conceito em sistemas de produção de nível empresarial, mantendo memória, segurança, observabilidade e gerenciamento de ferramentas escalável.

Como reduzir gargalos do KV Cache com NVIDIA Dynamo

O Dynamo da NVIDIA transfere o KV Cache da memória da GPU para armazenamento de custo mais baixo, permitindo janelas de contexto maiores, maior concorrência e menor custo de inferência em grandes modelos.

Monitorar Bedrock batch inference da Amazon usando métricas do CloudWatch

Saiba como monitorar e otimizar trabalhos de bedrock batch inference com métricas do CloudWatch, alarmes e painéis para melhorar desempenho, custo e governança.

Prompting para precisão com Stability AI Image Services no Amazon Bedrock

O Bedrock now oferece Stability AI Image Services com nove ferramentas para criar e editar imagens com maior precisão. Veja técnicas de prompting para uso empresarial.

Aumente a produção visual com Stability AI Image Services no Amazon Bedrock

Stability AI Image Services já estão disponíveis no Amazon Bedrock, oferecendo capacidades de edição de mídia prontas para uso via Bedrock API, ampliando os modelos Stable Diffusion 3.5 e Stable Image Core/Ultra já existentes no Bedrock.