Envoyer des agents plus intelligents à chaque nouveau modèle : SafetyKit et GPT‑5 pour une modération plus sûre et plus intelligente

Sources: https://openai.com/index/safetykit, OpenAI

TL;DR

- SafetyKit utilise des agents IA multimodaux alimentés par GPT‑5 et GPT‑4.1 pour détecter et agir sur les fraudes et les activités interdites à travers le texte, les images et les transactions financières. OpenAI SafetyKit

- Il passe en revue 100% du contenu client avec plus de 95% de précision selon les évaluations de SafetyKit.

- La plateforme couvre désormais le risque des paiements, la fraude, l’exploitation d’enfants et la lutte contre le blanchiment d’argent, atteignant des centaines de millions d’utilisateurs finaux.

- Une approche de correspondance de modèles oriente chaque élément vers le meilleur agent et le modèle OpenAI optimal pour chaque violation, offrant une application plus nuancée entre les modalités.

- Depuis ses débuts, SafetyKit traite plus de 16 milliards de tokens par jour, contre 200 millions il y a six mois, permettant une couverture du risque plus rapide et plus étendue.

Contexte et enjeux

OpenAI SafetyKit construit des agents IA multimodaux pour aider les places de marché, les plateformes de paiement et les fintechs à détecter et agir face aux fraudes et activités interdites dans le texte, les images, les transactions et les listes de produits. Les avancées récentes en raisonnement des modèles et en compréhension multimodale renforcent l’efficacité, établissant une nouvelle référence pour les opérations de risque, de conformité et de sécurité. Les agents de SafetyKit s’appuient sur GPT‑5, GPT‑4.1, la recherche approfondie et Computer Using Agent (CUA) pour examiner 100% du contenu client avec une précision supérieure à 95% selon les évaluations de SafetyKit. Ils aident les plateformes à protéger les utilisateurs, prévenir les fraudes, éviter les amendes réglementaires et appliquer des politiques complexes que les systèmes hérités pourraient manquer, notamment les règles régionales, les numéros de téléphone intégrés dans les images d’arnaques ou le contenu explicite. L’automatisation peut aussi protéger les modérateurs humains de l’exposition à du contenu offensant et leur permettre de se concentrer sur des décisions politiques nuancées. Les agents SafetyKit sont chacun conçus pour gérer une catégorie de risque spécifique, des arnaques aux produits illégaux. Chaque contenu est acheminé vers l’agent le mieux adapté à la violation, en utilisant le modèle OpenAI optimal : cette approche de correspondance de modèle permet à SafetyKit d’étendre l’examen du contenu à travers les modalités avec plus de nuance et de précision que les solutions héritées. Par exemple, l’agent Détection d’Arnaques analyse non seulement le texte mais aussi les visuels comme les codes QR ou les numéros de téléphone intégrés dans les images de produit. GPT‑4.1 l’aide à analyser l’image, comprendre la mise en page et déterminer s’il existe une violation de politique. L’agent Disclosure des Politiques vérifie les listes ou pages d’atterrissage pour des informations obligatoires telles que les avertissements légaux ou les exigences de conformité régionales. GPT‑4.1 extrait les sections pertinentes, et GPT‑5 évalue la conformité, l’agent signalant les violations. « Nous voyons nos agents comme des flux de travail dédiés », déclare Graunke. « Certaines tâches nécessitent un raisonnement profond, d’autres un contexte multimodal. OpenAI est le seul stack qui offre des performances fiables dans les deux domaines. » Les décisions politiques dépendent souvent de distinctions subtiles. Prenons un marketplace qui exige qu’un vendeur inclue un avertissement pour les produits de bien-être, les exigences variant selon les affirmations du produit et les règles régionales. Les fournisseurs historiques utilisent des déclencheurs par mots-clés ou des règles rigides qui peuvent manquer les appels de jugement plus profonds. L’agent Disclosure des Politiques de SafetyKit se réfère d’abord à la bibliothèque interne de politiques, puis GPT‑5 évalue le contenu : mentionne-t-il le traitement ou la prévention ? Le produit est-il vendu dans une région où l’avis est obligatoire ? Si oui, le libellé requis est-il bien inclus dans l’annonce ? En cas de carence, GPT‑5 retourne une sortie structurée utilisée par l’agent pour signaler le problème. « Le pouvoir de GPT‑5 réside dans sa capacité de raisonnement précis lorsqu’il est ancré dans une politique réelle », note Graunke. « Cela nous permet de prendre des décisions précises et défendables même dans les cas limites où d’autres systèmes échouent. » SafetyKit évalue chaque nouveau modèle OpenAI contre ses cas les plus difficiles, en déployant souvent les meilleurs performeurs le même jour. Des évaluations internes rigoureuses permettent à l’équipe d’identifier rapidement comment les nouveaux modèles peuvent améliorer les performances et s’intégrer sans couture à leur infrastructure principale. Lorsque OpenAI o3 a été lancé, SafetyKit l’a utilisé pour améliorer les performances sur les cas limites clés. GPT‑5 a suivi, et en quelques jours, il a été déployé dans leurs agents les plus exigeants, améliorant les scores de référence de plus de 10 points sur leurs tâches de vision les plus difficiles. « OpenAI bouge vite, et nous avons conçu notre système pour suivre. Chaque nouvelle version nous donne un avantage opérationnel — ouvrant de nouvelles capacités et domaines que nous ne pouvions pas supporter auparavant, tout en augmentant la couverture et la précision offertes aux clients », déclare Graunke. SafetyKit alimente également les améliorations de l’écosystème en partageant les résultats d’évaluation, les échecs dans les cas limites et les insights politiques directement avec OpenAI pour aider à façonner les performances des modèles futurs pour les workloads critiques de sécurité. L’architecture SafetyKit applique les politiques à grande échelle, offrant rapidité, précision et couverture du risque. Dans les coulisses, SafetyKit gère désormais plus de 16 milliards de tokens par jour, soit une croissance par rapport à 200 millions six mois plus tôt, analysant davantage de contenu sans sacrifier la précision. Pendant cette même période, SafetyKit s’est étendu à des domaines tels que le risque de paiements, la fraude, la lutte contre l’exploitation sexuelle des enfants, la lutte contre le blanchiment d’argent et de nouveaux clients avec des centaines de millions d’utilisateurs finaux protégés par SafetyKit. Cette base permet aux clients de répondre rapidement et en toute confiance aux risques émergents. « Nous avons créé une boucle où chaque version d’OpenAI renforce directement nos capacités », affirme Graunke. « C’est pourquoi le système s’améliore continuellement, restant toujours en avance sur les risques évolutifs. »

Ce qui est nouveau

- De la prototypation avec des préversions visionnelles à l’échelle avec GPT‑5, les agents multimodaux SafetyKit s’étendent à de nouveaux domaines et améliorent la précision. SafetyKit passe en revue le contenu à travers le texte, les images et les données financières pour détecter et agir contre les activités prohibées.

- La plateforme couvre désormais les risques liés aux paiements, à la fraude, à l’exploitation d’enfants et au blanchiment d’argent, atteignant des centaines de millions d’utilisateurs finaux.

- Une approche de correspondance de modèles oriente chaque élément vers le bon agent et le modèle le plus adapté, permettant une application plus précise entre les modalités. Par exemple, l’agent Détection des Arnaques analyse les éléments visuels tels que les codes QR ou les numéros de téléphone intégrés dans les images, avec l’aide de GPT‑4.1 pour l’interprétation du layout.

- Les décisions politiques s’ancrent dans la bibliothèque interne de politiques, GPT‑5 évaluant la conformité et signalant lorsque le langage ou les divulgués obligatoires manquent.

- Les évaluations internes rapides favorisent l’adoption des meilleurs performeurs dès les sorties OpenAI, les améliorations étant disponibles le jour même.

- L’architecture continue de se scaler pour traiter des milliards de tokens par jour sans sacrifier la précision, tout en alimentant des améliorations pour aider OpenAI à façonner les performances des modèles pour les workloads critiques de sécurité.

Pourquoi c’est important (impact pour les développeurs/entreprises)

Pour les développeurs et les entreprises qui construisent des places de marché numériques, des plateformes de paiement ou des services fintech, SafetyKit offre une approche évolutive pour l’application des politiques et la gestion du risque. En combinant GPT‑5, GPT‑4.1 et des CUAs, SafetyKit offre des décisions précises et défendables entre les modalités et les juridictions. La capacité de passer en revue 100% du contenu avec une grande précision aide les plateformes à protéger les utilisateurs, réduire les fraudes et atténuer les risques réglementaires tels que les exigences de divulgation régionales. L’automatisation réduit aussi l’exposition des modérateurs humains à du contenu offensant et les libère pour interpréter les politiques et gérer les exceptions complexes. La correspondance des modèles permet aux plateformes de faire évoluer les règles sans reconstruire les pipelines autour de déclencheurs keyword ou de règles statiques. Au lieu de cela, les risques sont traités par des flux de travail dédiés pour des catégories telles que les arnaques ou les produits illégaux, offrant une couverture plus large et une piste de conformité plus claire à mesure que les règles évoluent. SafetyKit favorise également l’évolutivité : en acheminant le contenu vers l’agent et le modèle les plus adaptés, les plateformes peuvent étendre la couverture à de nouveaux domaines, types de contenus et grandes populations d’utilisateurs, sans perdre en précision. La collaboration continue avec OpenAI — le partage d’évaluations, de données de cas limites et d’insights politiques — aide à façonner les améliorations des modèles utilisés pour les workloads sensibles à la sécurité.

Détails techniques ou Mise en œuvre

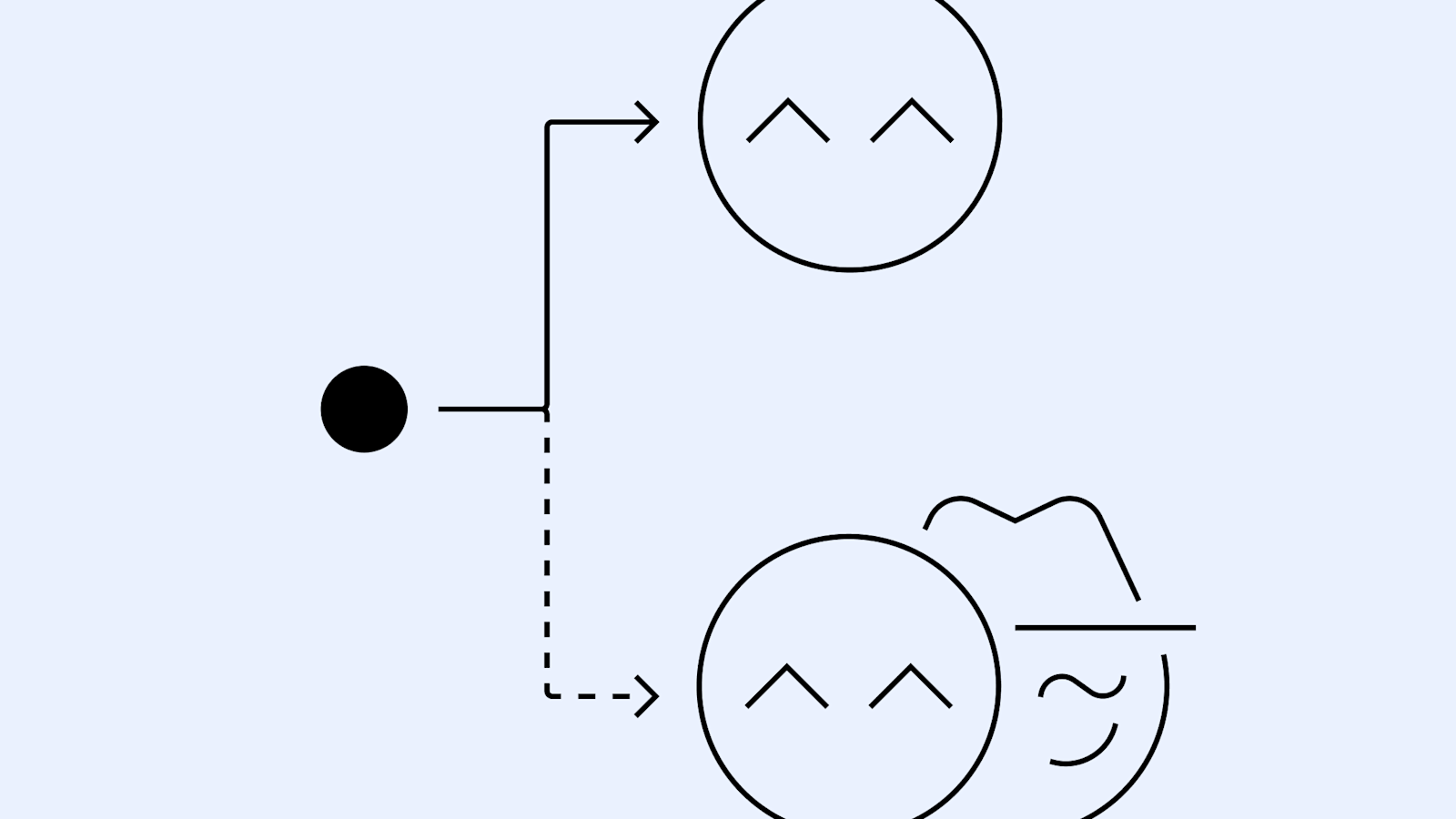

- L’architecture comprend des agents spécialisés, chacun gérant une catégorie de risque (par exemple, arnaques, produits illégaux) et coordonnés par une couche de correspondance de modèle qui choisit le meilleur agent et le meilleur modèle OpenAI pour chaque violation.

- L’agent Détection d’Arnaques étend l’analyse au-delà du texte en examinant les éléments visuels présents dans les images, tels que les codes QR ou les numéros de téléphone. GPT‑4.1 aide au traitement des images et à la compréhension de la mise en page pour déterminer s’il existe une violation.

- L’agent Disclosure des Politiques s’appuie d’abord sur la bibliothèque interne de politiques, puis GPT‑5 évalue la conformité et signale les cas où le libellé requis ou les avertissements régionaux ne sont pas présents.

- Les décisions politiques s’ancrent dans des règles réelles, ce qui permet une application précise même lorsque des nuances régionales entrent en jeu. Cela aide à éviter des fautes ou des faux positifs que des approches basées sur des mots-clés pourraient générer.

- SafetyKit effectue des benchmarks des nouveaux modèles OpenAI face aux cas les plus difficiles et déploie généralement les meilleurs performeurs en production, parfois le même jour.

- L’architecture est scalable pour des milliards de tokens quotidiens — SafetyKit analyse désormais plus de 16 milliards de tokens par jour sans compromettre la précision.

- Le cycle SafetyKit offre aussi une voie d’amélioration continue : à chaque nouvelle capacité d’OpenAI, SafetyKit l’intègre pour étendre la couverture, la précision et la vitesse dans les workloads sensibles à la sécurité.

Points clés

- SafetyKit combine agents multimodaux avec GPT‑5 et GPT‑4.1 pour faire respecter les politiques à travers le texte, les images et les transactions.

- Il passe en revue 100% du contenu avec une précision >95% et s’étend au risque de paiements, à la fraude, à l’AML et à l’exploitation des enfants.

- Une approche de correspondance de modèles envoie chaque violation vers le meilleur agent et le modèle pour une application plus nuancée.

- La plateforme traite des milliards de tokens par jour, assurant une couverture large sans perte de précision.

- Le système maintient une boucle de rétroaction avec OpenAI pour guider les performances futures des modèles dans des workloads de sécurité.

FAQ

-

Qu’est-ce que SafetyKit ?

Un ensemble d’agents IA multimodaux conçus pour détecter et agir face à la fraude et aux activités interdites dans le texte, les images, les transactions et les listes.

-

uels modèles sont utilisés ?

GPT‑5 et GPT‑4.1, complétés par des composants Computer Using Agent (CUA).

-

Combien de tokens traitent-ils par jour ?

Plus de 16 milliards de tokens par jour.

-

uel est le niveau de précision de la revue ?

100% du contenu analysé avec plus de 95% de précision selon les évaluations internes.

-

Comment répond-il aux réglementations régionales ?

Par une bibliothèque interne de politiques et une évaluation de conformité via GPT‑5.

Références

More news

Détection et réduction de scheming dans les modèles d IA : progrès, méthodes et implications

OpenAI et Apollo Research ont évalué le désalignement caché dans des modèles de frontière, observé des comportements de scheming et testé une méthode d’alignement délibératif qui a réduit les actions covertes d’environ 30x, tout en reconnaissant des limites et des travaux en cours.

Vers une Prédiction d’Âge : OpenAI Adapte ChatGPT aux Adolescents et aux Familles

OpenAI décrit un système de prédiction d’âge à long terme pour adapter ChatGPT aux utilisateurs de moins de 18 ans et de 18 ans et plus, avec des politiques adaptées, des mesures de sécurité et des contrôles parentaux à venir.

Teen safety, freedom, and privacy

Explore OpenAI’s approach to balancing teen safety, freedom, and privacy in AI use.

OpenAI, NVIDIA et Nscale lancent Stargate UK pour une IA souveraine au Royaume-Uni

OpenAI, NVIDIA et Nscale annoncent Stargate UK, une infrastructure d’IA souveraine offrant un pouvoir de calcul local au Royaume-Uni pour soutenir les services publics, les secteurs réglementés et les objectifs nationaux d’IA.

OpenAI présente GPT‑5‑Codex : code plus rapide, plus fiable et revues de code avancées

OpenAI dévoile GPT‑5‑Codex, une version de GPT‑5 optimisée pour le codage orienté agent dans Codex. Accélère les sessions interactives, gère des tâches longues, améliore les revues de code et fonctionne sur terminal, IDE, web, GitHub et mobile.

Addenda GPT-5-Codex : GPT-5 optimisé pour le codage agent et mesures de sécurité

Un addenda détaillant GPT-5-Codex, une variante de GPT-5 optimisée pour le codage dans Codex, avec des mesures de sécurité et une disponibilité multiplateforme.