Connecter des centres de données distribués en grandes usines d’IA grâce au Scale-Across Networking

Sources: https://developer.nvidia.com/blog/how-to-connect-distributed-data-centers-into-large-ai-factories-with-scale-across-networking, https://developer.nvidia.com/blog/how-to-connect-distributed-data-centers-into-large-ai-factories-with-scale-across-networking/, NVIDIA Dev Blog

TL;DR

- Spectrum-XGS Ethernet permet le scale-across networking pour relier des centres de données distribués en une seule usine d’IA sur de longues distances (plus de 500 mètres).

- Il s’appuie sur la plate-forme matérielle NVIDIA Spectrum-X Ethernet (commutateurs Spectrum-X et SuperNICs ConnectX-8) avec un contrôle de congestion basé sur la télémétrie et un routage adaptatif sensible à la distance pour minimiser la latence.

- Dans des tests NCCL à 10 km, Spectrum-XGS offre jusqu’à 1,9x plus de bande passante all-reduce que l’Ethernet grand public, notamment pour les messages volumineux.

- La technologie unifie les centres de données, quelle que soit leur proximité, renforçant la fungibilité de l’infrastructure IA et permettant des formations à grande échelle et une inférence distribuée.

- Elle aborde les problèmes de latence et de jitter liés à l’Ethernet de grand trajet avec des buffers profonds, offrant des performances prévisibles pour les charges de travail synchrones d’IA. NVIDIA

Contexte et arrière-plan

L’évolutivité de l’IA est extrêmement complexe, et de nouvelles techniques dans l’entraînement et l’inférence exigent toujours plus des data centers. Bien que les capacités des data centers évoluent rapidement, l’infrastructure physique impose des limites qui n’affectent pas les algorithmes et les modèles. L’approvisionnement en énergie, la capacité de refroidissement et l’espace disponible restreignent l’emprise physique d’une usine IA. Pour continuer à croître, de nouveaux data centers sont construits et la connectivité à distance devient un facteur pour fédérer les ressources afin d’exécuter des charges d’entraînement distribuées ou d’inférence désagrégée. NVIDIA Traditionnellement, lors de la connexion de data centers par Ethernet longue distance utilisant du silicium grand public, l’objectif principal était de garantir que les données arrivent à destination. Comme les distances peuvent être longues et les latences élevées, la congestion devient un facteur majeur et l’impact peut être extrême. Pour atténuer ce problème et éviter la perte de paquets, les fournisseurs d’Ethernet grand public déploient des buffers profonds pour absorber de fortes pointes de trafic. Bien que ces buffers soient une solution pour les opérateurs longue distance et les télécoms, ils introduisent des latences plus élevées et, lorsque le tampon se remplit, il doit se vider. Pour les charges d’IA, cet événement peut être imprévisible, provoquant une jitter importante dans la livraison des données. Des latences élevées et une imprévisibilité de cette technique de choc deviennent problématiques pour l’entraînement et l’inférence distribuée, qui sont des flux synchrones et nécessitent des performances réseau prévisibles. Ce post explique comment NVIDIA Spectrum-XGS Ethernet pour scale-across networking permet une connectivité entre data centers avec les performances requises pour l’IA. NVIDIA Scale-across networking est une nouvelle catégorie de connectivité de calcul IA qui peut être vue comme une nouvelle dimension, orthogonale aux options de connectivité existantes scale-up et scale-out. Avec Spectrum-XGS Ethernet pour scale-across networking, plusieurs data centers de tailles et distances variables peuvent être réunis comme une seule grande usine IA. Pour la première fois, le réseau peut offrir les performances nécessaires pour un entraînement IA à grande échelle et une inférence répartie à travers des centres géographiquement séparés. Spectrum-XGS Ethernet est une nouvelle addition technologique à la plate-forme NVIDIA Spectrum-X Ethernet. Elle repose sur le même ensemble matériel que les commutateurs Spectrum-X et les SuperNICs ConnectX-8, et utilise la même pile logicielle et les mêmes bibliothèques utilisées pour le scale-out dans le data center. Avec Spectrum-XGS Ethernet, la connectivité est entre des usines d’IA sur de longues distances; c’est-à-dire plus de 500 mètres. Cela peut signifier une connectivité entre bâtiments sur un campus, ou sur des dizaines ou centaines de miles, à travers des villes ou des états et même des pays. Pour rendre feasible la connectivité scale-across, les algorithmes qui assurent une large bande passante effective et l’isolation des performances ont dû évoluer. NVIDIA L’un des défis lors du transfert de données sur de longues distances est l’impact de latence accrue—même pour des données traversant une fibre optique sous forme de lumière. Les données se propagent dans les fibres à une vitesse de 5 nanosecondes par mètre. Cela signifie que parcourir 1 kilomètre prend 5 microsecondes. Ces chiffres peuvent sembler modestes en termes absolus, mais pour la communication GPU-à-GPU, chaque microseconde compte. Spectrum-XGS Ethernet propose un contrôle de congestion basé sur télémétrie modifié et un routage adaptatif optimisés en fonction de la distance entre les dispositifs communicants. À l’établissement d’une connexion, le réseau note si les deux dispositifs se trouvent dans le même data center ou non. Cela aide le switch à choisir l’approche optimale de répartition de charge pour le routage adaptatif et informe la SuperNIC sur la gestion du taux d’injection pour le contrôle de congestion. À l’échelle du réseau, cela permet à Spectrum-XGS Ethernet de gérer les communications sans ajouter de latence supplémentaire. NVIDIA Parmi les bénéfices clés de la technologie Spectrum-XGS Ethernet pour le scale-across networking figurent :

- Pour démontrer l’impact sur le scale-across, les ingénieurs NVIDIA ont exécuté des primitives NCCL entre plusieurs sites à 10 km et les ont comparées à l’Ethernet grand public. Les résultats montrent que Spectrum-XGS Ethernet offre jusqu’à 1,9x plus de bande passante NCCL all-reduce que l’Ethernet grand public. Le gain est le plus élevé pour les messages de grande taille, typiques des charges d’entraînement IA. Ces améliorations se traduisent par des temps d’exécution plus courts pour les jobs IA. NVIDIA

- Spectrum-XGS Ethernet améliore la fungibilité de l’infrastructure IA. En introduisant une technologie qui permet aux data centers de communiquer sur n’importe quelle distance sans dégradation des performances, Spectrum-XGS crée une architecture commune entre les réseaux scale-out et scale-across. Des data centers Ethernet basés sur Spectrum-XGS peuvent être réunis pour fonctionner comme un seul système, peu importe la distance. Cela permet aux infrastructures IA critiques de mutualiser les ressources et d’offrir une valeur constante pour les workloads IA avancés. NVIDIA Pour en savoir plus sur les innovations techniques derrière NVIDIA Spectrum-X Ethernet, consultez NVIDIA Spectrum-X Network Platform Architecture. NVIDIA

More news

NVIDIA HGX B200 réduit l’intensité des émissions de carbone incorporé

Le HGX B200 de NVIDIA abaisse l’intensité des émissions de carbone incorporé de 24% par rapport au HGX H100, tout en offrant de meilleures performances IA et une efficacité énergétique accrue. Cet article résume les données PCF et les nouveautés matérielles.

Scaleway rejoint les Fournisseurs d’Inference de Hugging Face pour une Inférence Serverless et Faible Latence

Scaleway est désormais un Fournisseur d’Inference pris en charge sur Hugging Face Hub, permettant l’inférence serverless directement sur les pages de modèles avec les SDK JS et Python. Accédez à des modèles open-weight populaires et bénéficiez d’une latence réduite.

Prévoir les phénomènes météorologiques extrêmes en quelques minutes sans superordinateur : Huge Ensembles (HENS)

NVIDIA et le Lawrence Berkeley National Laboratory présentent Huge Ensembles (HENS), un outil IA open source qui prévoit des événements météorologiques rares et à fort impact sur 27 000 années de données, avec des options open source ou prêtes à l’emploi.

Comment réduire les goulots d’étranglement KV Cache avec NVIDIA Dynamo

NVIDIA Dynamo déporte le KV Cache depuis la mémoire GPU vers un stockage économique, permettant des contextes plus longs, une meilleure concurrence et des coûts d’inférence réduits pour les grands modèles et les charges AI génératives.

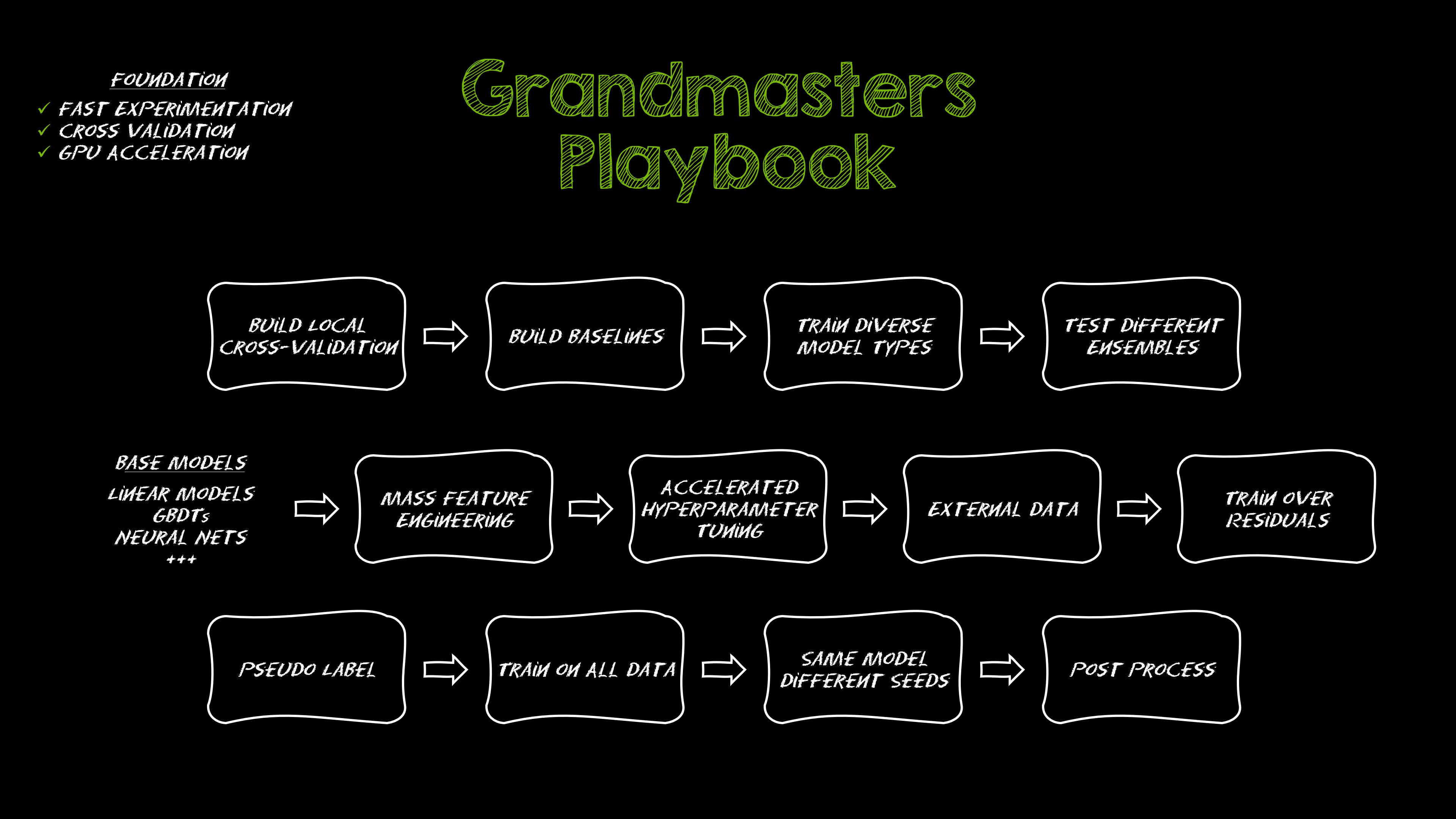

Le Playbook des Grands Maîtres Kaggle: 7 Techniques de Modélisation pour Données Tabulaires

Analyse approfondie de sept techniques éprouvées par les Grands Maîtres Kaggle pour résoudre rapidement des ensembles de données tabulaires à l’aide d’une accélération GPU, des baselines divers à l’assemblage et à la pseudo-étiquetage.

NVIDIA RAPIDS 25.08 Ajoute un Nouveau Profiler pour cuML, Améliorations du moteur GPU Polars et Support d’Algorithmes Étendu

RAPIDS 25.08 introduit deux profils pour cuml.accel (fonctionnel et ligne), l’exécuteur streaming par défaut du moteur Polars GPU, un support de types et chaînes étendu, Spectral Embedding dans cuML et des accélérations zéro-code pour plusieurs estimateurs.