Ce qui manque aux chatbots LLM : un sens de l'objectif

Sources: https://thegradient.pub/dialog, https://thegradient.pub/dialog/, The Gradient

Vue d’ensemble

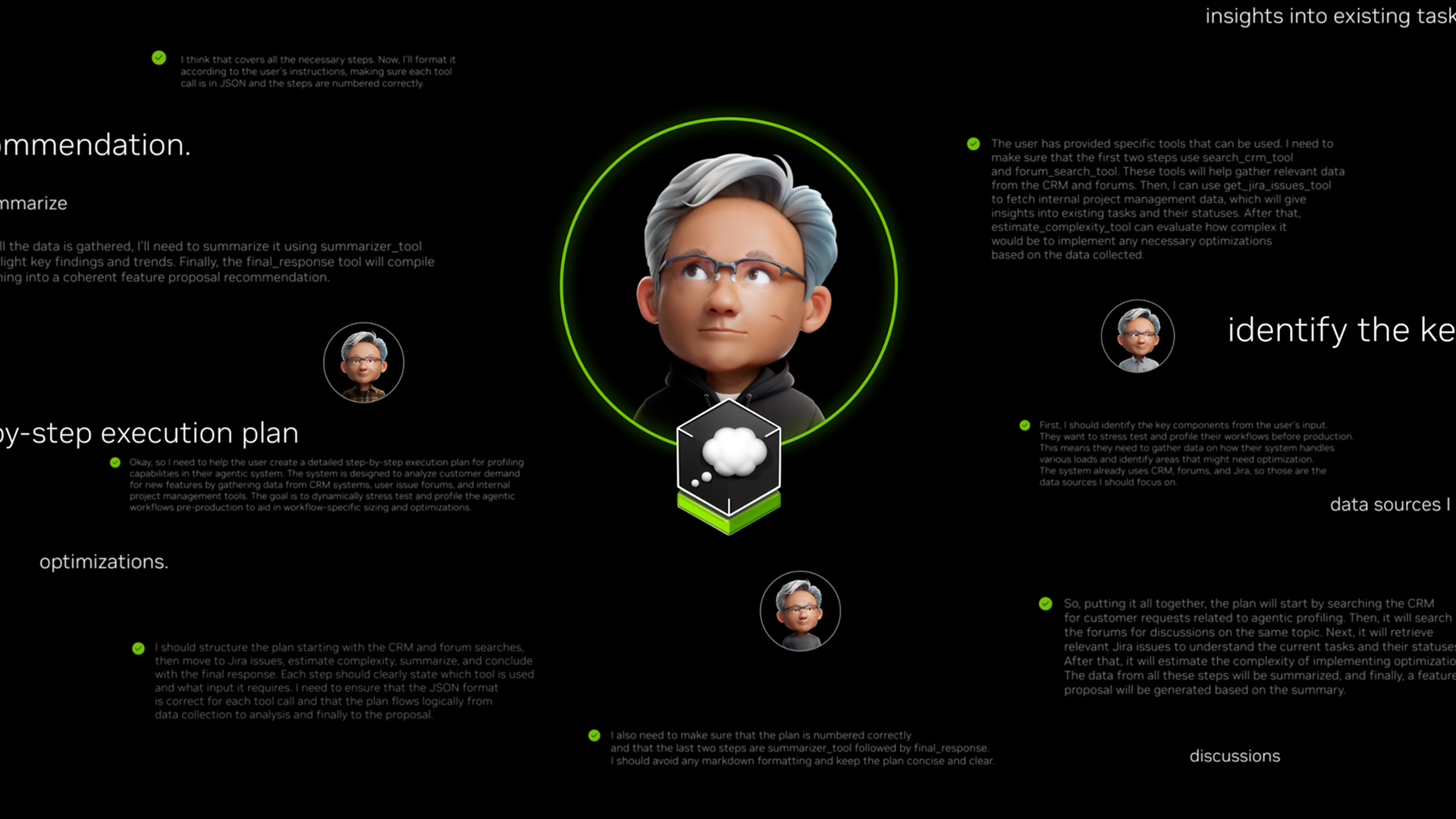

Le dialogue orienté objectif considère les chatbots LLM comme des agents collaboratifs poursuivant des buts sur plusieurs échanges, plutôt que comme de simples prédicteurs du prochain token. Un futur de collaboration homme-IA privilégie un dialogue qui affine les informations de manière itérative, négocie les préférences et met à jour le modèle du monde des deux parties. L’idée couvre des tâches simples (par exemple la planification de voyages) jusqu’à des travaux d’ingénierie plus complexes comme la génération de code, où des échanges récurrents permettent de clarifier les exigences, de rassembler des données manquantes et de réduire les défauts. Historiquement, les systèmes de dialogue ont évolué des interactions scriptées (par exemple le script de restaurant de Schank) et des premiers chatbots (ELIZA, PARRY) vers les LLM modernes, où l’historique du dialogue doit être formaté pour des modèles traitant du texte. L’article décrit trois étapes centrales : 1) Pré-entraînement : un modèle de séquence apprend à prédire le prochain token sur de vastes corpus textuels variés. 2) Introduction de la mise en forme du dialogue : l’historique est représenté par des prompts (prompts du système, échanges passés, blocs ). 3) RLHF : ajustement fin par récompenses ou pénalités pour aligner les sorties avec le comportement souhaité. Les auteurs notent que les systèmes actuels dépendent fortement des prompts système pour le comportement, mais au fil des rounds, les modèles peuvent s’éloigner de ces prompts et devenir plus vulnérables au jailbreaking ou aux hallucinations. Ils discutent aussi que les contextes longs peuvent distraire dans les dialogues, d’où des techniques comme le split-softmax pour atténuer ces effets. En bref, un dialogue significatif permet une collaboration à long terme axée sur des objectifs, mais il pose aussi de nouveaux défis de recherche et de sécurité qui ne sont pas entièrement capturés par des benchmarks à une seule passe.

Caractéristiques clés

- Dialogue multi-tours axé sur des objectifs avec prise de tour

- Mémoire et mise à jour de profils pour s’adapter aux préférences au fil du temps

- Prompts système et mise en forme du dialogue pour orienter le comportement et la sécurité

- RLHF comme étape d’ajustement fin qui complète le pré-entraînement et la mise en forme

- Capacité à lire des sources externes (ex. Twitter, arXiv, Slack, NYT) et à résumer ou rédiger

- Collaboration avec les humains similaire à la programmation en paire, diminuant les défauts par clarification

- Potentiel de personnalisation à long terme, comme la rédaction d’e-mails et l’apprentissage par les éditions

- Conscience des limites : fragilité du suivi des instructions, questions de sécurité et dérive sur les tours

- Prise en compte du contexte : les contextes plus longs ne signifient pas nécessairement une meilleure adhérence; des techniques comme split-softmax sont proposées pour atténuer cela

Cas d’usage communs

- Planification de voyages ou tâches guidées par des objectifs bénéficiant d’un clarifieur itératif

- Assistants personnels qui construisent des modèles d’utilisateur au fil du temps (par exemple, résumés matinaux de l’actualité adaptés aux préférences)

- Génération de code et tâches d’ingénierie nécessitant une boucle avec les ingénieurs pour préciser les exigences et les données

- Rôles de psychothérapeute ou de service client, avec des réserves sur la sécurité et les limites

- Lecture de ressources (Twitter, arXiv, Slack, NYT) et production de résumés ou de brouillons

- Rédaction d’e-mails ou de documents, améliorés par les éditions de l’utilisateur

Setup & installation

Aucune commande explicite de configuration ou d’installation n’est fournie dans la source.

Quick start

# Exemple minimal exécutables (conceptuel)

# Montre la structure de dialogue par tours avec un prompt système.

def respond(prompt, history, system_prompt):

# Espace réservé pour l'inférence LLM en dialogue interactif

return f"[réponse LLM à '{prompt}' avec système '{system_prompt}']"

def run():

system_prompt = "inoffensif et utile"

history = []

turns = [

{"role": "user", "text": "Je veux planifier un voyage."},

{"role": "user", "text": "Concentre-toi sur l'Europe, 5 jours, budget modéré."}

]

for t in turns:

assistant = respond(t["text"], history, system_prompt)

history.append(("user", t["text"]))

history.append(("assistant", assistant))

print(assistant)

if __name__ == "__main__":

run()Avantages et inconvénients

- Avantages

- Permet une collaboration orientée objectifs entre humains et IA sur plusieurs tours

- Autorise un échange d’informations sélectif au fil des tours, améliorant l’efficacité

- Facilite la mémoire et la personnalisation, en adaptant les préférences de l’utilisateur

- Soutient des flux de travail collaboratifs en codage et autres domaines

- Inconvénients

- Les modèles peuvent dériver des prompts système au fil des tours, posant des questions de sécurité

- Le jailbreaking et les hallucinations peuvent augmenter lorsque les prompts deviennent obsolètes

- Les dialogues plus longs restent soumis à des limitations malgré des contextes plus importants

- Mettre en place une gestion robuste des tours et de la mémoire demande une ingéniérie soignée

Alternatives (brève comparaison)

| Approche | Description | Points forts | Limites |---|---|---|---| | Instruction unique | Un seul tour guidant le modèle pour une tâche | Simple, faible latence | Implique peu la prise en compte des objectifs évolutifs |Dialogue orienté objectif (multi-tours) | Échanges itératifs pour atteindre un objectif | Meilleure échange d’informations; mémoire et personnalisation | Plus complexe; défis de sécurité et de stabilité |RLHF avec systèmes interactifs | Ajustement fin basé sur le retour humain | Généralement mieux aligné et robuste | Besoins en données; risque de surajustement au feedback |

Licensing or Pricing

Non spécifié dans la source.

References

More resources

Réduire les coûts de déploiement des modèles tout en conservant les performances grâce au swap de mémoire GPU

Exploitez le swap mémoire GPU (hot-swapping de modèles) pour partager les GPUs entre plusieurs LLM, réduire les coûts inoccupés et améliorer l’auto-Scaling tout en respectant les SLA.

Fine-Tuning gpt-oss pour la précision et les performances avec l’entraînement par quantisation (QAT)

Guide du fine-tuning de gpt-oss utilisant SFT + QAT pour récupérer la précision FP4 tout en préservant l’efficacité, avec upcast vers BF16, MXFP4, NVFP4 et déploiement avec TensorRT-LLM.

Comment les petits modèles linguistiques contribuent à une IA agentique évolutive

Explique comment les petits modèles linguistiques permettent une IA agentique plus rentable et flexible, aux côtés des LLMs, via NVIDIA NeMo et Nemotron Nano 2.

Comment faire évoluer vos agents LangGraph en production d’un seul utilisateur à 1 000 collègues

Guide pour déployer et faire évoluer des agents LangGraph en production avec le NeMo Agent Toolkit, des tests de charge et une mise en œuvre par étapes pour des centaines à des milliers d’utilisateurs.

NVFP4 Entraîne avec une Précision de 16 Bits et une Vitesse et Efficacité de 4 Bits

NVFP4 est un format de données en 4 bits offrant une précision équivalente au FP16 avec la bande passante et l’efficacité mémoire du 4 bits, étendu au pré-entraînement pour les grands modèles de langage. Ce profil couvre des expériences en 12B, la stabilité et les collaborations industrielles.

TextQuests : Évaluer les LLM dans des jeux d’aventure textuels

TextQuests est un benchmark qui évalue les agents LLM sur 25 jeux classiques d’infocom, mettant l’accent sur le raisonnement en contexte long et l’exploration autonome.