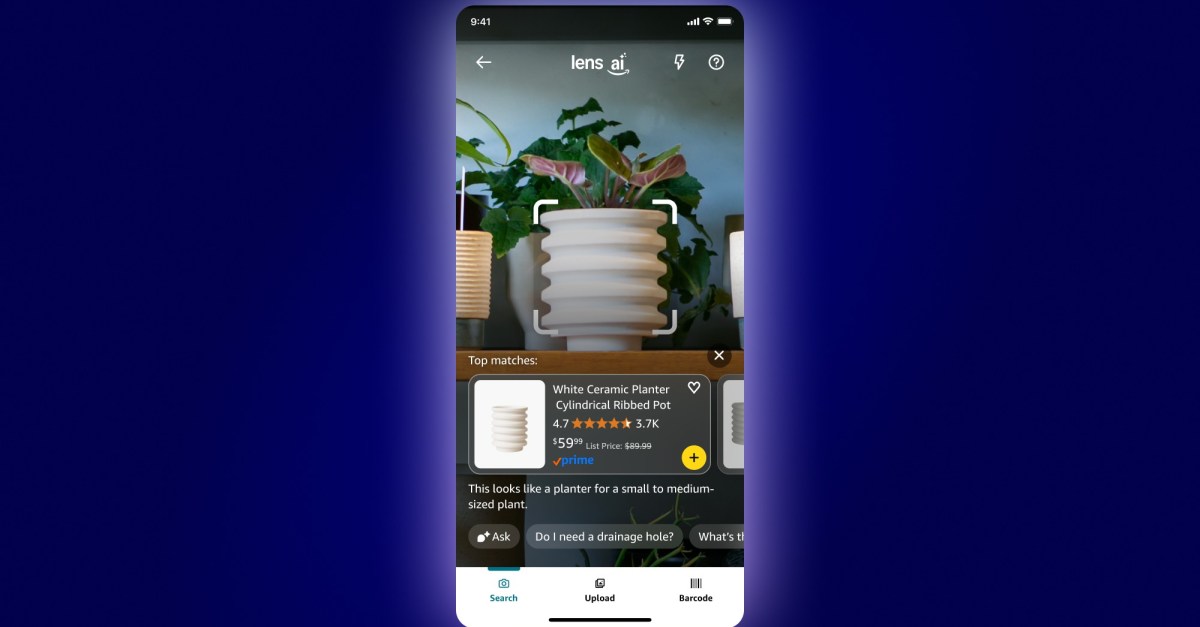

Amazon Lens Live AI: Compras em tempo real apontando a câmera

Sources: https://www.theverge.com/news/769585/amazon-lens-live-ai-real-time-shopping, The Verge AI

TL;DR

- A Lens Live permite comprar apontando a câmera, varrendo o ambiente para apresentar listas de produtos correspondentes em tempo real.

- Ela usa um modelo de detecção de objetos para identificar itens e compará-los com bilhões de listagens da Amazon, apresentando os resultados em um carrossel deslizável.

- As opções permitem adicionar itens ao carrinho ou à lista de desejos e integra o Rufus para resumir descrições e responder perguntas.

- O Lens Live está sendo lançado no aplicativo Amazon Shopping para iOS e deve chegar a mais usuários nas próximas semanas; é a abordagem da Amazon para ferramentas de varredura ao vivo, com ênfase na compra.

Contexto e antecedentes

A Amazon já oferece capacidades de busca visual no aplicativo Shopping, incluindo envio de imagens, varredura de códigos de barras e consultas por foto. O Lens Live amplia essas funcionalidades ao permitir reconhecimento de objetos em tempo real no ambiente do usuário enquanto você move a câmera ou foca em um item específico. A imprensa descreve o Lens Live como a resposta da Amazon a experiências de varredura ao vivo semelhantes ao Gemini Live do Google, com a diferença de enfatizar fortemente a compra direta quando itens são identificados. A experiência utiliza o catálogo vasto da Amazon, com a intenção de exibir correspondências de bilhões de itens da plataforma.

O que há de novo

O Lens Live usa um modelo de detecção de objetos para identificar produtos mostrados no feed da câmera em tempo real. Quando um item é reconhecido, o Lens Live o compara com o marketplace da Amazon para exibir itens similares ou correspondentes. O usuário vê um carrossel deslizável com correspondências, com ações diretas para adicionar ao carrinho ou à lista de desejos. A experiência pode ser guiada por varredura de uma sala ou foco em um produto específico. Além das informações do produto, o Lens Live integra o Rufus, assistente de IA da Amazon, para resumir descrições e responder perguntas sobre os itens. Essa funcionalidade complementa as capacidades visuais existentes da Amazon, que já permitiam buscas por imagem, leitura de código de barras e captura de foto dentro do app. A empresa afirma que o Lens Live está sendo lançado para iOS no momento, com planos de ampliar o acesso nos próximos meses.

Por que isso importa (impacto para desenvolvedores/empresas)

O Lens Live demonstra um fluxo de compras com IA em tempo real dentro de um aplicativo consumidor, mostrando como reconhecimento de objetos ao vivo pode ser combinado com um catálogo amplo para oferecer correspondências acionáveis. Para desenvolvedores, é um exemplo de como criar experiências de compra assistidas por IA no aplicativo. A integração com o Rufus aponta para caminhos de combinar resumos de produtos e perguntas e respostas com resultados de busca ao vivo, potencialmente acelerando jornadas de compra e reduzindo lacunas de informação no momento da decisão. De uma perspectiva corporativa, isso ilustra o valor crescente de IA multimodal no varejo: percepção em tempo real, comparação com o catálogo e ações de compra imediatas dentro de um app, com suporte de um assistente IA para informações rápidas.

Detalhes técnicos ou Implementação

O Lens Live depende de um modelo de detecção de objetos capaz de identificar produtos mostrados no feed da câmera em tempo real. Assim que um item é reconhecido, o sistema o compara com bilhões de itens cadastrados no marketplace da Amazon para apresentar correspondências ou itens similares. Os resultados aparecem em um carrossel deslizável, com ações diretas para adicionar ao carrinho ou à lista de desejos. O recurso está atualmente sendo lançado para o aplicativo Amazon Shopping no iOS e deve alcançar mais usuários nas próximas semanas. O Lens Live também integra o Rufus, o assistente de IA da Amazon, para resumir descrições de produtos e responder perguntas sobre itens identificados. Essa integração busca facilitar a compreensão rápida de detalhes do produto sem deixar o fluxo de varredura. A abordagem se apoia nas capacidades existentes de busca visual da Amazon, que já suportavam envio de imagens, varredura de códigos de barras e consultas por fotos.

Principais conclusões

- Lens Live permite identificar itens em tempo real e comprar apontando a câmera no aplicativo Amazon Shopping (iOS, rollout progressivo).

- Usa um modelo de detecção de objetos e compara resultados com bilhões de listagens para apresentar correspondências.

- Um carrossel deslizável mostra itens correspondentes com opções diretas de adicionar ao carrinho ou à lista de desejos.

- O Rufus está integrado para resumir descrições e responder perguntas sobre itens identificados.

- O lançamento deve se expandir nas próximas semanas, sinalizando o contínuo interesse da Amazon em experiências de compra com IA dentro de apps.

FAQ

-

O que é Lens Live?

Lens Live é um recurso alimentado por IA que usa a câmera para escanear o ambiente em tempo real e apresentar listagens de produtos correspondentes no marketplace da Amazon.

-

Onde Lens Live está disponível agora?

Está sendo lançado para o aplicativo Amazon Shopping no iOS, com planos de ampliar o acesso nas próximas semanas.

-

Como Lens Live identifica itens?

Usa um modelo de detecção de objetos para identificar produtos visíveis na câmera em tempo real e compará-los com bilhões de listagens da Amazon.

-

O que acontece após a identificação dos itens?

Um carrossel deslizável exibe itens correspondentes, com opções diretas para adicionar ao carrinho ou à lista de desejos, e o Rufus pode resumir descrições e responder perguntas.

Referências

More news

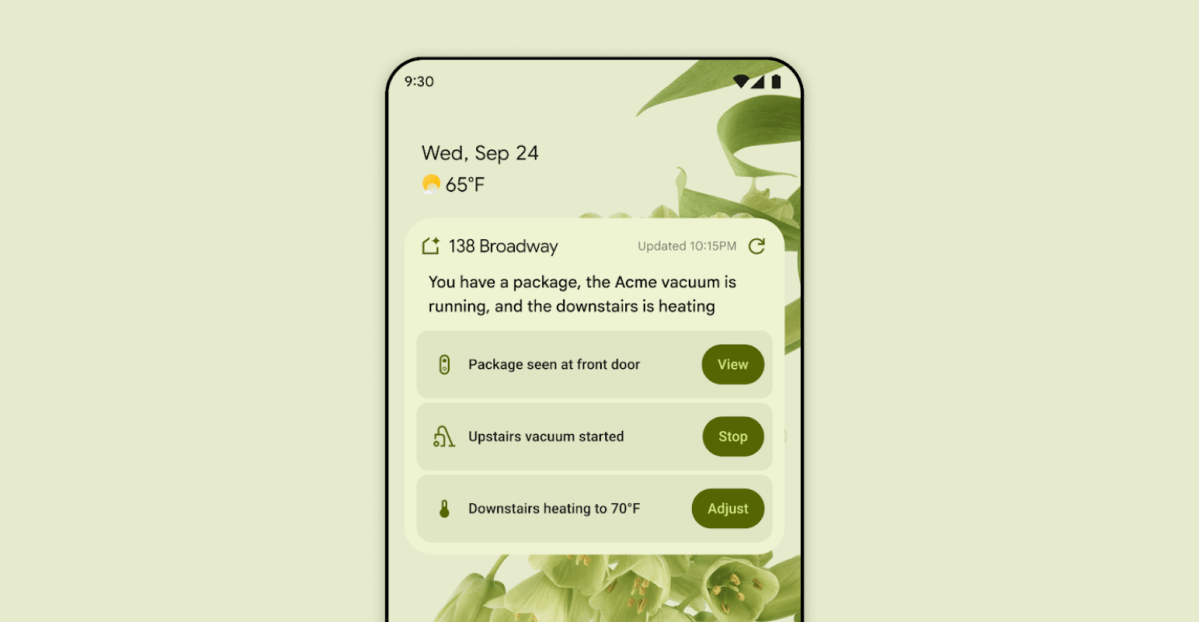

Primeira olhada no app Google Home alimentado pelo Gemini

O The Verge mostra que o Google está atualizando o app Google Home para trazer recursos do Gemini, incluindo a barra de busca Ask Home, um redesign da interface e controles por voz natural para o lar.

Demos fracassados de óculos com Live AI da Meta não tiveram relação com Wi‑Fi, explica o CTO

Demos ao vivo dos óculos Ray‑Ban com Live AI da Meta enfrentaram falhas constrangedoras. O CTO Andrew Bosworth explica as causas, incluindo tráfego autoimplicado e um bug raro de chamada de vídeo, e aponta que o bug foi corrigido.

OpenAI supostamente desenvolve alto-falante inteligente, óculos, gravador e pin com Jony Ive

A OpenAI estaria explorando uma família de dispositivos com o ex-chefe de design da Apple, Jony Ive, incluindo um alto-falante inteligente sem tela, óculos, um gravador de voz e um pin vestível, com lançamento previsto para o final de 2026 ou início de 2027.

Shadow Leak mostra como agentes do ChatGPT podem exfiltrar dados do Gmail via injeção de prompt

Pesquisadores de segurança demonstraram uma injeção de prompt chamada Shadow Leak que usou o Deep Research do ChatGPT para extrair dados de uma caixa de entrada do Gmail. OpenAI corrigiu a falha; o caso destaca riscos de IA com atuação autônoma.

Google expande Gemini no Chrome com lançamento multiplataforma e sem taxa de assinatura

O Gemini AI no Chrome ganha acesso às abas, histórico e propriedades do Google, com rollout para Mac e Windows nos EUA sem cobrança e com automação de tarefas e integrações com o Workspace.

James Cameron sobre IA e Realidade Mista: uma visão baseada em molduras com 3D no Quest

James Cameron e o CTO da Meta, Andrew Bosworth, discutem produção estereoscópica, o quadro como ferramenta de narrativa e como IA generativa pode ampliar o cinema sem substituir artistas, junto com o primeiro trailer de Avatar 3 na Horizon TV.