Repensando a Fatoração de Matrizes Não Negativas com Representações Neurais Implícitas

Sources: https://machinelearning.apple.com/research/rethinking-non-negative, machinelearning.apple.com

TL;DR

- A Fatoração de Matrizes Não Negativas (NMF) pode ser estendida para representações TF irregulares tratando os fatores como funções aprendíveis, em vez de vetores fixos.

- Representações como transformadas de Constant-Q (CQT), wavelets e modelos de análise senoidal podem ser analisadas com NMF quando codificadas como representações neurais implícitas.

- O trabalho foi aceito no IEEE Workshop on Applications of Signal Processing to Audio and Acoustics (WASPAA) 2025, sinalizando um avanço significativo em processamento de sinais de áudio.

- Essa abordagem amplia o alcance do NMF para análise de áudio e possivelmente de outros domínios de sinal que não se encaetam naturalmente em forma matricial.

Contexto e antecedentes

A Fatoração de Matrizes Não Negativas (NMF) é uma ferramenta amplamente utilizada para descobrir estruturas baseadas em partes em dados não negativos. Em áudio, NMF costuma operar em representações tempo-frequência (TF) como o Short-Time Fourier Transform (STFT), que organiza dados em matrizes que podem ser decompostas em bases e ativações não negativas, proporcionando decomposições interpretabes de sinais complexos. No entanto, uma limitação de longo alcance acompanha essa visão tradicional: muitas representações TF são irregularmente amostradas no tempo ou na frequência. Representações importantes—transformada Constant-Q (CQT), diversas decomposições baseadas em wavelets e modelos de análise senoidal—não se movem naturalmente para uma matriz que possa ser diretamente fatorada pelo NMF clássico. Como essas representações não podem ser armazenadas diretamente em uma forma matricial, aplicar NMF na prática permaneceu restrito a dados com amostragem regular. Em resposta, os autores propõem uma mudança na forma como o NMF é formulado. Em vez de ancorar os componentes de fator em vetores fixos que residem em uma matriz, a abordagem trata os fatores como funções aprendíveis. Em outras palavras, os componentes de base e suas ativações são parametri zados por funções que podem se adaptar a padrões de amostragem irregulares. Essa reinterpretação está alinhada com o conceito de representações neurais implícitas, onde uma função contínua aprendível define o sinal ao longo de coordenadas, em vez de depender de um conjunto fixo de amostras. A afirmação central é que o NMF pode ser estendido para uma variedade mais ampla de classes de sinais que não requerem amostragem regular. Ao reformular o fatoração em termos de funções, as representações TF irregulares podem ser incorporadas a um arcabouço de fatoração que não depende estritamente de uma matriz. O trabalho está inserido no contexto da pesquisa em aprendizado de máquina e processamento de sinais e está associado a venues como WASPAA 2025. Além dessa ideia técnica, a página observa o posicionamento da Apple dentro de um programa de pesquisa mais amplo, com ênfase contínua em privacidade como valor central. Essa contextualização reforça a consideração de abordagens robustas de processamento de sinais e análise de dados quando se projeta aplicações no mundo real, mantendo práticas responsáveis. O trabalho é descrito no conteúdo de pesquisa da Apple e foi associado ao WASPAA 2025. A formulação centrada em componentes de fatorização aprendíveis, com referências a representações neurais implícitas, situa esta contribuição no âmbito das discussões atuais em ML e processamento de sinais de áudio.

O que há de novo

A contribuição principal é redefinir os componentes do NMF como funções aprendíveis, em vez de vetores base fixos. Essa mudança permite a fatoração de sinais que não são naturalmente armazenados como matrizes, estendendo o NMF para representações TF irregulares. Ideias-chave incluem:

- Representar bases e ativações do NMF como funções aprendíveis que podem se adaptar a padrões de amostragem irregulares.

- Permitir que o NMF opere em representações como transformadas Constant-Q (CQT), wavelets e modelos analíticos senoidais, que não são diretamente compatíveis com NMF clássico.

- Enquadrar a abordagem no contexto de representações neurais implícitas, onde uma função parametri zada por redes neurais define o sinal em coordenadas (tempo e frequência). Para ilustrar a expansão prática, considere o contraste entre representações TF regulares (STFT) e irregulares. A tabela simplificada a seguir ilustra onde o NMF clássico se aplica e como a nova abordagem amplia o escopo: | representação TF | Pode ser armazenada como matriz? | Aplicável ao NMF com funções aprendíveis? |--- |--- |--- |STFT | Sim | Aplicável pelo NMF clássico; a nova abordagem também se aplica |Transformada Constant-Q (CQT) | Não | Não diretamente aplicável; estendido por funções aprendíveis |Wavelets / modelos senoidais | Não | Não diretamente aplicável; estendido por funções aprendíveis | Essa tabela destaca a barreira prática que a nova formulação busca superar, permitindo a fatoração em um conjunto mais amplo de representações de áudio.

Por que isso importa (impacto para desenvolvedores/empresas)

Para desenvolvedores e pesquisadores envolvidos com pipelines de análise de áudio, a capacidade de aplicar NMF a representações TF irregulares abre novas possibilidades. Representações irregulares costumam oferecer vantagens, como resolução de frequência mais apropriada onde é necessária ou melhor localização no espaço tempo-frequência para certos fenômenos acústicos. Ao possibilitar NMF nesse contexto mais amplo, os praticantes podem explorar decomposições baseadas em partes, extração de recursos ou separação de fontes em representações que capturam melhor as propriedades de sinais de áudio específicos. Do ponto de vista da indústria, essa extensão pode enriquecer fluxos de análise de áudio sem exigir que usuários conformem seus dados a formatos matriciais. Ela se alinha com direções mais amplas de ML que buscam modelos baseados em funções capazes de lidar com amostragem não uniforme e variações contínuas de sinais. Adicionalmente, reflete a ênfase da Apple em privacidade como princípio orientador de pesquisa e desenvolvimento de produtos, reforçando práticas de análise de sinais responsáveis quando se aplica técnicas avançadas de processamento de áudio.

Detalhes técnicos ou Implementação

A mudança técnica essencial é migrar de bases baseadas em vetores para funções aprendíveis que parametrizam os componentes de fatoração. Ao tratar os fatores como funções, o método pode acomodar padrões de amostragem irregulares. Os fatores podem manter propriedades não-negativas e interpretabilidade, características centrais do NMF, enquanto se adaptam a representações que não podem ser organizadas como matriz. Essa abordagem está alinhada com o conceito de representações neurais implícitas, onde uma função parametri zada por redes neurais define o sinal por meio de coordenadas temporais e frequenciais. Na prática, isso pode envolver a parametrização de funções base ou ativações com redes neurais ou outros modelos aprendíveis que podem ser otimizados para se ajustar a dados TF irregulares. Embora a arquitetura exata não seja detalhada no trecho, o enquadramento sinaliza uma mudança para componentes de fatoração contínuos, definidos por funções em vez de vetores discretos. As implicações práticas incluem:

- Ampliar a aplicabilidade do NMF a tarefas reais de processamento de áudio que dependem de representações TF irregulares.

- Potencial melhoria na interpretabilidade e flexibilidade de componentes de fatoração em contexto de amostragem não uniforme.

- Um caminho de pesquisa que conecta NMF a representações neurais implícitas, possivelmente abrindo novas combinações entre fatoração clássica e codificação neural.

Pontos-chave

- O NMF é estendido para representações TF irregulares modelando componentes como funções aprendíveis.

- Bases e ativações são tratadas como funções aprendíveis em vez de vetores fixos, permitindo fatoração fora de matrizes.

- A extensão amplia a aplicabilidade do NMF em análise de áudio e pode inspirar reformulação semelhante em outros domínios de sinais.

- A pesquisa foi apresentada no WASPAA 2025, refletindo o interesse contínuo em representar sinais com padrões de amostragem não tradicionais.

- Questões de privacidade aparecem como parte da filosofia de pesquisa da Apple, apoiando práticas responsáveis na análise de dados.

Perguntas frequentes

-

- **P:** Qual problema este artigo aborda?

borda estender o NMF para representações TF irregulares tratando componentes como funções aprendíveis (representações neurais implícitas). - **P:** Quais representações TF podem ser tratadas? **A:** Representações irregulares em tempo ou frequência, como CQT (Constant-Q), wavelets e modelos analíticos senoidais, podem ser acomodadas por meio de funções aprendíveis. - **P:** Onde o trabalho foi apresentado ou aceito? **A:** O artigo foi aceito no IEEE WASPAA 2025. - **P:** Como isso difere do NMF clássico? **A:** O NMF clássico opera em matrizes com bases vetoriais; a nova abordagem parametriza bases e ativações como funções aprendíveis, permitindo fatoração para além de representações armazenadas em matriz.

Referências

More news

Checklists superam modelos de recompensa no alinhamento de modelos de linguagem

Nova abordagem de RL usa listas de verificação derivadas de instruções para orientar o alinhamento, superando modelos de recompensa fixa em vários benchmarks no Qwen2.5-7B-Instruct, apresentada na ICLR 2025.

SlowFast-LLaVA-1.5: LLMs de Vídeo Eficientes em Tokens para Compreensão de Longa Duração

A Apple ML Research apresenta SlowFast-LLaVA-1.5 (SF-LLaVA-1.5), uma família de LLMs de vídeo com eficiência de tokens para compreensão de vídeos de longa duração, usando o mecanismo SlowFast de dois fluxos e dados públicos para alcançar resultados de ponta entre 1B e 7B.

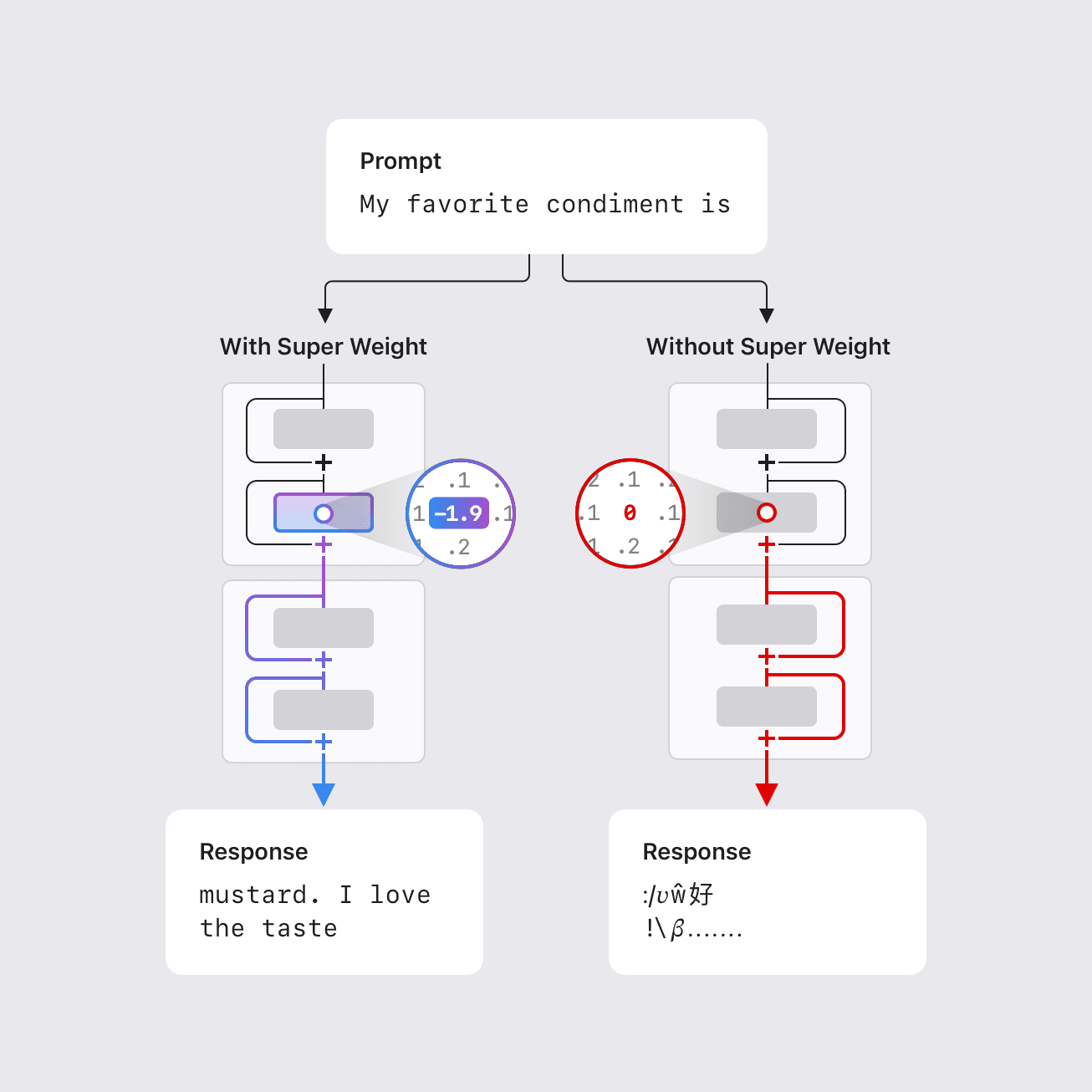

O 'Super Weight': Como um único parâmetro pode determinar o comportamento de um LLM

Pesquisadores da Apple identificam 'super weights'—um conjunto extremamente pequeno de parâmetros de LLM—que podem influenciar decisivamente o comportamento do modelo, abrindo caminhos para compressão e levantando questões sobre a dinâmica interna.

Investigando Viés Interseccional em LLMs via Disparidade de Confiança em Coreferência

Nova referência, WinoIdentity, avalia viés interseccional em LLMs por meio da Disparidade de Confiança na Coreferência (CCD) em 25 marcadores demográficos e 10 atributos, com resultados de cinco modelos.

Misty: Protótipos de UI via Blending Conceitual Interativo

Um novo fluxo de prototipagem de UI chamado Misty mescla exemplos de design com o trabalho em andamento, permitindo exploração rápida e fusões de UI serendipitamente geradas por meio do conceito cognitivo de blending conceitual.

Treinamento Ótimo de Corpus Aware (OCAT) impulsiona MT neural com ajuste leve de corpus

OCAT ajusta um modelo CAT congelando a maior parte dos parâmetros e treinando um conjunto pequeno relacionado ao corpus, gerando ganhos expressivos em WMT23 para MT.