Detecção de Acento de Tom Melhora Reconhecimento Automático de Fala Pré-Treinado

Sources: https://machinelearning.apple.com/research/pitch-accent, machinelearning.apple.com

TL;DR

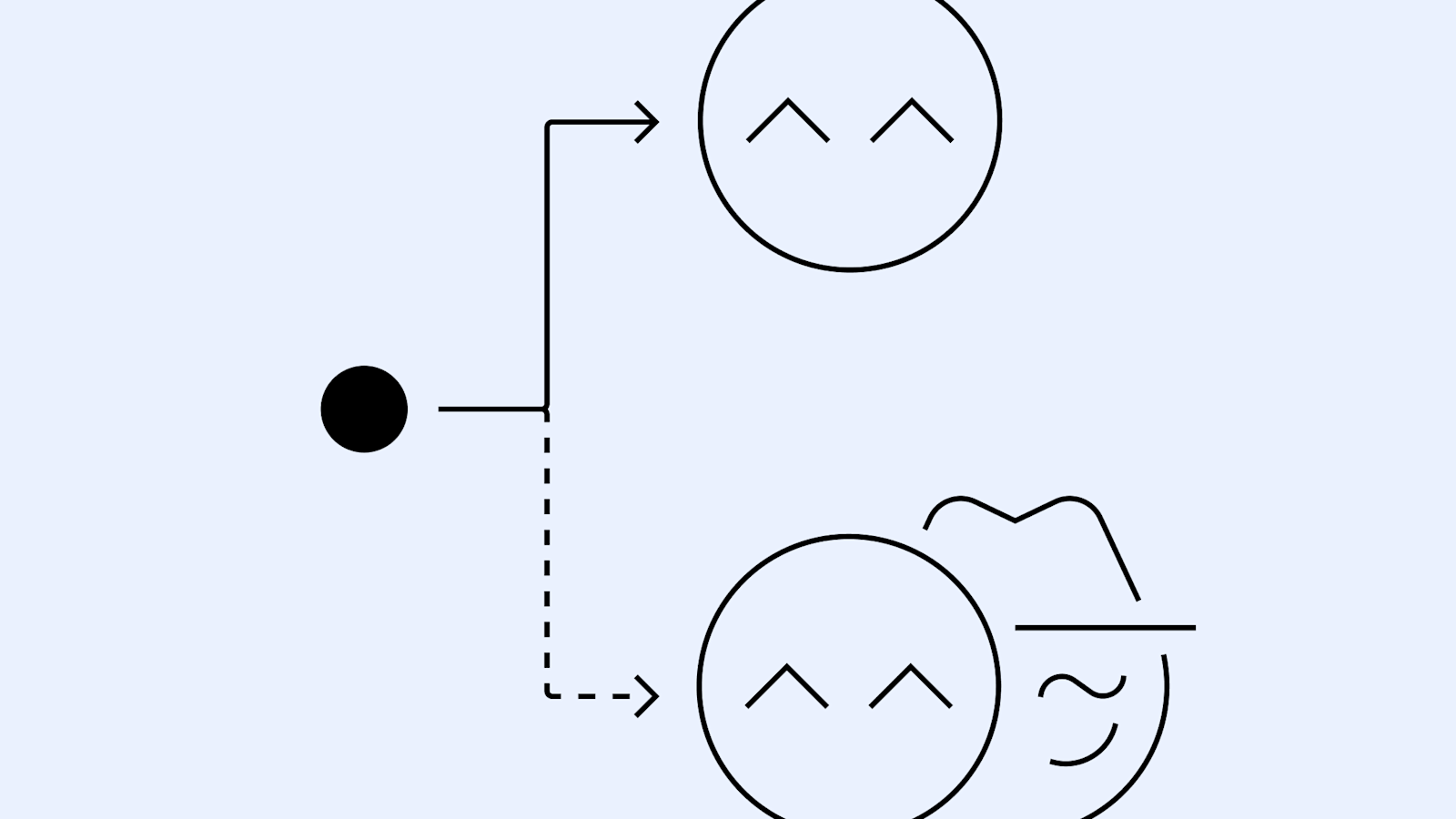

- Propõe-se um modelo conjunto de Reconhecimento Automático de Fala (ASR) e detecção de acento de tom para ampliar representações de fala semi-supervisionadas.

- O detector de acento de tom atinge melhoria significativa no estado da arte, fechando a lacuna de F1 em 41%. Apple Machine Learning Research

- O treinamento conjunto reduz o WER no LibriSpeech em 28,3% com ajuste fino de recursos limitados. Apple Machine Learning Research

- Os resultados destacam a importância de estender modelos de fala pré-treinados para manter ou reaprender pistas prosódicas como o acento de tom.

Contexto e antecedentes

Sistemas de Reconhecimento Automático de Fala (ASR) passam a usar representações de fala semi-supervisionadas para melhorar a precisão. Paralelamente, pistas prosódicas, especialmente o acento de tom, desempenham papel crucial na fala natural e na interpretação adequada. O estudo apresenta uma abordagem de modelagem conjunta que combina ASR com detecção de acento de tom, visando preservar ou reaprender informações prosodias ao estender modelos de fala pré-treinados. O trabalho é apresentado em contexto de pesquisa em interação humano-computador e Processamento de Fala e Linguagem Natural, com participação em conferências relevantes como Interspeech. A data citada é 6 de outubro de 2020. A principal afirmação é que adicionar um componente complementar de detecção de acento de tom a uma framework pré-treinada baseado em semi-supervisão pode gerar ganhos significativos tanto para a tarefa de prosódia quanto para o desempenho do ASR, especialmente quando os recursos para ajuste fino são restritos.

O que há de novo

- Introdução de um modelo conjunto de ASR e detecção de acento de tom, integrando duas tarefas relacionadas em um único aprendizado.

- O componente de detecção de acento de tom atinge desempenho notável em relação ao estado da arte para detecção de acento de tom, reduzindo a lacuna de F1 em 41% em relação a abordagens anteriores. Apple Machine Learning Research

- No treinamento conjunto, o desempenho de ASR no LibriSpeech melhora sob ajuste fino com recursos limitados, com redução de WER de 28,3%. Apple Machine Learning Research

- Os achados ressaltam o valor de preservar ou reaprender pistas prosódicas como o acento de tom ao estender modelos de fala pré-treinados.

| Métrica | Resultado |

|---|---|

| Lacuna de F1-score fechada (detecção de acento de tom) | 41% |

| Redução de WER no LibriSpeech (ajuste fino com recursos limitados) | 28,3% |

| Os resultados são apresentados no âmbito da pesquisa em conferências como Interspeech, com destaque para o patrocínio da Apple. |

Por que isso importa (impacto para desenvolvedores/empresas)

Para desenvolvedores que constroem produtos com ASR, o estudo sugere um caminho prático para melhorar o desempenho sem exigir modelos inteiramente novos ou grandes quantidades de dados rotulados. Ao ampliar modelos pré-treinados com um módulo de detecção de acento de tom e treinar conjuntamente, é possível manter ou reaprender pistas prosódicas importantes que influenciam a compreensão e a naturalidade da fala. Em cenários com ajuste fino limitado, melhorias no WER podem se traduzir em transcrições mais confiáveis, melhor manejo de variações prosódicas e possível redução de custos com coleta de dados. Além disso, a abordagem está alinhada com interesses da indústria em tornar sistemas de fala mais robustos à variação prosódica, relevante para assistentes de voz, ditado e automação de atendimento ao cliente, onde padrões de fala variam entre usuários e contextos.

Detalhes técnicos ou Implementação

O foco central é um modelo conjunto que combina ASR com detecção de acento de tom. O estudo enfatiza que o detector de acento de tom contribui para o desempenho de estado da arte nessa tarefa e também beneficia o ASR quando treinado junto. As figuras quantitativas destacadas são:

- Redução de 41% na lacuna de F1-score para detecção de acento de tom, indicando que o detector está próximo ou supera as melhores práticas anteriores.

- Melhora de 28,3% no WER do ASR no LibriSpeech quando o modelo é treinado de forma conjunta sob ajuste fino com recursos limitados. O trabalho usa representações de fala semi-supervisionadas como base, com o módulo de acento de tom fornecendo informações complementares para ajudar o modelo a capturar melhor as pistas prosódicas. Os resultados mostram que extender modelos de fala pré-treinados para manter ou reaprender informações prosódicas importantes, especialmente o acento de tom, pode trazer ganhos mensuráveis em prosódia e na precisão da transcrição.

Principais conclusões

- Modelos conjuntos de ASR e detecção de acento de tom podem superar abordagens de tarefa única.

- Preservar pistas prosódicas em modelos pré-treinados é essencial para a robustez da compreensão da fala.

- Em cenários com recursos limitados para ajuste fino, o treinamento conjunto pode melhorar significativamente o WER em benchmarks padrão como LibriSpeech.

- Os resultados apoiam trajetórias de pesquisa que integram módulos sensíveis à prosódia em representações de fala pré-treinadas.

Perguntas frequentes

-

O que é detecção de acento de tom neste contexto?

Trata-se de identificar pistas de prosódia de tom em fala como uma tarefa separada, integrada ao ASR em um modelo conjunto.

-

uais ganhos de desempenho foram observados?

lacuna de F1-score para detecção de acento de tom caiu em 41%, e o WER do ASR melhorou em 28,3% no LibriSpeech sob ajuste fino com recursos limitados.

-

Por que isso é importante para aplicações do mundo real?

Mostra que manter ou reaprender pistas prosódicas em modelos pré-treinados pode melhorar a acurácia da transcrição e a robustez a variações prosódicas, o que é valioso para assistentes de voz e serviços de transcrição.

-

Onde encontrar o trabalho original?

O conteúdo está descrito no site de pesquisa de Machine Learning da Apple: https://machinelearning.apple.com/research/pitch-accent.

Referências

More news

Shadow Leak mostra como agentes do ChatGPT podem exfiltrar dados do Gmail via injeção de prompt

Pesquisadores de segurança demonstraram uma injeção de prompt chamada Shadow Leak que usou o Deep Research do ChatGPT para extrair dados de uma caixa de entrada do Gmail. OpenAI corrigiu a falha; o caso destaca riscos de IA com atuação autônoma.

Deteção e redução de scheming em modelos de IA: avanços, métodos e implicações

OpenAI e Apollo Research avaliaram desalineação oculta em modelos de fronteira, observaram comportamentos de scheming e testaram um método de alinhamento deliberativo que reduziu ações encobertas em cerca de 30x, com limitações e trabalhos em andamento.

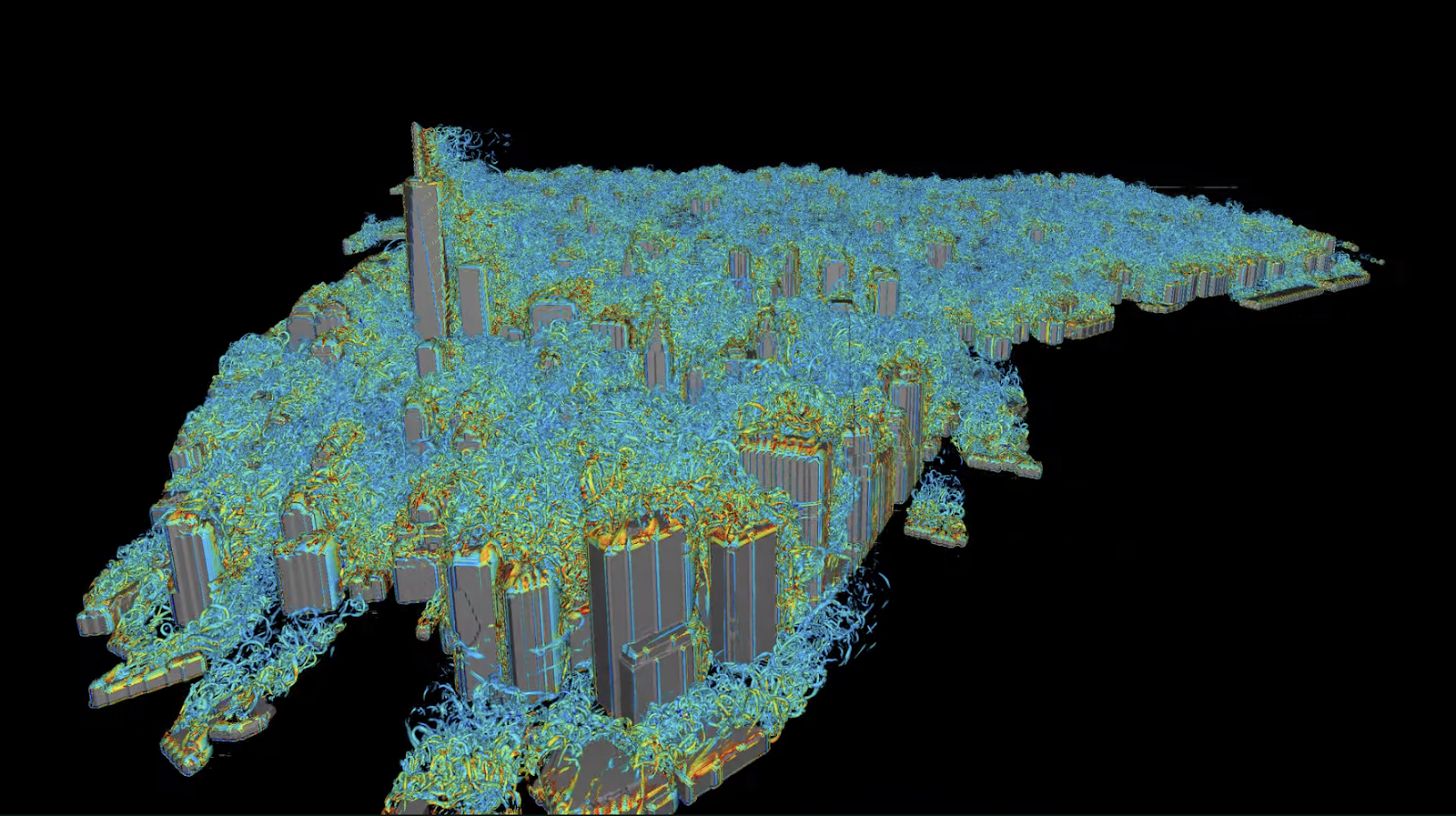

Autodesk Research Revoluciona CFD com Warp no NVIDIA GH200

Autodesk Research, NVIDIA Warp e GH200 mostram CFD baseado em Python com XLB: ~8x de velocidade, até 50 bilhões de células e desempenho próximo a soluções OpenCL/C++.

Interferência no espaço de ferramentas na era MCP: projetando para compatibilidade de agentes em escala

Microsoft Research aborda interferência no espaço de ferramentas na era MCP e descreve considerações de design para compatibilidade de agentes em escala, com Magentic-UI como exemplo ilustrativo.

RenderFormer: How neural networks are reshaping 3D rendering

RenderFormer, from Microsoft Research, is the first model to show that a neural network can learn a complete graphics rendering pipeline. It’s designed to support full-featured 3D rendering using only machine learning—no traditional graphics computation required. The post RenderFormer: How neural ne

Quebrando a barreira de rede na infraestrutura de IA

A Microsoft Research descreve o MOSAIC, um conceito de interconexão óptica baseado em microLEDs para superar limites de memória e rede no data center que restringem o desempenho de IA, com potencial para transformar designs de clusters de IA.