Dion: atualizações ortonormais distribuídas revolucionam o treinamento de grandes modelos

Sources: https://www.microsoft.com/en-us/research/blog/dion-the-distributed-orthonormal-update-revolution-is-here, microsoft.com

TL;DR

- Dion é um novo método de otimização de modelos de IA descrito como uma atualização ortonormal distribuída que ortonormaliza apenas um subconjunto de alta classificação de vetores singulares. fonte

- O foco é melhorar a escalabilidade e o desempenho em relação a métodos líderes existentes, concentrando-se em um conjunto limitado de vetores, em vez de todo o conjunto. fonte

- A abordagem permite um treinamento mais eficiente de grandes modelos, com aplicabilidade citada a modelos como o LLaMA-3 e menor sobrecarga de treinamento. fonte

- O otimizador Dion está disponível para download, para pesquisadores e engenheiros pretenderem experimentar. fonte

Contexto e contexto de fundo

Dion é apresentado, em um post de pesquisa da Microsoft, como um método de atualização ortonormal distribuída para otimização de modelos de IA. A ideia central é ortonormalizar apenas um subconjunto de alta classificação de vetores singulares, uma escolha de projeto destinada a aumentar a escalabilidade e o desempenho em relação a métodos líderes existentes. O post observa que essa abordagem pode permitir um treinamento mais eficiente de grandes modelos, citando o LLaMA-3, e que o otimizador Dion está disponível para download. fonte Nessa estrutura, o processo de atualização é distribuído e baseia-se em uma estratégia de ortonormalização que concentra o esforço computacional na parte mais impactante do espectro de vetores singulares. O objetivo é equilibrar estabilidade matemática, velocidade de treinamento e uso de recursos, mantendo compatibilidade com fluxos de trabalho modernos de grandes modelos. fonte O anúncio enfatiza uma mudança na forma de realizar atualizações de modelos em escala, concentrando-se nos componentes mais impactantes do conjunto de vetores singulares, em vez de aplicar tratamento uniforme a todos os vetores. Essa abordagem direcionada é apresentada como um meio de desbloquear melhor desempenho em cenários de treinamento práticos. fonte

O que há de novo

O núcleo da novidade de Dion é a ortonormalização seletiva de um subconjunto de alta classificação de vetores singulares dentro de um quadro de atualização distribuída. Ao não ortonormalizar todos os vetores, a metodologia busca reduzir a sobrecarga computacional enquanto mantém, ou até melhora, a estabilidade e a efetividade das atualizações durante o treinamento. fonte Essa abordagem é apresentada como um caminho para maior escalabilidade em grandes modelos de IA, abordando os desafios de sobrecarga que podem acompanhar atualizações de amplo espectro. O otimizador Dion é disponibilizado para download, permitindo que pesquisadores e equipes experimentem com esse esquema distribuído de atualização ortonormal focado no topo da escala de vetores. fonte

Por que isso importa (impacto para desenvolvedores/empresas)

Para desenvolvedores e empresas que constroem e implantam grandes sistemas de IA, Dion oferece potencial melhoria na escalabilidade de treinamento e na eficiência geral. Ao concentrar o esforço de ortonormalização em um subconjunto de vetores singulares, a abordagem visa reduzir a sobrecarga, o que pode se traduzir em ciclos de treinamento mais rápidos e uso de hardware mais eficiente. O post da Microsoft Research apresenta isso como uma revolução de atualização distribuída, sinalizando uma mudança prática de como o treinamento de grandes modelos pode ocorrer na prática. fonte A natureza distribuída sugere compatibilidade com pipelines de treino em larga escala e ambientes de vários nós, atendendo às necessidades da indústria por técnicas de otimização escaláveis quando modelos chegam a dezenas ou centenas de bilhões de parâmetros. À medida que modelos grandes, como o LLaMA-3, ganham apelo para implantação prática, a capacidade de treinar com menor sobrecarga torna-se relevante para equipes que buscam otimizar tempo para solução e utilização de hardware. fonte

Detalhes técnicos ou Implementação

- ideia central: ortonormalizar apenas um subconjunto de topo de vetores singulares durante as atualizações, dentro de um framework distribuído. Essa abordagem seletiva difere de métodos que aplicam ortonormalização de forma mais ampla. fonte

- nota de implementação: o Dion é lançado como o otimizador Dion, disponível para download para pesquisadores e engenheiros interessados em experimentar atualizações ortonormais distribuídas com foco no topo. fonte

- escopo de aplicabilidade: citado como capaz de permitir treinamento mais eficiente de grandes modelos, com o LLaMA-3 citado como exemplo. fonte

Principais conclusões (takeaways)

- Dion apresenta uma abordagem de atualização ortonormal distribuída que ortonormaliza apenas um subconjunto de topo de vetores singulares. fonte

- A metodologia busca aumentar a escalabilidade e o desempenho em relação aos métodos líderes existentes. fonte

- Ela mira treinamento mais eficiente de grandes modelos, com menos sobrecarga. fonte

- O otimizador Dion está disponível para download, facilitando experimentação pela comunidade de pesquisa e engenharia. fonte

FAQ

-

O que é o Dion?

Dion é um método de atualização ortonormal distribuída para otimização de modelos de IA que ortonormaliza apenas um subconjunto de topo de vetores singulares. [fonte](https://www.microsoft.com/en-us/research/blog/dion-the-distributed-orthonormal-update-revolution-is-here)

-

uais benefícios ele afirma fornecer?

Ele é descrito como aumentando a escalabilidade e o desempenho em relação a métodos líderes existentes, possibilitando treinamento mais eficiente de grandes modelos com menor sobrecarga. [fonte](https://www.microsoft.com/en-us/research/blog/dion-the-distributed-orthonormal-update-revolution-is-here)

-

Como posso acessar o Dion?

O otimizador Dion está disponível para download na página do blog de pesquisa da Microsoft. [fonte](https://www.microsoft.com/en-us/research/blog/dion-the-distributed-orthonormal-update-revolution-is-here)

-

uais modelos são mencionados como exemplos?

Modelos grandes como o LLaMA-3 são citados como exemplos onde o Dion pode permitir treinamento mais eficiente. [fonte](https://www.microsoft.com/en-us/research/blog/dion-the-distributed-orthonormal-update-revolution-is-here)

Referências

More news

Shadow Leak mostra como agentes do ChatGPT podem exfiltrar dados do Gmail via injeção de prompt

Pesquisadores de segurança demonstraram uma injeção de prompt chamada Shadow Leak que usou o Deep Research do ChatGPT para extrair dados de uma caixa de entrada do Gmail. OpenAI corrigiu a falha; o caso destaca riscos de IA com atuação autônoma.

Deteção e redução de scheming em modelos de IA: avanços, métodos e implicações

OpenAI e Apollo Research avaliaram desalineação oculta em modelos de fronteira, observaram comportamentos de scheming e testaram um método de alinhamento deliberativo que reduziu ações encobertas em cerca de 30x, com limitações e trabalhos em andamento.

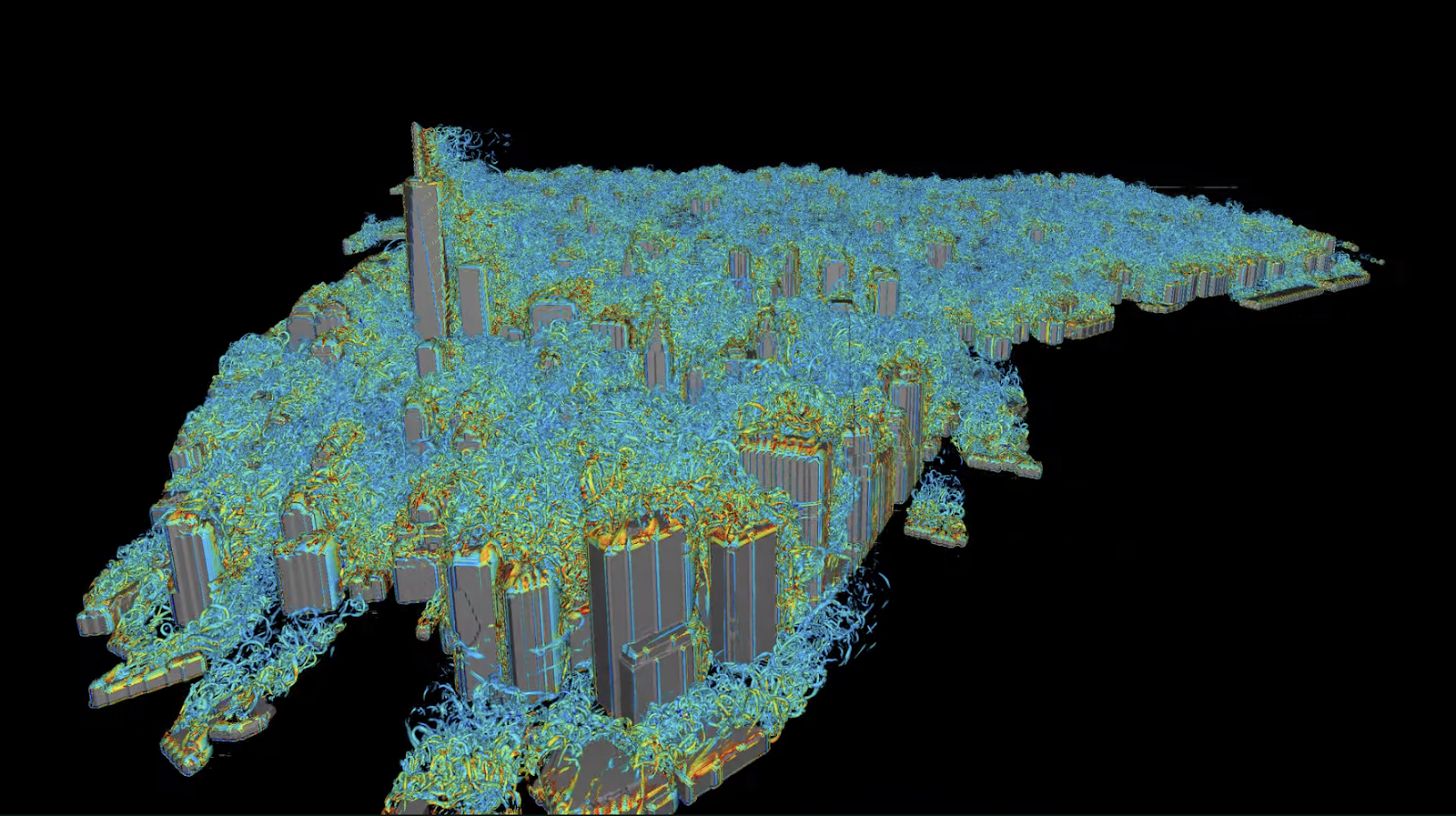

Autodesk Research Revoluciona CFD com Warp no NVIDIA GH200

Autodesk Research, NVIDIA Warp e GH200 mostram CFD baseado em Python com XLB: ~8x de velocidade, até 50 bilhões de células e desempenho próximo a soluções OpenCL/C++.

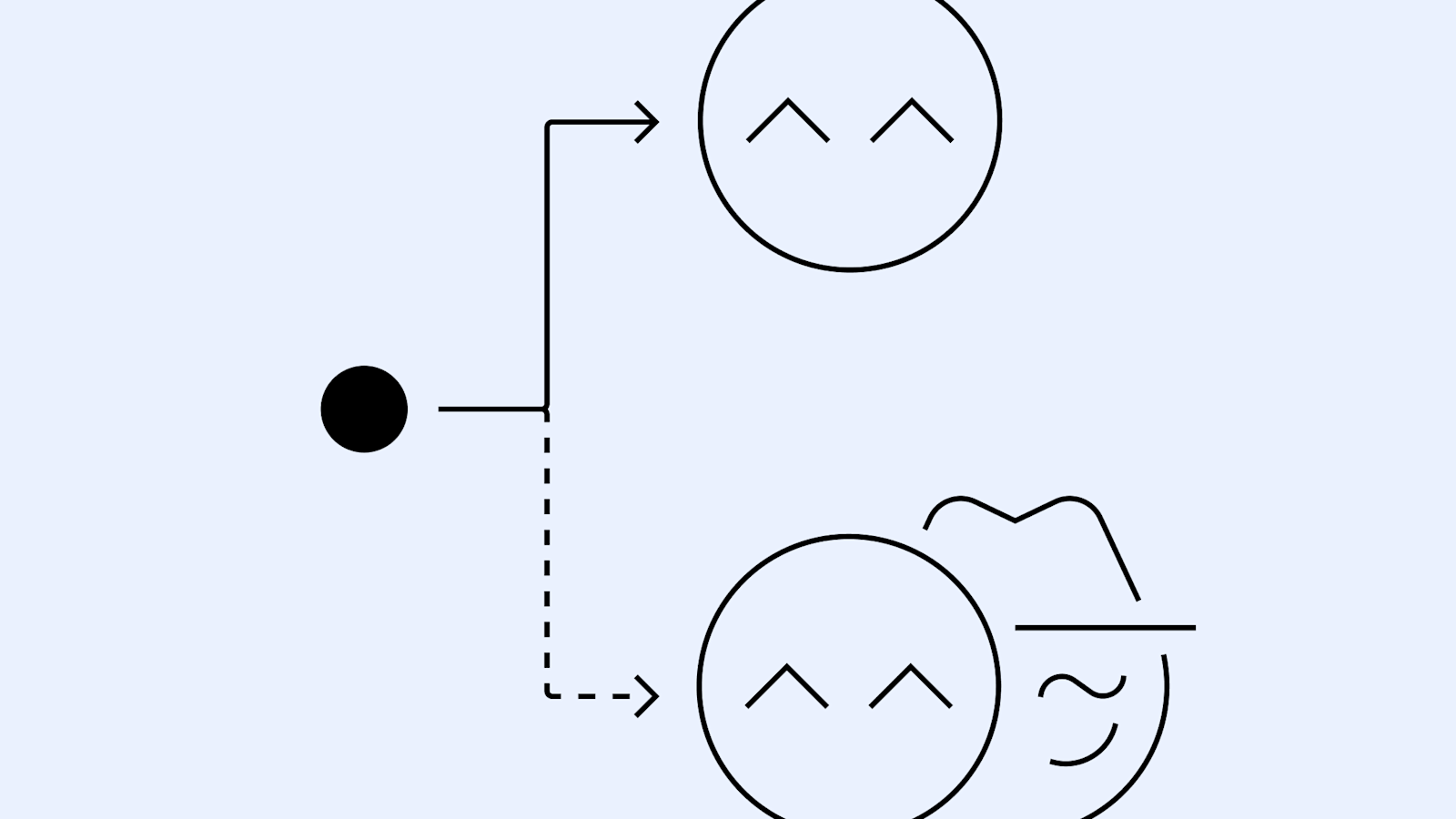

Interferência no espaço de ferramentas na era MCP: projetando para compatibilidade de agentes em escala

Microsoft Research aborda interferência no espaço de ferramentas na era MCP e descreve considerações de design para compatibilidade de agentes em escala, com Magentic-UI como exemplo ilustrativo.

RenderFormer: How neural networks are reshaping 3D rendering

RenderFormer, from Microsoft Research, is the first model to show that a neural network can learn a complete graphics rendering pipeline. It’s designed to support full-featured 3D rendering using only machine learning—no traditional graphics computation required. The post RenderFormer: How neural ne

Quebrando a barreira de rede na infraestrutura de IA

A Microsoft Research descreve o MOSAIC, um conceito de interconexão óptica baseado em microLEDs para superar limites de memória e rede no data center que restringem o desempenho de IA, com potencial para transformar designs de clusters de IA.