Renderize instantaneamente cenas do mundo real em simulação interativa com NVIDIA Omniverse NuRec e 3DGUT

Sources: https://developer.nvidia.com/blog/how-to-instantly-render-real-world-scenes-in-interactive-simulation, developer.nvidia.com

TL;DR

- A NVIDIA afirma que Omniverse NuRec e 3DGUT podem reconstruir cenas 3D fotorrealistas a partir de dados simples de sensores e implantá-las no Isaac Sim ou CARLA instantaneamente.

- O fluxo de trabalho combina COLMAP SfM/MVS com renderização 3DGUT para transformar captura de dados em um ativo USD que se integra aos ambientes de simulação.

- A reconstrução neural acelera o treinamento de robôs e veículos autônomos em simulações realistas, melhorando a transferência de simulação para o mundo real.

- Cosmos Transfer oferece síntese de vídeo controlável para expandir cenários, iluminação e clima rapidamente, com tempos de geração mais rápidos através de etapas de difusão reduzidas.

Contexto e histórico

Tradicionalmente, transformar ambientes do mundo real em simulações interativas exigia dias ou semanas de trabalho. A abordagem da NVIDIA reúne NuRec, um pipeline de renderização baseado em Gaussianos, com 3DGUT, uma representação 3D baseada em Gaussianos que utiliza transformadas não lineares, para reconstruir cenas fotorrealistas a partir de dados de sensores e implantá-las em simuladores estabelecidos como o Isaac Sim e o CARLA. O objetivo é simplificar a reconstrução neural e a renderização em uma receita repetível que se adapte a diferentes ambientes. O fluxo começa com captação de dados: aproximadamente 100 fotos de múltiplos ângulos, com boa iluminação e sobreposição para facilitar o pareamento de características. O COLMAP é utilizado para gerar uma nuvem de pontos esparsos e parâmetros de câmera. Os resultados do COLMAP alimentam o treinamento com 3DGUT, usando um arquivo de configuração como apps/colmap_3dgut_mcmc.yaml. Após o treinamento, a cena reconstruída é exportada como um arquivo USD com as flags essenciais. Um script de exemplo pode ser executado no Script Editor ou como Aplicação Autônoma para produzir um ativo USD que se integra ao ecossistema do Isaac Sim. Ao ser carregado no Isaac Sim, pode-se criar um plano de solo para simulação de mobilidade. Cenas reconstruídas também estão disponíveis no NVIDIA Physical AI Dataset para experimentação rápida. Para o desenvolvimento de veículos autônomos, as bibliotecas Omniverse NuRec foram integradas ao simulador aberto CARLA AV, abrindo possibilidades para repetição de cenários e testes em um ambiente controlável. Você pode selecionar uma cena, executá-la no CARLA, reproduzir o cenário NuRec e capturar dados dentro da simulação para testes adicionais. A captura de imagens para geração de datasets também é suportada para ampliar a validação. Para aprimorar ainda mais as cenas reconstruídas, o NVIDIA Cosmos Transfer oferece um modelo de fundação multi-controlnet para geração de vídeo fotorealista controlável. Cosmos Transfer permite sintetizar ambientes diversos, condições de iluminação e clima, além de adicionar e editar objetos dinamicamente usando controles multimodais como segmentação, mapas de profundidade e HD maps. Com Cosmos Transfer-1, o tempo de difusão é reduzido para menos de 30 segundos, e Cosmos Transfer-2 está chegando para acelerar ainda mais a geração de dados sintéticos para o desenvolvimento de AV. Essa abordagem, que combina 3D Gaussian com COLMAP SfM/MVS, fornece uma base robusta para lidar com a complexidade do mundo real, incluindo iluminação desafiadora e distorções de câmera. Ela apoia pesquisadores e engenheiros que buscam melhorar o sim-to-real e acelerar a geração de cenas de alta fidelidade para aplicações reais. Pronto para começar? O pipeline foi projetado para tornar gêmeos digitais mais realistas mais acessíveis. A NVIDIA também promove cobertura no SIGGRAPH e atualizações por meio de canais de notícias e Omniverse. Para desenvolvedores, kits de início rápido e exemplos ajudam a começar a integrar essas capacidades em seus aplicativos e serviços. Consulte o link de referência para mais contexto.

Atribuição: as afirmações a seguir descrevem as capacidades da NVIDIA conforme descrito em seu guia sobre renderizar cenas reais instantaneamente em simulação interativa. Consulte a fonte original para o contexto completo: Blog NVIDIA How to Instantly Render Real-World Scenes.

O que há de novo

- Reconstrução instantânea e implantação de cenas fotorrealistas no Isaac Sim e CARLA via Omniverse NuRec e 3DGUT.

- Fluxo de trabalho de reconstrução neural que combina COLMAP SfM/MVS com treinamento 3DGUT para produzir ativos USD prontos para simulação.

- Disponibilidade de cenas reconstruídas no NVIDIA Physical AI Dataset para experimentação rápida.

- Integração experimental que permite rever cenários NuRec no CARLA, expandindo testes de AV em um ambiente controlável.

- Cosmos Transfer amplia as capacidades com geração de vídeo fotorrealista controlável, diversificação de cenários e condições ambientais com controles multimodais.

- Ênfase explícita em lidar com iluminação desafiadora e distorções de câmera por meio da linha COLMAP + 3DGUT.

Por que isso importa (impacto para desenvolvedores/empresas)

- Ciclos de desenvolvimento mais rápidos: ao reduzir o tempo desde a captura de dados até o ativo de simulação utilizável, equipes podem iterar com mais eficiência em perceção, planejamento e controle.

- Melhor transferência de simulação para mundo real: reconstrução neural em cenas realistas ajuda a reduzir a lacuna entre desempenho em simulação e no mundo real, essencial para robótica e sistemas autônomos.

- Testes flexíveis para AV e robótica: a integração CARLA/Physical AI Dataset permite reproduzir cenários reais, validar situações e gerar dados adicionais dentro de simulações controláveis.

- Diversificação de cenários: Cosmos Transfer permite variação rápida de ambientes, clima e iluminação, facilitando validação abrangente sem reconstruir cenas manualmente.

- Fluxos práticos: o pipeline utiliza ferramentas bem estabelecidas (COLMAP) e as integra com NuRec/3DGUT para produzir ativos USD compatíveis com Isaac Sim e CARLA.

Detalhes técnicos ou Implementação

Visão geral do pipeline

- Captura de dados do mundo real: aproximadamente 100 fotos de múltiplos ângulos, com boa iluminação e sobreposição.

- Geração de características e geometria com COLMAP: nuvem de pontos esparsos e parâmetros de câmera; modelo de câmera pinhole (ou pinhole simples) compatível com 3DGUT.

- Treinamento com 3DGUT: usar as saídas do COLMAP e o arquivo de configuração apps/colmap_3dgut_mcmc.yaml.

- Exportação para USD: após o treinamento, exportar a cena reconstruída como um ativo USD com as Flags essenciais.

- Importar no Isaac Sim: carregue o ativo USD via File > Import ou arraste e solte; adicione um plano de chão para simulação de mobilidade.

- Ativos já reconstruídos: utilizar cenas do NVIDIA Physical AI Dataset para experimentação imediata.

- Fluxo AV: no CARLA, selecione uma cena reconstruída, execute no CARLA, reproduza o cenário NuRec e capture dados para testes adicionais.

- Geração de dados adicional: capture imagens dentro da simulação para enriquecer os datasets.

- Aprimoramento com Cosmos Transfer: gere vídeo fotorealista controlável com tempos de geração rápidos e controles multimodais.

Detalhes de implementação (passos selecionados)

| Passo | Descrição |

|---|---|

| Captura de dados | Aproximadamente 100 fotos de vários ângulos com boa iluminação e sobreposição. |

| Características e geometria | COLMAP para recuperar nuvem de pontos esparsos e parâmetros de câmera; modelo pinhole ou pinhole simples. |

| Treinamento | Treinamento 3DGUT usando apps/colmap_3dgut_mcmc.yaml. |

| Exportação USD | Exportar para USD com flags essenciais para uso no Isaac Sim/CARLA. |

| Importação no Isaac | File > Import ou arrastar/soltar; criar um plano de solo para simulação de mobilidade. |

| Disponibilidade de datasets | Cenas reconstruídas disponíveis no NVIDIA Physical AI Dataset. |

| Integração com CARLA | Integração experimental NuRec: selecionar a cena, executar no CARLA e reproduzir o cenário NuRec. |

| Captura de dados na sim | Capturar imagens na simulação para ampliar datasets. |

| Cosmos Transfer | Cosmos Transfer-1 para geração rápida de vídeo; Cosmos Transfer-2 em desenvolvimento para SDG (dados sintéticos) de AV. |

Principais conclusões

- Cenas do mundo real podem ser reconstruídas e implantadas em ambientes de simulação quase instantaneamente usando NuRec e 3DGUT.

- O pipeline integra COLMAP SfM/MVS com renderização neural para produzir ativos USD prontos para Isaac Sim e CARLA.

- A reconstrução neural sustenta treinamentos mais rápidos e realistas para robótica e sistemas autônomos, melhorando a transferência entre simulação e mundo real.

- Cosmos Transfer amplia capacidades com geração de vídeo controlável e variações de ambiente, acelerando validação sem reconstituir cenas manualmente.

- O NVIDIA Physical AI Dataset facilita testes imediatos sem reconstruir tudo do zero.

FAQ

- Q: O que NuRec e 3DGUT fazem neste fluxo de trabalho? A: Eles reconstróem cenas 3D fotorrealistas a partir de dados de sensores e geram ativos USD utilizáveis, que se integram ao Isaac Sim ou ao CARLA para simulação interativa.

- Q: Quantas fotos são necessárias para começar a reconstrução? A: Aproximadamente 100 fotos de múltiplos ângulos com boa iluminação e sobreposição ajudam no pareamento de características.

- Q: Como a cena reconstruída é exportada para uso na simulação? A: Após o treinamento com COLMAP e 3DGUT, exporte a cena reconstruída como USD usando flags essenciais, depois importe no Isaac Sim ou configure no CARLA.

- Q: É possível reproduzir cenários reais no CARLA usando NuRec? A: Sim, as bibliotecas Omniverse NuRec foram integradas ao CARLA para desenvolvimento de AV; você pode selecionar uma cena reconstruída, executá-la no CARLA e reproduzir o cenário NuRec.

- Q: O que o Cosmos Transfer acrescenta ao fluxo de trabalho? A: Cosmos Transfer permite geração de vídeo fotorealista controlável com variações de ambiente, clima e iluminação, usando controles multimodais para enriquecer validação e datasets.

Referências

- NVIDIA blog: How to Instantly Render Real-World Scenes in Interactive Simulation. https://developer.nvidia.com/blog/how-to-instantly-render-real-world-scenes-in-interactive-simulation

More news

NVIDIA HGX B200 reduz a Intensidade de Emissões de Carbono Incorporado

O HGX B200 da NVIDIA reduz 24% da intensidade de carbono incorporado em relação ao HGX H100, ao mesmo tempo em que aumenta o desempenho de IA e a eficiência energética. Esta análise resume os dados de PCF e as novidades de hardware.

Prever Eventos Climáticos Extremos em Minutos sem Supercomputador com Huge Ensembles (HENS)

NVIDIA e o Lawrence Berkeley National Laboratory apresentam Huge Ensembles (HENS), uma ferramenta de IA de código aberto que prevê eventos climáticos raros e de alto impacto usando 27.000 anos de dados, com opções de código aberto ou prontos para uso.

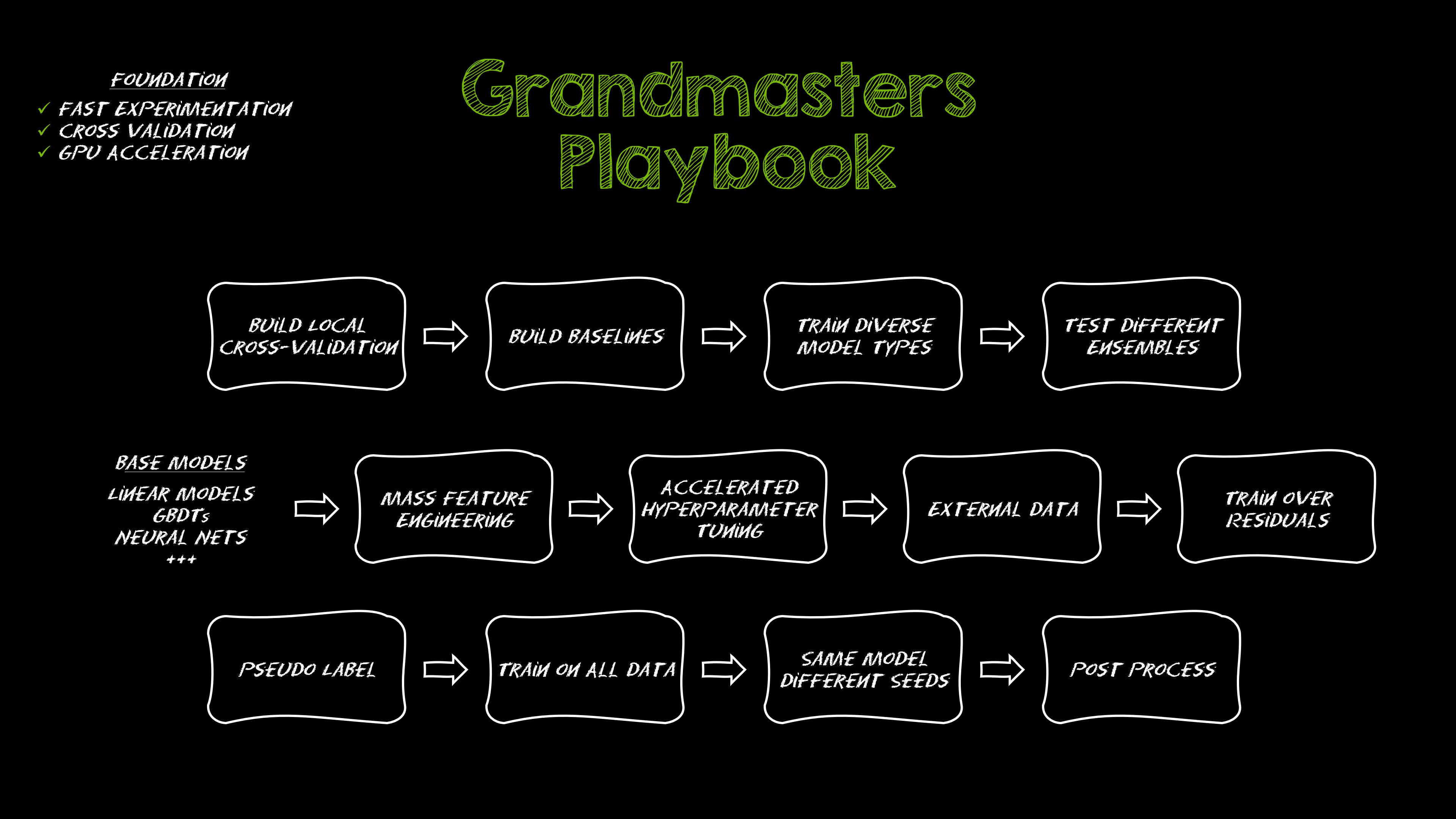

Playbook dos Grandmasters do Kaggle: 7 Técnicas de Modelagem Testadas para Dados Tabulares

Análise detalhada de sete técnicas testadas por Grandmasters do Kaggle para resolver grandes conjuntos de dados tabulares com aceleração por GPU, desde baselines diversificados até ensemble avançado e pseudo-rotulagem.

Como reduzir gargalos do KV Cache com NVIDIA Dynamo

O Dynamo da NVIDIA transfere o KV Cache da memória da GPU para armazenamento de custo mais baixo, permitindo janelas de contexto maiores, maior concorrência e menor custo de inferência em grandes modelos.

NVIDIA RAPIDS 25.08 Adiciona Novo Profiler para cuML, Melhorias no Motor GPU Polars e Suporte Ampliado de Algoritmos

RAPIDS 25.08 traz profiladores function-level e line-level para cuml.accel, executor streaming padrão no motor GPU Polars, suporte ampliado de tipos e strings, novo Spectral Embedding no cuML e acelerações com zero código para mais algoritmos.

Decodificação Especulativa para Reduzir a Latência na Inferência de IA: EAGLE-3, MTP e Abordagens Draft-Target

Exploração detalhada de decodificação especulativa para inferência de IA, incluindo métodos draft-target e EAGLE-3, como reduzem latência e como implantar em GPUs NVIDIA com TensorRT.