Claude da Anthropic ganha função de memória para lembrar conversas passadas

Sources: https://www.theverge.com/news/757743/anthropic-claude-ai-search-past-chats, theverge.com

TL;DR

- A Anthropic lançou uma função de memória para o Claude que pode buscar conversas anteriores, ler e resumir sob demanda.

- A memória não é persistente por padrão e não cria um perfil de usuário; Claude só recupera conversas passadas quando você pedir.

- o recurso funciona entre web, desktop e mobile e pode manter projetos e espaços de trabalho separados.

- A função começou a ser disponibilizada para as assinaturas Claude Max, Team e Enterprise, com outras opções avaliadas para breve.

Contexto e antecedentes

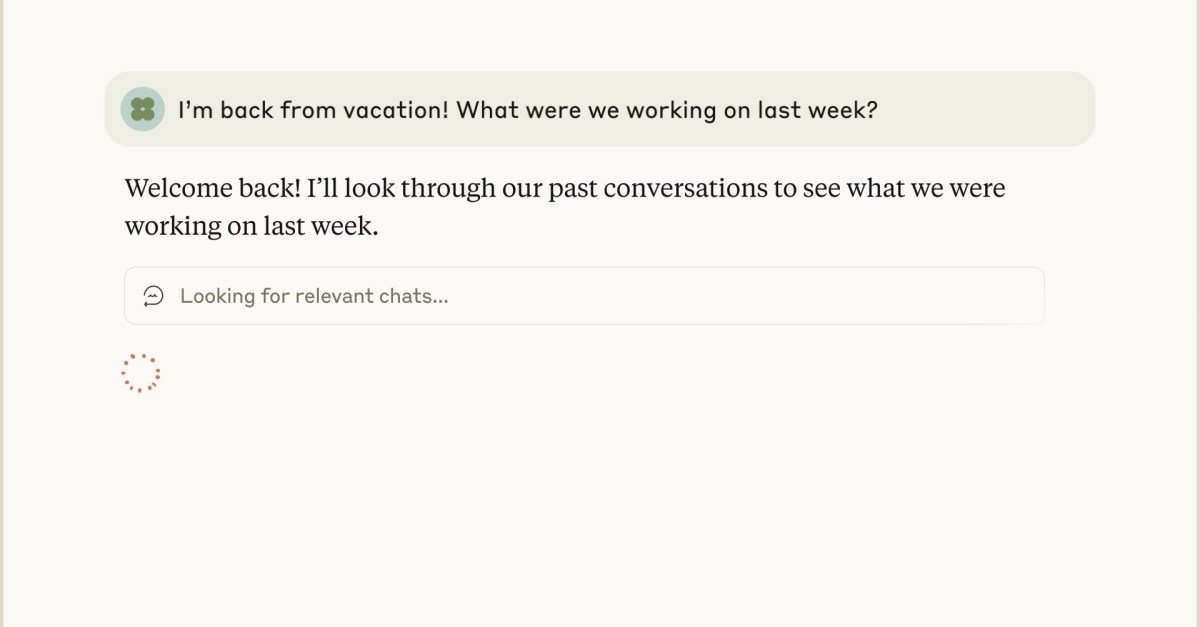

A Anthropic anunciou uma função de memória para o chatbot Claude, criada para ajudar os usuários a retomar projetos onde pararam. Em um vídeo no YouTube, a empresa demonstrou Claude pesquisando conversas anteriores para ler e resumir as discussões para o usuário. A demonstração mostrou Claude oferecendo continuar o mesmo projeto após revisar conversas anteriores, destacando a capacidade de referenciar decisões e ideias sem precisar recomeçar do zero. A memória é apresentada como uma forma de reduzir a repetição e manter a continuidade entre sessões. O recurso funciona em várias plataformas, incluindo web, desktop e mobile, e consegue manter diferentes projetos e espaços de trabalho separados para evitar confusões entre contextos. A Anthropic detalhou que a memória não é um perfil de usuário persistente; Claude recupera e referencia conversas passadas apenas quando solicitado, e não está construindo um perfil de longo prazo do usuário. Apenas parte de uma tendência maior de IA, o recurso de memória é citado como forma de aumentar a “aderência” do usuário a uma única plataforma de chatbot, alinhando-se com movimentos de concorrentes que buscam oferecer mais contexto e funcionalidades. No entanto, o artigo também aponta debates online sobre memória em modelos de chat e a forma como plataformas lidam com histórico de conversas.

O que há de novo

O principal diferencial é a memória do Claude, capaz de buscar e resumir conversas anteriores mediante solicitação do usuário. Pontos-chave incluem:

- Memória entre dispositivos: funciona no web, desktop e mobile.

- Separação de projetos: Mantém diferentes projetos e espaços de trabalho distintos.

- Memória sob demanda: não busca automaticamente conversas passadas; só quando solicitado.

- Disponibilidade por planos: começou a chegar aos planos Max, Team e Enterprise; outros planos devem ver acesso em breve.

- Caminho de ativação: usuários podem ativar a memória indo até as configurações no perfil e ativando a opção de buscar e referenciar chats. Essa abordagem busca equilibrar utilidade com controles de privacidade, garantindo que os usuários mantenham o controle sobre quando e o que é consultado.

Por que isso importa (impacto para desenvolvedores/empresas)

Memória é uma aposta estratégica para engajamento. Ao permitir que Claude referencie conversas anteriores, equipes podem manter a continuidade entre sessões, reduzindo o retrabalho de configuração repetitiva. Isso pode aumentar produtividade e aumentar a satisfação com um assistente de IA único em diversos projetos. O cenário competitivo também influencia: capacidades de memória são diferenciais à medida que plataformas de IA buscam oferecer mais manejo de contexto, conjuntos de recursos maiores e modelos de assinatura variados. A memória é apresentada como parte de um conjunto maior de melhorias, incluindo modos de voz e janelas de contexto maiores. Para as empresas, a capacidade de manter espaços de trabalho separados ajuda a impor limites de contexto e organização de dados, além de permitir que equipes gerenciem informações sensíveis com mais clareza de escopo.

Detalhes técnicos ou Implementação

A memória está acessível via configuração do usuário:

- Caminho: Configurações em Perfil > buscar e referenciar chats

- Ativação: o usuário habilita a memória para permitir que Claude pesquise e referencie conversas passadas Pontos técnicos importantes:

- Recuperação sob demanda: Claude só consulta as conversas passadas quando solicitado pelo usuário

- Design não persistente: a memória não constrói um perfil de longo prazo

- Suporte multiplataforma: funciona em web, desktop e mobile

- Isolamento de workspaces: separa projetos para evitar mistura de contextos Tal implementação requer controles de permissão, auditoria e clareza para o usuário, com a ênfase em memória acionada pelo usuário em vez de rastreamento passivo.

Principais pontos

- Claude oferece memória sob demanda para ler e resumir conversas passadas.

- A memória não é persistente e não cria um perfil; o acesso é acionado pelo usuário.

- Suporte entre plataformas e várias áreas de trabalho ajudam a organizar contextos.

- A implantação começou para Max, Team e Enterprise, com disponibilidade para outros planos em breve.

FAQ

-

a memória do Claude está sempre ligada e acessando dados automaticamente?

Não. Claude só recupera conversas passadas quando solicitado; a memória não é persistente por padrão.

-

uais planos Claude suporta memória?

O recurso começou a chegar aos planos Max, Team e Enterprise; outros planos devem receber acesso em breve.

-

É possível gerenciar vários projetos separadamente com memória?

Sim. Claude pode manter espaços de trabalho distintos para evitar misturar contextos.

-

A memória cria um perfil de usuário ou rastreia meus dados ao longo do tempo?

Anthropic afirma que a memória não constrói um perfil de usuário; o acesso é por demanda.

Referências

More news

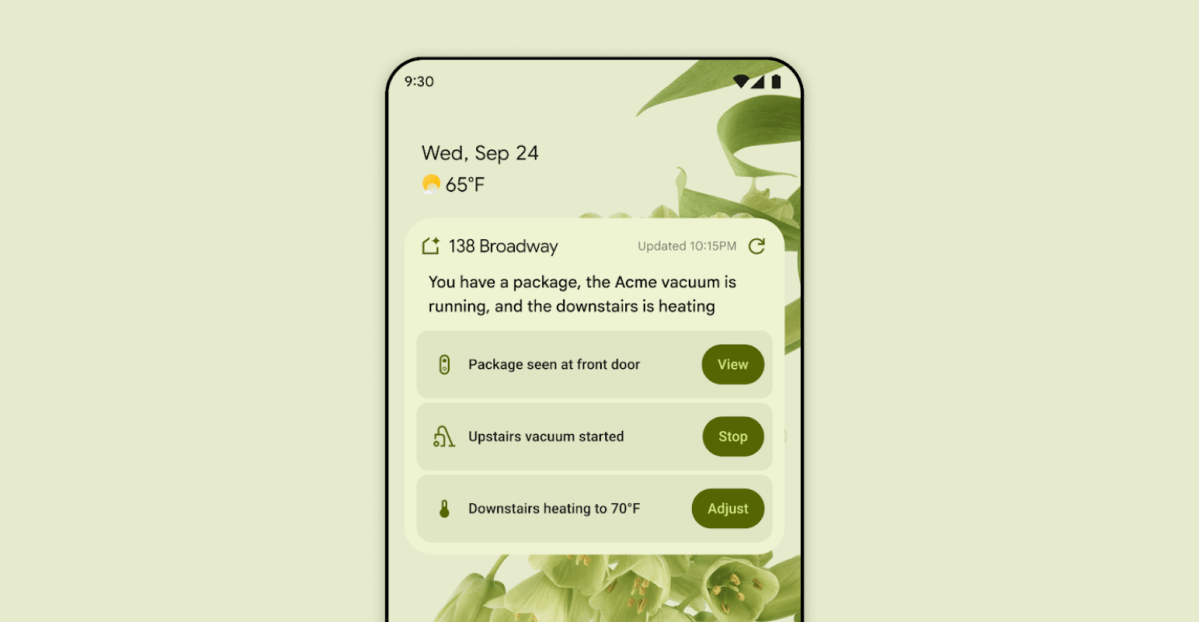

Primeira olhada no app Google Home alimentado pelo Gemini

O The Verge mostra que o Google está atualizando o app Google Home para trazer recursos do Gemini, incluindo a barra de busca Ask Home, um redesign da interface e controles por voz natural para o lar.

Demos fracassados de óculos com Live AI da Meta não tiveram relação com Wi‑Fi, explica o CTO

Demos ao vivo dos óculos Ray‑Ban com Live AI da Meta enfrentaram falhas constrangedoras. O CTO Andrew Bosworth explica as causas, incluindo tráfego autoimplicado e um bug raro de chamada de vídeo, e aponta que o bug foi corrigido.

OpenAI supostamente desenvolve alto-falante inteligente, óculos, gravador e pin com Jony Ive

A OpenAI estaria explorando uma família de dispositivos com o ex-chefe de design da Apple, Jony Ive, incluindo um alto-falante inteligente sem tela, óculos, um gravador de voz e um pin vestível, com lançamento previsto para o final de 2026 ou início de 2027.

Shadow Leak mostra como agentes do ChatGPT podem exfiltrar dados do Gmail via injeção de prompt

Pesquisadores de segurança demonstraram uma injeção de prompt chamada Shadow Leak que usou o Deep Research do ChatGPT para extrair dados de uma caixa de entrada do Gmail. OpenAI corrigiu a falha; o caso destaca riscos de IA com atuação autônoma.

Scaleway Como Novo Fornecedor de Inferência no Hugging Face para Inferência serverless de Baixa Latência

A Scaleway é agora um Fornecedor de Inferência compatível no Hugging Face Hub, permitindo inferência serverless diretamente nas páginas de modelo com as SDKs JS e Python. Acesse modelos abertos populares com operações escaláveis e baixa latência.

Google expande Gemini no Chrome com lançamento multiplataforma e sem taxa de assinatura

O Gemini AI no Chrome ganha acesso às abas, histórico e propriedades do Google, com rollout para Mac e Windows nos EUA sem cobrança e com automação de tarefas e integrações com o Workspace.