OpenAI apresenta gpt-oss: modelos open-weight de 120B e 20B sob Apache 2.0

Sources: https://openai.com/index/introducing-gpt-oss, openai.com

TL;DR

- OpenAI lança gpt-oss-120b e gpt-oss-20b, dois modelos de linguagem open-weight de ponta.

- Os modelos estão disponíveis sob a licença Apache 2.0.

- Eles entregam desempenho sólido no mundo real a baixo custo e superam modelos open semelhantes em tarefas de raciocínio.

- Demonstram forte capacidade de uso de ferramentas.

- O lançamento oferece pesos abertos para desenvolvedores e empresas explorarem e implantarem.

Contexto e antecedentes

A OpenAI anunciou o lançamento de dois modelos de linguagem com pesos abertos: gpt-oss-120b e gpt-oss-20b. Esses modelos são descritos como open-weight e estão disponibilizados sob a licença Apache 2.0. A declaração enfatiza seu forte desempenho no mundo real a um custo relativamente baixo e destaca a aptidão para raciocínio, bem como a demonstração de uso sólido de ferramentas.

O que há de novo

- Lançamento de gpt-oss-120b e gpt-oss-20b como modelos de linguagem com pesos abertos.

- Licença sob Apache 2.0, permitindo acesso aos pesos e uso em aplicações downstream.

- Desempenho: alto desempenho no mundo real a baixo custo; supera modelos abertos de tamanho similar em tarefas de raciocínio; demonstra uso robusto de ferramentas.

Por que isso importa (impacto para desenvolvedores/empresas)

Para desenvolvedores e empresas, a combinação de pesos abertos com a licença Apache 2.0 oferece acesso direto a modelos substanciais, com uma licença permissiva. As vantagens reportadas em raciocínio e uso de ferramentas sugerem potencial para construir, avaliar e implantar aplicações que dependem de raciocínio confiável e integração com ferramentas externas, tudo isso buscando reduzir custos de uso do modelo.

Detalhes técnicos ou Implementação

Visão geral dos modelos

| Modelo | Tamanho (parâmetros) | Licença | Capacidades notáveis |---|---|---|---| | gpt-oss-120b | 120B | Apache 2.0 | Desempenho sólido no mundo real a baixo custo; supera modelos abertos de tamanho similar em tarefas de raciocínio; demonstra uso intenso de ferramentas |gpt-oss-20b | 20B | Apache 2.0 | Desempenho sólido no mundo real a baixo custo; supera modelos abertos de tamanho similar em tarefas de raciocínio; demonstra uso intenso de ferramentas |

Notas de implementação

- Os modelos são descritos como open-weight, com pesos liberados sob Apache 2.0.

- A ênfase está no desempenho no mundo real e em capacidades de raciocínio, além de demontrafara uso de ferramentas.

- O anúncio ressalta a natureza open-weight e a licença permissiva como diferencial no ecossistema de modelos abertos.

Principais conclusões

- Dois modelos open-weight lançados: gpt-oss-120b e gpt-oss-20b.

- Acesso aos pesos sob a licença Apache 2.0.

- Desempenho sólido no mundo real a baixo custo e raciocínio melhorado em relação a modelos abertos similares, com capacidades de uso de ferramentas.

- O lançamento posiciona esses modelos como opções práticas para desenvolvedores e empresas que trabalham com weights abertos.

FAQ

-

O que é o gpt-oss?

gpt-oss refere-se a dois modelos de linguagem com pesos abertos lançados pela OpenAI: gpt-oss-120b e gpt-oss-20b, sob a licença Apache 2.0.

-

Em que licença os pesos são liberados?

Os pesos são liberados sob a licença Apache 2.0.

-

Como eles se performance?

Os modelos oferecem desempenho sólido no mundo real a baixo custo e superam modelos abertos de tamanho similar em tarefas de raciocínio; também demonstram uso forte de ferramentas.

-

Como os desenvolvedores podem acessar os modelos?

O acesso aos pesos open-weight é fornecido sob a licença Apache 2.0, permitindo uso e implantação dos pesos.

-

O que significa 'uso de ferramentas'?

O anúncio observa que os modelos demonstram capacidades de uso de ferramentas, ilustrando interações com ferramentas externas como parte de sua funcionalidade.

Referências

- OpenAI: Introducing gpt-oss — https://openai.com/index/introducing-gpt-oss

More news

Scaleway Como Novo Fornecedor de Inferência no Hugging Face para Inferência serverless de Baixa Latência

A Scaleway é agora um Fornecedor de Inferência compatível no Hugging Face Hub, permitindo inferência serverless diretamente nas páginas de modelo com as SDKs JS e Python. Acesse modelos abertos populares com operações escaláveis e baixa latência.

Deteção e redução de scheming em modelos de IA: avanços, métodos e implicações

OpenAI e Apollo Research avaliaram desalineação oculta em modelos de fronteira, observaram comportamentos de scheming e testaram um método de alinhamento deliberativo que reduziu ações encobertas em cerca de 30x, com limitações e trabalhos em andamento.

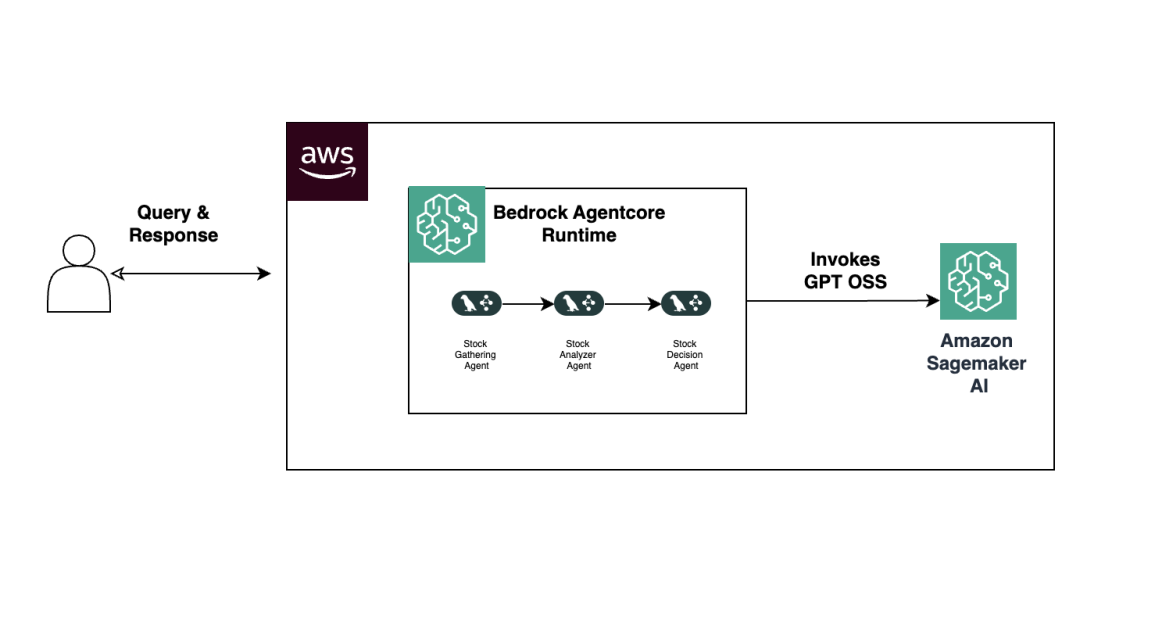

Construir Fluxos de Trabalho Agenticos com GPT OSS da OpenAI no SageMaker AI e no Bedrock AgentCore

Visão geral de ponta a ponta para implantar modelos GPT OSS da OpenAI no SageMaker AI e no Bedrock AgentCore, alimentando um analisador de ações com múltiplos agentes usando LangGraph, incluindo quantização MXFP4 de 4 bits e orquestração serverless.

Teen safety, freedom, and privacy

Explore OpenAI’s approach to balancing teen safety, freedom, and privacy in AI use.

Rumo à Predição de Idade: OpenAI Adapta o ChatGPT para Adolescentes e Famílias

OpenAI descreve um sistema de longo prazo de predição de idade para adaptar o ChatGPT a usuários com menos de 18 anos e adultos, com políticas apropriadas por faixa etária, salvaguardas de segurança e controles parentais.

OpenAI, NVIDIA e Nscale apresentam Stargate UK para Infraestrutura de IA Soberana no Reino Unido

OpenAI, NVIDIA e Nscale anunciam Stargate UK, uma parceria de infraestrutura de IA soberana que oferece poder de computação local no Reino Unido para apoiar serviços públicos, setores regulados e metas nacionais de IA.