O que Falta aos Chatbots LLM: Um Senso de Propósito

Sources: https://thegradient.pub/dialog, thegradient.pub

TL;DR

- Os chatbots baseados em LLM progridem rapidamente, mas métricas como MMLU, HumanEval e MATH estão se saturando, levantando dúvidas sobre o impacto real na experiência do usuário.

- Diálogo com Propósito usa trocas em várias etapas, com objetivo definido, para cumprir tarefas com maior confiabilidade do que interações de única passagem. Permite compartilhamento seletivo de informações, memória e adaptação às preferências do usuário.

- Prompts do sistema, formatação e RLHF moldam o comportamento, mas a instrução pode se desviar ao longo das etapas; a segurança pode diminuir em diálogos mais longos.

- Alinear troca de turnos e memória abre novas possibilidades, desde assistentes pessoais que aprendem preferências até fluxos de codificação colaborativos que lembram programação em par.

- Testes e técnicas (ex.: split-softmax) visam estabilizar instruções em conversas longas, preservando a segurança.

Contexto e antecedentes

The Gradient argumenta que, apesar dos avanços rápidos, a indústria pode estar medindo progresso por meio de métricas que não capturam valor prático para o usuário. Métricas como MMLU, HumanEval e MATH avaliam desempenho de uma única rodada, mas não refletem como humanos interagem com IA em cenários de diálogo multirodadas. Um futuro de colaboração humano–IA — em oposição à substituição de humanos — requer uma lente de avaliação diferente, que foque em metas e cooperação iterativa, e não apenas na geração de uma saída. A ideia de diálogo com Propósito enquadra a interação como uma conversa em várias etapas com objetivo, que pode ser tão amplo quanto “inofensivo e útil” ou tão específico quanto atuar como agente de planejamento de viagens, terapeuta ou bot de serviço ao cliente.

A transmissão de informações, em tarefas reais, é custosa para ser feita de uma só vez. Quando várias trocas são permitidas, apenas os dados essenciais precisam ser compartilhados. Isso se alinha à teoria da negociação: bargaining iterativo frequentemente gera melhores resultados do que uma oferta única. Cada fala pode ser vista como uma ação deliberada para alterar o modelo de mundo do outro. A citação de Terry Winograd, de que toda linguagem pode ativar procedimentos no ouvinte, embasa a ideia de que o objetivo do chatbot é ajudar pessoas a alcançar suas metas por meio de uma interação colaborativa.

O artigo ainda aponta aplicações práticas para codificação. Muitos benchmarks atuais de codificação avaliam apenas geração de uma passagem; para automatizar tarefas comuns no Github, é improvável atingir isso com uma única ação. A IA precisa dialogar com engenheiros para entender requisitos, solicitar documentação ausente e, se necessário, pedir ajuda humana. Em termos de teste, isso sugere que a cooperação parecida com programação em dupla pode reduzir defeitos sem aumentar demais o tempo de trabalho. À medida que as interações se tornam longas, o chatbot pode atualizar perfis de usuários, adaptar-se às preferências e ler fontes de informação para oferecer resumos matinais conforme o interesse do usuário.

Historicamente, os sistemas de diálogo começaram com scripts bem definidos (por exemplo, o restaurante de Schank) e evoluíram para a era de ML com ELIZA e PARRY. Hoje, a linha de montagem típica envolve três etapas: (1) pré-treinamento em grandes corpora da internet; (2) introdução de formatação de diálogo para estruturar o histórico de conversas; (3) RLHF (treinamento com feedback humano) para ajustar o comportamento. A formatação do diálogo, marcada por tokens como ou <INST>, ajuda o modelo a focar no papel atribuído, embora o formato em si seja uma adaptação posterior ao pré-treinamento. O artigo também destaca que a formatação é introduzida durante o treinamento fino e que RLHF acrescenta uma camada de alinhamento com segurança e utilidade desejadas.

Os autores observam que, embora o prompts do sistema sejam a principal ferramenta de controle hoje, LLMs podem ser frágeis sob condições adversárias. Benchmarks de uma única rodada, como MT-Bench e Alpaca-Eval, ajudam, mas avaliar a interatividade é muito mais difícil — requer prever respostas em um diálogo aberto. Em um projeto conduzido pelos autores, foi criado um ambiente para sintetizar diálogos de comprimento ilimitado entre dois agentes LM com prompts do sistema para testar a adesão às instruções ao longo de várias rodadas. Os resultados mostraram instabilidade de instruções ao longo do tempo e preocupações de segurança, demonstrando que a prática atual pode não sustentar comportamentos desejados em diálogos mais longos.

O artigo também discute o fato de que janelas de contexto maiores nem sempre ajudam: modelos com alta capacidade de atenção podem se distrair após cerca de 1.6 mil tokens em diálogos, o que motivou a proposição de soluções como split-softmax para mitigar esse efeito. Os autores destacam que a persona de um modelo deriva de pré-treinamento e RLHF, e que mesmo quando uma única persona é especificada, o modelo pode ter dificuldade em mantê-la consistentemente ao longo de várias interações.

Para leitores que acompanham a literatura, essas observações reforçam a ideia de que uma colaboração humano–IA sólida exige objetivos de uso mais claros e práticas de avaliação mais robustas. O objetivo é tornar a presença de propósito em diálogo uma meta prática e implementável, com impactos reais para desenvolvedores e empresas. Como aponta The Gradient, o diálogo com Propósito é uma moldura para a cooperação humano–IA. The Gradient.

O que há de novo

- A argumentação muda o foco de apenas acurácia de uma rodada para diálogos voltados a metas, com turnos, organização de informações e atualização de mundo ao longo da conversa.

- O texto vincula diálogo com Propósito a tarefas do mundo real, como planejamento de viagens e assistência de codificação, onde esclarecer requisitos, solicitar dados ausentes e iterar com a entrada humana é comum.

- Enfatiza memória de longo prazo e modelagem do usuário: um assistente futuro poderia aprender preferências, ler fluxos de informação (Twitter, arXiv, Slack, NYT), oferecer resumos matinais e redigir e-mails, melhorando com as edições.

- Apresenta uma abordagem de teste empírico com diálogos sintéticos entre agentes com prompts do sistema para exhibir a instabilidade de instruções ao longo de várias rodadas, revelando preocupações de segurança.

- Discute técnicas de contexto longo, como split-softmax, para mitigar distrações em diálogos extensos, ao mesmo tempo mantendo recursos do modelo. A mensagem central é que o aumento do comprimento do contexto não garante comportamento mais estável ou útil no diálogo. A estabilidade depende da interação entre prompts do sistema, arquitetura do modelo e sinais de treinamento (especialmente RLHF). A proposta de diálogos com Propósito aponta para um futuro em que memória, modelagem de usuário e colaboração contínua com humanos são centrais para avaliação e construção de assistentes de IA mais confiáveis.

Por que isso importa (impacto para desenvolvedores/empresas)

- Para equipes de produto, adotar diálogos com Propósito pode significar assistentes mais confiáveis e centrados no usuário, que refinam recomendações e ações conforme a conversa avança.

- Para desenvolvedores, a memória de diálogo implica desafios de design: como armazenar, atualizar e raciocinar sobre as preferências do usuário, mantendo privacidade e segurança.

- Para empresas, a discussão ressalta a importância de testar sistemas de IA em interações prolongadas, com objetivos claros, a fim de identificar falhas, vulnerabilidades de segurança e orientar práticas de implantação seguras.

- Em termos de negócios, diários de diários com Propósito abrem possibilidades de assistentes pessoais que sintetizam informações de fontes externas, oferecendo resumos diários conforme o interesse do usuário, desde que as questões de privacidade sejam gerenciadas.

Detalhes técnicos ou Implementação

- Pré-treinamento: o modelo de sequência é treinado para prever o próximo token em um grande corpus da internet, incluindo notícias, livros, código e dados de fóruns.

- Formatação de diálogo: como os modelos processam strings, o histórico de diálogo natural é estruturado com marcadores (por exemplo, ou

<INST>) para enfatizar o prompt do sistema. - RLHF: o chatbot passa por ajuste fino com recompensas e punições para favorecer saídas desejadas. RLHF é descrito como a cereja no topo do bolo, reconhecendo sua importância, mas lembrando que ele se apoia no pré-treinamento e no design conceitual.

- Prompts do sistema e fragilidade: promotores do sistema são a principal ferramenta de controle hoje, mas existem relatos de que os modelos podem se desviar após várias rodadas, elevando preocupações de segurança.

- Avaliação interativa e testes de estresse: pesquisadores criaram um ambiente com dois LMs promovidos pelo sistema para testar adesão às instruções ao longo de diálogos longos, introduzindo perguntas e funções de avaliação para medir a estabilidade. Os resultados indicam degradação da adesão e aumentos de risco de segurança.

- Desafios de contexto longo e solução proposta: mesmo com janelas de contexto amplas, diálogos podem distrair o modelo bem antes de alcancar o limite máximo. split-softmax é apresentado como uma técnica simples para mitigar esse efeito, mantendo capacidade do modelo e estabilidade de diálogo.

- Persona e consistência: mesmo com uma persona especificada, manter essa persona ao longo de várias trocas é difícil. A ideia de que a pré-treinamento oferece distribuições de personas e que RLHF influencia a adesão a um papel sugere que a consistência de persona em diálogos extensos ainda é um desafio.

Dicas/Conclusões úteis

- Diálogos com Propósito exigem que avaliadores e equipes de produto olhem para além de métricas de geração única e considerem a qualidade do diálogo ao longo do tempo.

- A memória e a modelagem de usuário devem ser integradas com salvaguardas de privacidade e segurança para uso prático.

- Testes de instrução com diálogos longos ajudam a identificar modos de falha de segurança e orientam melhorias de alinhamento.

- A consistência da persona depende de uma combinação de pré-treinamento e RLHF, e ainda há espaço para técnicas que mantenham o papel ao longo de turnos extensos.

- Técnicas como split-softmax representam caminhos práticos para estabilizar diálogos de longa duração sem sacrificar capacidades linguísticas.

FAQ

- Q: O que é diálogo com Propósito? A: É uma interação multi-turno orientada a alcançar um objetivo específico, em que cada turno contribui para o progresso da tarefa.

- Q: Por que métricas de uma única rodada não são suficientes? A: Em situações reais, as pessoas interagem com IA ao longo de várias etapas, com mudanças de requisitos e necessidade de memória; avaliações de uma única rodada não capturam esse comportamento dinâmico.

- Q: O que é split-softmax, e por que é citado? A: Split-softmax é uma técnica proposta para reduzir a tendência de os transformadores desviarem-se dos prompts do sistema durante diálogos longos, oferecendo uma possível solução para maior estabilidade.

- Q: Como diálogos com Propósito afetam tarefas de codificação? A: Permitem colaboração contínua com engenheiros, clarificando requisitos, solicitando dados ausentes e iterando com input humano, o que pode reduzir defeitos e aumentar a eficiência, semelhante a programação em par.

- Q: Qual o impacto para implantação empresarial? A: Empesas devem considerar avaliações em interações longas com objetivos claros, investir em memória e modelagem de usuário, e tratar questões de privacidade e segurança associadas a assistentes persistentes e adaptáveis.

Referências

- The Gradient article: O que falta aos chatbots LLM: um senso de propósito — https://thegradient.pub/dialog

</INST>``````````</INST>

More news

Como reduzir gargalos do KV Cache com NVIDIA Dynamo

O Dynamo da NVIDIA transfere o KV Cache da memória da GPU para armazenamento de custo mais baixo, permitindo janelas de contexto maiores, maior concorrência e menor custo de inferência em grandes modelos.

Reduzindo a Latência de Cold Start para Inferência de LLM com NVIDIA Run:ai Model Streamer

Análise detalhada de como o NVIDIA Run:ai Model Streamer reduz o tempo de cold-start na inferência de LLMs ao transmitir pesos para a memória da GPU, com benchmarks em GP3, IO2 e S3.

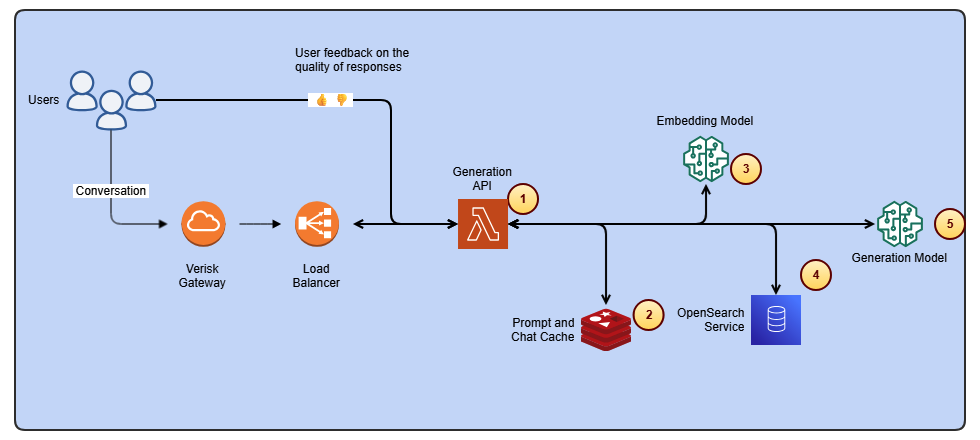

Otimize o acesso a alterações de conteúdo ISO-rating com Verisk Rating Insights e Amazon Bedrock

Verisk Rating Insights, impulsionado pelo Amazon Bedrock, LLMs e RAG, oferece uma interface conversacional para acessar mudanças ERC ISO, reduzindo downloads manuais e aumentando a velocidade e a precisão das informações.

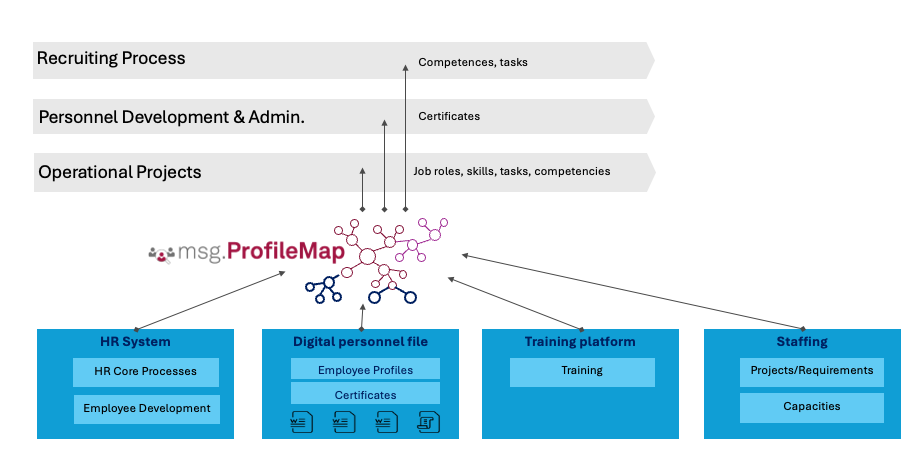

Como a msg otimizou a transformação de RH com Amazon Bedrock e msg.ProfileMap

Este post mostra como a msg automatizou a harmonização de dados para o msg.ProfileMap usando o Amazon Bedrock para alimentar fluxos de enriquecimento de dados alimentados por LLM, elevando a precisão na correspondência de conceitos de RH, reduzindo trabalho manual e alinhando-se ao EU AI Act e ao GD

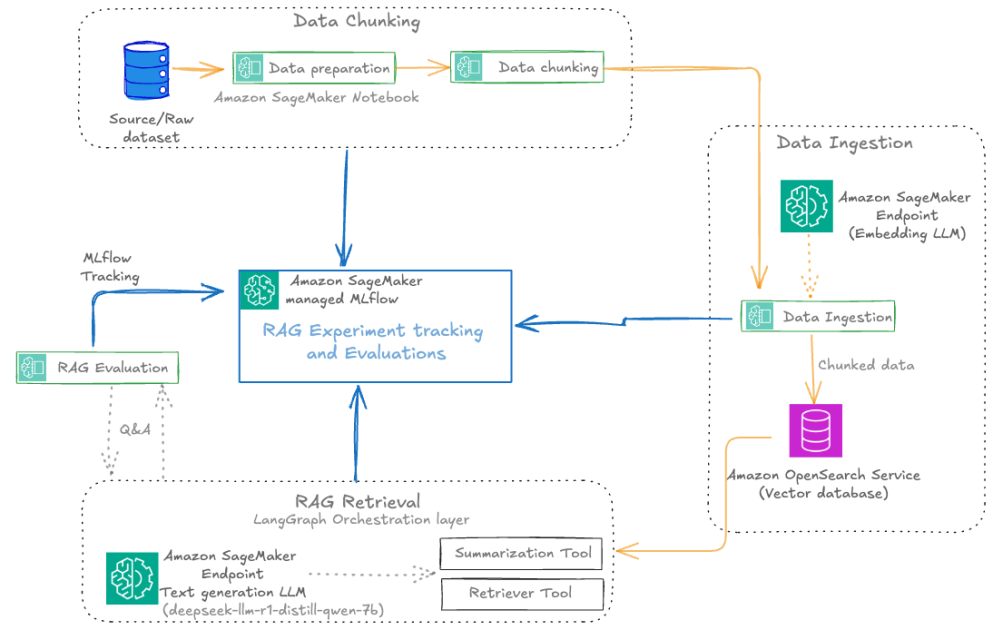

Automatize pipelines RAG avançadas com SageMaker AI da AWS

Aperfeiçoe a experimentação até a produção para Retrieval Augmented Generation (RAG) com SageMaker AI, MLflow e Pipelines, promovendo fluxos reprodutíveis, escaláveis e com governança.

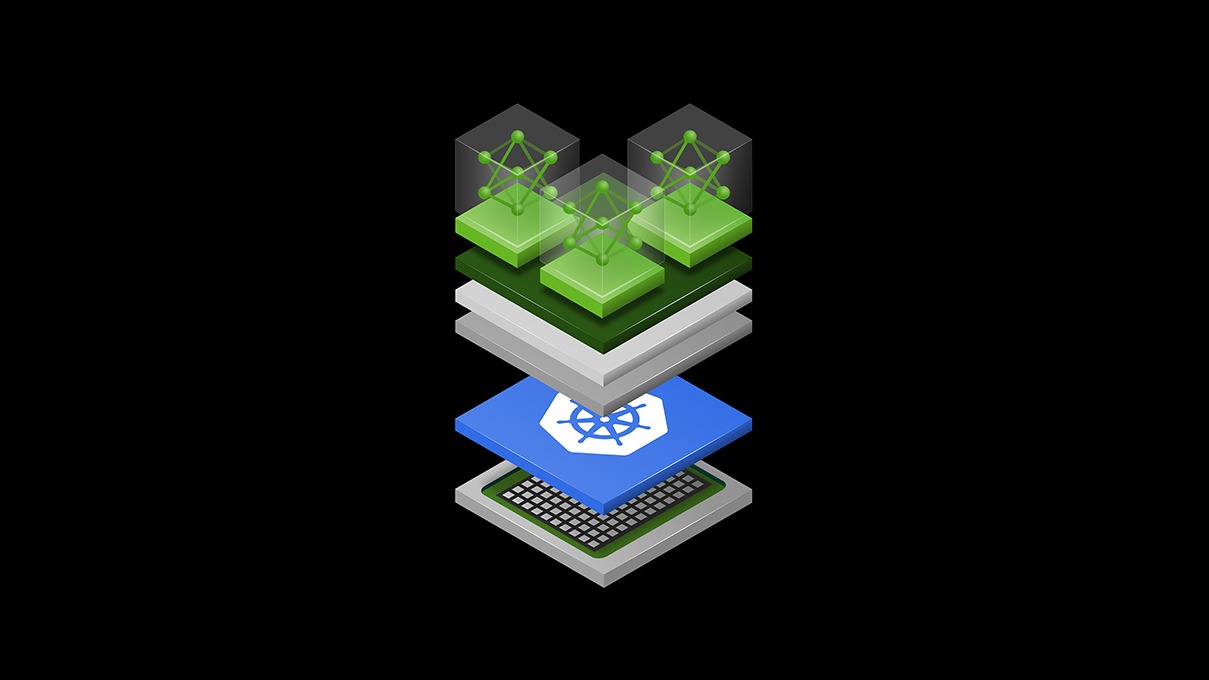

Implante Inferência de IA Escalável com NVIDIA NIM Operator 3.0.0

O NVIDIA NIM Operator 3.0.0 amplia a inferência de IA escalável no Kubernetes, permitindo implantações multi-LLM e multi-nó, integração com KServe e suporte a DRA em modo de tecnologia, com colaboração da Red Hat e NeMo Guardrails.