Créer des flux de travail agentiques avec GPT OSS d’OpenAI sur SageMaker AI et Bedrock AgentCore

Sources: https://aws.amazon.com/blogs/machine-learning/build-agentic-workflows-with-openai-gpt-oss-on-amazon-sagemaker-ai-and-amazon-bedrock-agentcore, https://aws.amazon.com/blogs/machine-learning/build-agentic-workflows-with-openai-gpt-oss-on-amazon-sagemaker-ai-and-amazon-bedrock-agentcore/, AWS ML Blog

TL;DR

- OpenAI a publié deux modèles à poids ouvert, gpt-oss-120b (117B paramètres) et gpt-oss-20b (21B paramètres), tous deux dotés d’une fenêtre de contexte de 128K et d’une architecture MoE creuse.

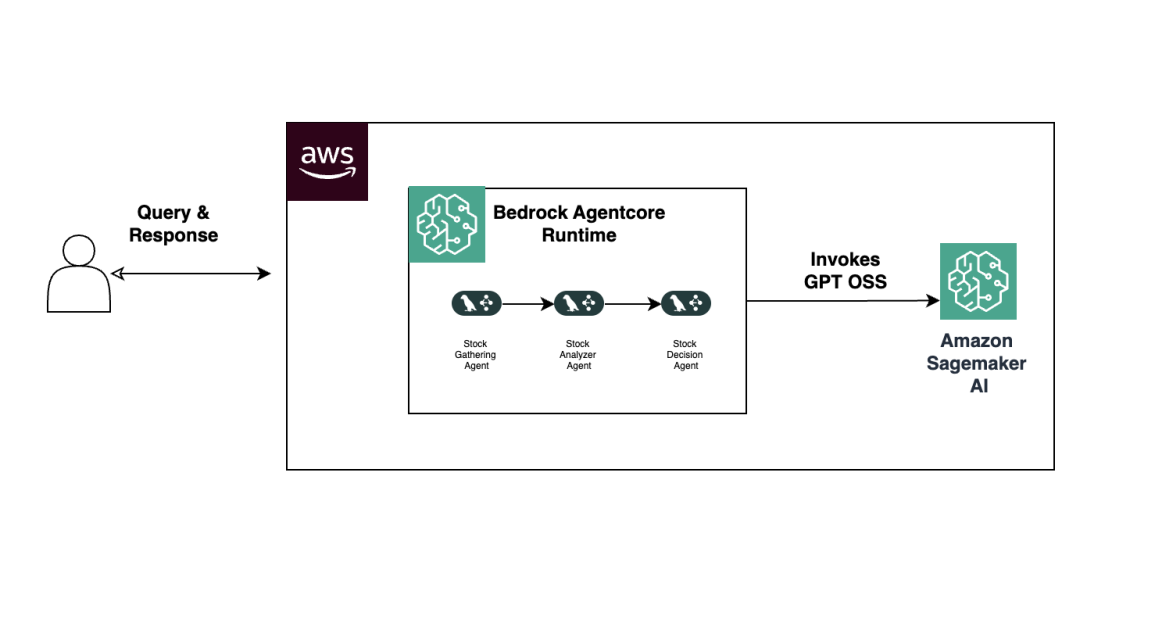

- L’article montre le déploiement de gpt-oss-20b sur des endpoints gérés par SageMaker AI via un conteneur vLLM, puis l’orchestration d’un analyseur d’actions multi-agents avec LangGraph, et le déploiement sur Amazon Bedrock AgentCore Runtime.

- Une architecture à trois agents (Data Gathering Agent, Stock Performance Analyzer Agent, Stock Report Generation Agent) fonctionne dans Bedrock AgentCore, tandis que GPT-OSS gère la compréhension et la génération via SageMaker AI.

- La quantification 4 bits (MXFP4) réduit les poids à 63 Go (120B) ou 14 Go (20B), permettant l’exécution sur un seul GPU H100, avec des options de déploiement incluant BYOC (bring-your-own-container) et un hébergement entièrement géré par SageMaker AI.

- La solution privilégie des systèmes agentiques sans serveur, modulaires et évolutifs avec mémoire persistante et orchestration des flux de travail, ainsi que des étapes claires pour le déploiement, l’invocation et le nettoyage. Reportez-vous au blog AWS pour les détails. Cet article s’appuie sur l’approche décrite par AWS et OpenAI dans leurs documents et démonstrations sur la construction de flux agentiques avec GPT OSS sur SageMaker AI et Bedrock AgentCore. AWS blog

More news

NVIDIA HGX B200 réduit l’intensité des émissions de carbone incorporé

Le HGX B200 de NVIDIA abaisse l’intensité des émissions de carbone incorporé de 24% par rapport au HGX H100, tout en offrant de meilleures performances IA et une efficacité énergétique accrue. Cet article résume les données PCF et les nouveautés matérielles.

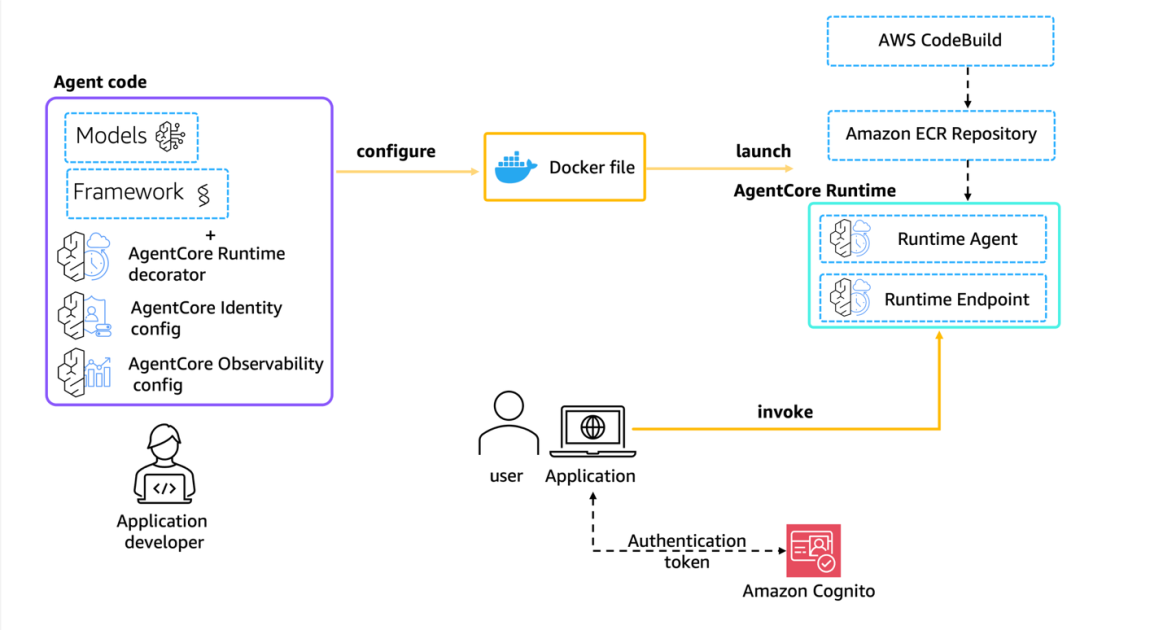

Faire passer vos agents IA du concept à la production avec Amazon Bedrock AgentCore

Une exploration détaillée de la façon dont Amazon Bedrock AgentCore aide à faire passer des applications IA basées sur des agents du proof of concept à des systèmes de production de niveau entreprise, en préservant mémoire, sécurité, observabilité et gestion d’outils à l’échelle.

Scaleway rejoint les Fournisseurs d’Inference de Hugging Face pour une Inférence Serverless et Faible Latence

Scaleway est désormais un Fournisseur d’Inference pris en charge sur Hugging Face Hub, permettant l’inférence serverless directement sur les pages de modèles avec les SDK JS et Python. Accédez à des modèles open-weight populaires et bénéficiez d’une latence réduite.

Prévoir les phénomènes météorologiques extrêmes en quelques minutes sans superordinateur : Huge Ensembles (HENS)

NVIDIA et le Lawrence Berkeley National Laboratory présentent Huge Ensembles (HENS), un outil IA open source qui prévoit des événements météorologiques rares et à fort impact sur 27 000 années de données, avec des options open source ou prêtes à l’emploi.

Comment réduire les goulots d’étranglement KV Cache avec NVIDIA Dynamo

NVIDIA Dynamo déporte le KV Cache depuis la mémoire GPU vers un stockage économique, permettant des contextes plus longs, une meilleure concurrence et des coûts d’inférence réduits pour les grands modèles et les charges AI génératives.

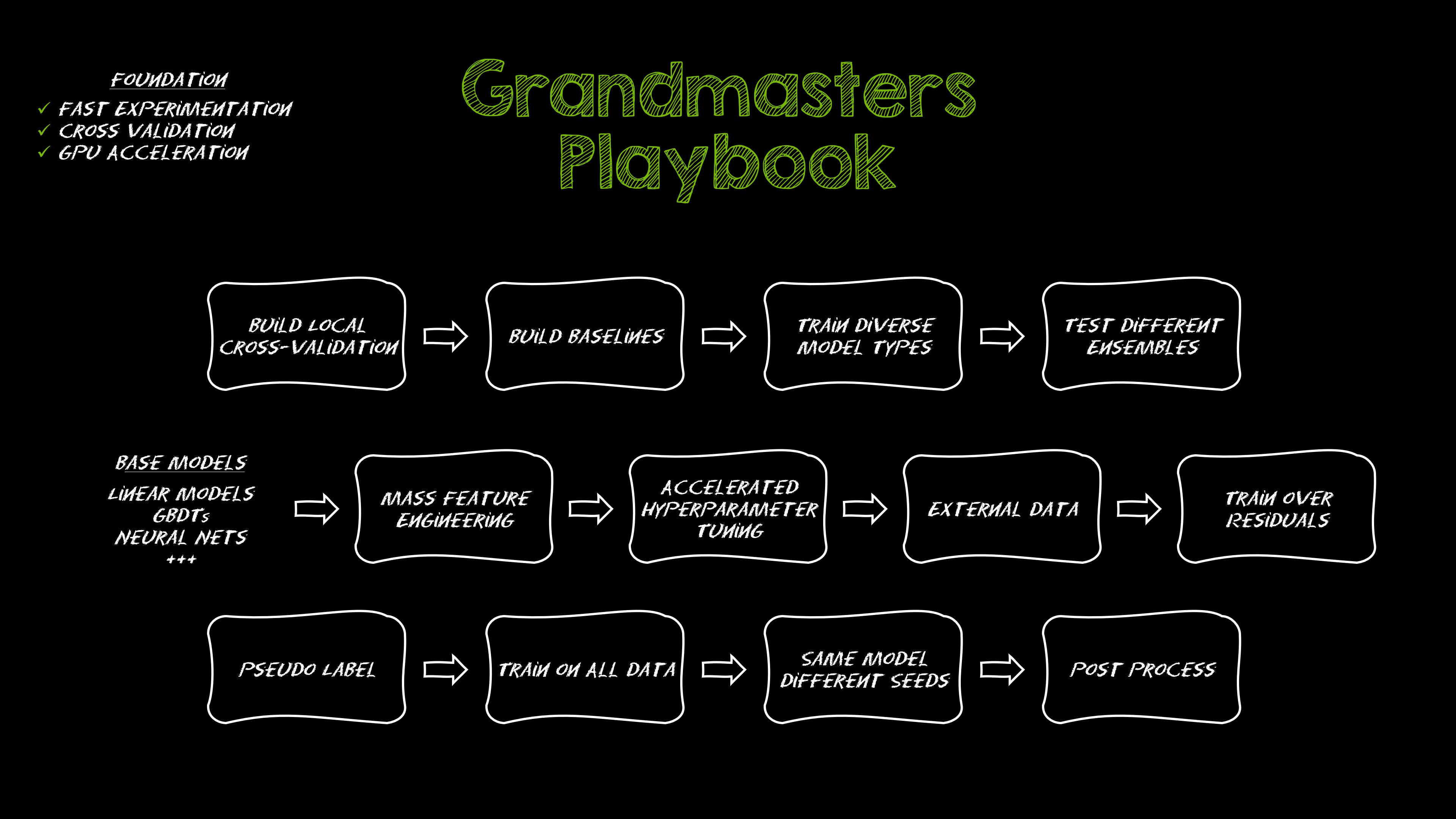

Le Playbook des Grands Maîtres Kaggle: 7 Techniques de Modélisation pour Données Tabulaires

Analyse approfondie de sept techniques éprouvées par les Grands Maîtres Kaggle pour résoudre rapidement des ensembles de données tabulaires à l’aide d’une accélération GPU, des baselines divers à l’assemblage et à la pseudo-étiquetage.