Comment msg a renforcé la transformation RH avec Amazon Bedrock et msg.ProfileMap

Sources: https://aws.amazon.com/blogs/machine-learning/how-msg-enhanced-hr-workforce-transformation-with-amazon-bedrock-and-msg-profilemap, https://aws.amazon.com/blogs/machine-learning/how-msg-enhanced-hr-workforce-transformation-with-amazon-bedrock-and-msg-profilemap/, AWS ML Blog

TL;DR

- msg.ProfileMap utilise Amazon Bedrock pour enrichir semanticellem des données et alimenter des flux d’enrichissement pilotés par LLM.

- L’approche améliore la précision de l’appariement des concepts RH et réduit considérablement le travail manuel, tout en renforçant la conformité à l’EU AI Act et au GDPR.

- L’architecture combine une couche robuste d’extraction de texte, un moteur d’harmonisation basé sur l’IA et une méthode de récupération hybride (vecteur et chaîne) pour aligner les données entre sources.

- Bedrock offre un accès modèle entièrement géré et sans serveur, permettant une inférence à faible latence, une scalabilité et des interactions auditable pour les usages RH.

- Les résultats des benchmarks montrent 95,5% de précision pour les fusions à haute probabilité lors des tests internes, une réduction de plus de 70% du travail de validation manuel et de solides performances dans OAEI 2024 Bio-ML (NCIT-DOID F1 0,918; Hits@1 > 92%).

Contexte et historique

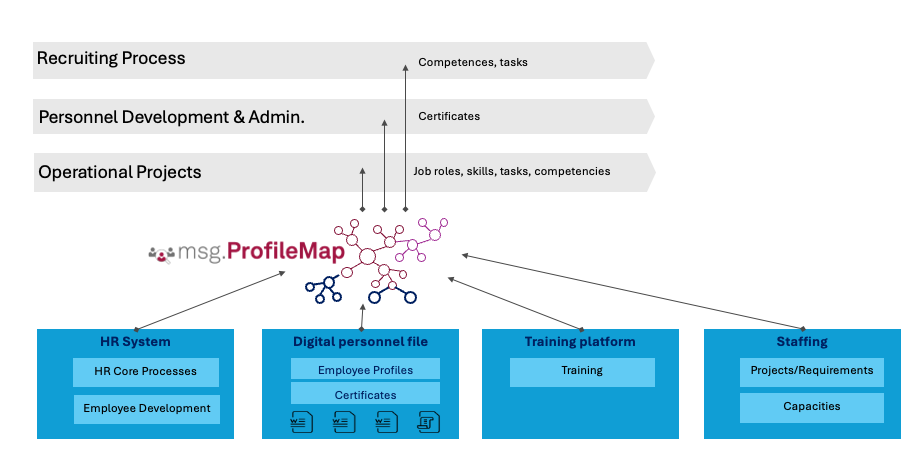

Msg ProfileMap est une solution SaaS cloud pour la gestion des compétences et des savoir-faire, conçue pour aider les équipes RH et stratégie à cartographier les capacités de la main-d’œuvre, identifier les lacunes et mettre en œuvre des plans de développement ciblés. Avec plus de 7 500 utilisateurs et des activités dans plus de 10 000 experts répartis dans 34 pays, msg opère comme éditeur indépendant et intégrateur dans des secteurs hautement réglementés. La solution est qualifiée comme logiciel partenaire AWS et est disponible sur AWS Marketplace. Les équipes RH et stratégie s’appuient sur une vue centralisée des compétences pour dynamiser la mise en correspondance des candidats à des rôles, les opportunités de mobilité interne, l’analyse des écarts de compétences et la planification du développement de la main-d’œuvre. Or, les données RH se trouvent souvent dans des sources et formats variés — bases de données relationnelles, fichiers Excel, documents Word et PDFs — et des identifiants divergents peuvent exister pour des mêmes concepts, ce qui rend nécessaire une harmonisation efficace. Pour relever ce défi, msg a conçu une architecture modulaire adaptée aux scénarios IT. Au cœur de msg.ProfileMap, une couche robuste d’extraction de texte transforme les entrées hétérogènes en données structurées, puis un moteur d’harmonisation piloté par l’IA assure la cohérence entre les sources, évite les duplications et aligne les concepts. L’approche de récupération hybride combine similarité sémantique vectorielle et correspondance par chaîne pour lier les données aux entités existantes. Amazon Bedrock est utilisé pour enrichir les données sur le plan sémantique, améliorant la compatibilité entre sources et la précision des correspondances. Les données extraites et enrichies sont indexées et stockées dans Amazon OpenSearch Service et Amazon DynamoDB pour une récupération rapide. Le cadre est conçu pour être non supervisé et indépendant du domaine, optimisé pour les cas d’usage IT mais démontrant une bonne généralisation dans d’autres domaines. msg.ProfileMap s’appuie sur plusieurs services AWS, notamment Amazon Neptune, Amazon DynamoDB et Amazon Bedrock. Le schéma architectural complet est décrit dans le diagramme de la publication originale. msg a évalué l’efficacité du cadre d’harmonisation des données via des tests internes et des benchmarks externes dans Bio-ML Track d’OAEI, une initiative de recherche UE qui évalue les technologies d’appariement ontologique depuis 2004. Lors des tests internes, le système a traité 2 248 concepts sur plusieurs types de suggestions. Les recommandations de fusion à haute probabilité ont atteint 95,5% de précision, couvrant près de 60% des entrées, et ont permis de réduire le travail de validation manuelle de plus de 70%, améliorant significativement le temps de valeur pour les équipes RH. En OAEI 2024, msg.ProfileMap s’est classé en tête du benchmark Bio-ML, outperformant d’autres systèmes sur plusieurs jeux de données biomédicaux. Sur NCIT-DOID, F1 de 0,918 et Hits@1 > 92% confirment la généralisabilité de l’outil au-delà du domaine RH. Msg s’appuie sur des LLM pour enrichir les données en quasi-temps réel. Ces charges nécessitent une inférence à faible latence, une scalabilité flexible et une simplicité opérationnelle. Bedrock répond à ces besoins en offrant une interface entièrement gérée et sans serveur vers les modèles, sans nécessiter la gestion d’infrastructure ou le déploiement de stacks ML personnalisés. Son modèle de tarification basé sur la consommation s’aligne sur le modèle SaaS de msg, les ressources étant utilisées et facturées uniquement lorsque nécessaire. Bedrock aide aussi msg à répondre aux exigences de conformité sous EU AI Act et GDPR en autorisant des interactions avec des APIs de modèles avec périmètre défini et auditables. L’intégration réussie de Bedrock dans msg.ProfileMap démontre qu’une adoption IA à grande échelle ne nécessite pas une infrastructure complexe ni l’entraînement de modèles. En combinant conception modulaire, harmonisation fondée sur des ontologies et les capacités LLM entièrement gérées de Bedrock, msg a livré une plateforme d’intelligence de la main-d’œuvre alimentée par IA, précise, évolutive et conforme. Msg.ProfileMap est disponible en SaaS sur AWS Marketplace. Pour en savoir plus, contactez [email protected]. Le contenu et les opinions de ce billet reflètent les auteurs, et AWS n’est pas responsable du contenu. Stefan Walter est Vice-président Senior des solutions IA SaaS chez msg, et dirige des initiatives d’innovation SaaS évolutives. Gianluca Vegetti est Architecte Principal d’Entreprise chez AWS Partner Organization, et Yuriy Bezsonov est Architecte de Solutions Senior chez AWS.

Nouvelles importantes

L’intégration d’Amazon Bedrock dans msg.ProfileMap constitue la principale avancée, en fournissant l’accès à des modèles de base gérés pour l’enrichissement des données via LLM. Bedrock permet une inférence à faible latence et sans gestion d’infrastructure, ce qui simplifie l’intégration et améliore l’adaptabilité face à la demande croissante des clients. En parallèle, l’architecture demeure modulaire et axée sur l’harmonisation fondée sur l’ontologie, renforçant la précision des correspondances et la conformité.

Pourquoi cela compte (impact pour les développeurs/entreprises)

- La qualité des données est essentielle pour le recrutement, la mobilité interne, l’analyse des lacunes de compétences et le plan de développement de la main-d’œuvre. L’automatisation de l’harmonisation réduit les erreurs et accélère les flux RH.

- L’approche modulaire démontre qu’une solution non limitée à un seul domaine peut évoluer avec les besoins clients, Bedrock offrant une inférence à faible latence et une scalabilité élastique, tandis que le modèle SaaS ajuste les coûts en fonction de l’utilisation.

- La conformité est renforcée grâce à des interactions avec des APIs de modèles définies et auditable, ce qui est crucial pour répondre au EU AI Act et au GDPR lors de traitements de données sensibles en RH.

- Les résultats de benchmarks montrent une performance robuste, tant en tests internes qu’en benchmarks externes d’alignement d’ontologies, indiquant une généralisabilité et une fiabilité élevées.

Détails techniques ou Mise en œuvre

| Composant | But | Service AWS |---|---|---| | Couche d’extraction de texte | Convertir les entrées hétérogènes en données structurées | — | Moteur d’harmonisation IA | Assurer la cohérence, éviter les doublons, aligner les concepts | — | Récupération hybride | Combiner similarité sémantique vectorielle et correspondance par chaîne | — | Enrichissement | Enrichissement sémantique via LLM | Amazon Bedrock |Stockage/Indexation | Recherche rapide et stockage durable | Amazon OpenSearch Service; Amazon DynamoDB |Graphes et relations | Gérer entités et liens complexes | Amazon Neptune | msg.ProfileMap est conçu comme une solution SaaS axée sur l’utilisateur et adaptable à d’autres domaines, pas uniquement RH et IT. Le flux de données décrit montre comment les entrées passent par l’extraction de texte, puis l’harmonisation IA avec récupération hybride, l’enrichissement par Bedrock, et les résultats qui sont ensuite indexés pour une recherche rapide et une utilisation en aval.

Performances et benchmarks

- Tests internes sur des concepts IT: 2 248 concepts traités; 95,5% de précision pour les fusions à haute probabilité; réduction du travail de validation manuelle > 70%. Ces résultats accélèrent la valeur ajoutée pour les équipes RH.

- Benchmark externe: OAEI 2024 Bio-ML Track, performance de premier plan sur plusieurs jeux de données biomédicaux; NCIT-DOID F1 = 0,918; Hits@1 > 92%, confirmant la généralisabilité au-delà du domaine RH.

Points clés

- L’automatisation de l’harmonisation des données avec enrichissement LLM via Bedrock améliore la précision des concepts RH et réduit l’effort manuel.

- Une approche de récupération hybride soutient la cohérence intersources et diminue les duplications.

- L’accès géré et sans serveur à Bedrock simplifie l’intégration, offre une scalabilité et permet des interactions auditable pour la conformité.

- Le cadre est conçu pour être indépendant du domaine et peut être adapté à d’autres cas d’utilisation d’harmonisation de données en entreprise.

- Les benchmarks démontrent de solides performances aussi bien dans les tests internes que dans les benchmarks d’alignement d’ontologies, renforçant la robustesse de la plateforme.

FAQ

Références

More news

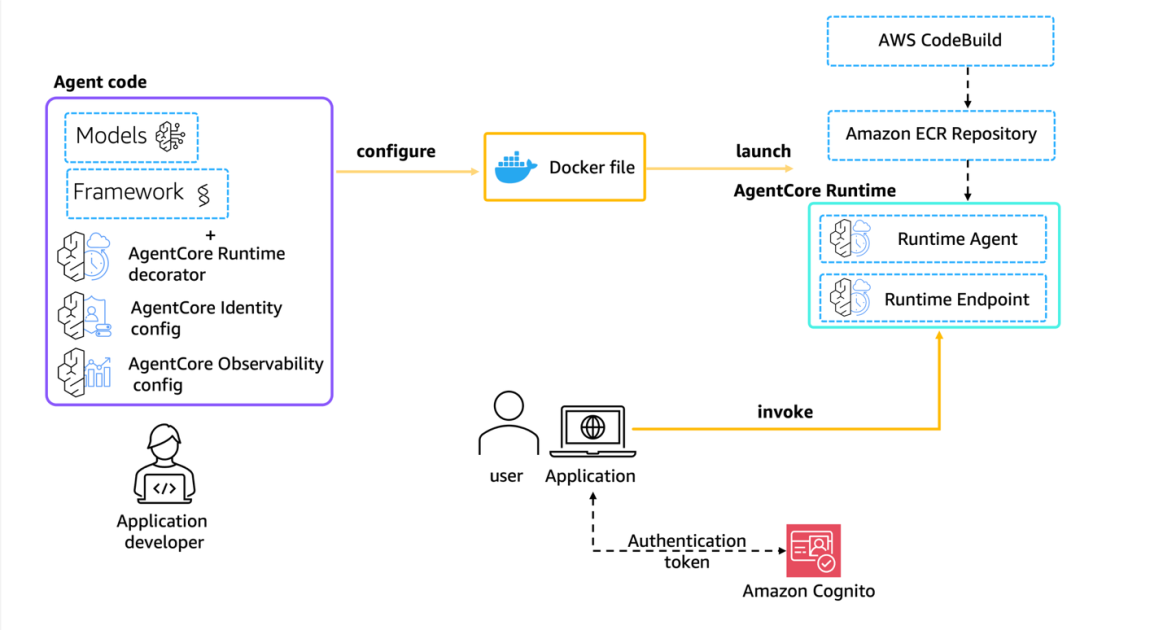

Faire passer vos agents IA du concept à la production avec Amazon Bedrock AgentCore

Une exploration détaillée de la façon dont Amazon Bedrock AgentCore aide à faire passer des applications IA basées sur des agents du proof of concept à des systèmes de production de niveau entreprise, en préservant mémoire, sécurité, observabilité et gestion d’outils à l’échelle.

Comment réduire les goulots d’étranglement KV Cache avec NVIDIA Dynamo

NVIDIA Dynamo déporte le KV Cache depuis la mémoire GPU vers un stockage économique, permettant des contextes plus longs, une meilleure concurrence et des coûts d’inférence réduits pour les grands modèles et les charges AI génératives.

Surveiller l’inférence par lot Bedrock d’AWS via les métriques CloudWatch

Apprenez à surveiller et optimiser les jobs d’inférence par lot Bedrock via CloudWatch, with alertes et tableaux de bord pour améliorer les performances, les coûts et l’exploitation.

Prompting pour la précision avec Stability AI Image Services sur Amazon Bedrock

Bedrock intègre Stability AI Image Services avec neuf outils pour créer et modifier des images avec précision. Apprenez les techniques de prompting adaptées à l’entreprise.

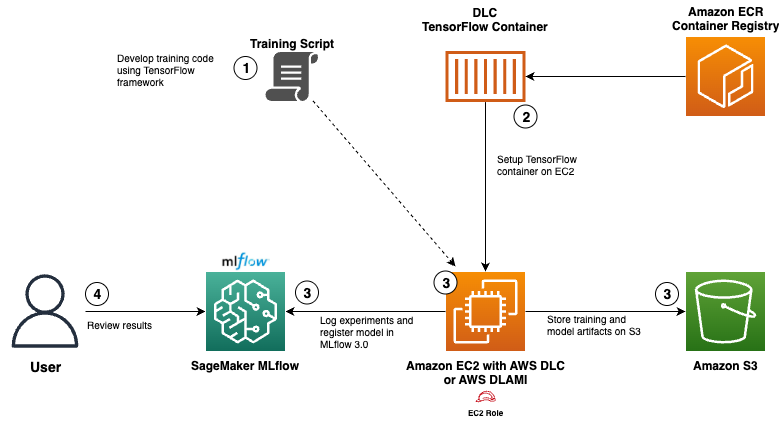

Utiliser les AWS Deep Learning Containers avec SageMaker AI géré MLflow

Découvrez comment les AWS Deep Learning Containers (DLCs) s’intègrent à SageMaker AI géré par MLflow pour équilibrer le contrôle de l’infrastructure et une gouvernance ML robuste. Un flux TensorFlow pour la prédiction de l’âge des abalones illustre le suivi de bout en bout et la traçabilité des modè

Évoluer la production visuelle avec Stability AI Image Services dans Amazon Bedrock

Stability AI Image Services est désormais disponible dans Amazon Bedrock, offrant des capacités d’édition d’images prêtes à l’emploi via l’API Bedrock et étendant les modèles Stable Diffusion 3.5 et Stable Image Core/Ultra déjà présents.