Réinventer la Factorisation Non Négative par des Représentations Neurales Implicites pour des Transformées Audio Irrégulières

Sources: https://machinelearning.apple.com/research/rethinking-non-negative, machinelearning.apple.com

TL;DR

- Des chercheurs d’Apple réforment la Factorisation Non Négative de Matrice (NMF) en des fonctions apprenables pour permettre son utilisation avec des représentations temps-fréquence irrégulières en audio, comme les transformées Constant-Q et les ondelettes. source

- Le NMF traditionnel opère sur des matrices; les représentations irrégulières ne peuvent pas être stockées directement sous forme de matrice, limitant les applications.

- Cette approche étend le NMF à une catégorie plus large de signaux qui ne nécessitent pas d’échantillonnage régulier, en utilisant des représentations neuronales implicites.

- Le travail a été accepté au WASPAA 2025 (IEEE).

Contexte et arrière-plan

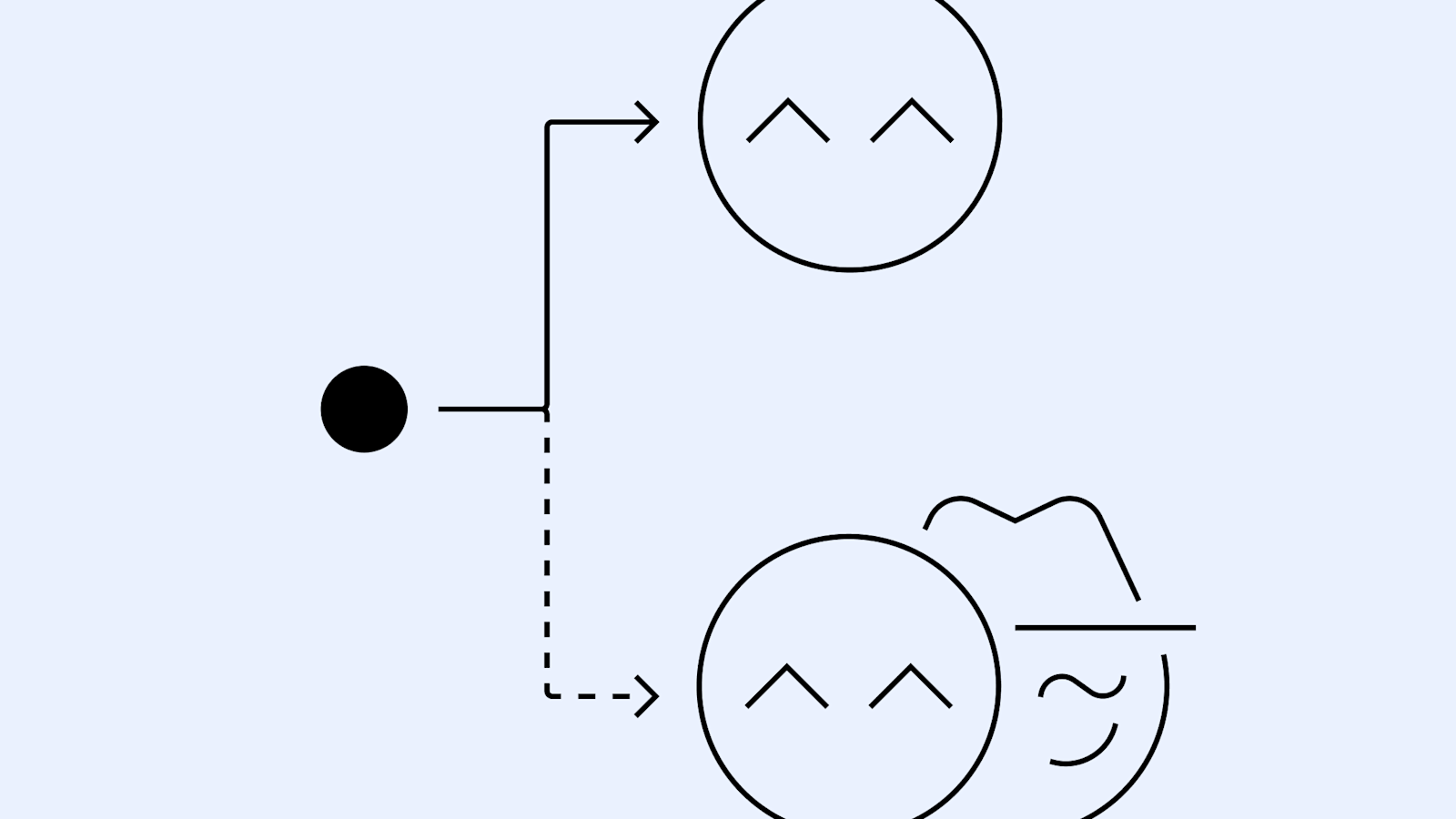

Le NMF est une technique puissante pour l’analyse de données échantillonnées régulièrement, c’est-à-dire des données qui peuvent être stockées dans une matrice. Pour l’audio, cela a conduit à de nombreuses applications utilisant des représentations temps-fréquence comme la Transformée de Fourier à court terme (STFT). Cependant, étendre ces applications à des représentations TF irrégulièrement échantillonnées, comme la transformée Constant-Q, les ondelettes ou les modèles d’analyse sinusoïdaux, n’a pas été possible car ces représentations ne peuvent pas être stockées directement sous forme matricielle. Dans cet article, nous formulons le NMF en termes de fonctions apprenables (au lieu de vecteurs) et démontrons que le NMF peut être étendu à une plus grande variété de classes de signaux qui n’exigent pas un échantillonnage régulier.

Quoi de neuf

L’apport majeur est de formuler le NMF en termes de fonctions apprenables—des représentations neurales implicites—plutôt que des vecteurs fixes de dimension finie. Cette reformulation rend possible l’application du NMF à des représentations TF irrégulières qui ne peuvent pas être stockées comme une matrice, comme les transformées Constant-Q, les ondelettes ou les modèles d’analyse sinusoïdale. En procédant ainsi, le NMF peut être étendu à une plus grande variété de classes de signaux qui ne nécessitent pas d’échantillonnage régulier.

Pourquoi c’est important (impact pour les développeurs et les entreprises)

Pour les développeurs et ingénieurs travaillant sur l’analyse audio, ce travail élargit le champ d’application des méthodes basées sur le NMF. En supprimant l’exigence que la représentation TF soit stockable sous forme de matrice, les praticiens peuvent envisager des transformations irrégulières qui captent potentiellement des structures perceptuelles pertinentes ou conviennent à des domaines d’application spécifiques. Cette expansion peut influencer la conception des pipelines d’analyse audio et des interprétations basées sur des modèles, ouvrant la voie à de nouvelles décompositions de signaux autrefois inaccessibles avec le NMF standard.

Détails techniques ou Mise en œuvre

L’idée centrale est de remplacer les matrices de facteurs (comme dans le NMF classique) par des fonctions apprenables qui mappent des indices — tels que les coordonnées temps-fréquence ou d’autres descripteurs du signal — en valeurs non négatives. Ces fonctions sont paramétrées (par exemple par des réseaux neuronaux) et entraînées pour approximer le produit de composants non négatifs qui reconstruisent les données observées sous une contrainte de non-négativité. Comme les représentations sont implicites et non liées à une matrice fixe, des schémas d’échantillonnage irréguliers comme le Constant-Q, les ondelettes ou les modèles sinusoïdaux peuvent être intégrés directement dans le processus de factorisation. Cette approche conserve l’esprit du NMF — décomposer les données en parties additives et interprétables — tout en assouplissant l’exigence que la représentation sous-jacente soit une matrice.

Points à retenir

- Le NMF peut être étendu au-delà des grilles régulières via des représentations neurales implicites.

- Les représentations TF irrégulières deviennent accessibles à l’analyse fondée sur les facteurs.

- La méthode préserve la non-négativité et la décomposition additive tout en adoptant des facteurs apprenables et continus.

- Ce travail ouvre de nouvelles voies pour la recherche et la pratique du traitement audio sur des transformées non traditionnelles.

FAQ

-

Quel problème ce papier aborde-t-il ?

Étendre le NMF à des représentations TF irrégulières qui ne peuvent pas être stockées sous forme matricielle.

-

uelle est l’idée centrale ?

Formuler le NMF en termes de fonctions apprenables (représentations neuronales implicites) plutôt que de vecteurs fixes.

-

uelles représentations sont considérées ?

Des représentations TF irrégulières telles que la transformée Constant-Q, les ondelettes ou les modèles d’analyse sinusoïdale.

-

Où ce travail a-t-il été présenté ?

ccepté au WASPAA 2025 (IEEE).

Références

More news

Shadow Leak montre comment les agents ChatGPT peuvent exfiltrer des données Gmail via injection de prompt

Des chercheurs en sécurité ont démontré une attaque par injection de prompt baptisée Shadow Leak, utilisant Deep Research de ChatGPT pour exfiltrer discrètement des données d'une boîte Gmail. OpenAI a corrigé la faille; l'affaire illustre les risques des IA agentisées.

Détection et réduction de scheming dans les modèles d IA : progrès, méthodes et implications

OpenAI et Apollo Research ont évalué le désalignement caché dans des modèles de frontière, observé des comportements de scheming et testé une méthode d’alignement délibératif qui a réduit les actions covertes d’environ 30x, tout en reconnaissant des limites et des travaux en cours.

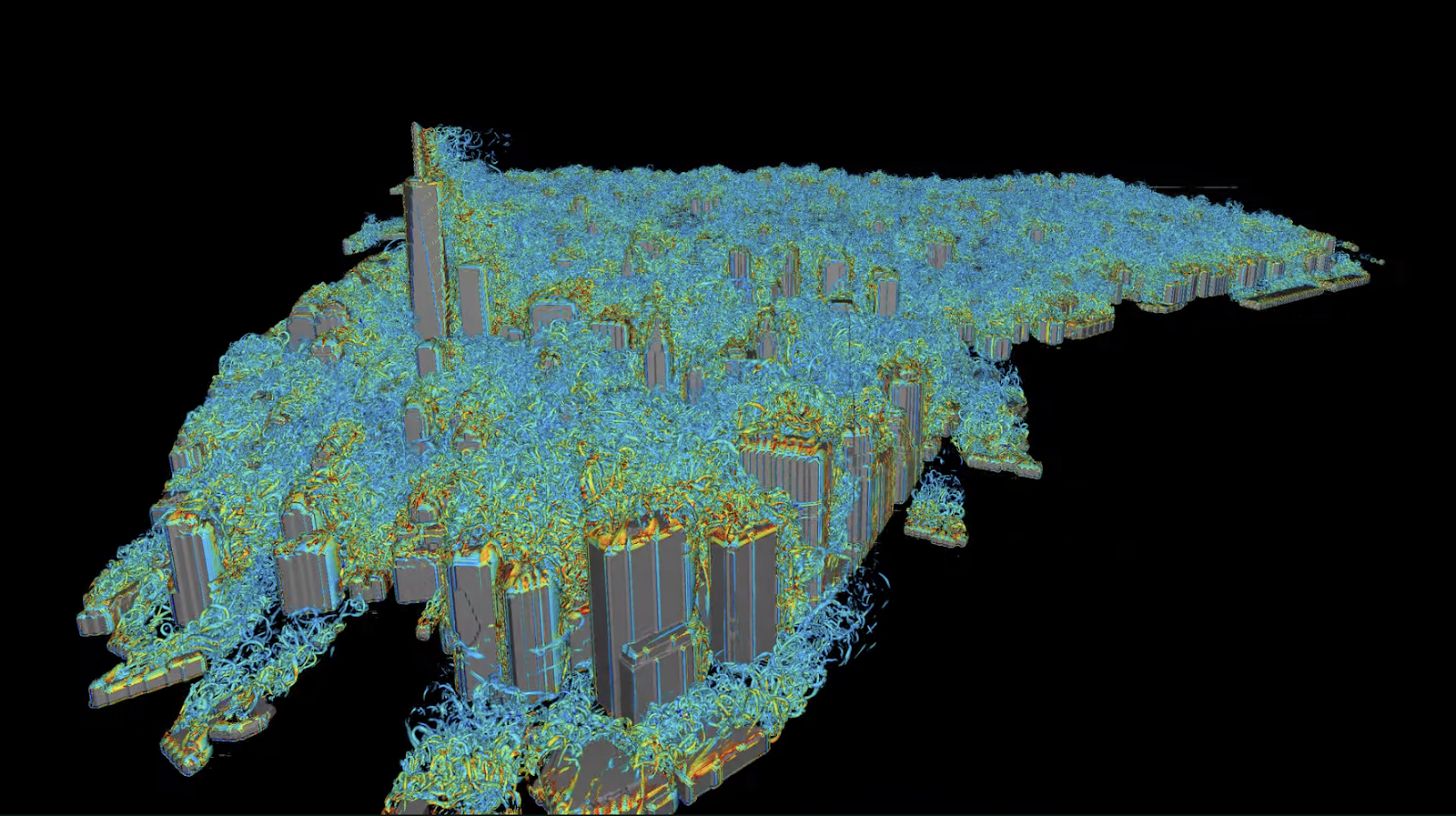

Autodesk Research mène la CFD à vitesse Warp sur le NVIDIA GH200

Autodesk Research, Warp de NVIDIA et le GH200 démontrent une CFD Python-native avec XLB, atteignant environ 8x de vitesse et évoluant jusqu’à 50 milliards de cellules.

Interférences dans l’espace d’outils à l’ère MCP : concevoir pour la compatibilité des agents à grande échelle

Microsoft Research examine les interférences dans l’espace d’outils à l’ère MCP et décrit les considérations de conception pour une compatibilité des agents à l’échelle, avec Magentic-UI comme exemple illustratif.

RenderFormer: How neural networks are reshaping 3D rendering

RenderFormer, from Microsoft Research, is the first model to show that a neural network can learn a complete graphics rendering pipeline. It’s designed to support full-featured 3D rendering using only machine learning—no traditional graphics computation required. The post RenderFormer: How neural ne

Briser le mur du réseau dans l’infrastructure IA

Microsoft Research présente MOSAIC, un interconnect optique basé sur des microLEDs destiné à surmonter les limites de mémoire et réseau des centres de données, avec le potentiel de transformer les architectures de clusters IA.