Envision et Solos lancent Ally Solos Glasses : lunettes intelligentes alimentées par l’IA pour mal-voyants

Sources: https://www.theverge.com/news/759160/ally-solos-smart-glasses-ai-envision-low-vision, theverge.com

TL;DR

- Envision et Solos annoncent les Ally Solos Glasses, une paire de lunettes intelligentes destinées aux personnes aveugles et malvoyantes.

- Les lunettes équipées d’une caméra utilisent Ally AI d’Envision pour lire et traduire du texte, décrire l’environnement, rechercher sur le Web et reconnaître des personnes, des objets et des panneaux, avec un son en ouverture d’oreille dans les branches.

- Précommande à 399 USD (tarif de lancement spécial, réduit de 699 USD); expédition prévue en octobre 2025. Montures en deux tailles — régulière et grande — et couleurs noir, gris et brun.

- Ces lunettes s’appuient sur la gamme AirGo Vision et se connectent à l’application Ally iOS ou Android via Bluetooth, avec une certification IP67 et une autonomie allant jusqu’à 16 heures en utilisation active.

Contexte et antécédents

La société axée sur l’accessibilité, Envision, s’est associée à Solos pour livrer une nouvelle paire de lunettes intelligentes destinées aux personnes aveugles ou malvoyantes. Les Ally Solos Glasses étendent l’approche IA d’Envision en ajoutant une caméra qui interprète le monde et transmet l’information à l’utilisateur. Le projet s’appuie sur la plateforme AirGo Vision de Solos et remplace le modèle GPT-4o par Ally AI. L’écosystème autour de ces appareils s’étoffe à mesure que les marques explorent des solutions de vision assistée par IA. The Verge indique que Ally combine plusieurs fondations IA pour prendre en charge ses fonctions. The Verge.

Nouveautés

Les Ally Solos Glasses sont décrites comme des lunettes équipées d’une caméra qui, via Ally AI, décrivent le monde, lisent et traduisent le texte, et reconnaissent les personnes, objets et panneaux. L’utilisateur reçoit les informations par le biais d’enceintes en oreille ouvertes intégrées aux branches, permettant de rester conscient de l’environnement. La précommande est lancée à 399 USD (tarif spécial de lancement, au lieu de 699 USD), avec expédition prévue en octobre 2025. Les montures existent en deux tailles — régulière et grande — et en noir, gris et brun. Ces lunettes s’appuient sur les AirGo Vision lancées en décembre; elles offrent leurs propres capacités de reconnaissance visuelle via le GPT-4o. En revanche, Ally utilise Ally AI, alimenté par une combinaison de modèles de fondation tels que Meta’s Llama, OpenAI’s ChatGPT, Google’s Gemini et Perplexity, selon la page produit d’Ally. Les fonctions IA se connectent à l’application Ally pour iOS ou Android via Bluetooth, permettant une expérience fluide entre le matériel et le logiciel.

Pourquoi c’est important (impact pour les développeurs/entreprises)

Pour les développeurs et les entreprises axés sur l’accessibilité, les Ally Solos Glasses illustrent comment une stack IA multi-modèles peut soutenir l’interprétation en temps réel d’une vision dans une forme portable. Capacité à lire et traduire le texte, décrire l’environnement, identifier des personnes et des objets, et effectuer des recherches web peut faciliter les tâches quotidiennes pour les utilisateurs souffrant d’un handicap visuel. L’approche audio ouverte aide à maintenir la conscience de l’environnement, ce qui est crucial dans les situations réelles. Bien que le prix soit un facteur, à 399 USD, ce produit se positionne comme une option premium alors que des rivaux plus économes existent—AirGo Vision à 299 USD et mention de Ray-Ban Meta—mais il n’est pas clair comment Ally se compare en termes de capacités.

Détails techniques ou Mise en œuvre

Spécifications et implémentations telles que décrites : | Élément | Détails

| --- |

|---|

| Architecture IA |

| Connectivité |

| Base matérielle |

| Résistance |

| Batterie et chargement |

| Disponibilité et prix |

| Options physiques |

| Produit précédent |

En résumé

- Les Ally Solos Glasses montrent une IA de vision augmentée intégrée à des lunettes d’assistance pour malvoyants.

- L’audio ouvert et la connectivité via Bluetooth avec une application mobile offrent une expérience pratique au quotidien.

- Le prix de lancement place ce produit dans une catégorie premium, avec des rivaux plus abordables comme AirGo Vision à 299 USD; l’écosystème Ally est encore en évolution pour évaluer les performances relatives.

- La conception multi-modèles d’IA reflète une stratégie visant à fournir des capacités avancées sans s’appuyer sur un seul moteur IA.

FAQ

- Q : À quoi servent les Ally Solos Glasses ? A : Ce sont des lunettes assistives pour aveugles et malvoyants, utilisant l’IA pour lire le texte, décrire l’environnement, traduire, reconnaître des personnes et des objets et effectuer des recherches Web, avec un son en oreille ouverte.

- Q : Qui alimente l’IA Ally à l’intérieur des lunettes ? A : Ally AI s’appuie sur une combinaison de modèles de fondation (Meta Llama, OpenAI ChatGPT, Google Gemini, Perplexity).

- Q : Quel est le prix et la date d’expédition ? A : Précommande à 399 USD, expédition prévue en octobre 2025.

- Q : Comment les lunettes se connectent-elles aux appareils ? A : Via Bluetooth à l’application Ally sur iOS/Android.

Références

- Article du Verge détaillant les Ally Solos Glasses et Ally AI d’Envision : https://www.theverge.com/news/759160/ally-solos-smart-glasses-ai-envision-low-vision

More news

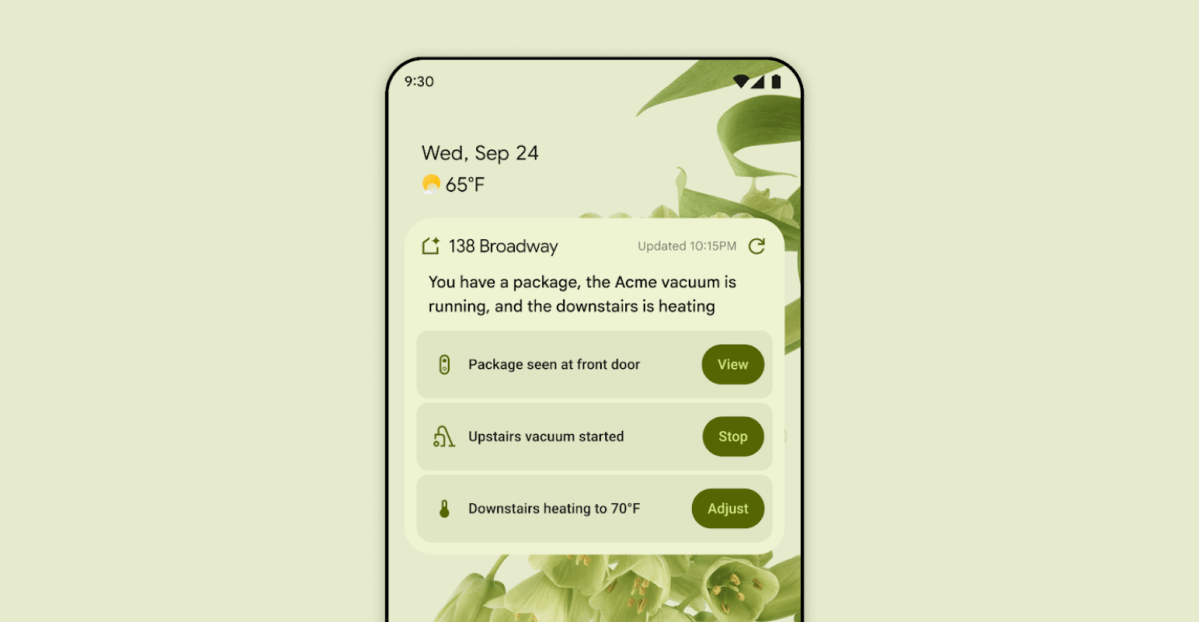

Premier aperçu de l'app Google Home propulsée par Gemini

The Verge rapporte que Google met Gemini dans l'application Google Home avec une refonte majeure et la nouvelle fonction 'Ask Home'.

Shadow Leak montre comment les agents ChatGPT peuvent exfiltrer des données Gmail via injection de prompt

Des chercheurs en sécurité ont démontré une attaque par injection de prompt baptisée Shadow Leak, utilisant Deep Research de ChatGPT pour exfiltrer discrètement des données d'une boîte Gmail. OpenAI a corrigé la faille; l'affaire illustre les risques des IA agentisées.

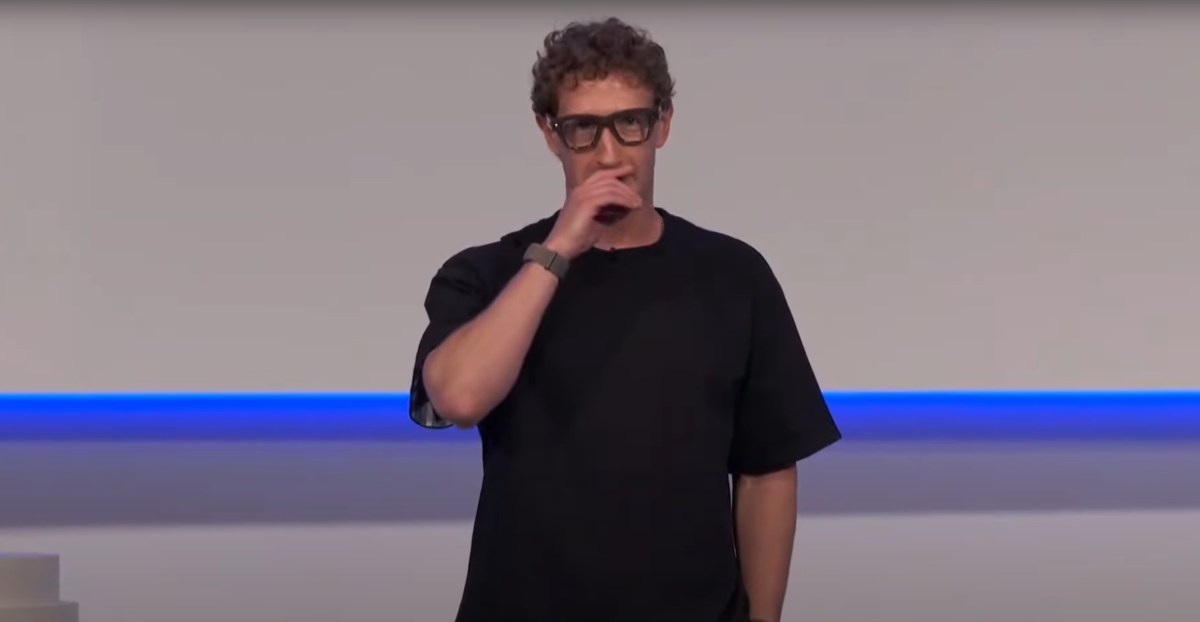

Les démonstrations ratées des lunettes intelligentes Live AI de Meta n’avaient rien à voir avec le Wi‑Fi, affirme le CTO

Les démonstrations en direct des lunettes Ray‑Ban avec Live AI de Meta ont connu des échecs embarrassants. Le CTO Andrew Bosworth explique les causes, dont un trafic auto-imposé et un bug rare d’appel vidéo, et précise que le bug est corrigé.

OpenAI envisagerait un haut-parleur intelligent, des lunettes, un enregistreur vocal et un pin avec Jony Ive

OpenAI explorerait une famille d'appareils IA avec l'ancien chef du design d'Apple, Jony Ive, incluant un haut-parleur sans écran, des lunettes intelligentes, un enregistreur vocal et un pin portable, avec une sortie visée fin 2026 ou début 2027.

Comment les chatbots et leurs créateurs alimentent la psychose liée à l’IA

Analyse de la psychose liée à l’IA, de la sécurité des adolescents et des questions juridiques à mesure que les chatbots se multiplient, selon les reportages de Kashmir Hill pour The Verge.

Google étend Gemini dans Chrome avec un déploiement multiplateforme et sans abonnement

Gemini IA dans Chrome accède aux onglets, à l’historique et aux propriétés Google, déployé sur Mac et Windows aux États-Unis sans frais, avec automatisation des tâches et intégrations Workspace.