Anthropic étend la fenêtre de contexte à 1 million de jetons dans la course IA de codage

Sources: https://www.theverge.com/ai-artificial-intelligence/757998/anthropic-just-made-its-latest-move-in-the-ai-coding-wars, theverge.com

TL;DR

- Claude Sonnet 4 dispose désormais d’une fenêtre de contexte de 1 000 000 de jetons (x5).

- Capacité étendue pour analyser des dizaines de papiers et des centaines de documents, ainsi que des bases de code de 75 000 à 110 000 lignes.

- Disponibilité dès aujourd’hui pour les clients Tier 4 et les limites de taux personnalisées; déploiement plus large dans les prochaines semaines.

- Cette évolution alimente la compétition dans l’IA spécialisée en codage avec OpenAI (GPT-4.1 et GPT-5) et résulte des mises à jour antérieures comme Opus 4 et Sonnet 4.

Contexte et arrière-plan

La guerre de l’IA axée sur le codage se joue en grande partie sur la fenêtre de contexte — la quantité de texte que peut prendre en charge un modèle lors de la génération d’une réponse. Mesurée en jetons, une fenêtre plus grande permet au modèle de traiter des tâches plus longues sans avoir à découper le problème. Anthropic annonce une augmentation par 5 de la fenêtre de contexte pour Claude Sonnet 4, pour atteindre 1 000 000 de jetons. Cette étape situe Anthropic dans un paysage compétitif avec des acteurs comme OpenAI et Google, qui misent tous deux sur des capacités de mémoire étendue pour les usages professionnels. OpenAI avait déjà proposé une fenêtre équivalente avec le GPT-4.1 en avril, ce qui renforce la pression concurrentielle sur les capacités de codage destinées aux entreprises. The Verge. Brad Abrams, chef de produit pour Claude, décrit ce développement comme une réponse à une barrière clé rencontrée par les clients: avec un million de jetons, le modèle peut gérer l’ensemble du contexte sans que les utilisateurs aient à scinder le problème. Il précise que Sonnet 4 peut désormais traiter des bases de code comprises entre 75 000 et 110 000 lignes, contre environ 20 000 lignes auparavant. Cette capacité se traduit aussi par la possibilité de traiter environ 2 500 pages de texte, War and Peace étant cité comme exemple pouvant tenir dans le contexte. The Verge. L’évolution survient alors que OpenAI a récemment lancé GPT-5 pour renforcer ses benchmarks en codage, accentuant la pression sur le marché côté entreprise. Anthropic souligne que les clients professionnels sont particulièrement intéressés par ces améliorations et prêts à investir pour accéder à ces capacités à grande échelle. The Verge.

Quoi de neuf

Anthropic annonce une augmentation par 5 de la fenêtre de contexte pour Claude Sonnet 4, portant la capacité à 1 000 000 de jetons. Ce saut représente une amélioration significative par rapport à la fenêtre précédente de 200 000 jetons. Cette mise à niveau permet d’analyser des dizaines de papiers ou des centaines de documents dans une seule requête API, selon Anthropic. Concrètement, l’entreprise indique que la nouvelle fenêtre peut gérer des bases de code entre 75 000 et 110 000 lignes, contre environ 20 000 lignes auparavant. En termes simples, environ 2 500 pages de texte peuvent tenir dans le contexte, et War and Peace peut y être entièrement contenu. L’outil est surtout utile pour les équipes travaillant sur des ensembles de données volumineux ou des projets de codage complexes, où le maintien du contexte est crucial. Brad Abrams affirme que cette amélioration répond à un besoin client critique et permet de traiter les problématiques dans leur intégralité sans fragmentation. L’accès à la nouvelle fenêtre est disponible dès aujourd’hui dans l’API d’Anthropic pour certains clients — Tier 4 et limites de taux personnalisées — et une disponibilité plus large suivra dans les semaines à venir. The Verge. La mise à jour s’inscrit dans un contexte de concurrence accrue, avec la OpenAI qui a lancé GPT-5 et des benchmarks de codage en tête. The Verge précise que le secteur est axé sur les clients professionnels, qui constituent une source de revenus essentielle et soutiennent les investissements continus en développement. The Verge.

Pourquoi c’est important (impact pour les développeurs/entreprises)

Une fenêtre de contexte plus large réduit le besoin de découper les entrées pour des projets volumineux et peut faciliter les flux de travail autour du codage et de l’analyse documentaire. Les clients dans les secteurs du codage, pharmaceutique, vente au détail, services professionnels et juridique manifestent un intérêt marqué pour cette amélioration, ce qui reflète une demande pour des outils capables de traiter des ensembles de données et des documents plus importants sans perte de cohérence contextuelle. L’attrait pour les capacités à grande échelle s’accompagne d’un engagement financier plus fort des clients entreprises, un facteur clé pour les startups IA comme Anthropic dans un paysage de financement et de déploiement. The Verge. L’accélération des livraisons est également une réponse directe à la pression concurrentielle, notamment face à OpenAI qui a lancé GPT-5 et qui propose des capacités concurrentes de codage. Abrams insiste sur le fait que les retours des clients guident le rythme des livraisons et que les améliorations visent à répondre aux besoins réels des équipes qui travaillent sur des projets complexes et de grande envergure. The Verge.

Détails techniques ou Mise en œuvre

Détails techniques clés:

- Taille de la fenêtre de contexte: 1 000 000 jetons pour Claude Sonnet 4

- Fenêtre précédente: 200 000 jetons

- Capacité d’analyse de code: 75 000–110 000 lignes

- Équivalent texte: environ 2 500 pages; War and Peace peut tenir dans le contexte

- Disponibilité: dès aujourd’hui pour Tier 4 et clients à limites personnalisées; déploiement élargi dans les prochaines semaines

| Métrique | Valeur |

|---|---|

| Fenêtre de contexte (Claude Sonnet 4) | 1 000 000 jetons |

| Fenêtre de contexte précédente | 200 000 jetons |

| Capacité d’analyse de code | 75 000–110 000 lignes |

| Capacité précédente de code | ~20 000 lignes |

| Pages de texte accommodées | ~2 500 pages |

| Cette mise à jour est présentée comme permettant au modèle d’envisager le contexte complet en une seule appel API, ce qui peut simplifier les flux de travail pour le codage et l’analyse de documents à grande échelle. L’orientation vers les clients d’entreprise, qui ont déjà investi dans la plateforme, reflète une tendance générale dans le secteur des IA à privilégier les clients à haut potentiel de revenu et à dépense continue. The Verge. |

Points clés

- La fenêtre de contexte de Claude Sonnet 4 passe à 1 000 000 de jetons (5x).

- Capacité étendue pour analyser de grands documents et des bases de code en une seule requête.

- Disponibilité aujourd’hui pour Tier 4 et clients à limites personnalisées; déploiement plus large dans les semaines à venir.

- Reconduction du positionnement d’Anthropic dans la course de codage IA face à OpenAI (GPT-4.1, GPT-5).

- Cadence rapide de sorties (Opus 4, Sonnet 4, Opus 4.1) soutenue par le retour client.

FAQ

-

Quelle est la nouvelle taille de la fenêtre de contexte pour Claude Sonnet 4 ?

1 000 000 de jetons.

-

Comment cela se compare-t-il à la fenêtre précédente et à la capacité de code ?

Fenêtre précédente: 200 000 jetons; capacité de code: 75 000–110 000 lignes (vs ~20 000 lignes auparavant).

-

uand la fonctionnalité est-elle disponible ?

Disponible dès aujourd’hui pour Tier 4 et les limites de taux personnalisées; déploiement plus large dans les semaines à venir.

-

Comment cela se situe-t-il par rapport aux offres des concurrents ?

Cela suit les avancées d’OpenAI (GPT-4.1 et GPT-5) dans une course centrée sur les clients professionnels pour le codage. [The Verge](https://www.theverge.com/ai-artificial-intelligence/757998/anthropic-just-made-its-latest-move-in-the-ai-coding-wars).

Références

More news

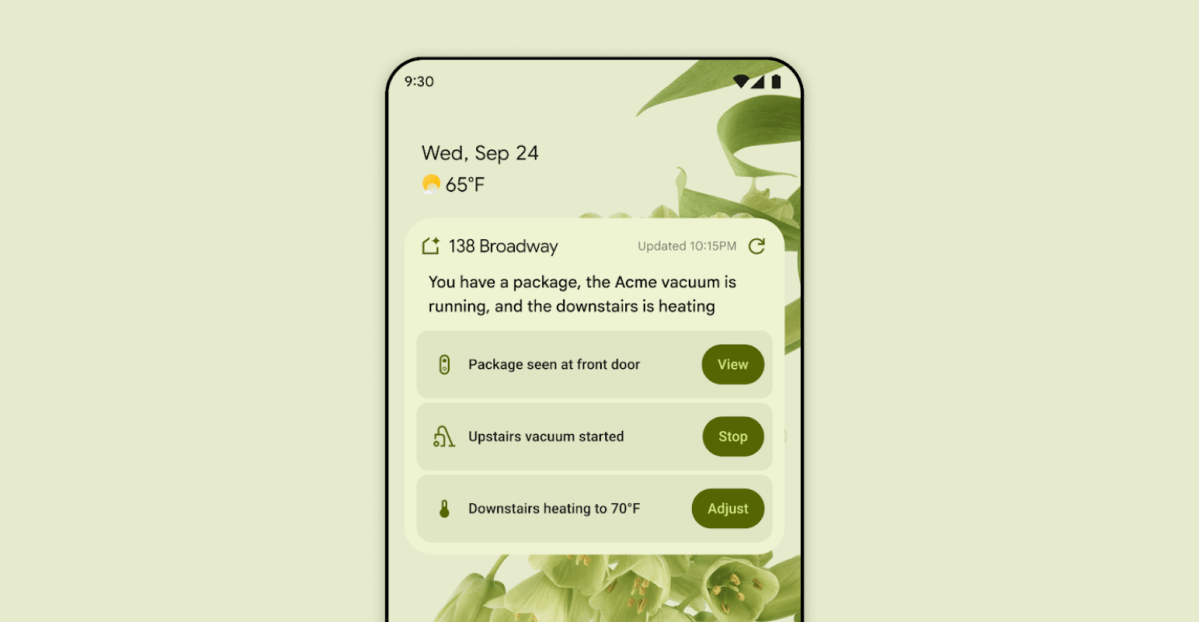

Premier aperçu de l'app Google Home propulsée par Gemini

The Verge rapporte que Google met Gemini dans l'application Google Home avec une refonte majeure et la nouvelle fonction 'Ask Home'.

Shadow Leak montre comment les agents ChatGPT peuvent exfiltrer des données Gmail via injection de prompt

Des chercheurs en sécurité ont démontré une attaque par injection de prompt baptisée Shadow Leak, utilisant Deep Research de ChatGPT pour exfiltrer discrètement des données d'une boîte Gmail. OpenAI a corrigé la faille; l'affaire illustre les risques des IA agentisées.

Les démonstrations ratées des lunettes intelligentes Live AI de Meta n’avaient rien à voir avec le Wi‑Fi, affirme le CTO

Les démonstrations en direct des lunettes Ray‑Ban avec Live AI de Meta ont connu des échecs embarrassants. Le CTO Andrew Bosworth explique les causes, dont un trafic auto-imposé et un bug rare d’appel vidéo, et précise que le bug est corrigé.

OpenAI envisagerait un haut-parleur intelligent, des lunettes, un enregistreur vocal et un pin avec Jony Ive

OpenAI explorerait une famille d'appareils IA avec l'ancien chef du design d'Apple, Jony Ive, incluant un haut-parleur sans écran, des lunettes intelligentes, un enregistreur vocal et un pin portable, avec une sortie visée fin 2026 ou début 2027.

Comment les chatbots et leurs créateurs alimentent la psychose liée à l’IA

Analyse de la psychose liée à l’IA, de la sécurité des adolescents et des questions juridiques à mesure que les chatbots se multiplient, selon les reportages de Kashmir Hill pour The Verge.

Google étend Gemini dans Chrome avec un déploiement multiplateforme et sans abonnement

Gemini IA dans Chrome accède aux onglets, à l’historique et aux propriétés Google, déployé sur Mac et Windows aux États-Unis sans frais, avec automatisation des tâches et intégrations Workspace.