Maximiser les performances robotiques avec Cosmos Reason de NVIDIA après entraînement

Sources: https://developer.nvidia.com/blog/maximize-robotics-performance-by-post-training-nvidia-cosmos-reason, developer.nvidia.com

TL;DR

- NVIDIA a dévoilé Cosmos Reason lors du GTC 2025 comme un modèle de raisonnement vision-langage (VLM) ouvert et entièrement personnalisable pour l’IA physique et la robotique. Source

- L’ajustement post-formation et l’apprentissage par renforcement combinés augmentent les performances du modèle de plus de 10 %, et un gain supplémentaire d’environ 5 % est apporté, aboutissant à une moyenne de 65,7 sur des benchmarks robotiques et véhicules autonomes.

- Le système convertit les vidéos en tokens via un encodeur visuel et un traducteur appelé projecteur, les fusionnant avec des prompts texte pour permettre un raisonnement pas-à-pas.

- Les développeurs peuvent télécharger des points de contrôle sur Hugging Face et accéder aux scripts d’inférence et de post-formation sur GitHub. Cosmos Reason est optimisé pour les GPUs NVIDIA et prend en charge le déploiement via Docker, de l’edge au cloud.

- Cosmos Reason a dominé le classement Physical Reasoning sur Hugging Face, démontrant ses capacités en raisonnement physique dans des situations réelles.

Contexte et arrière-plan

Présenté pour la première fois au GTC 2025, Cosmos Reason est conçu comme un modèle de raisonnement vision-langage ouvert et entièrement personnalisable pour l’IA physique et la robotique. Le modèle permet aux robots et aux agents de vision de raisonner en utilisant des connaissances préalables, une compréhension de la physique et du sens commun pour comprendre et agir dans le monde réel. Sa position en tête du leaderboard de raisonnement physique sur Hugging Face souligne son niveau de performance dans les tâches de raisonnement multimodal en conditions réelles. L’architecture intègre la vision et le langage pour relier perception et prise de décision, rendant les systèmes robotiques plus performants que la simple perception. Cosmos Reason s’appuie sur une combinaison d’ajustement supervisé et d’apprentissage par renforcement pour relier perception multimodale et prise de décision dans le monde réel. Le modèle bénéficie de capacités de raisonnement en chaîne pour comprendre les dynamiques du monde sans annotations humaines et propose un pipeline flexible de bout en bout qui combine des entrées vidéo et des prompts en langage naturel pour guider le raisonnement et les réponses. Pour les développeurs, cela signifie une base ouverte et adaptable, capable d’être spécialisée pour les tâches robotiques propres à leur domaine, avec un écosystème comprenant des points de contrôle disponibles sur Hugging Face et des scripts d’inférence et de post-formation sur GitHub. La documentation et les tutoriels offrent des détails sur l’implémentation, la formation et les considérations de déploiement.

Quoi de neuf

L’approche de post-formation de Cosmos Reason est au cœur des avancées. L’ajustement fin supervisé sur des tâches d’IA physique améliore les performances de la base de plus de 10 %, et l’apprentissage par renforcement ajoute environ 5 %. Ensemble, ces améliorations placent Cosmos Reason à une moyenne de 65,7 sur des benchmarks robotiques et véhicules autonomes. Les innovations clés incluent :

- Ajustement fin supervisé (SFT) sur des tâches d’IA physique pour améliorer les scénarios robotiques spécifiques ;

- apprentissage par renforcement (RL) pour aligner la perception multimodale sur les actions souhaitées ;

- pipeline vidéo-vers-tokens : transformant une vidéo et un prompt texte, Cosmos Reason convertit les frames en tokens via l’encodeur visuel et le projecteur, puis les fusionne avec le prompt pour guider le raisonnement ;

- raisonnement en chaîne de pensée : le modèle peut penser étape par étape et fournir des explications détaillées pour faciliter le débogage et la validation ;

- modèle d’upsampling de prompts : améliore les prompts d’entrée et l’alignement entre l’intention et le résultat ;

- démonstration sur des tâches robotiques : l’utilisation du robovqa illustre l’application VQA robotique ;

- déploiement : points de contrôle disponibles sur Hugging Face et scripts sur GitHub, avec des options Docker et une optimisation GPU NVIDIA. Pour une utilisation pratique, Cosmos Reason accepte des vidéos de résolutions et cadences variées, avec un prompt texte guidant le raisonnement et les conclusions du modèle. Cette flexibilité supporte des applications allant de la manipulation robotique à la navigation autonome et à l’inspection.

Pourquoi cela compte (impact pour les développeurs/entreprises)

- Ouvert et personnalisable : Cosmos Reason offre une base ouverte pour que chercheurs et équipes adaptent un modèle de raisonnement multimodal à leurs cas robotiques, accélérant l’expérimentation et le passage à la production.

- Flux de travail de bout en bout : de l’entrée vidéo au texte, avec un raisonnement pas à pas, le pipeline permet une prise de décision physique en temps réel.

- Leader sur les benchmarks : la position en tête du leaderboard Hugging Face renforce les capacités de raisonnement physique du Cosmos Reason, ce qui est un atout pour les systèmes robotiques et autonomes.

- Déploiement prêt pour la production : le modèle est conçu pour une déploiement pratique, avec Docker, des performances optimisées sur les GPUs NVIDIA et des pipelines couvrant l’edge et le cloud.

- Écosystème accessible : les points de contrôle, scripts d’inférence et ressources de post-formation sont disponibles sur des plateformes largement utilisées, facilitant l’adoption par des équipes de toutes tailles.

Détails techniques ou Implémentation

- Entrée et prétraitement : Étant donné une vidéo et un prompt, Cosmos Reason traite la vidéo via un encodeur visuel pour générer des tokens. Un traducteur spécialisé appelé projecteur convertit les tokens visuels dans un format compatible avec la pile de raisonnement multimodal du cœur du modèle. Le prompt texte est intégré aux tokens vidéo pour guider le raisonnement.

- Architecture du cœur : Le modèle emploie une combinaison de modules LLM et de techniques de raisonnement multimodal pour effectuer un raisonnement pas à pas sur les dynamiques du monde réel et les interactions physiques.

- Formation : Cosmos Reason utilise un ajustement fin supervisé et un apprentissage par renforcement pour aligner la perception multimodale sur les actions souhaitées. Cette approche produit des gains de performance et de robustesse.

- Gains de performance : l’ajustement fin sur des tâches d’IA physique augmente les performances de plus de 10 %, l’apprentissage par renforcement apportant environ 5 % supplémentaires, atteignant 65,7 sur des benchmarks robotiques et véhicules autonomes.

- Exemples de tâches et jeux de données : robovqa est cité comme exemple pour des scénarios de VQA robotiques, illustrant la spécialisation du domaine.

- Inférence et déploiement : le modèle peut être exécuté dans des environnements Docker ou standards, avec des GPUs NVIDIA compatibles (DGX Spark, RTX Pro 6000, séries A100/H100 et Blackwell GB200 NVL72 sur DGX Cloud). Les pipelines vision-texte et les mécanismes d’upsampling de prompts permettent une qualité et une réactivité adaptées.

- Accès et écosystème : les points de contrôle sont disponibles sur Hugging Face, les scripts d’inférence et les outils de post-formation sur GitHub. Les ressources incluent des tutoriels approfondis, des détails d’implémentation et des cas d’usage pratiques.

Points-clés

- Cosmos Reason est un VLM ouvert et personnalisable pour l’IA physique et la robotique.

- Les gains post-formation (SFT + RL) offrent des améliorations notables et un raisonnement guidé par la perception.

- Le pipeline vidéo-vers-tokens fusionne vision et texte pour un raisonnement multimodal robuste.

- L’accès se fait via Hugging Face et GitHub, avec une exécution optimisée sur GPUs NVIDIA.

- Le modèle a démontré des capacités solides dans des tâches robotiques et VQA associées.

FAQ

-

Qu’est-ce que NVIDIA Cosmos Reason et en quoi est-il unique ?

C’est un modèle ouvert de raisonnement vision-langage conçu pour l’IA physique et la robotique, capable de raisonnement pas à pas et d’expliquer ses conclusions en chaîne logique. Il combine ajustement fin supervisé et apprentissage par renforcement pour améliorer les performances.

-

uelles améliorations de performance ont été constatées ?

L’ajustement fin sur des tâches d’IA physique sauve des gains de plus de 10 %, l’apprentissage par renforcement ajoute environ 5 %, menant à une moyenne de 65,7 sur des benchmarks robotiques et véhicules autonomes.

-

Comment les développeurs accèdent-ils à Cosmos Reason ?

Des points de contrôle sont disponibles sur Hugging Face, avec des scripts d’inférence et des ressources de post-formation sur GitHub. Le déploiement se fait via Docker sur les GPUs NVIDIA.

-

Sur quelles plateformes et GPU Cosmos Reason est-il optimisé ?

Optimisé pour les GPUs NVIDIA, il peut tourner sur des systèmes comme DGX Spark, RTX Pro 6000, et les séries A100/H100, ainsi que sur Blackwell GB200 NVL72 via DGX Cloud.

-

uelles tâches illustrent les capacités de Cosmos Reason ?

Des scénarios robotiques et des tâches de VQA robotique, y compris robovqa, montrent la spécialisation du domaine et l’applicabilité à des cas réels.

Références

More news

NVIDIA HGX B200 réduit l’intensité des émissions de carbone incorporé

Le HGX B200 de NVIDIA abaisse l’intensité des émissions de carbone incorporé de 24% par rapport au HGX H100, tout en offrant de meilleures performances IA et une efficacité énergétique accrue. Cet article résume les données PCF et les nouveautés matérielles.

Prévoir les phénomènes météorologiques extrêmes en quelques minutes sans superordinateur : Huge Ensembles (HENS)

NVIDIA et le Lawrence Berkeley National Laboratory présentent Huge Ensembles (HENS), un outil IA open source qui prévoit des événements météorologiques rares et à fort impact sur 27 000 années de données, avec des options open source ou prêtes à l’emploi.

Comment réduire les goulots d’étranglement KV Cache avec NVIDIA Dynamo

NVIDIA Dynamo déporte le KV Cache depuis la mémoire GPU vers un stockage économique, permettant des contextes plus longs, une meilleure concurrence et des coûts d’inférence réduits pour les grands modèles et les charges AI génératives.

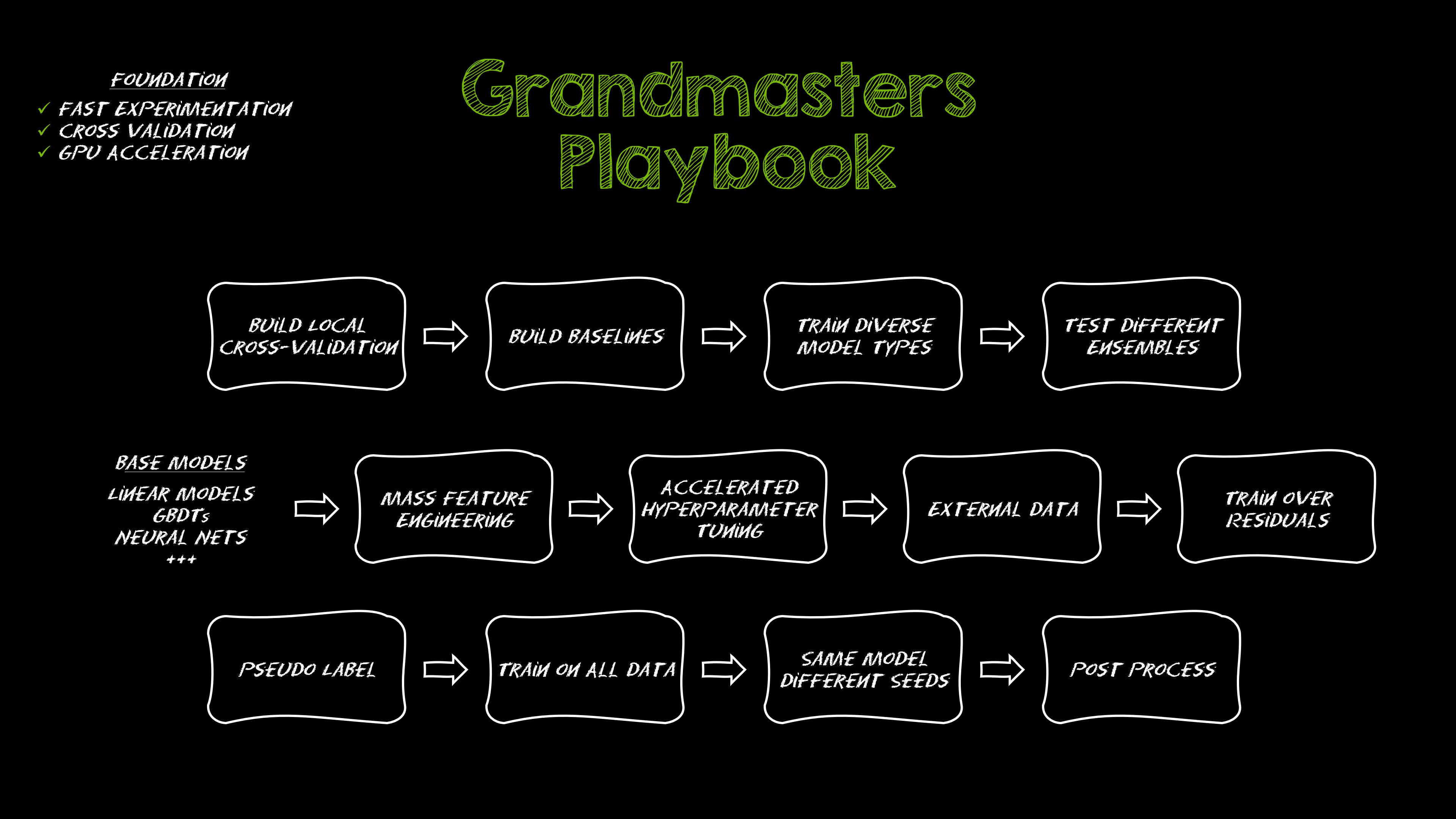

Le Playbook des Grands Maîtres Kaggle: 7 Techniques de Modélisation pour Données Tabulaires

Analyse approfondie de sept techniques éprouvées par les Grands Maîtres Kaggle pour résoudre rapidement des ensembles de données tabulaires à l’aide d’une accélération GPU, des baselines divers à l’assemblage et à la pseudo-étiquetage.

Microsoft transforme le site Foxconn en data center Fairwater AI, présenté comme le plus puissant au monde

Microsoft dévoile des plans pour un data center Fairwater AI de 1,2 million de mètres carrés au Wisconsin, abritant des centaines de milliers de GPU Nvidia GB200. Le projet de 3,3 milliards de dollars promet un entraînement IA sans précédent.

NVIDIA RAPIDS 25.08 Ajoute un Nouveau Profiler pour cuML, Améliorations du moteur GPU Polars et Support d’Algorithmes Étendu

RAPIDS 25.08 introduit deux profils pour cuml.accel (fonctionnel et ligne), l’exécuteur streaming par défaut du moteur Polars GPU, un support de types et chaînes étendu, Spectral Embedding dans cuML et des accélérations zéro-code pour plusieurs estimateurs.