Optimiser la Reconnaissance Vocale Contextuelle grâce à la Verrouillage Vectoriel pour une Récupération Efficace

Sources: https://machinelearning.apple.com/research/optimizing-contextual, machinelearning.apple.com

TL;DR

- Le biais contextuel neuronal peut améliorer la transcription, mais l’attention croisée avec des catalogues volumineux entraîne des coûts informatiques élevés.

- L’article introduit une approximation par quantification vectorielle du scoring d’attention croisée, permettant une utilisation efficace de catalogues larges de biais.

- L’approche s’insère dans un flux de biais contextuel par récupération et est indépendante du mode de biais utilisé ; des expériences couvrent l’attention croisée complète, le prompting de LLM et des combinaisons.

- La recherche par récupération permet de dresser une liste restreinte d’entrées pertinentes, fournissant jusqu’à 71% de réduction relative du taux d’erreurs (ER) pour la reconnaissance d’entités personnelles.

- Le système proposé réduit le temps de calcul d’environ 20% et l’utilisation mémoire de 85–95% pour des listes allant jusqu’à un million d’entrées, par rapport à l’attention croisée par produit scalaire standard. Le travail a été accepté à l’IEEE Spoken Language Technology Workshop (SLT) 2024.

Contexte et arrière-plan

Le biais contextuel neuronal permet aux modèles de reconnaissance vocale d’exploiter des informations contextuelles pertinentes, améliorant ainsi la précision des transcriptions. Cependant, le mécanisme de biais repose généralement sur un module d’attention croisée entre l’audio et un catalogue d’entrées de biais, ce qui entraîne des coûts computationnels importants lorsque le catalogue est volumineux et peut limiter les améliorations de précision. Le travail propose une approximation du scoring d’attention croisée basée sur la quantification vectorielle et permet une utilisation efficace en mémoire de catalogues biaisants importants. Il propose ensuite d’utiliser cette technique conjointement avec une approche de biais contextuel par récupération. D’abord, un module de récupération quantifié et efficace est utilisé pour présélectionner les entrées de biais en les groundant sur l’audio. Puis les entrées récupérées servent au biaisage. Comme l’approche est indépendante du mode de biais, les auteurs étudient l’utilisation d’une attention croisée complète, de prompts LLM et une combinaison des deux. Les résultats montrent que la présélection par récupération permet d’exploiter efficacement des catalogues de biais comportant plusieurs milliers d’entrées, ce qui se traduit par une réduction relative du ER allant jusqu’à 71% en reconnaissance d’entités personnelles. Par ailleurs, l’algorithme d’approximation proposé réduit le temps de calcul de 20% et l’utilisation de mémoire de 85–95% pour des listes allant jusqu’à un million d’entrées, par rapport à l’attention croisée standard par produit scalaire.

Ce qui est nouveau

- Introduction d’un module de récupération quantifiée efficace qui grounde les entrées de biais sur l’audio afin d’établir une liste courte de candidats.

- Utilisation des entrées de biais récupérées pour guider le biaisage, établissant un pipeline de biais par récupération.

- Démonstration que l’approche est indépendante du mode de biais et qu’elle a été évaluée avec l’attention croisée complète, le prompting LLM et des combinaisons des deux.

- Évaluation montrant que la récupération permet d’exploiter des catalogues de biais contenant des milliers d’entrées, atteignant jusqu’à 71% de réduction ER.

- Un algorithme de quantification qui réduit le temps de calcul de 20% et l’utilisation mémoire entre 85 et 95% pour des listes allant jusqu’à un million d’entrées, par rapport à l’attention croisée par produit scalaire.

Pourquoi cela compte (impact pour les développeurs/entreprises)

Pour les développeurs et les entreprises qui construisent des systèmes de reconnaissance vocale avec personnalisation ou des vocabulaires spécifiques, cette approche offre une voie pratique pour exploiter des catalogues importants de biais sans coûts computationnels ni mémoire prohibitifs. La quantification vectorielle permet un ground rapide des entrées de biais avec une faible empreinte mémoire, rendant possibles des catalogues volumineux allant de milliers à des millions d’entrées, tout en maintenant ou en améliorant l’exactitude dans des tâches telles que la reconnaissance d’entités personnelles. L’aspect indépendant du mode de biais signifie que les équipes peuvent expérimenter avec l’attention croisée, le prompting LLM, ou des stratégies hybrides sans réarchitecturer l’intégralité du système. Cela peut réduire les besoins matériels, accélérer l’itération des fonctionnalités de personnalisation et améliorer la fiabilité des transcriptions dans des environnements réels où le contexte est crucial.

Détails techniques ou Implementation

L’idée centrale est de remplacer ou d’augmenter la pointage de l’attention croisée par une approximation fondée sur la quantification vectorielle, capable de s’étendre à des catalogues de biais volumineux. Le pipeline comporte deux étapes principales :

- Étape 1 : Récupération quantifiée efficace. Une représentation compacte et quantifiée des entrées de biais est utilisée pour grounder les entrées dans l’audio, générant une liste restreinte d’entrées pertinentes.

- Étape 2 : Bias avec les entrées récupérées. Les entrées récupérées sont ensuite utilisées pour le biais, soit par attention croisée, prompting LLM, soit par une combinaison des deux. Les résultats montrent des gains d’efficacité pour des catalogues allant jusqu’à un million d’entrées : temps de calcul réduit de 20% et utilisation mémoire réduite de 85–95% par rapport à l’attention croisée par produit scalaire standard. Le travail souligne que la récupération permet d’exploiter des catalogues avec des milliers d’entrées, ce qui serait difficile avec une attention croisée naïve.

| Métrique | Réduction (relative) |

|---|---|

| Temps de calcul | 20% |

| Utilisation mémoire | 85–95% |

| Taille du catalogue testé | jusqu’à 1 000 000 d’entrées |

Points clés à retenir

- La quantification vectorielle peut approximativement modéliser l’attention croisée pour permettre le biais à grande échelle.

- La récupération guidée par l’audio constitue un moyen efficace de sélectionner les entrées pertinentes avant le biais.

- L’approche est indépendante du mode de biais et supporte l’attention croisée, le prompting LLM ou les deux.

- Des catalogues volumineux peuvent être exploités avec des gains de précision notables, notamment pour les entités personnelles.

- Les économies de calcul et de mémoire rendent faisable le déploiement dans des environnements à ressources limitées sans perte d’efficacité du biais.

FAQ

-

Quel problème l’approche tente-t-elle de résoudre ?

La complexité de l’attention croisée lors de l’utilisation de catalogues de biais importants pour le biais contextuel dans la reconnaissance vocale.

-

En quoi la quantification vectorielle aide-t-elle ?

Elle fournit une approximation du scoring d’attention croisée, permettant de représenter compactement les entrées de biais et de générer une liste restreinte de candidats avec grounding audio.

-

uels gains de performance sont rapportés ?

Jusqu’à 71% de réduction ER pour les entités personnelles, avec un temps de calcul réduit de 20% et une utilisation mémoire réduite de 85–95% pour des catalogues jusqu’à un million d’entrées, par rapport à l’attention croisée par produit scalaire standard.

-

Cette approche dépend-elle d’un seul mode de biais ?

Non. Elle est indépendante du mode de biais et a été évaluée avec l’attention croisée complète, le prompting LLM et des combinaisons.

-

Où ce travail a-t-il été présenté ?

Le travail a été accepté au IEEE Spoken Language Technology Workshop (SLT) 2024. [Source](https://machinelearning.apple.com/research/optimizing-contextual)

Références

- https://machinelearning.apple.com/research/optimizing-contextual

- Le travail est présenté dans le cadre du programme de la conférence IEEE SLT 2024. Pour plus de détails, voir la publication : Optimizing Contextual Speech Recognition Using Vector Quantization for Efficient Retrieval.

More news

Comment réduire les goulots d’étranglement KV Cache avec NVIDIA Dynamo

NVIDIA Dynamo déporte le KV Cache depuis la mémoire GPU vers un stockage économique, permettant des contextes plus longs, une meilleure concurrence et des coûts d’inférence réduits pour les grands modèles et les charges AI génératives.

Réduire la latence de démarrage à froid pour l’inférence LLM avec NVIDIA Run:ai Model Streamer

Analyse approfondie sur la façon dont NVIDIA Run:ai Model Streamer abaisse les temps de démarrage à froid pour l’inférence des LLM en diffusant les poids vers la mémoire GPU, avec des benchmarks sur GP3, IO2 et S3.

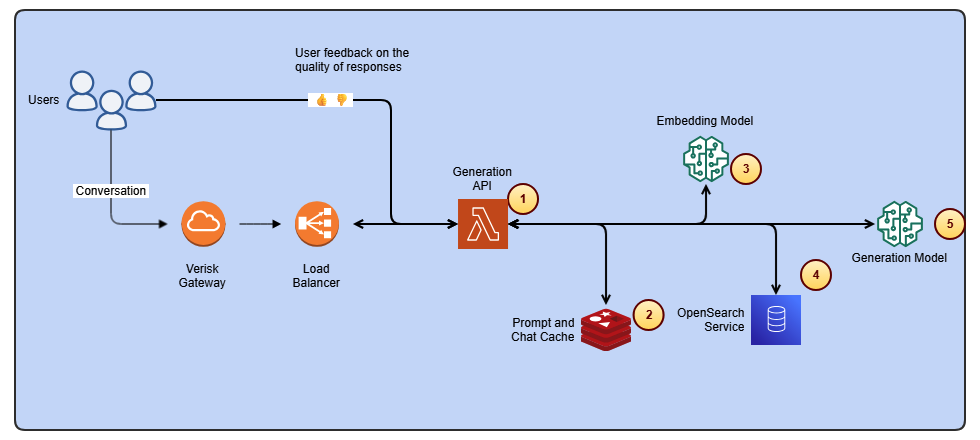

Simplifier l accès aux changements de contenu ISO-rating avec Verisk Rating Insights et Amazon Bedrock

Verisk Rating Insights, propulsé par Amazon Bedrock, LLM et RAG, offre une interface conversationnelle pour accéder aux changements ERC ISO, réduisant les téléchargements manuels et accélérant les informations fiables.

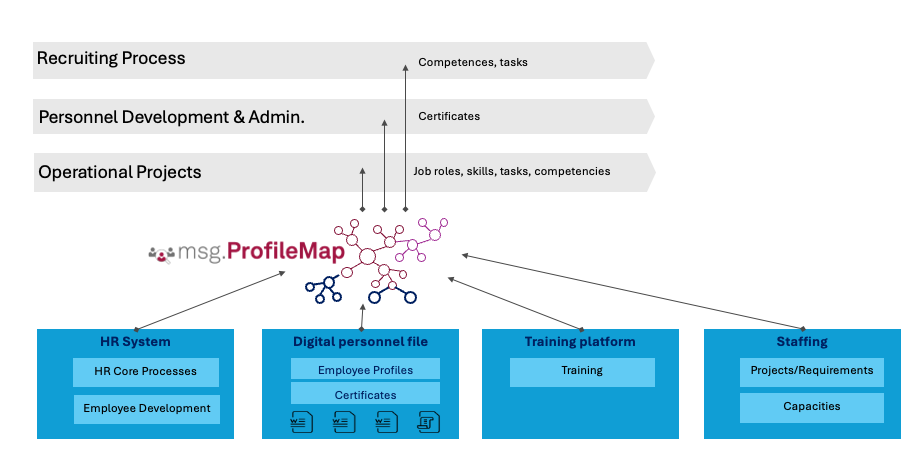

Comment msg a renforcé la transformation RH avec Amazon Bedrock et msg.ProfileMap

Cet article explique comment msg a automatisé l'harmonisation des données pour msg.ProfileMap en utilisant Amazon Bedrock pour alimenter des flux d'enrichissement pilotés par LLM, améliorant la précision de l'appariement des concepts RH, réduisant la charge manuelle et assurant la conformité avec l'

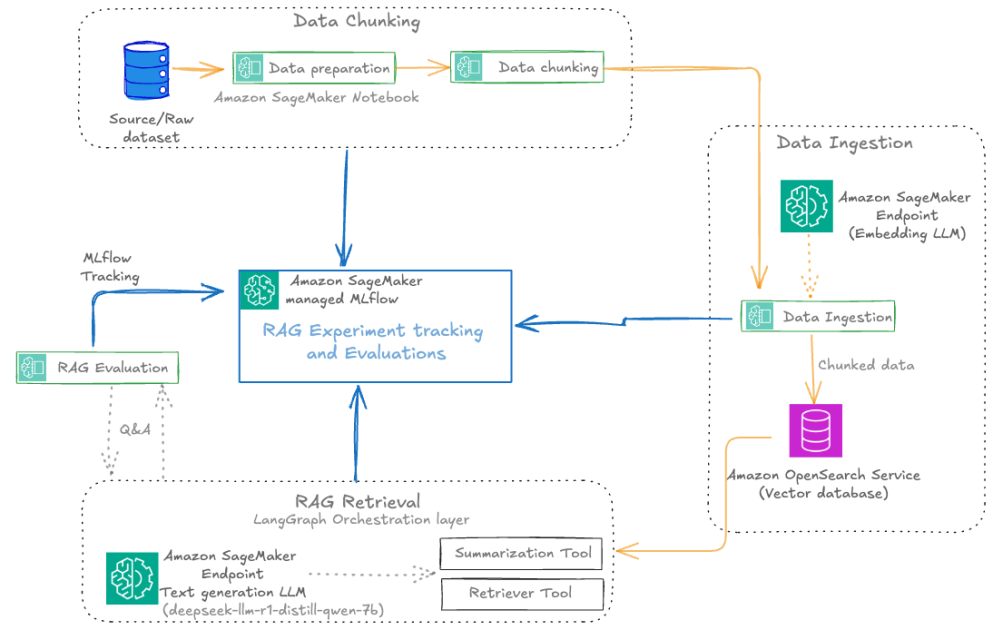

Automatiser des pipelines RAG avancés avec Amazon SageMaker AI

Optimisez l’expérimentation jusqu’à la production pour le RAG (Retrieval Augmented Generation) avec SageMaker AI, MLflow et Pipelines, afin d’obtenir des flux reproductibles, évolutifs et gouvernés.

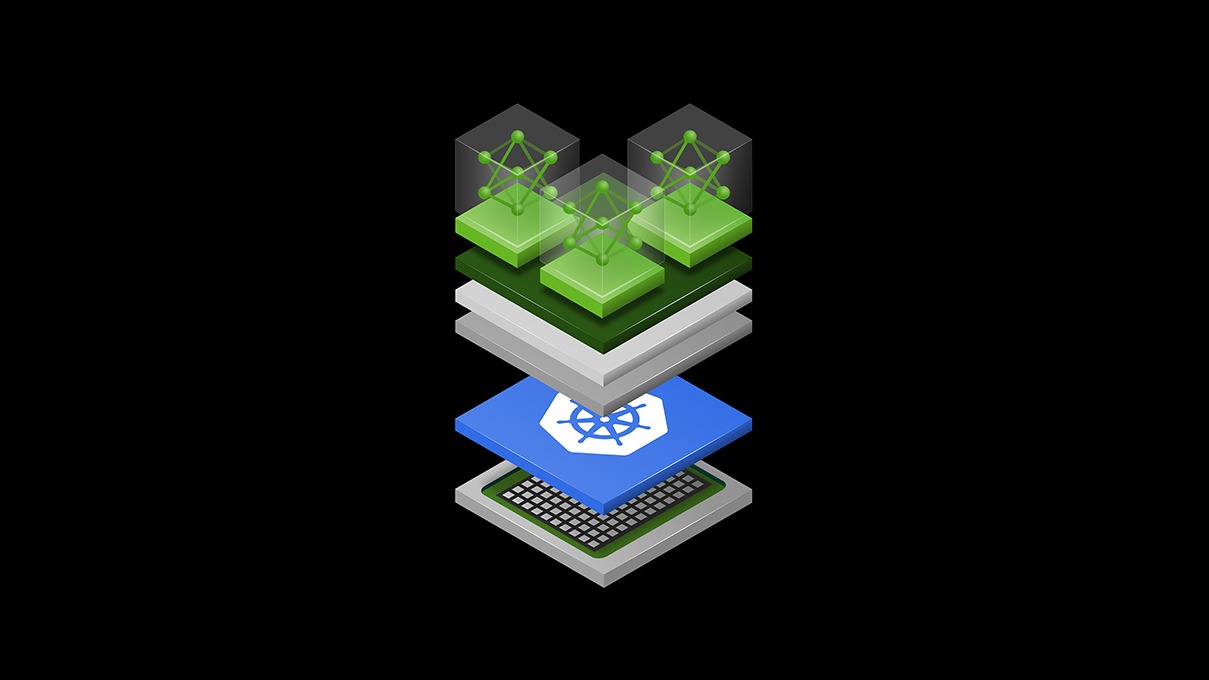

Déployer une inférence IA scalable avec NVIDIA NIM Operator 3.0.0

NVIDIA NIM Operator 3.0.0 étend l’inférence IA scalable sur Kubernetes, avec déploiements multi-LLM et multi-nœud, intégration KServe et support DRA en version technologique, en collaboration avec Red Hat et NeMo Guardrails.