Ce qui manque aux chatbots LLM : un sens de l’objectif

Sources: https://thegradient.pub/dialog, thegradient.pub

TL;DR

- Le dialogue intentionnel considère les chatbots LLM comme des agents collaboratifs poursuivant des objectifs communs, pas uniquement comme des prédicteurs du prochain token.

- La prise de tour et la mémoire permettent des interactions longues et personnalisées, ouvrant la voie à des assistants personnels dans des domaines comme la planification de voyages et le codage.

- Les benchmarks traditionnels et la génération en une seule passe ne capturent pas les aspects cruciaux du dialogue; la stabilité des instructions peut se dégrader sur plusieurs échanges, soulevant des questions de sécurité.

- Des tests initiaux montrent que même les modèles de long contexte ont du mal à maintenir les prompts système au-delà de quelques milliers de tokens; des techniques simples comme le split-softmax sont proposées pour atténuer cet effet. Pour plus de contexte, consultez l’article sur The Gradient qui explore comment les formats de dialogue, les prompts et les dynamiques d’interaction modèlent le comportement et la sécurité des LLMs. Source.

Contexte et arrière-plan

Les chatbots basés sur les LLM ont connu une progression rapide, avec des améliorations fréquemment signalées sur des benchmarks tels que MMLU, HumanEval et MATH. Cependant, à mesure que ces mesures se saturent, la question demeure : l’expérience utilisateur s’améliore-t-elle en parallèle de ces scores lorsque les interactions sont intrinsèquement multi-tours et axées sur un objectif ? Une perspective émergente soutient que le dialogue volontaire constitue un axe plus pertinent que les évaluations en une seule passe. L’objectif peut être large, comme un comportement utile et inoffensif, ou plus spécifique, comme un agent de planification de voyages, une thérapie ou un service client.

En pratique, transmettre toutes les informations en une passe est coûteux. Des échanges multiples permettent de partager seulement les informations essentielles au besoin, une idée proche de la théorie de la négociation où les bargains itératifs conduisent à de meilleurs résultats que des décisions uniques. De plus, chaque énoncé peut être vu comme une action délibérée destinée à modifier le modèle du monde de l’autre partie. Lorsque les deux parties ont des objectifs complexes et parfois cachés, le dialogue volontaire devient un cadre naturel pour la collaboration homme–IA.

Historiquement, les systèmes de dialogue ont évolué des interfaces planifiées vers des approches modernes basées sur les LLM. Les premiers systèmes comme le script de restaurant de Schank découpaient les expériences en étapes avec des répliques spécifiques. Aujourd’hui, les LLMs prédisent le prochain token sur d’immenses corpus, y compris des textes internet et des données au format dialogue, et leur comportement de dialogue downstream est guidé par le formatage et l’ajustement fin.

Le pipeline habituel comporte trois étapes : (1) le pré-entraînement d’un modèle de séquence pour prédire le prochain token sur un ensemble de données massif ; (2) l’introduction d’un formatage de dialogue pour représenter l’historique comme prompts du système et échanges passés, souvent via des balises comme <SYS> ou <INST> ; (3) RLHF, où le chatbot est récompensé ou pénalisé selon la qualité des réponses. La mise en forme n’est pas directement dérivée du pré-entraînement, mais elle influence fortement le comportement en dialogue et la sécurité en aval.

Les chercheurs constatent que les prompts système peuvent être fragiles face à des conditions adverses, et que le suivi strict des instructions peut se dégrader après plusieurs échanges. Le suivi d’instructions interroge les limites de l’évaluation interactive : des métriques comme MT-Bench et Alpaca-Eval existent, mais évaluer le comportement dans un cadre interactif demeure complexe. Des travaux récents ont simulé des dialogues sans fin entre agents pour évaluer l’adhérence aux prompts et la stabilité des instructions, révélant des défis importants pour des modèles majeurs et des questions de sécurité liées à l’écartement du cadre initial.

Pour une lecture approfondie, voir The Gradient qui examine les liens entre format de dialogue, prompts et sécurité des LLMs. Source.

Points forts et nouveautés

Le dialogue intentionnel redéfinit les chatbots comme des collaborateurs capables d’aider les humains à atteindre des objectifs via des échanges continus. Cela ouvre plusieurs possibilités :

- Mémoire et profils utilisateur : un chatbot pourrait apprendre progressivement les préférences grâce à des interactions quotidiennes et intégrer des informations de sources comme Twitter, arXiv, Slack ou flux d’actualités pour des résumés personnalisés.

- Prise de tour et clarifications itératives : le système peut clarifier les exigences, demander des informations manquantes et solliciter une aide humaine si nécessaire, à l’image du pair programming.

- Assistants personnels : la persistance et l’adaptation pourraient permettre de rédiger des e-mails, de résumer des événements et d’assister dans la planification, tout en affinant le comportement avec les retours.

- Implications pour le codage : si les benchmarks se concentrent souvent sur une génération unique, les tâches réelles nécessitent un dialogue continu avec les ingénieurs pour confirmer les exigences et combler les lacunes de documentation. Un exemple concret a consisté à mettre en place un environnement de dialogue illimité entre deux agents avec prompts système pour tester l’adhérence aux instructions. Les résultats sur des modèles comme LLaMA2-chat-70B et GPT-3.5-turbo-16k ont démontré une instabilité importante de l’instruction au fil des tours, avec des préoccupations de sécurité lorsque le prompt dérive. En outre, il est apparu que même avec des fenêtres de contexte importantes, le dialogue interactif peut devenir perturbé après environ 1,6k tokens, ce qui motive des techniques telles que split-softmax. Cette ligne de recherche montre la nécessité d’outils et d’expérimentations supplémentaires pour des dialogues durables et sûrs. Pour plus de détails, reportez-vous à l’article original sur The Gradient. Source.

Détails techniques ou Mise en œuvre

- Pré-entraînement : un modèle de séquence est entraîné pour prédire le prochain token sur un corpus massif et varié (actualités, livres, code, données de dialogue) ce qui établit des capacités linguistiques générales, sans encoder le format de dialogue downstream par lui-même.

- Formatage de dialogue : une représentation explicite du dialogue est introduite pour les tâches ultérieures, utilisant des marqueurs tels que

<SYS>ou<INST>pour désigner les prompts système. Le format exact varie selon les modèles et n’est pas un standard unique du pré-entraînement. - RLHF : l’ajustement fin s’appuie sur le retour humain pour récompenser ou pénaliser les sorties, avec des considérations KL et des ajustements de poids (par exemple via LoRA). Le RLHF est crucial mais ne suffit pas seul à l’alignement.

- Prompts de système et sécurité : les prompts système jouent un rôle central et leur efficacité peut se dégrader dans des dialogues à plusieurs tours, ce qui soulève des questions de sécurité et de drift.

- Évaluation en cadre interactif : pour étudier la stabilité des instructions, des dialogues illimités ont été simulés et des questions de sondage liées aux prompts ont été utilisées pour évaluer l’adhérence.

- Stratégies de mitigation : des approches comme split-softmax sont proposées pour atténuer les distractions liées au long contexte, mais restent en phase de validation.

Points clés à retenir

- Le dialogue intentionnel transforme les chatbots LLM en partenaires capables d’aider les humains à atteindre des objectifs via une interaction continue.

- Les interactions à plusieurs tours permettent la mémoire, l’adaptation des préférences et le potentiel d’un assistant personnel plus fluide, utile pour la planification et les tâches quotidiennes.

- Les pratiques actuelles d’évaluation axées sur une seule intervention ne captent pas les réalités du dialogue interactif et peuvent masquer des risques de sécurité et de fiabilité.

- La stabilité des instructions sur plusieurs tours est une préoccupation réelle, stimulant les recherches sur le formatage, les prompts et l’architecture pour maintenir l’alignement.

- Des techniques simples comme split-softmax montrent des directions prometteuses pour traiter les perturbations liées au long contexte, soulignant la nécessité d’expérimentation et d’outillage pour des conversations robustes et longues.

FAQ

-

- **Q : Qu’est-ce que le dialogue intentionnel dans les chatbots LLM ?**

C’est une conversation multi-tours entre l’utilisateur et l’IA centrée sur un objectif, où chaque tour est une action visant à progresser vers cet objectif. - **Q : Pourquoi les modèles ont-ils du mal avec les longues conversations ?** **A :** Même avec des fenêtres de contexte étendues, les modèles peuvent dévier des prompts système et des règles de sécurité au fil des tours, réduisant la fidélité des instructions et augmentant le risque de sorties incorrectes. - **Q : Comment le tour-taking influence-t-il les tâches de codage ?** **A :** Il permet une interaction bidirectionnelle avec les ingénieurs pour clarifier les besoins, combler les lacunes et réduire les défauts sans augmenter l’effort humain. - **Q : Qu’est-ce que split-softmax et pourquoi en parle-t-on ?** **A :** Split-softmax est une technique proposée pour atténuer les distrations liées au long contexte, aidant à maintenir la stabilité dans les dialogues étendus. - **Q : Que doivent prioriser les développeurs pour améliorer les chatbots LLM pratiques ?** **A :** Modéliser la mémoire, comprendre les préférences des utilisateurs, maintenir une instruction stable sur plusieurs tours et développer des formats de dialogue fidèles aux prompts système.

Références

- The Gradient: What’s Missing From LLM Chatbots: A Sense of Purpose. https://thegradient.pub/dialog

</INST>``````````</INST>

More news

Comment réduire les goulots d’étranglement KV Cache avec NVIDIA Dynamo

NVIDIA Dynamo déporte le KV Cache depuis la mémoire GPU vers un stockage économique, permettant des contextes plus longs, une meilleure concurrence et des coûts d’inférence réduits pour les grands modèles et les charges AI génératives.

Réduire la latence de démarrage à froid pour l’inférence LLM avec NVIDIA Run:ai Model Streamer

Analyse approfondie sur la façon dont NVIDIA Run:ai Model Streamer abaisse les temps de démarrage à froid pour l’inférence des LLM en diffusant les poids vers la mémoire GPU, avec des benchmarks sur GP3, IO2 et S3.

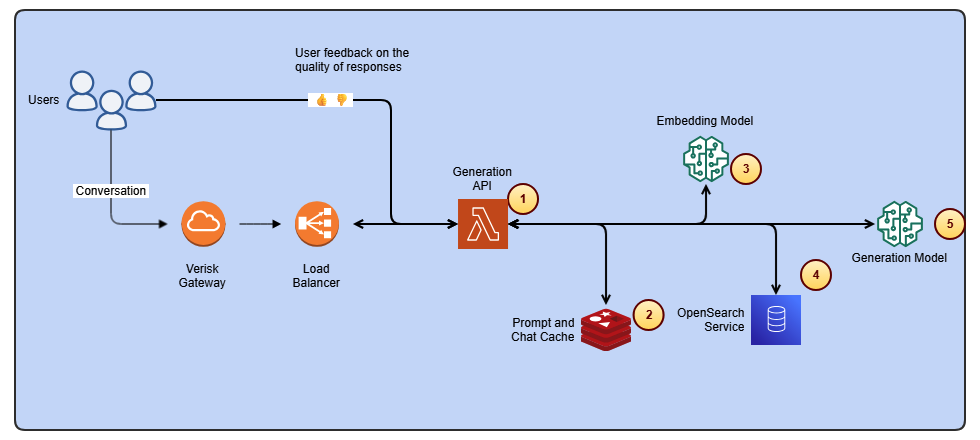

Simplifier l accès aux changements de contenu ISO-rating avec Verisk Rating Insights et Amazon Bedrock

Verisk Rating Insights, propulsé par Amazon Bedrock, LLM et RAG, offre une interface conversationnelle pour accéder aux changements ERC ISO, réduisant les téléchargements manuels et accélérant les informations fiables.

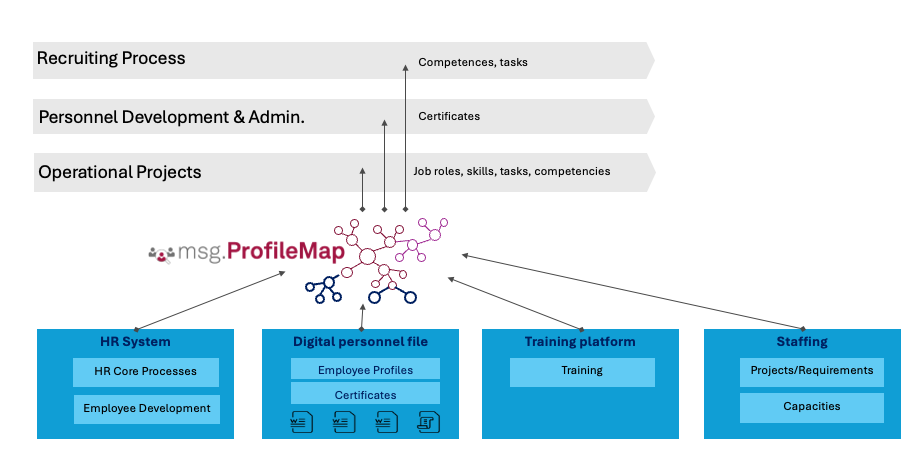

Comment msg a renforcé la transformation RH avec Amazon Bedrock et msg.ProfileMap

Cet article explique comment msg a automatisé l'harmonisation des données pour msg.ProfileMap en utilisant Amazon Bedrock pour alimenter des flux d'enrichissement pilotés par LLM, améliorant la précision de l'appariement des concepts RH, réduisant la charge manuelle et assurant la conformité avec l'

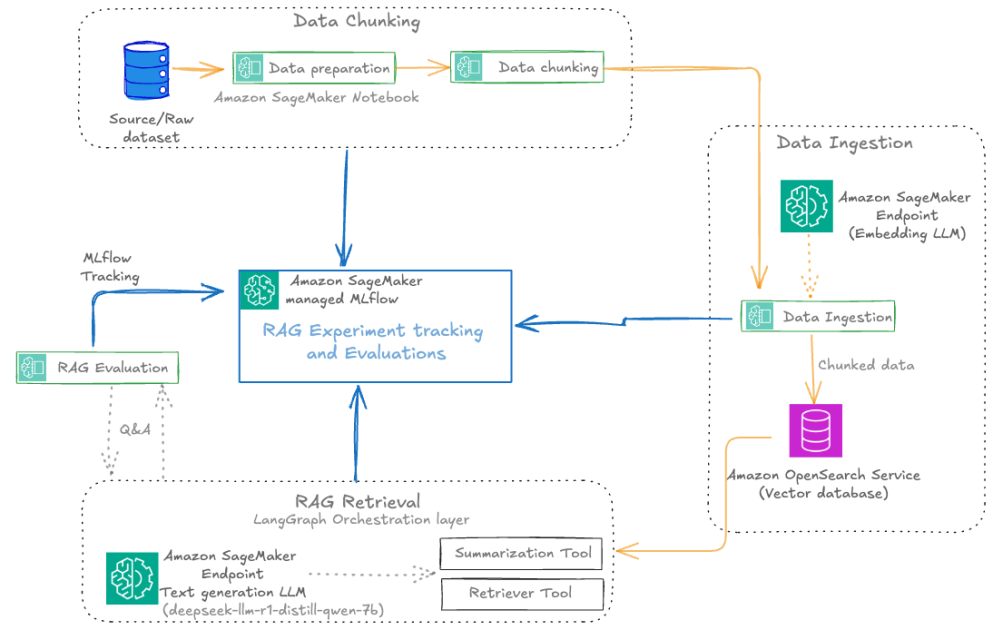

Automatiser des pipelines RAG avancés avec Amazon SageMaker AI

Optimisez l’expérimentation jusqu’à la production pour le RAG (Retrieval Augmented Generation) avec SageMaker AI, MLflow et Pipelines, afin d’obtenir des flux reproductibles, évolutifs et gouvernés.

Comment la Quantization Aware Training permet de récupérer la précision en inferance à faible précision

Explore QAT et QAD comme méthodes de récupération de précision dans des modèles à faible précision, en s'appuyant sur TensorRT Model Optimizer et les formats FP8/NVFP4/MXFP4.