Mejora la comprensión de video con Amazon Bedrock Data Automation y detección de objetos de conjunto abierto

Sources: https://aws.amazon.com/blogs/machine-learning/enhance-video-understanding-with-amazon-bedrock-data-automation-and-open-set-object-detection, https://aws.amazon.com/blogs/machine-learning/enhance-video-understanding-with-amazon-bedrock-data-automation-and-open-set-object-detection/, AWS ML Blog

TL;DR

- La detección de objetos de conjunto abierto (OSOD) permite a los modelos detectar objetos conocidos y no vistos, mediante prompts flexibles y sin necesidad de reentrenamiento.

- Bedrock Data Automation añade OSOD al flujo de video a través de blueprints, devolviendo cuadros delimitadores por fotograma (XYWH), etiquetas y puntuaciones de confianza.

- OSOD se integra con las capacidades de video de Bedrock (segmentación de capítulos, detección de texto por fotograma y clasificación por taxonomías IAB por capítulo) para obtener insights accionables.

- Casos de uso abarcan optimización publicitaria, seguridad y monitoreo, búsqueda en retail y más, con salidas que pueden filtrarse o personalizarse para ajustar precisión o recall. AWS ML Blog

Contexto y antecedentes

En el análisis de video e imagen del mundo real, los enfoques de detección de objetos en conjunto cerrado (CSOD) tradicionales, que reconocen solo un conjunto fijo de categorías, fallan cuando aparecen objetos que no formaban parte del entrenamiento. Esto se agrava en entornos dinámicos donde emergen objetos nuevos, desconocidos o definidos por el usuario. Ejemplos prácticos incluyen editores de medios que rastrean marcas emergentes en contenido generado por usuarios, anunciantes que analizan apariciones de productos en videos de influenciadores, minoristas que requieren búsquedas descriptivas flexibles, y escenarios como coches autónomos que deben identificar escombros inesperados. Cuando se encuentran objetos desconocidos, los modelos CSOD pueden clasificarlos incorrectamente u omitirlos, limitando su utilidad para aplicaciones del mundo real. La detección de objetos de conjunto abierto (OSOD) es un enfoque que permite detectar tanto objetos conocidos como no vistos, incluyendo aquellos no encontrados durante el entrenamiento. OSOD admite entradas de texto muy flexibles y puede adaptarse a objetivos definidos por el usuario en tiempo real sin reentrenamiento, combinando el reconocimiento visual con la comprensión semántica, a menudo mediante modelos visión-lenguaje. AWS ML Blog Bedrock Data Automation es un servicio en la nube que extrae insights de contenido no estructurado como documentos, imágenes, video y audio. Para video, admite segmentación de capítulos, detección de texto por fotograma, clasificación por taxonomías IAB por capítulo y detección de objetos en conjunto abierto por fotograma. La capacidad de OSOD está disponible en blueprints de video de Bedrock Data Automation, permitiendo especificar objetos deseados mediante un prompt de texto. AWS ML Blog

Novedades

La capacidad OSOD está integrada en las herramientas de análisis de video de Bedrock Data Automation, proporcionando detección de objetos poderosa y flexible sin necesidad de reentrenamiento.

- OSOD por fotograma en blueprints de video: se proporciona un video y un prompt de texto que especifica los objetos a detectar. Por cada fotograma, el modelo devuelve un diccionario con cuadros delimitadores en formato XYWH (x, y, ancho, alto), junto con etiquetas y puntuaciones de confianza. Esto facilita la localización precisa y la clasificación de detecciones a lo largo de la línea de tiempo.

- Prompt flexible y campos dinámicos: el texto de entrada puede ser muy flexible, permitiendo definir blueprints de video respaldados por OSOD con campos dinámicos. Se pueden definir prompts que respondan preguntas de negocio actuales o apuntes específicos sin reentrenamiento.

- Salida personalizable: las salidas pueden ajustarse, por ejemplo filtrando detecciones de alta confianza para priorizar precisión, o ajustando umbrales para equilibrar precisión y recall.

- Capacidades de video integradas: además de OSOD, Bedrock Data Automation ofrece segmentación de capítulos, detección de texto por fotograma y clasificación por taxonomía IAB por capítulo, para apoyar flujos de trabajo de análisis de video completos.

- Casos prácticos y ejemplos: los anuncios pueden realizar pruebas A/B para comparar la efectividad de colocaciones de anuncios en distintas ubicaciones; otros prompts muestran cómo detectar elementos clave en un video o verificar elementos peligrosos en escenarios de seguridad doméstica. También se puede localizar objetos específicos mediante prompts descriptivos como “Detectar el coche blanco con llantas rojas.” Se mencionan esquemas de blueprint de ejemplo y salidas de muestra; se indica que existe un repositorio de GitHub para ejemplos completos. AWS ML Blog La capacidad OSOD dentro de Bedrock Data Automation mejora significativamente la capacidad de extraer insights accionables de contenido de video. Combinando consultas guiadas por texto con localización por fotogramas, OSOD ayuda a que las empresas implementen flujos de análisis de video inteligentes, desde evaluación de anuncios y monitoreo de seguridad hasta seguimiento de objetos personalizados. Integrado en el conjunto de herramientas de análisis de video de Bedrock Data Automation, OSOD facilita la comprensión del contenido y reduce la necesidad de intervención manual, haciendo de esta capacidad una pieza valiosa para soluciones escalables en el mundo real. AWS ML Blog

¿Por qué es importante (impacto para desarrolladores/empresas)?

- Capacidad de consulta flexible: OSOD permite búsquedas que van más allá de las categorías fijas, aceptando prompts específicos o descripciones abiertas para dirigir la analítica de forma amplia.

- No se necesita reentrenamiento: la aproximación de conjunto abierto permite detectar objetos desconocidos sin reentrenar, reduciendo tiempos de implementación y mantenimiento de pipelines. AWS ML Blog

- Localización precisa por fotograma: disponer de detecciones por fotograma con cajas XYWH facilita integrar el seguimiento de objetos en flujos downstream de procesamiento y recuperación de contenido.

- Análisis de video end-to-end: OSOD se complementa con otras capacidades de Bedrock Data Automation para ofrecer insights más completos y contextuales del contenido de video entre capítulos y segmentos.

- Aplicabilidad en múltiples industrias: publicidad, moderación de contenido, retail y seguridad son algunos de los casos mencionados, lo que demuestra el valor de combinar OSOD con pipelines de análisis de video escalables. AWS ML Blog

Detalles técnicos o Implementación

- OSOD por fotograma en blueprints de Bedrock Data Automation: el núcleo permite introducir un video y un prompt de texto que describe los objetos a detectar. Por cada fotograma, se devuelve un diccionario con las cajas delimitadoras y las puntuaciones de confianza.

- Cómo funcionan los prompts: el texto de entrada es altamente flexible, permitiendo definir blueprints de video con campos dinámicos para responder a preguntas de negocio actuales sin necesidad de reentrenamiento.

- Salidas personalizables: se pueden ajustar las salidas mediante filtros de confianza para equilibrar precisión y recall conforme al caso de uso.

- Capacidades integradas: además de OSOD, incluye segmentación de capítulos, detección de texto por fotograma y clasificación por taxonomía IAB por capítulo, lo que facilita obtener insights más ricos y estructurados.

- Ejemplos y esquemas: se mencionan esquemas de blueprint y salidas de ejemplo por fotograma; un repositorio de GitHub es citado para demostraciones completas, cuando esté disponible. AWS ML Blog

- Consideraciones prácticas: prompts como “Detectar las ubicaciones de dispositivos Echo” muestran cómo dirigir el sistema a objetivos prácticos. Las salidas ayudan a decidir cómo ajustar la visualización y el procesamiento para diferentes resoluciones y relaciones de aspecto. AWS ML Blog

Tabla rápida: OSOD en Bedrock Data Automation – características y beneficios

| Función | Beneficio |

|---|---|

| OSOD por fotograma en blueprints | Detecta objetos conocidos y no vistos por fotograma mediante prompts flexibles |

| Salida por fotograma | Valores XYWH, etiquetas y puntuaciones de confianza para localización precisa |

| Prompts flexibles | Defina campos dinámicos y objetivos sin reentrenamiento |

| Salidas personalizables | Filtre por confianza para equilibrar precisión y recall |

| Capacidades de vídeo complementarias | Segmentación de capítulos, detección de texto por fotograma, taxonomía IAB por capítulo |

Conclusiones clave

- OSOD permite detectar objetos conocidos y desconocidos en video, guiado por prompts flexibles y sin necesidad de reentrenamiento.

- Bedrock Data Automation ofrece OSOD por fotograma dentro de blueprints de video, con salidas de localización por fotograma (XYWH), etiquetas y puntuaciones de confianza.

- La plataforma se integra con otras capacidades de video para entregar insights de extremo a extremo, incluyendo evaluación de publicidad y monitoreo de seguridad.

- Los casos de uso abarcan publicidad, seguridad, búsqueda en retail y más, con salidas personalizables para satisfacer requerimientos de negocio.

- Este enfoque reduce la intervención manual y soporta flujos de trabajo de análisis de video escalables en diversas industrias. AWS ML Blog

Preguntas frecuentes (FAQ)

- P: ¿Qué es OSOD? R: OSOD permite detectar objetos conocidos y no vistos, incluidos aquellos no encontrados durante el entrenamiento, mediante prompts flexibles y, a menudo, modelos visión-lenguaje. AWS ML Blog

- P: ¿Cómo implementa Bedrock Data Automation OSOD en video? R: OSOD se aplica a nivel de fotograma en blueprints de video. Se proporciona un video y un prompt; por cada fotograma, el sistema devuelve cajas, etiquetas y puntuaciones de confianza, con opciones de personalización de salida. AWS ML Blog

- P: ¿Necesito reentrenar modelos para usar OSOD con Bedrock Data Automation? R: No. OSOD permite adaptación en tiempo real a objetos desconocidos sin reentrenamiento, mediante prompts flexibles. AWS ML Blog

- P: ¿Qué salidas se producen por fotograma? R: Por fotograma, se obtienen detecciones con cajas XYWH, etiquetas de objetos y puntuaciones de confianza. AWS ML Blog

- P: ¿Qué usos prácticos se citan? R: Evaluación de publicidad, monitoreo de seguridad y búsqueda/indexación en retail, con la capacidad de localizar objetos mediante prompts descriptivos como “Detectar el coche blanco con ruedas rojas.” AWS ML Blog

Referencias

More news

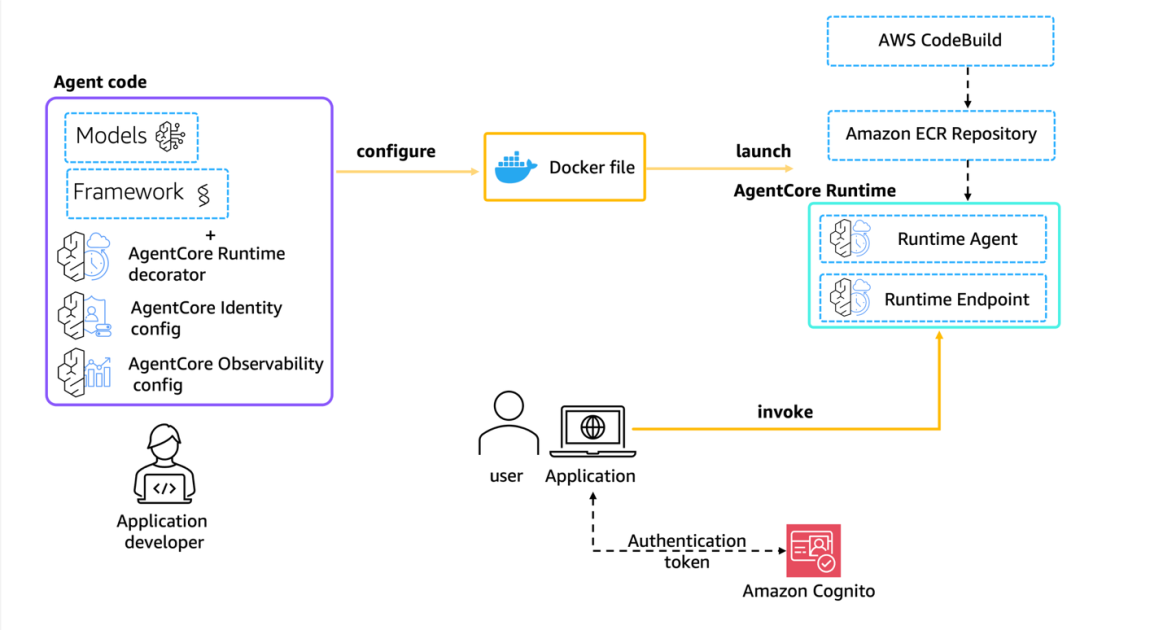

Llevar agentes de IA de concepto a producción con Amazon Bedrock AgentCore

Análisis detallado de cómo Amazon Bedrock AgentCore facilita la transición de aplicaciones de IA basadas en agentes desde un concepto de prueba hasta sistemas de producción empresariales, conservando memoria, seguridad, observabilidad y gestión escalable de herramientas.

Monitorear la inferencia por lotes de Bedrock de AWS con métricas de CloudWatch

Descubra cómo monitorear y optimizar trabajos de inferencia por lotes de Bedrock con métricas, alarmas y paneles de CloudWatch para mejorar rendimiento, costos y operación.

Solicitando precisión con Stability AI Image Services en Amazon Bedrock

Bedrock incorpora Stability AI Image Services con nueve herramientas para crear y editar imágenes con mayor precisión. Descubre técnicas de prompting para uso empresarial.

Escala la producción visual con Stability AI Image Services en Amazon Bedrock

Stability AI Image Services ya está disponible en Amazon Bedrock, ofreciendo capacidades de edición de imágenes listas para usar a través de la API de Bedrock y ampliando los modelos Stable Diffusion 3.5 y Stable Image Core/Ultra ya presentes.

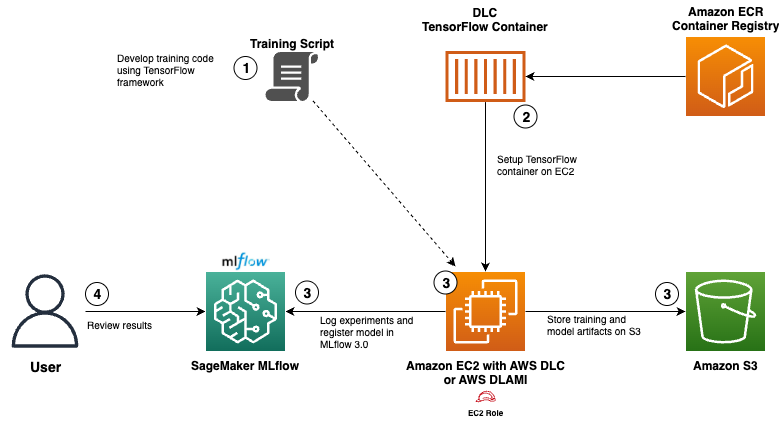

Usar AWS Deep Learning Containers con Amazon SageMaker AI MLflow gestionado

Vea cómo los AWS Deep Learning Containers (DLCs) se integran con SageMaker AI gestionado por MLflow para equilibrar el control de la infraestructura y una gobernanza de ML sólida. Un flujo de TensorFlow para predicción de edad de abalones ilustra el seguimiento de extremo a extremo y la trazabilidad

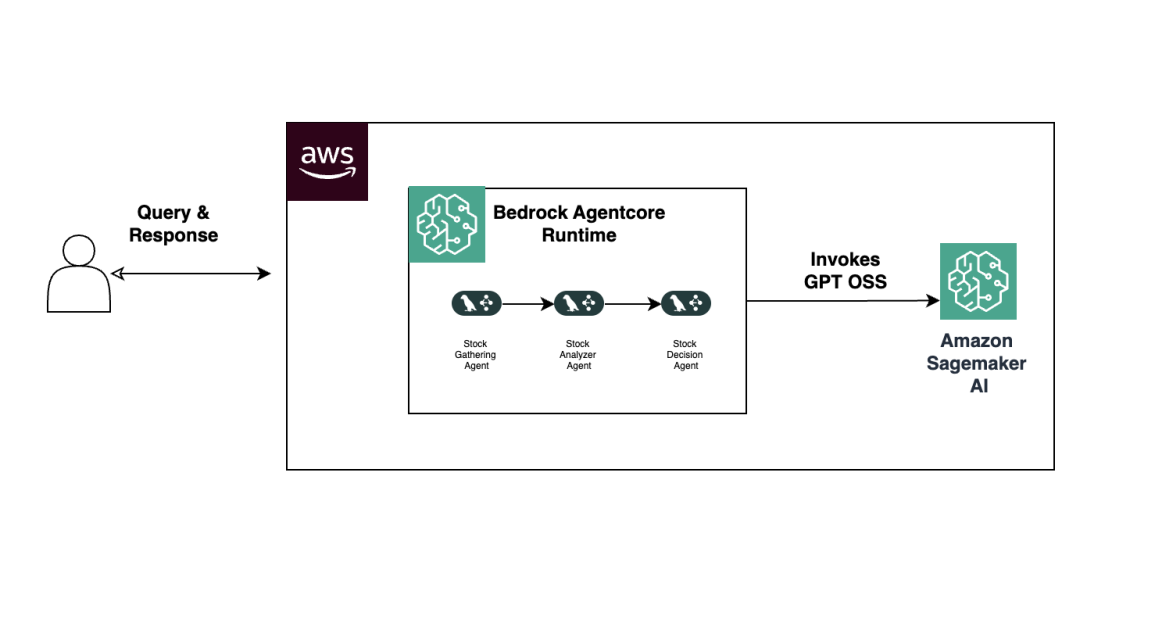

Construir Flujos de Trabajo Agenticos con GPT OSS de OpenAI en SageMaker AI y Bedrock AgentCore

Visión general de extremo a extremo para implementar modelos GPT OSS de OpenAI en SageMaker AI y Bedrock AgentCore, impulsando un analizador de acciones multiagente con LangGraph, con cuantización MXFP4 de 4 bits y orquestación serverless.