NVIDIA Jetson Thor: la plataforma definitiva para la IA física

Sources: https://developer.nvidia.com/blog/introducing-nvidia-jetson-thor-the-ultimate-platform-for-physical-ai, https://developer.nvidia.com/blog/introducing-nvidia-jetson-thor-the-ultimate-platform-for-physical-ai/, NVIDIA Dev Blog

TL;DR

- NVIDIA presenta Jetson Thor, la plataforma definitiva para IA física, que une GPU Blackwell, 128 GB de memoria y MIG para robótica de borde.

- Ofrece hasta 7,5x más cómputo de IA y hasta 3,5x mejor eficiencia energética frente a Jetson AGX Orin, con cuantización nativa FP4 y un Transformer Engine que cambia dinámicamente entre FP4 y FP8 para optimizar rendimiento.

- Soporta múltiples modelos de IA generativa en el borde (LLMs, VLMs, modelos VLA) y procesamiento multimodal en tiempo real, con demostraciones de 16 solicitudes simultáneas.

- La plataforma se completa con el Jetson AGX Thor Developer Kit y el módulo Jetson T5000, JetPack 7, CUDA 13.0 para ARM y pilas de software como Isaac, Metropolis y Holoscan.

- MIG y una consola de E/S robusta (QSFP 4x25 GbE, RJ-45, USB) permiten prototipado rápido para robots humanoides y autónomos.

Contexto y antecedentes

La robótica está evolucionando hacia plataformas generalistas que pueden aprender, adaptarse y operar en entornos variados sin necesidad de reprogramación para cada tarea. Inspiradas en la cognición humana, estas máquinas combinan respuestas rápidas con planificación de alto nivel para facilitar el aprendizaje y la adaptación. NVIDIA presentó el ecosistema Isaac GR00T en GTC 2025, que reúne modelos de robótica, pipelines de datos sintéticos, un entorno de simulación y una computadora en tiempo real. Con ello, Jetson Thor extiende este marco al borde para acelerar modelos de base y procesamiento multimodal en robots de próxima generación. Jetson Thor permite a los robots reorientarse para nuevas tareas sin reprogramación, soportando manipulación de objetos, navegación y seguir instrucciones a gran escala. NVIDIA describe a Thor como un salto enorme en IA de borde para robótica física.

Qué hay de nuevo

Jetson Thor se apoya en dos productos principales: NVIDIA Jetson AGX Thor Developer Kit y NVIDIA Jetson T5000 module. El kit ofrece rendimiento y escalabilidad incomparables para robótica de borde, impulsado por la GPU NVIDIA Blackwell, con 128 GB de memoria y un rango de potencia de 130 W. Proporciona hasta 2070 FP4 TFLOPS de cómputo IA para ejecutar los últimos modelos generativos en el borde, con hasta 7,5x más cómputo IA y 3,5x mejor eficiencia energética que Orin. La plataforma introduce cuantización FP4 nativa con un Transformer Engine de próxima generación que cambia dinámicamente entre FP4 y FP8 para optimizar rendimiento. Puntos clave de hardware y software:

- CPU de 14 núcleos Arm Neoverse-V3AE y una suite de aceleradores, que incluye un PVA de tercera generación, codificadores/decodificadores dobles y un acelerador de flujo óptico.

- MIG (Multi-Instance GPU), que permite particionar la GPU en instancias aisladas con recursos dedicados para cargas de trabajo predecibles.

- E/S extensa, incluyendo ranura QSFP con 4x25 GbE, conector RJ-45 Multi-GbE, múltiples puertos USB y otras opciones de conectividad para una integración rápida de sensores.

- Compatibilidad con plataformas robóticas humanoides y tethering sencillo para prototipado rápido. En el software, Jetson Thor ejecuta la pila de software de NVIDIA para IA física, que incluye NVIDIA Isaac para robótica, NVIDIA Metropolis para IA visual agentiva y NVIDIA Holoscan para procesamiento de sensores. La plataforma admite una amplia gama de modelos de IA generativa, desde LLMs hasta VLMs y VLAs, con Cosmos Reason 7B VLM para razonamiento físico. NVIDIA detalla estos componentes y su integración.

Por qué importa (impacto para desarrolladores/empresas)

Jetson Thor está diseñado para permitir que los desarrolladores desplieguen agentes de IA adaptables que razonen sobre tareas variadas sin reprogramación constante. Al acelerar modelos de base en el borde, Thor habilita robots con planificación de alto nivel, percepción robusta y control sensible en entornos dinámicos. Esto es especialmente crítico para automatización industrial, logística, robótica de servicios y sistemas autónomos, donde la latencia baja, el rendimiento predecible y la seguridad son esenciales. La capacidad de ejecutar múltiples modelos de IA generativa en el borde, con MIG para el aislamiento, facilita despliegues complejos y confiables. NVIDIA ofrece más contexto sobre impactos y casos de uso.

Detalles técnicos o Implementación (para practicantes)

Jetson Thor integra una pila de hardware y software diseñada para cargas de trabajo robóticas de borde en tiempo real y multimodal. Consideraciones técnicas clave:

- Cuantificación e inferencia: FP4 nativo con Transformer Engine dinámico (FP4/FP8) para mayor throughput y mejor uso de la memoria; decodificación especulativa acelera la generación proponiendo tokens con un modelo menor que luego es validado.

- Generación a escala edge: capacidad para ejecutar múltiples modelos de IA generativa (LLMs, VLMs, VLAs) simultáneamente con latencia baja en entornos de borde.

- Software de borde: pila optimizada para borde, alineada con SBSA para interoperabilidad empresarial y fusiones rápidas de sensores, planificación y control.

- Ecosistema: Isaac, Metropolis y Holoscan trabajan juntos para soportar agentes de IA en borde y procesamiento de sensores. NVIDIA describe la integración.

- Despliegue y alineación empresarial: CUDA 13.0 en ARM facilita la consistencia entre entornos de servidor y borde, simplificando la portabilidad de software. SBSA figura como marco de referencia para hardware/firmware. NVIDIA discute esto.

- Rendimiento y benchmarks: mejoras de hasta 5x frente a Orin en modelos generativos y beneficios con FP4 y decodificación especulativa. En pruebas, Qwen2.5-VL-7B logró hasta 3,5x de velocidad de inferencia en Thor frente a Orin con FP4 y decodificación Eagle frente a W4A16. Estos números ilustran la capacidad de Thor para cargas complejas de razonamiento en tiempo real. NVIDIA proporciona detalles de las cifras y configuraciones.

Puntos clave

- Thor es una plataforma de IA física de borde con flexibilidad para múltiples tareas sin reprogramación constante.

- Beneficios sustanciales en cómputo IA y eficiencia energética frente a generaciones anteriores, impulsados por FP4/FP8, MIG y 128 GB de memoria.

- Soporta un abanico de modelos generativos (LLMs, VLMs, VLAs) y procesamiento en tiempo real de sensores.

- Stack de software completo (JetPack 7, CUDA 13.0 en ARM, Isaac, Metropolis, Holoscan) para prototipado y despliegue.

- Conectividad robusta y aislamiento MIG para despliegues robóticos mixtos y predecibles.

FAQ

-

¿Cómo ayuda FP4?

FP4, con un Transformer Engine dinámico (FP4/FP8), aumenta el rendimiento de inferencia y la eficiencia de memoria, manteniendo la precisión mediante decodificación especulativa. [NVIDIA](https://developer.nvidia.com/blog/introducing-nvidia-jetson-thor-the-ultimate-platform-for-physical-ai/)

-

¿Qué cargas de trabajo soporta Thor?

Soporta modelos generativos variados (LLMs, VLMs, VLAs) para tareas robóticas como manipulación, navegación e instrucciones en borde. [NVIDIA](https://developer.nvidia.com/blog/introducing-nvidia-jetson-thor-the-ultimate-platform-for-physical-ai/)

-

¿Cómo se compara con Orin?

Hasta 7,5x más cómputo IA y 3,5x mejor eficiencia energética; mejoras de hasta 5x en modelos generativos con FP4 y decodificación especulativa. [NVIDIA](https://developer.nvidia.com/blog/introducing-nvidia-jetson-thor-the-ultimate-platform-for-physical-ai/)

-

¿Qué stack de software incluye?

JetPack 7, Linux kernel 6.8 y Ubuntu 24.04 LTS, con Isaac, Metropolis y Holoscan para IA en borde. [NVIDIA](https://developer.nvidia.com/blog/introducing-nvidia-jetson-thor-the-ultimate-platform-for-physical-ai/)

Referencias

More news

NVIDIA HGX B200 reduce la intensidad de las emisiones de carbono incorporado

El HGX B200 de NVIDIA reduce la intensidad de carbono incorporado en un 24% frente al HGX H100, al tiempo que ofrece mayor rendimiento de IA y eficiencia energética. Este artículo resume los datos PCF y las novedades de hardware.

Predecir Eventos Climáticos Extremos en Minutos sin Supercomputadora: Huge Ensembles (HENS)

NVIDIA y Berkeley Lab presentan Huge Ensembles (HENS), una herramienta de IA de código abierto que pronostica eventos climáticos raros y de alto impacto usando 27,000 años de datos, con opciones de código abierto o listas para usar.

Cómo reducir cuellos de botella KV Cache con NVIDIA Dynamo

NVIDIA Dynamo offloads KV Cache desde la memoria de la GPU hacia almacenamiento económico, habilitando contextos más largos, mayor concurrencia y costos de inferencia más bajos para grandes modelos y cargas de IA generativa.

Microsoft transforma el sitio de Foxconn en el data center Fairwater AI, descrito como el más poderoso del mundo

Microsoft anuncia planes para un data center Fairwater AI de 1,2 millones de pies cuadrados en Wisconsin, con cientos de miles de GPU Nvidia GB200. El proyecto de 3.3 mil millones de dólares promete un entrenamiento de IA sin precedentes.

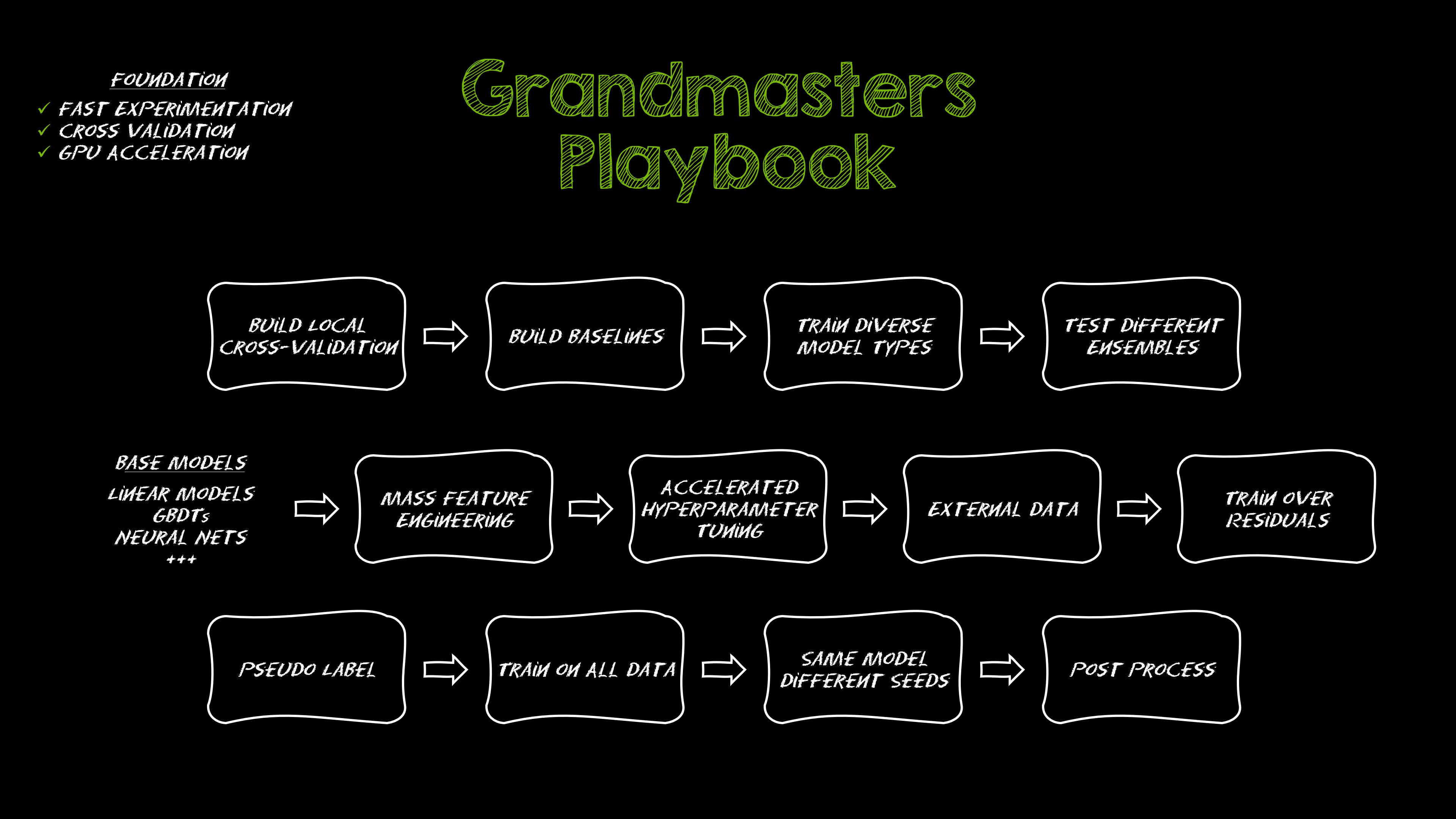

Manual de los Grandmasters de Kaggle: 7 Técnicas de Modelado para Datos Tabulares

Un análisis detallado de siete técnicas probadas por los Grandmasters de Kaggle para resolver rápidamente conjuntos de datos tabulares mediante aceleración por GPU, desde baselines variados hasta ensamblaje y pseudo-etiquetado.

NVIDIA RAPIDS 25.08 Agrega Nuevo profiler para cuML, Mejoras en el motor GPU de Polars y Soporte Ampliado de Algoritmos

RAPIDS 25.08 introduce perfiles de nivel de función y de línea para cuml.accel, el ejecutor de streaming por defecto del motor Polars GPU, soporte ampliado de tipos y cadenas, Spectral Embedding en cuML y aceleraciones de cero código para varios estimadores.