PwC y AWS Construyen IA Responsable con Razonamiento Automatizado en Amazon Bedrock

Sources: https://aws.amazon.com/blogs/machine-learning/pwc-and-aws-build-responsible-ai-with-automated-reasoning-on-amazon-bedrock, aws.amazon.com

TL;DR

- PwC y AWS integran controles de Razonamiento Automatizado en Guardrails de Amazon Bedrock para verificar salidas de IA frente a reglas de políticas formales.

- La propuesta se dirige a industrias reguladas y busca convertir la conformidad con la EU AI Act en un proceso sistemático, auditable y con verificación matemática.

- PwC, Regulated Content Orchestrator (RCO) y Guardrails muestran cómo la verificación automática puede fortalecer el cumplimiento y acelerar la creación de contenido.

- Los casos de uso iniciales incluyen cumplimiento de la EU AI Act, contenido regulado con RCO y gestión de interrupciones eléctricas con flujos de verificación por severidad.

- Los controles de Razonamiento Automatizado prometen mejorar la confiabilidad de las aplicaciones de IA al entregar artefactos auditable y mayor precisión de verificación.

Contexto y antecedentes

En un entorno globalmente competitivo, escalar importa, pero la confianza, la seguridad y la verificabilidad son esenciales para la adopción responsable de IA. El Razonamiento Automatizado busca pruebas matemáticas mediante búsqueda algorítmica. En Guardrails de Bedrock, estos checks codifican el conocimiento en lógica formal para validar si las salidas de los modelos de lenguaje grandes (LLMs) son posibles dentro de reglas definidas. Estos checks buscan mantener la exactitud dentro de parámetros y se distinguen de enfoques puramente probabilísticos, evaluando el contenido generado contra documentos de políticas, directrices y estándares operativos para producir hallazgos de alineación, ambigüedades y sugerencias para eliminar suposiciones. La disponibilidad general de estos checks se anunció para el 6 de agosto de 2025. Publicación PwC/AWS. PwC aporta experiencia profunda en la industria y AWS brinda la infraestructura Bedrock Guardrails capaz de codificar y verificar reglas de políticas. La alianza busca transformar la forma en que las organizaciones implementan IA, combinando la experiencia de PwC con verificación automática y matemática. El enfoque inicial se centra en sectores altamente regulados como farmacéutica, servicios financieros y energía, con un énfasis en la verificación formal para aumentar la confianza. La EU AI Act exige clasificar y verificar las aplicaciones de IA por nivel de riesgo y gobernanza. PwC propone un enfoque práctico que traduce criterios de clasificación de riesgo en guardrails definidos, permitiendo una evaluación y monitoreo consistentes con artefactos verificables que respaldan el juicio humano. PwC’s Regulated Content Orchestrator (RCO) es una capacidad global, escalable y multiagente impulsada por un motor de reglas central, personalizable por empresa, región, producto e indicación de uso, que automatiza el cumplimiento médico, legal, regulatorio y de marca. RCO fue un colaborador temprano con las verificaciones de Razonamiento Automatizado de Bedrock, implementándolas como una capa de validación secundaria en el proceso de generación de contenido de marketing. Esta arquitectura fortaleció controles existentes, aceleró la creación y revisión de contenido y elevó los estándares de cumplimiento.

Qué hay de nuevo

- Las verificaciones de Razonamiento Automatizado en Amazon Bedrock Guardrails permiten verificar salidas IA frente a reglas formales, con artefactos auditable y hallazgos de alineación.

- El cumplimiento de la EU AI Act se aborda mediante guardrails que transforman criterios de clasificación de riesgo en verificaciones automatizadas, con artefactos auditable.

- El RCO demuestra cómo la gobernanza multiagente puede escalar la conformidad en dominios como medicina, legal y contenido de marca.

- Un caso práctico de gestión de interrupciones eléctricas muestra cómo una arquitectura en la nube puede aplicar flujos de verificación basados en severidad para decisiones de despacho.

- La alianza subraya la IA responsable como componente clave de la innovación, combinando la experiencia de PwC con la tecnología Guardrails de AWS para mejorar la confianza y la gobernanza.

Por qué importa (impacto para desarrolladores/empresas)

Para desarrolladores y empresas, los checks de Razonamiento Automatizado ofrecen una vía para acelerar la adopción de IA sin sacrificar la confianza, la precisión o la conformidad. Al verificar salidas de IA frente a reglas formales y generar artefactos auditable, las organizaciones pueden reducir el riesgo de no conformidad, acortar el tiempo de comercialización de soluciones reguladas y proporcionar evidencia de gobernanza transparente. La alianza destaca que el razonamiento formal complementa métodos probabilísticos al introducir verificaciones explícitas que permiten identificar ambigüedades y suposiciones no respaldadas en las salidas de IA. A medida que crece la IA con agentes, Guardrails con Razonamiento Automatizado pueden convertirse en un componente central de las prácticas de IA responsable, ayudando a las organizaciones a implementar IA a gran escala sin comprometer seguridad o conformidad.

Detalles técnicos o Implementación

Las verificaciones de Razonamiento Automatizado en Beds Bedrock Guardrails codifican el conocimiento de documentos de políticas y normas en lógica formal. Cuando una LLM genera contenido, las verificaciones evalúan si el contenido podría derivarse de las reglas definidas. El sistema produce hallazgos sobre alineación, señala ambigüedades y sugiere cómo eliminar suposiciones. El objetivo es lograr una mayor precisión de verificación y artefactos auditable que respalden el juicio humano. El Regulated Content Orchestrator (RCO) es descrito como una capacidad global multiagente con un motor de reglas central, personalizable por región, producto e indicación de uso, que automatiza la conformidad médica, legal, regulatoria y de marca. PwC lo ha utilizado como capa de validación secundaria para contenido de marketing. Esta configuración fortalece controles, acelera la creación y revisión de contenido y mejora las normas de conformidad. En una aplicación práctica, las verificaciones de Razonamiento Automatizado ayudan a la conformidad con la EU AI Act al convertir criterios de clasificación de riesgo en guardrails verificables, con artefactos auditable que sostienen el juicio humano. El caso de gestión de interrupciones eléctricas demuestra cómo una arquitectura en la nube puede aplicar flujos de verificación basados en severidad para decisiones de despacho. Las interrupciones normales, con un objetivo de 3 horas, se asignan a equipos disponibles; interrupciones de severidad media, con objetivo de 6 horas, disparan despacho acelerado; incidentes críticos, con objetivo de 12 horas, activan procedimientos de emergencia con mensajes proactivos. Los checks Guardrails ayudan a asegurar que las clasificaciones y las decisiones de despacho cumplan con normas regulatorias y operativas.

Puntos clave

- Los checks de Razonamiento Automatizado proporcionan una verificación formal con artefactos auditable para salidas de IA en Bedrock Guardrails.

- La asociación PwC–AWS se orienta a sectores regulados para acelerar la adopción de IA segura, respetando requisitos de gobernanza como la EU AI Act.

- RCO ilustra cómo la gobernanza multiagente puede escalar la conformidad a través de dominios como medicina, contenido regulado y marca.

- Los casos de uso muestran beneficios prácticos en velocidad, precisión y confianza en IA.

- Las organizaciones pueden contactar a los equipos de AWS o PwC para soluciones a medida y asesoría de implementación.

FAQ

-

¿Qué son los checks de Razonamiento Automatizado en Bedrock Guardrails?

Son verificaciones que codifican conocimiento de políticas en lógica formal para verificar si las salidas de IA cumplen las reglas definidas, con artefactos auditable; disponibilidad general anunciada el 6 de agosto de 2025. [Publicación PwC/AWS](https://aws.amazon.com/blogs/machine-learning/pwc-and-aws-build-responsible-ai-with-automated-reasoning-on-amazon-bedrock).

-

¿Cómo ayuda esto con la conformidad de la EU AI Act?

Transforma criterios de clasificación de riesgo en guardrails verificables, con artefactos auditable para respaldar el juicio humano. [Publicación PwC/AWS](https://aws.amazon.com/blogs/machine-learning/pwc-and-aws-build-responsible-ai-with-automated-reasoning-on-amazon-bedrock).

-

¿Qué es el Regulated Content Orchestrator (RCO)?

Es una capacidad global multiagente con un motor central de reglas, personalizable por región/producto/indicación, que automatiza la conformidad médica, legal, regulatoria y de marca; utilizado como capa de validación secundaria para contenido de marketing. [Publicación PwC/AWS](https://aws.amazon.com/blogs/machine-learning/pwc-and-aws-build-responsible-ai-with-automated-reasoning-on-amazon-bedrock).

-

¿Cómo pueden las organizaciones adoptar esta tecnología?

Contactando a los equipos de AWS o PwC para soluciones personalizadas y orientación de implementación que combinen los checks de Razonamiento Automatizado con la experiencia del sector. [Publicación PwC/AWS](https://aws.amazon.com/blogs/machine-learning/pwc-and-aws-build-responsible-ai-with-automated-reasoning-on-amazon-bedrock).

-

¿Qué casos de uso se destacan como implementaciones iniciales?

Conformidad EU AI Act, contenido regulado con RCO y gestión de interrupciones eléctricas con flujos de verificación por severidad. [Publicación PwC/AWS](https://aws.amazon.com/blogs/machine-learning/pwc-and-aws-build-responsible-ai-with-automated-reasoning-on-amazon-bedrock).

Referencias

More news

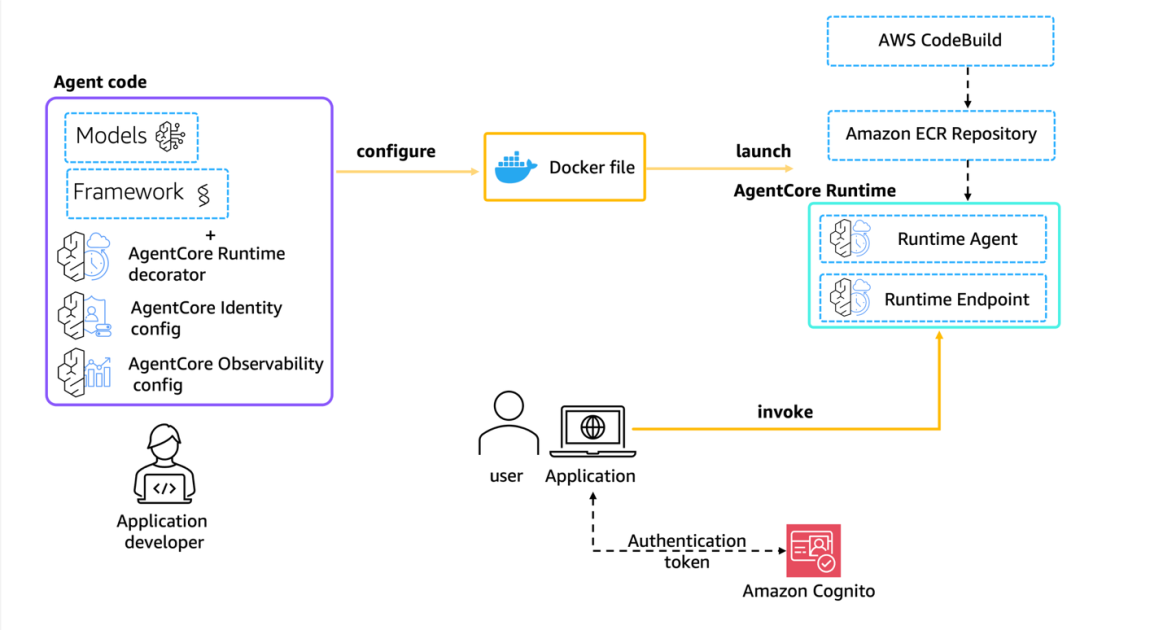

Llevar agentes de IA de concepto a producción con Amazon Bedrock AgentCore

Análisis detallado de cómo Amazon Bedrock AgentCore facilita la transición de aplicaciones de IA basadas en agentes desde un concepto de prueba hasta sistemas de producción empresariales, conservando memoria, seguridad, observabilidad y gestión escalable de herramientas.

Monitorear la inferencia por lotes de Bedrock de AWS con métricas de CloudWatch

Descubra cómo monitorear y optimizar trabajos de inferencia por lotes de Bedrock con métricas, alarmas y paneles de CloudWatch para mejorar rendimiento, costos y operación.

Solicitando precisión con Stability AI Image Services en Amazon Bedrock

Bedrock incorpora Stability AI Image Services con nueve herramientas para crear y editar imágenes con mayor precisión. Descubre técnicas de prompting para uso empresarial.

Escala la producción visual con Stability AI Image Services en Amazon Bedrock

Stability AI Image Services ya está disponible en Amazon Bedrock, ofreciendo capacidades de edición de imágenes listas para usar a través de la API de Bedrock y ampliando los modelos Stable Diffusion 3.5 y Stable Image Core/Ultra ya presentes.

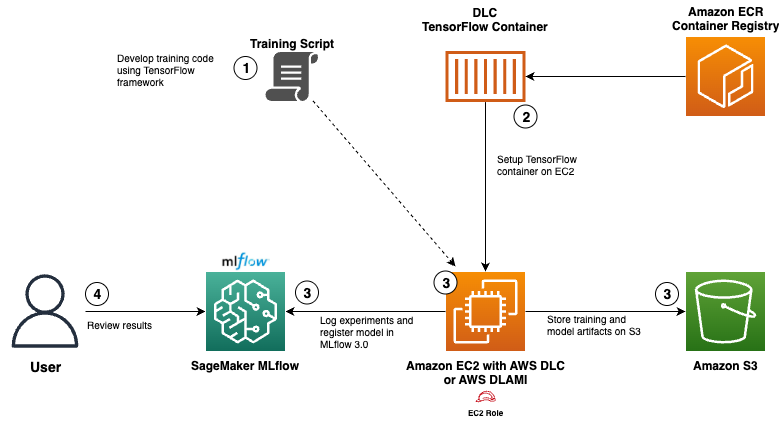

Usar AWS Deep Learning Containers con Amazon SageMaker AI MLflow gestionado

Vea cómo los AWS Deep Learning Containers (DLCs) se integran con SageMaker AI gestionado por MLflow para equilibrar el control de la infraestructura y una gobernanza de ML sólida. Un flujo de TensorFlow para predicción de edad de abalones ilustra el seguimiento de extremo a extremo y la trazabilidad

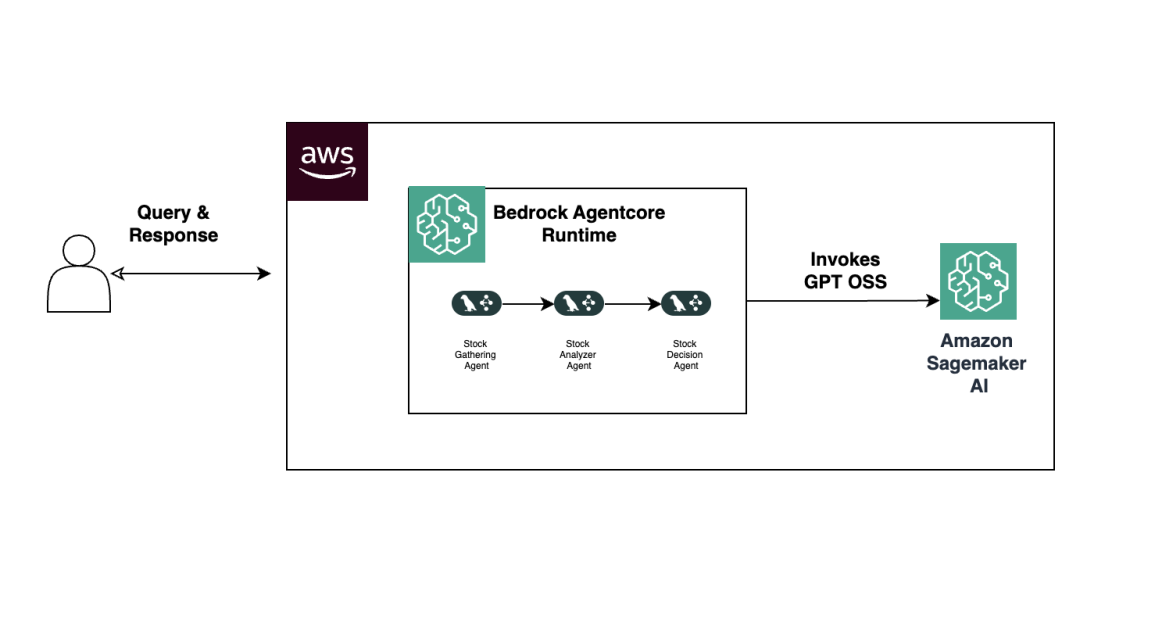

Construir Flujos de Trabajo Agenticos con GPT OSS de OpenAI en SageMaker AI y Bedrock AgentCore

Visión general de extremo a extremo para implementar modelos GPT OSS de OpenAI en SageMaker AI y Bedrock AgentCore, impulsando un analizador de acciones multiagente con LangGraph, con cuantización MXFP4 de 4 bits y orquestación serverless.