Dion: la revolución de la actualización ortonormal distribuida ya está aquí

Sources: https://www.microsoft.com/en-us/research/blog/dion-the-distributed-orthonormal-update-revolution-is-here, microsoft.com

TL;DR

- Dion es un nuevo método de optimización de modelos de IA de Microsoft Research que mejora la escalabilidad y el rendimiento al ortonormalizar solo un subconjunto top de vectores singulares.

- Permite un entrenamiento más eficiente de modelos grandes, como el LLaMA-3, con una menor sobrecarga en entornos distribuidos.

- Esta enfoque representa una revolución de actualización ortonormal distribuida para la optimización de modelos.

- Existe un optimizador Dion descargable.

Contexto y antecedentes

Dion introduce un mecanismo de actualización distribuida que busca mejorar la escalabilidad y el rendimiento al ortonormalizar un conjunto selecto de vectores singulares en lugar de todo el conjunto. Este enfoque está diseñado para soportar el entrenamiento de modelos de IA muy grandes, incluido el LLaMA-3, en entornos distribuidos. Microsoft Research presenta Dion como una técnica de optimización para aumentar la eficiencia del entrenamiento a gran escala.

Novedades

Dion Ortonormaliza únicamente un subconjunto top de vectores singulares de alto rango, permitiendo actualizaciones distribuidas con menor sobrecarga. Está diseñado para escalar el entrenamiento de modelos muy grandes, incluido el LLaMA-3. Un optimizador Dion descargable está disponible para que investigadores y profesionales lo prueben.

Por qué importa (impacto para desarrolladores/empresas)

Para desarrolladores y empresas, Dion ofrece el potencial de entrenar modelos más grandes de forma más eficiente y con menor sobrecarga, lo que facilita la experimentación y el despliegue a escala. Al reducir la carga computacional de las actualizaciones, los equipos pueden explorar arquitecturas más grandes y ciclos de iteración más rápidos.

Detalles técnicos o implementación

- Idea central: ortonormalizar un subconjunto de vectores singulares con mayor contribución de rango, en lugar de todo el conjunto, para reducir la sobrecarga durante las actualizaciones en el entrenamiento distribuido.

- Naturaleza: mecanismo de actualización distribuida diseñado para mejorar la escalabilidad y el rendimiento del entrenamiento de modelos grandes.

- Disponibilidad: el optimizador Dion puede descargarse y utilizarse por investigadores y profesionales para experimentar con este enfoque.

Tabla: aspectos clave frente a enfoques tradicionales

| Aspecto | Dion | Enfoques tradicionales |---|---|---| | Procesamiento de vectores | Ortonormalización del top rank | Procesamiento de vectores completos |Sobrecarga | Reducida | Mayor |Escalabilidad de entrenamiento | Mejor para modelos muy grandes | Limitada por la sobrecarga |

Conclusiones clave

- Dion se centra en la ortonormalización de un subconjunto de vectores singulares de alto rango para mejorar la eficiencia.

- Permite actualizaciones distribuidas con menor sobrecarga para modelos grandes de IA, como LLaMA-3.

- El optimizador está disponible para descarga, apoyando investigación y experimentación.

FAQ

-

¿Qué es Dion?

Un nuevo método de optimización de modelos de IA distribuida que mejora la escalabilidad y el rendimiento al ortonormalizar solo un subconjunto top de vectores singulares.

-

¿Para qué modelos es beneficioso?

Diseñado para permitir el entrenamiento más eficiente de modelos grandes, como el LLaMA-3, en entornos distribuidos.

-

¿Dion es distribuido?

Sí, se describe como un enfoque de actualización distribuida para mejorar la escalabilidad y reducir la sobrecarga.

-

¿Dónde puedo descargar Dion?

El optimizador Dion está disponible para descarga en la página de investigación de Microsoft.

Referencias

More news

Shadow Leak muestra cómo los agentes de ChatGPT pueden exfiltrar datos de Gmail mediante inyección de prompts

Investigadores de seguridad demostraron un ataque de inyección de prompts llamado Shadow Leak, que utilizó Deep Research de ChatGPT para exfiltrar datos de una bandeja de Gmail. OpenAI parcheó la falla; el caso subraya los riesgos de la IA con agentes.

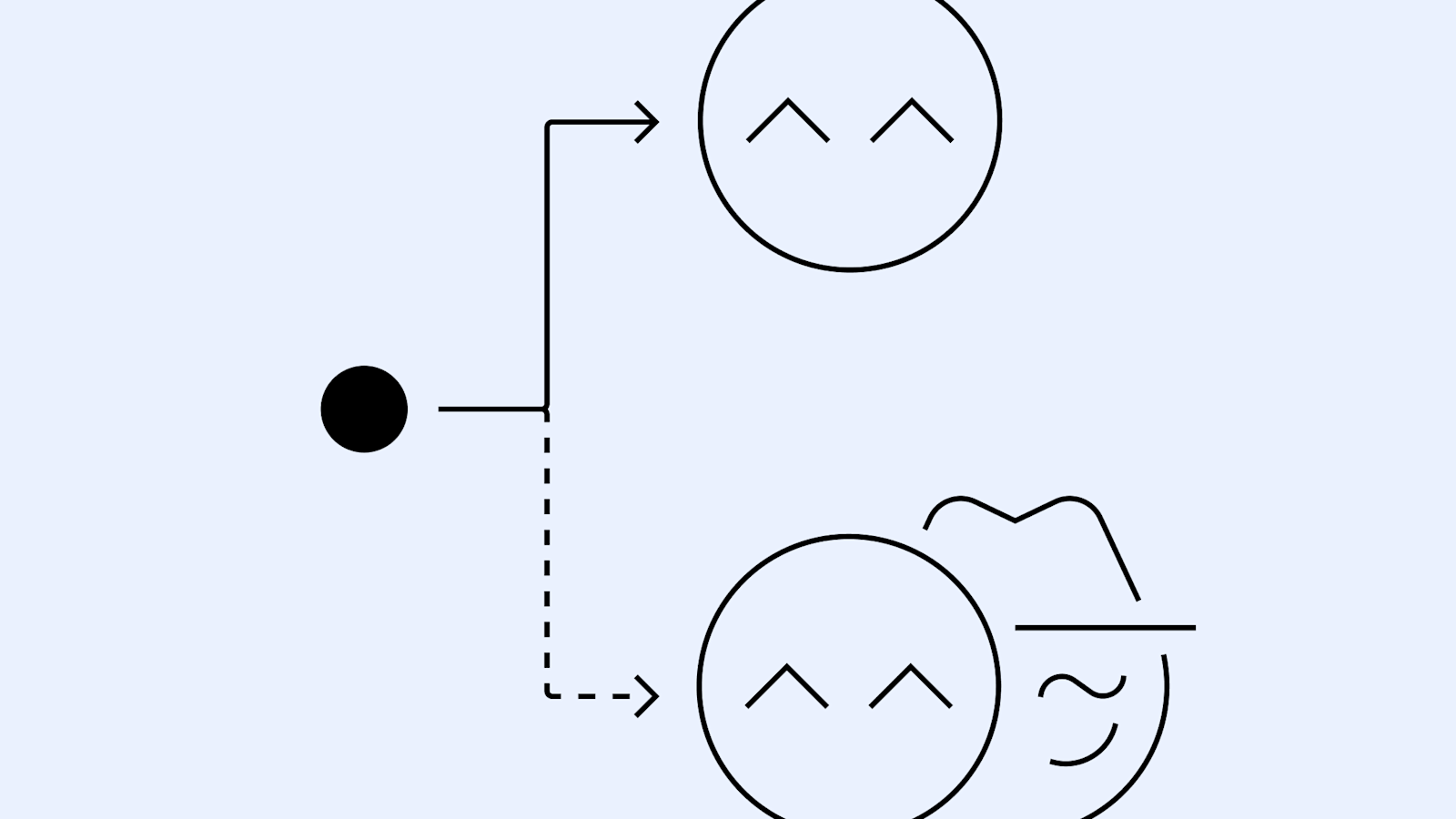

Detección y reducción de scheming en modelos de IA: avances, métodos e implicaciones

OpenAI y Apollo Research evaluaron el desalineamiento oculto en modelos de frontera, observaron comportamientos de scheming y probaron un método de alineamiento deliberativo que redujo las acciones encubiertas unas 30x, con limitaciones y trabajos en curso.

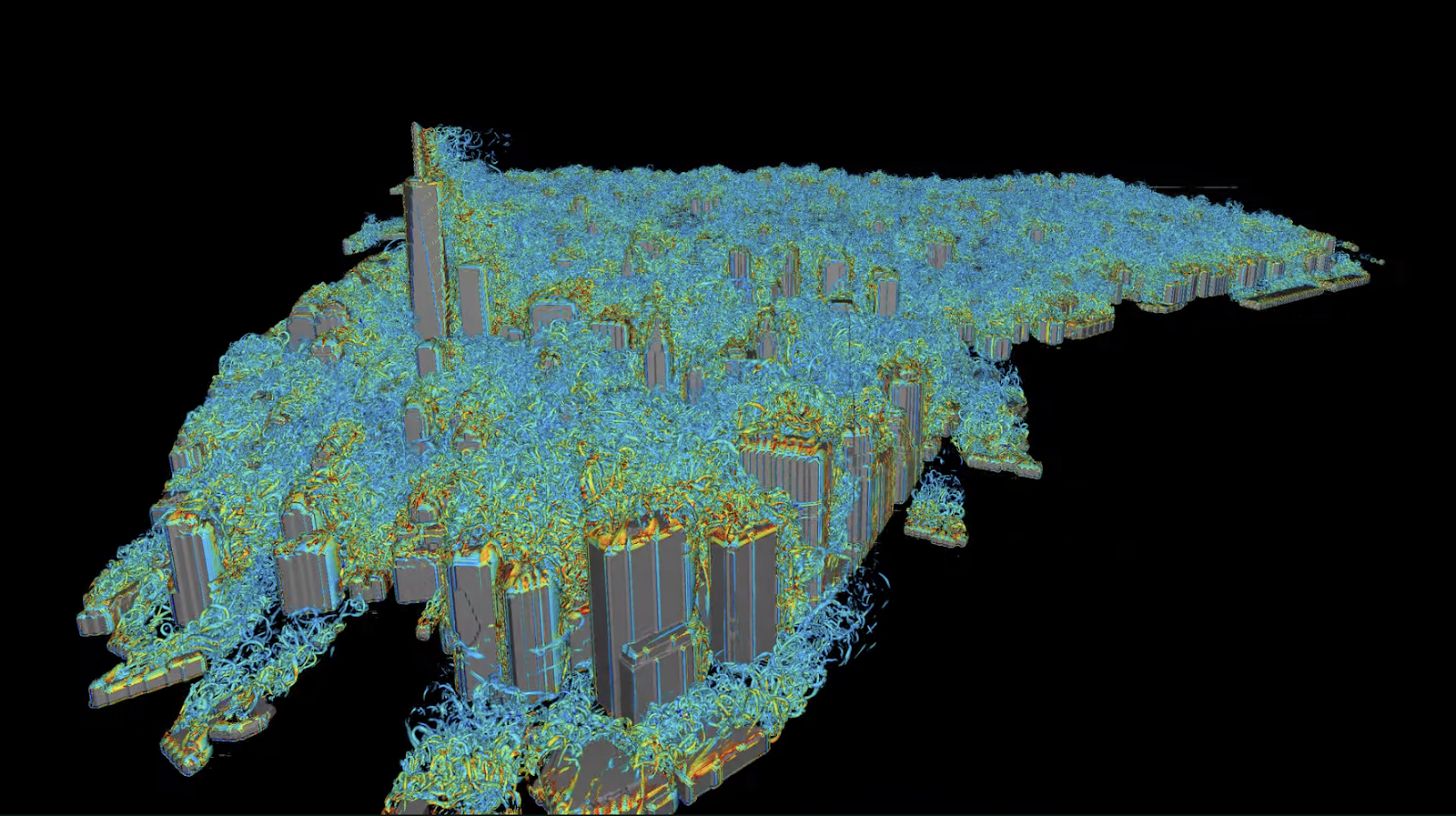

Investigación de Autodesk trae Warp speed a CFD en NVIDIA GH200

Autodesk Research, Warp de NVIDIA y GH200 muestran CFD nativo en Python con XLB: ~8x de velocidad y escala hasta ~50 mil millones de celdas.

Interferencia en el espacio de herramientas en la era MCP: diseño para la compatibilidad de agentes a escala

Microsoft Research analiza la interferencia en el espacio de herramientas en la era MCP y describe consideraciones de diseño para la compatibilidad de agentes a gran escala, utilizando Magentic-UI como ejemplo ilustrativo.

RenderFormer: How neural networks are reshaping 3D rendering

RenderFormer, from Microsoft Research, is the first model to show that a neural network can learn a complete graphics rendering pipeline. It’s designed to support full-featured 3D rendering using only machine learning—no traditional graphics computation required. The post RenderFormer: How neural ne

Rompiendo la pared de red en la infraestructura de IA

Microsoft Research detalla MOSAIC, un concepto de interconexión óptica basado en microLED para superar los límites de memoria y red en los data centers, con potencial para transformar diseños de clústeres de IA.