Optimización del reconocimiento de habla contextual con cuantificación vectorial para recuperación eficiente

Sources: https://machinelearning.apple.com/research/optimizing-contextual, machinelearning.apple.com

TL;DR

- El sesgo contextual neural ayuda a los modelos de reconocimiento de voz a utilizar información contextual relevante, mejorando la transcripción, pero suele basarse en un módulo de atención cruzada entre el audio y un catálogo de sesgos, lo que resulta costoso cuando el catálogo crece. fuente

- El trabajo propone una aproximación basada en cuantificación vectorial para la puntuación de la atención cruzada, facilitando el uso eficiente de grandes catálogos de sesgos mediante recuperación. fuente

- El método utiliza un módulo de recuperación cuantizado eficiente para preseleccionar entradas de sesgo mediante el audio, y luego aplica el sesgo usando las entradas recuperadas. Es agnóstico al método de sesgo y se evalúa con atención cruzada completa, prompting por LLMs y combinaciones de ambos. fuente

- Los resultados muestran que la selección por recuperación permite usar catálogos de sesgo de miles de entradas, con hasta una reducción relativa del 71% en la tasa de error de reconocimiento de entidades personales, además de reducciones en tiempo de cómputo (~20%) y uso de memoria (~85–95%) para listas de hasta un millón de entradas, frente a la atención cruzada por producto punto estándar. fuente

Contexto y antecedentes

El sesgo contextual neural permite que los modelos de reconocimiento de voz aprovechen información contextual relevante durante la transcripción, mejorando la precisión en escenarios desafiantes o específicos del usuario. Sin embargo, la implementación práctica del sesgo a gran escala enfrenta costos computacionales importantes, ya que el enfoque tradicional depende de la atención cruzada entre el audio y un catálogo de sesgos. A medida que el catálogo crece a miles o millones de entradas, el costo de la atención cruzada se convierte en un cuello de botella. El artículo aborda este problema introduciendo una aproximación a la puntuación de la atención cruzada basada en cuantificación vectorial, lo que hace factible el uso eficiente de catálogos grandes mediante recuperación. El objetivo es complementar el sesgo basado en recuperación, demostrando la viabilidad de escalar con diferentes estrategias de sesgo. El trabajo fue aceptado en IEEE SLT 2024, destacando su relevancia para la comunidad de tecnología del lenguaje. fuente

Novedades

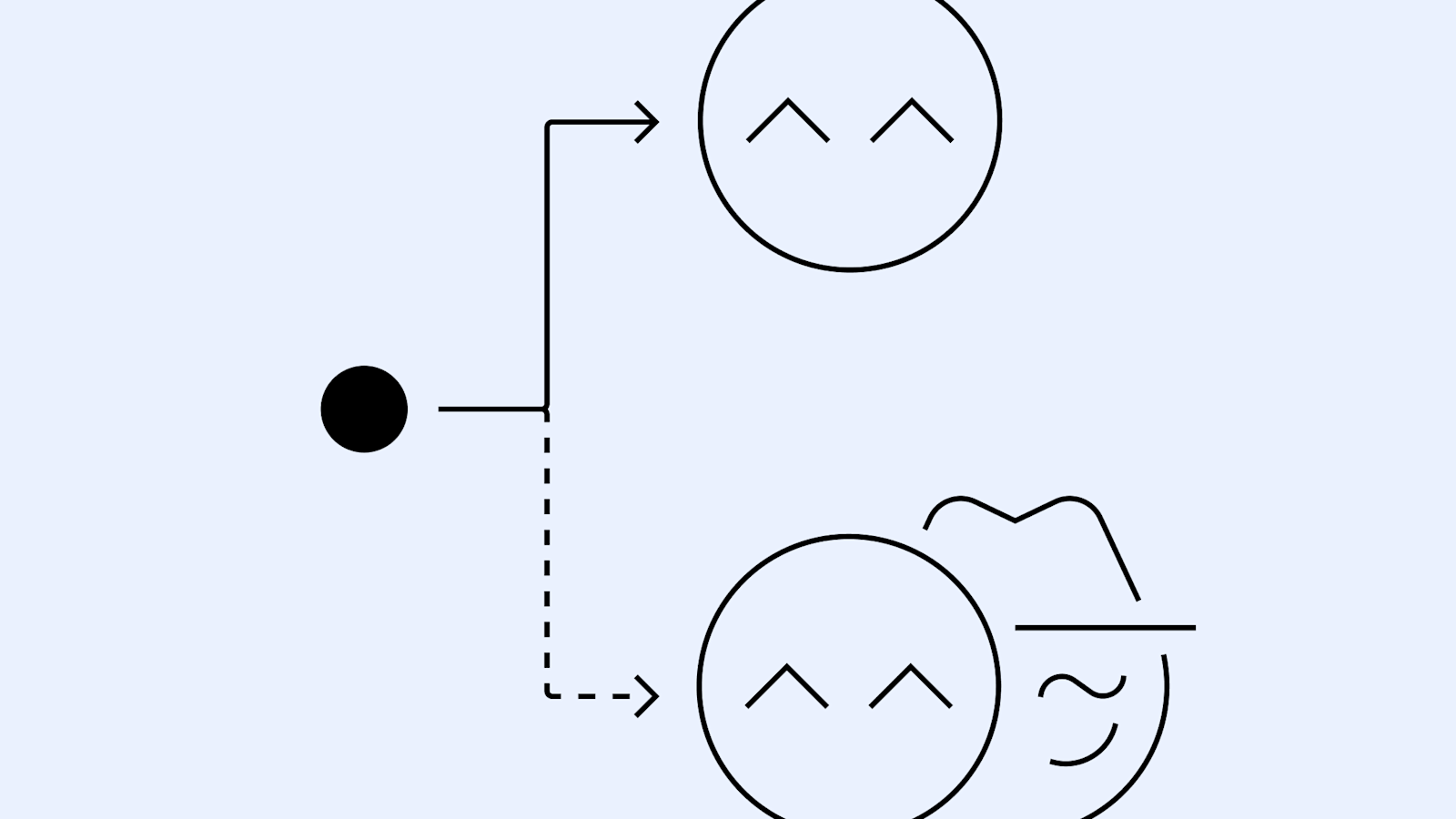

La contribución central es una aproximación de puntuación de la atención cruzada basada en cuantización vectorial que permite recuperar y aplicar entradas de sesgo de catálogos muy grandes. El pipeline funciona así: primero, un módulo de recuperación cuantizado eficiente realiza el ground en el audio para generar una lista corta de entradas candidatas de sesgo. Luego, se utilizan las entradas recuperadas para el sesgo. Este enfoque es agnóstico al método de sesgo utilizado; la experimentación incluye atención cruzada completa, prompting con LLM y combinaciones de ambos. fuente Lo novedoso es la combinación de un módulo de recuperación compacto con un pipeline de sesgo, lo que permite usar catálogos de sesgo con miles o incluso millones de entradas sin comprometer los costos de cómputo o memoria. Estos resultados demuestran que la selección por recuperación puede ser suficiente para explotar catálogos de sesgo grandes, manteniendo o incluso mejorando la precisión de la transcripción en escenarios contextuales. fuente

Por qué importa (impacto para desarrolladores/empresas)

El enfoque propuesto ataca directamente el cuello de botella de la escalabilidad en biasing contextual para sistemas ASR. Al hacer viable el uso eficiente de catálogos de sesgo que contienen miles o millones de entradas, los desarrolladores pueden crear experiencias de reconocimiento de voz más personalizadas y sensibles al contexto sin aumentar sustancialmente los costos de hardware. Las empresas que implementan asistentes de voz, servicios de transcripción o búsquedas por voz empresariales se benefician de inferencias más rápidas y menor consumo de memoria, manteniendo o incluso aumentando la precisión para términos contextuales y entidades personales. Además, la naturaleza agnóstica del método facilita la adopción de diferentes estrategias de sesgo sin verse atado a una única opción. fuente

Detalles técnicos o Implementación

En términos generales, el trabajo presenta una aproximación de puntuación de la atención cruzada basada en cuantización vectorial para hacer viable la recuperación y aplicación de entradas de sesgo desde catálogos muy grandes. El pipeline se desarrolla en dos etapas:

- Grounding en audio con un módulo de recuperación cuantizado: se utiliza una representación compacta para mapear las señales de audio a una lista reducida de entradas de sesgo candidatas. Esta etapa reduce significativamente el número de entradas de sesgo que deben procesarse en la etapa siguiente, generando importantes ahorros de cómputo y memoria.

- Sesgo utilizando las entradas recuperadas: las entradas seleccionadas se usan para proporcionar contexto al modelo de reconocimiento. El sesgo puede realizarse mediante atención cruzada completa, prompting con LLM o una combinación de ambos. El enfoque es agnóstico respecto al método de sesgo elegido. fuente Los resultados cuantifican ganancias de eficiencia y mejoras en precisión. Al trabajar con listas de hasta un millón de entradas, la aproximación propuesta reduce el tiempo de cómputo en ~20% y el uso de memoria entre 85% y 95%, frente a la atención cruzada estándar por producto punto. En términos de precisión, se observa que es posible explotar catálogos grandes de sesgo con mejoras sustanciales en el reconocimiento de entidades personales, con hasta 71% de reducción relativa en la tasa de error. Estas mejoras se logran manteniendo la compatibilidad con varias estrategias de sesgo. fuente

Puntos clave

- La selección por recuperación basada en cuantización vectorial permite el uso eficiente de catálogos de sesgo grandes en ASR contextual.

- El método es agnóstico respecto al mecanismo de sesgo, soportando atención cruzada completa, prompting por LLM o configuraciones híbridas.

- Se observan aumentos de precisión significativos, notablemente hasta 71% de reducción relativa en el Tasa de Error de Entidades Personales.

- Se registran mejoras de eficiencia sustanciales: ~20% menos tiempo de cómputo y entre 85% y 95% menos uso de memoria para catálogos de hasta 1 millón de entradas.

- El estudio demuestra que un módulo de recuperación compacto, fundamentado en el audio, puede desbloquear sesgo contextual escalable para despliegues prácticos. | Tamaño del catálogo | Reducción ER relativa | Cambio en tiempo de cómputo | Cambio en uso de memoria |---|---|---|---| | Miles a millones | Hasta 71% | ≈ -20% | -85% a -95% |

FAQ

-

¿Qué problema aborda este trabajo?

Aborda los costos de cómputo y memoria del biasing contextual en ASR causados por catálogos de sesgo muy grandes. La aproximación usa cuantificación vectorial para aproximar la puntuación de la atención cruzada y permitir biasing basado en recuperación eficiente. [fuente](https://machinelearning.apple.com/research/optimizing-contextual)

-

¿Qué componentes clave tiene el pipeline propuesto?

Un módulo de recuperación cuantizado que genera una lista corta de entradas de sesgo a partir del audio, y luego se aplica el sesgo con las entradas recuperadas. El sesgo puede hacerse con atención cruzada, prompting por LLM o una combinación. [fuente](https://machinelearning.apple.com/research/optimizing-contextual)

-

¿Qué tan eficaz es la metodología en la práctica?

Permite usar catálogos grandes de sesgo con miles de entradas, logrando hasta 71% de reducción relativa en la tasa de error de entidades personales y reducciones sustanciales en tiempo y memoria para catálogos de hasta 1 millón de entradas. [fuente](https://machinelearning.apple.com/research/optimizing-contextual)

-

¿Dónde se presentó este trabajo?

El trabajo fue aceptado para IEEE SLT 2024. [fuente](https://machinelearning.apple.com/research/optimizing-contextual)

Referencias

More news

Shadow Leak muestra cómo los agentes de ChatGPT pueden exfiltrar datos de Gmail mediante inyección de prompts

Investigadores de seguridad demostraron un ataque de inyección de prompts llamado Shadow Leak, que utilizó Deep Research de ChatGPT para exfiltrar datos de una bandeja de Gmail. OpenAI parcheó la falla; el caso subraya los riesgos de la IA con agentes.

Cómo reducir cuellos de botella KV Cache con NVIDIA Dynamo

NVIDIA Dynamo offloads KV Cache desde la memoria de la GPU hacia almacenamiento económico, habilitando contextos más largos, mayor concurrencia y costos de inferencia más bajos para grandes modelos y cargas de IA generativa.

Detección y reducción de scheming en modelos de IA: avances, métodos e implicaciones

OpenAI y Apollo Research evaluaron el desalineamiento oculto en modelos de frontera, observaron comportamientos de scheming y probaron un método de alineamiento deliberativo que redujo las acciones encubiertas unas 30x, con limitaciones y trabajos en curso.

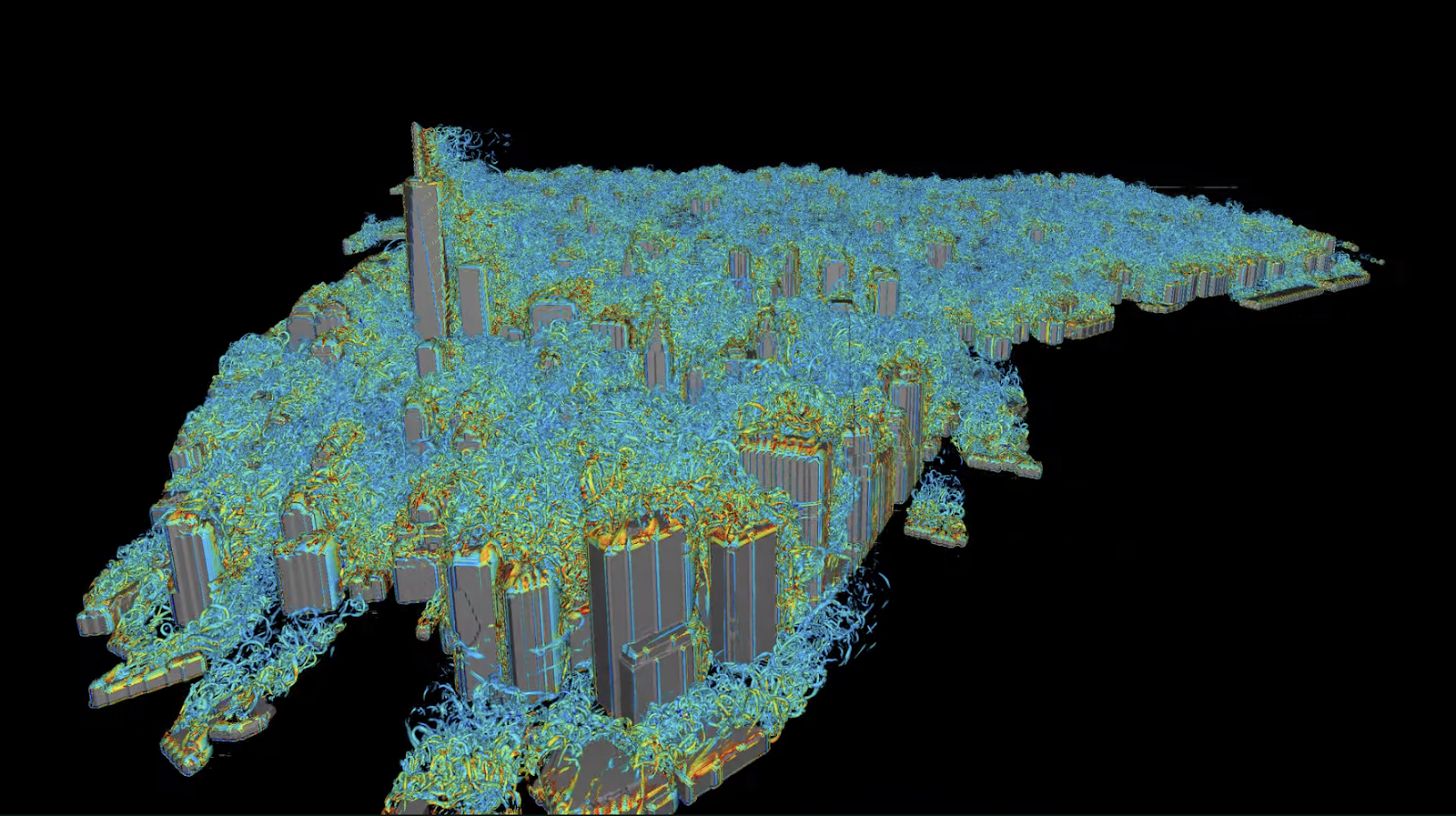

Investigación de Autodesk trae Warp speed a CFD en NVIDIA GH200

Autodesk Research, Warp de NVIDIA y GH200 muestran CFD nativo en Python con XLB: ~8x de velocidad y escala hasta ~50 mil millones de celdas.

Reduciendo la latencia en frío para la inferencia de LLM con NVIDIA Run:ai Model Streamer

Análisis detallado de cómo NVIDIA Run:ai Model Streamer disminuye los tiempos de arranque en frío al transmitir pesos a la memoria GPU, con benchmarks en GP3, IO2 y S3.

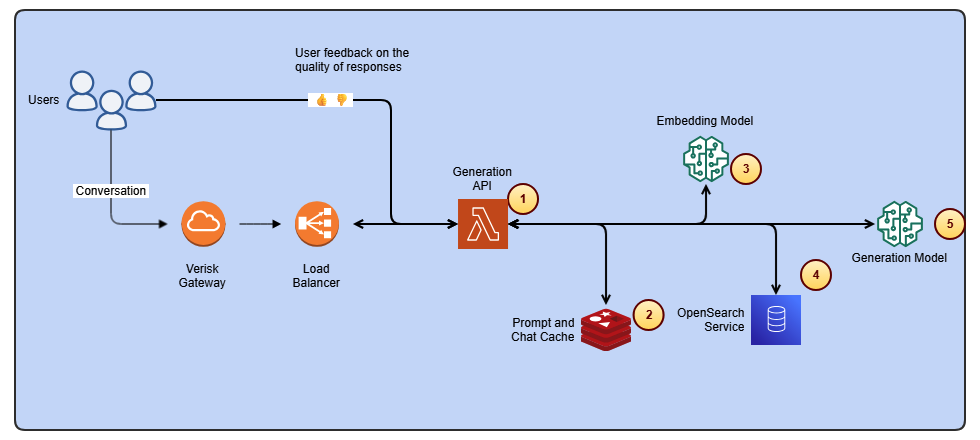

Agilizar el acceso a cambios de contenido ISO-rating con Verisk Rating Insights y Amazon Bedrock

Verisk Rating Insights, impulsado por Amazon Bedrock, LLM y RAG, ofrece una interfaz conversacional para acceder a cambios ERC ISO, reduciendo descargas manuales y acelerando información precisa.