Qué le falta a los chatbots LLM: un sentido de propósito

Sources: https://thegradient.pub/dialog, thegradient.pub

TL;DR

- Los avances en chatbots LLM miden más progreso en benchmarks que en la experiencia real del usuario, lo que sugiere la necesidad de nuevos enfoques de evaluación.

- El diálogo con propósito —conversaciones de varias rondas centradas en un objetivo— puede facilitar una colaboración humano–IA más eficaz que las interacciones de una sola pasada.

- El entrenamiento actual (preentrenamiento, formateo de diálogo, RLHF) da forma a cómo los modelos manejan instrucciones y seguridad, pero puede fallar con el turn-taking y conversaciones más largas.

- Experimentos recientes muestran que la estabilidad para seguir instrucciones se degrada a lo largo de las rondas, incluso cuando las ventanas de contexto crecen; se proponen ideas como split-softmax para mitigar esta deriva.

- Para desarrolladores y empresas, abrazar el turn-taking y modelos de usuario adaptativos podría mejorar la generación de código, los asistentes personales y el servicio al cliente, al tiempo que plantea consideraciones de seguridad.

Contexto y antecedentes

Las capacidades de los chatbots basados en LLM han ido aumentando mes a mes. Estas mejoras se miden principalmente con benchmarks como MMLU, HumanEval y MATH (p. ej., soneto 3.5, gpt-4o). Sin embargo, a medida que estas métricas se saturan, ¿la experiencia del usuario está aumentando en proporción a estas puntuaciones? Si visualizamos un futuro de colaboración humano–IA en lugar de reemplazo, las formas actuales de medir los sistemas de diálogo pueden ser insuficientes porque miden de forma no interactiva. ¿Por qué importa el diálogo con propósito? El diálogo con propósito se refiere a una conversación multironda entre usuario y chatbot que se centra en una meta o intención. La meta puede ir desde una genérica como “inofensivo y útil” hasta roles más específicos como “agente de planificación de viajes”, “psicoterapeuta” o “bot de servicio al cliente”. Planificar un viaje es un ejemplo sencillo. Nuestras preferencias y las de otros viajeros, junto con las complejidades del mundo real, hacen costosa la transmisión de toda la información en una sola pasada. Sin embargo, si se permiten intercambios de ida y vuelta, solo se comparten las informaciones importantes. La teoría de la negociación ofrece una analogía: la negociación iterativa produce mejores resultados que una oferta única. De hecho, compartir información es solo un aspecto del diálogo. En palabras de Terry Winograd: “Todo uso del lenguaje puede verse como una forma de activar procedimientos en el oyente”. Cada enunciado puede verse como una acción deliberada que toma una parte para alterar el modelo del mundo de la otra. ¿Qué pasa si ambas partes tienen metas complejas, incluso ocultas? De esta manera, el diálogo con propósito nos ofrece una forma de formular las interacciones humano–IA como un juego colaborativo, donde el objetivo del chatbot es ayudar a las personas a lograr ciertas metas. Esto puede parecer una complejidad innecesaria solo para académicos. Sin embargo, el diálogo con propósito podría ser beneficioso incluso para direcciones de investigación más pragmáticas como la generación de código. Los benchmarks de codificación actuales miden mayormente el rendimiento en una única pasada; sin embargo, para que la IA automatice la resolución de problemas comunes de GitHub (como en SWE-bench), es poco probable que se logre con una única acción: la IA necesita comunicarse con ingenieros de software humanos para entender los requisitos correctos, solicitar documentación y datos faltantes, e incluso pedir ayuda si es necesario. En una línea similar al pair programming, esto podría reducir los defectos de código sin aumentar las horas-hombre. Además, con la introducción de la toma de turnos, se abren muchas posibilidades nuevas. A medida que las interacciones se vuelven a largo plazo y se construye memoria, el chatbot puede actualizar gradualmente los perfiles de los usuarios y adaptarse a sus preferencias. Imagina un asistente personal (p. ej., IVA, Siri) que, a través de interacciones diarias, aprende tus preferencias e intenciones. Puede leer tus fuentes de información nuevas automáticamente (p. ej., Twitter, arXiv, Slack, NYT) y proporcionarte un resumen matutino de noticias según tus preferencias. Puede redactar correos electrónicos por ti y mejorar aprendiendo de tus ediciones. En resumen, las interacciones humanas significativas rara vez comienzan con extraños y no terminan en una sola consulta. Los humanos interactúan de forma natural mediante diálogos multironda y se adaptan a lo largo de la conversación. ¿Pero no parece eso exactamente lo opuesto a predecir el siguiente token, la piedra angular de los LLM modernos? A continuación, examinemos la composición de los sistemas de diálogo. ¿Cómo se hicieron/ se hacen los sistemas de diálogo? Volvamos a los años 70, cuando Roger Schank presentó su “guion de restaurante” como una especie de sistema de diálogo. Este guion descompone la experiencia típica de un restaurante en pasos como entrar, pedir, comer y pagar, cada uno con enunciados específicos. En ese entonces, cada parte del diálogo estaba cuidadosamente planificada, lo que permitía a los sistemas de IA imitar conversaciones realistas. ELIZA, simulador psicoterapéutico Rogeriano, y PARRY, un sistema que imitaba a un paranoide, fueron otros sistemas de diálogo hasta el advenimiento del aprendizaje automático. Compare este enfoque con el sistema de diálogo basado en LLM de hoy; parece misterioso cómo modelos entrenados para predecir el siguiente token pueden participar en diálogos. Por lo tanto, examinemos de cerca cómo se hacen los sistemas de diálogo, con énfasis en cómo el formato del diálogo entra en juego: (1) Pre-entrenamiento: se entrena un modelo de secuencia para predecir el siguiente token sobre un enorme corpus de textos de Internet mixtos. Las composiciones pueden variar, pero normalmente incluyen noticias, libros, código de GitHub, con una mezcla pequeña de datos de foros como Reddit o Stack Exchange, que pueden contener datos parecidos a diálogos. (2) Introducción del formateo del diálogo: dado que el modelo de secuencia solo procesa cadenas, mientras que la representación más natural del historial de diálogo es un índice estructurado de prompts del sistema y de intercambios pasados, se debe introducir un formato para facilitar la conversión. Algunos tokenizadores de Huggingface ofrecen este método llamado tokenizer.apply_chat_template para la conveniencia de los usuarios. El formato exacto difiere de un modelo a otro, pero normalmente implica encerrar los prompts del sistema con o para que el modelo preentrenado pueda dedicar más atención a ellos. El prompt del sistema desempeña un papel significativo en adaptar los modelos de lenguaje a aplicaciones y garantizar un comportamiento seguro (hablaremos más en la próxima sección). Es notable que la elección del formato es arbitraria en este paso — el corpus de preentrenamiento no sigue este formato. (3) RLHF: en este paso, el chatbot es recompensado o penalizado directamente por generar respuestas deseadas o indeseadas. Vale la pena señalar que esta es la primera vez que el formato de diálogo introducido aparece en los datos de entrenamiento. RLHF es un paso de ajuste fino no solo porque los datos son muy menores en comparación con el corpus de preentrenamiento, sino también debido a la penalización KL y al ajuste de pesos dirigido (p. ej., LoRA). Usando la analogía de LeCun sobre hacer un “pastel”, RLHF es solo la cereza en la cima. El mínimo indispensable para un sistema de diálogo es que permanezca en la tarea. De hecho, los humanos a menudo se desvían de un tema. ¿Qué tan bien operan ahora los sistemas? Actualmente, el “prompt del sistema” es el principal método para controlar el comportamiento del LM. Sin embargo, se ha encontrado evidencia de que los LLM pueden ser frágiles para seguir estas instrucciones bajo condiciones adversarias. Al interactuar con ChatGPT o Claude, cuando se abre una nueva ventana de chat, el modelo puede seguir la instrucción razonablemente bien, pero tras varias rondas ya no es tan fiel y puede incluso dejar de seguir su rol. ¿Cómo capturar cuantitativamente este fenómeno? Para el seguimiento de instrucciones en una ronda, ya contamos con benchmarks como MT-Bench y Alpaca-Eval. Sin embargo, al probar modelos en modo interactivo, es difícil anticipar qué generará el modelo y preparar una respuesta con anticipación. En un proyecto con mis colaboradores, construimos un entorno para sintetizar diálogos con duración ilimitada para evaluar la capacidad de seguimiento de instrucciones de los chatbots LLM. Para permitir una escalabilidad temporal sin límites, dejamos que dos agentes LM con prompts del sistema dialogaran entre sí durante varias rondas. Esto forma la columna vertebral del diálogo [a1, b1, a2, b2, …, a8, b8] (digamos un diálogo de 8 rondas). En este punto, podríamos entender cómo los LLMs se adhieren a sus prompts del sistema solo examinando este diálogo, pero muchas de las expresiones pueden ser irrelevantes para las instrucciones, dependiendo de a dónde vaya la conversación. Por ello, ramificamos hipotéticamente en cada ronda haciendo una pregunta directamente relacionada con los prompts del sistema y usamos una función de juicio correspondiente para cuantificar qué tan bien funciona. Todo lo que aporta el conjunto de datos es un banco de tríadas de (prompts del sistema, preguntas de sondeo y funciones de juicio). Promediando entre escenarios y pares de prompts del sistema, obtenemos una curva de estabilidad de instrucción a lo largo de las rondas. Para nuestra sorpresa, los resultados agregados en tanto LLaMA2-chat-70B como gpt-3.5-turbo-16k son alarmantes. Además de la mayor dificultad de ingeniería de prompts, la falta de estabilidad de instrucción también conlleva preocupaciones de seguridad. Cuando el chatbot se desvía de sus prompts del sistema que especifican aspectos de seguridad, se vuelve más susceptible a jailbreaks y propenso a más alucinaciones. Los resultados empíricos también contrastan con la longitud de contexto cada vez mayor de los LLM. Teóricamente, algunos modelos de contexto largo pueden atender una ventana de hasta 100k tokens. Sin embargo, en el setting de diálogo, se vuelven distraídos tras solo 1.6k tokens (asumiendo que cada intervención tiene 100 tokens). En el estudio, mostramos teóricamente cómo esto es inevitable bajo el esquema de prompts actual en un LM basado en Transformer y propusimos una técnica simple llamada split-softmax para mitigar tales efectos. En este punto, ¿por qué es tan malo? ¿Por qué los humanos no pierden su persona solo por conversar durante 8 rondas? Se podría sostener que las interacciones humanas se basan en propósitos e intenciones y que estos propósitos preceden a los medios: el LLM es, fundamentalmente, un generador fluido de inglés, y la persona es solo una capa delgada añadida. ¿Preentrenamiento? El preentrenamiento otorga al modelo de lenguaje la capacidad de modelar una distribución de personas en Internet, así como la distribución lingüística de cada persona. Sin embargo, incluso cuando una persona (o una mezcla de unas cuantas) está especificada por la instrucción de prompts del sistema, los enfoques actuales no logran aislarla por completo. RLHF? RLHF proporciona una solución poderosa para adaptar esta multi-persona…

More news

Cómo reducir cuellos de botella KV Cache con NVIDIA Dynamo

NVIDIA Dynamo offloads KV Cache desde la memoria de la GPU hacia almacenamiento económico, habilitando contextos más largos, mayor concurrencia y costos de inferencia más bajos para grandes modelos y cargas de IA generativa.

Reduciendo la latencia en frío para la inferencia de LLM con NVIDIA Run:ai Model Streamer

Análisis detallado de cómo NVIDIA Run:ai Model Streamer disminuye los tiempos de arranque en frío al transmitir pesos a la memoria GPU, con benchmarks en GP3, IO2 y S3.

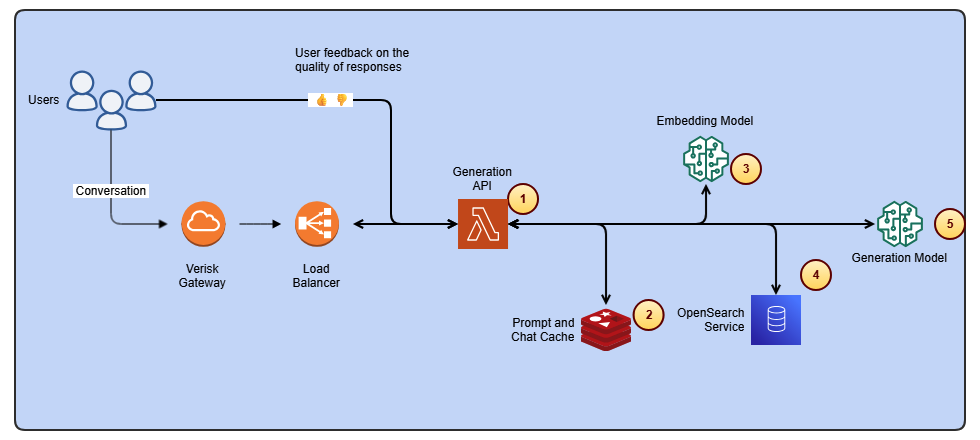

Agilizar el acceso a cambios de contenido ISO-rating con Verisk Rating Insights y Amazon Bedrock

Verisk Rating Insights, impulsado por Amazon Bedrock, LLM y RAG, ofrece una interfaz conversacional para acceder a cambios ERC ISO, reduciendo descargas manuales y acelerando información precisa.

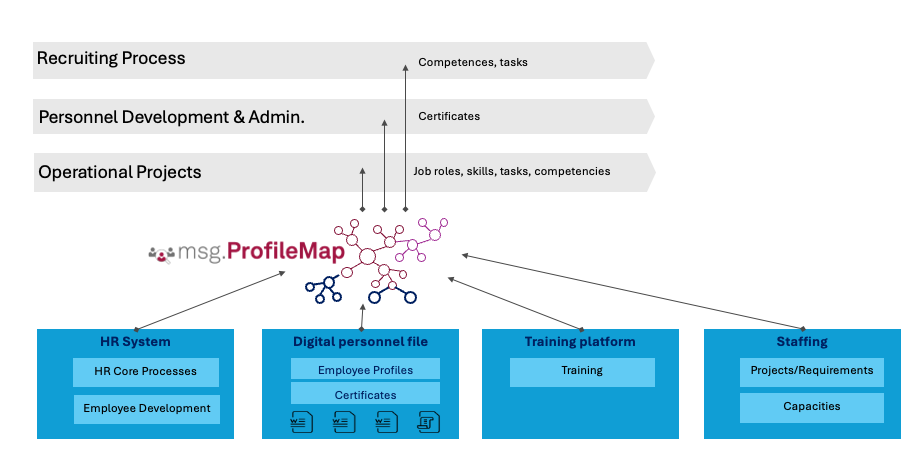

Cómo msg mejoró la transformación de la fuerza laboral de RR. HH. con Amazon Bedrock y msg.ProfileMap

Este artículo explica cómo msg automatizó la armonización de datos para msg.ProfileMap usando Amazon Bedrock para impulsar flujos de enriquecimiento impulsados por LLM, aumentando la precisión de la coincidencia de conceptos de RR. HH., reduciendo la carga de trabajo manual y alineándose con la UE A

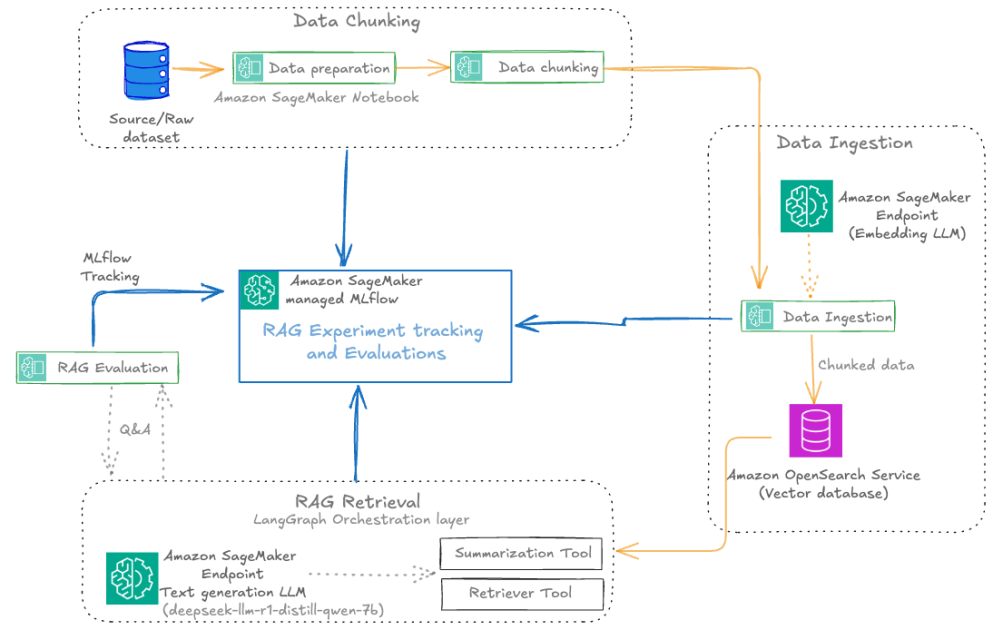

Automatizar pipelines RAG avanzados con Amazon SageMaker AI

Optimiza la experimentación a la producción para Retrieval Augmented Generation (RAG) con SageMaker AI, MLflow y Pipelines, para flujos reproducibles, escalables y con gobernanza.

Cómo la quantización consciente (QAT) recupera precisión en inferencia de baja precisión

Analiza QAT y QAD como métodos para recuperar precisión en modelos de baja precisión, utilizando el TensorRT Model Optimizer y formatos FP8/NVFP4/MXFP4.